Clear Sky Science · nl

Het effect van medische verklaringen van grote taalmodellen op diagnostische nauwkeurigheid in de radiologie

Waarom deze studie ertoe doet

Moderne ziekenhuizen nemen snel krachtige tekstgebaseerde kunstmatige-intelligentiehulpmiddelen in gebruik om artsen te helpen complexe medische informatie te begrijpen. Radiologen, die medische scans zoals CT- en MRI-beelden interpreteren, staan onder constante druk om snel en nauwkeurig te antwoorden. Deze studie stelt een eenvoudige maar belangrijke vraag: als een AI-systeem niet alleen een diagnose geeft maar ook zijn redenering uitlegt, helpt dat artsen dan daadwerkelijk betere beslissingen te nemen — en welke stijl van verklaring werkt het beste?

Verschillende manieren waarop een AI met artsen kan "praten"

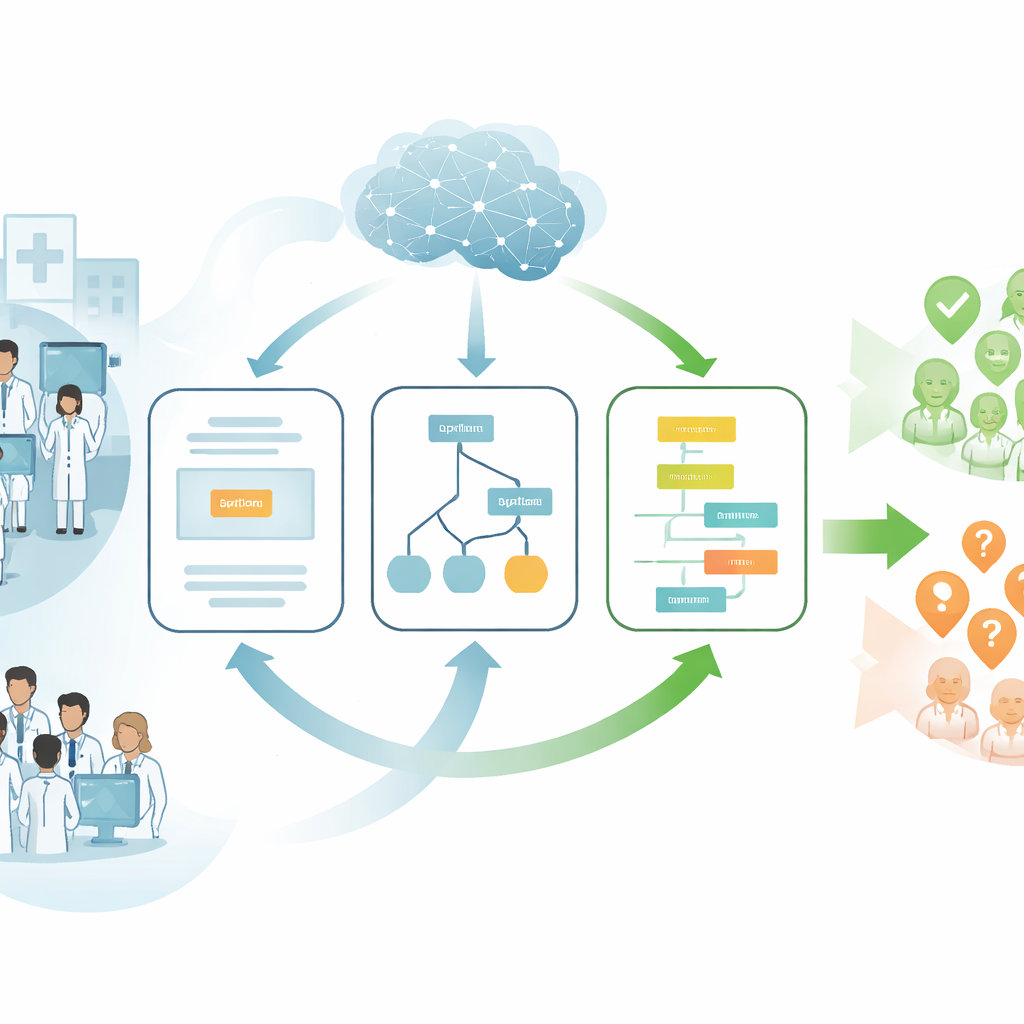

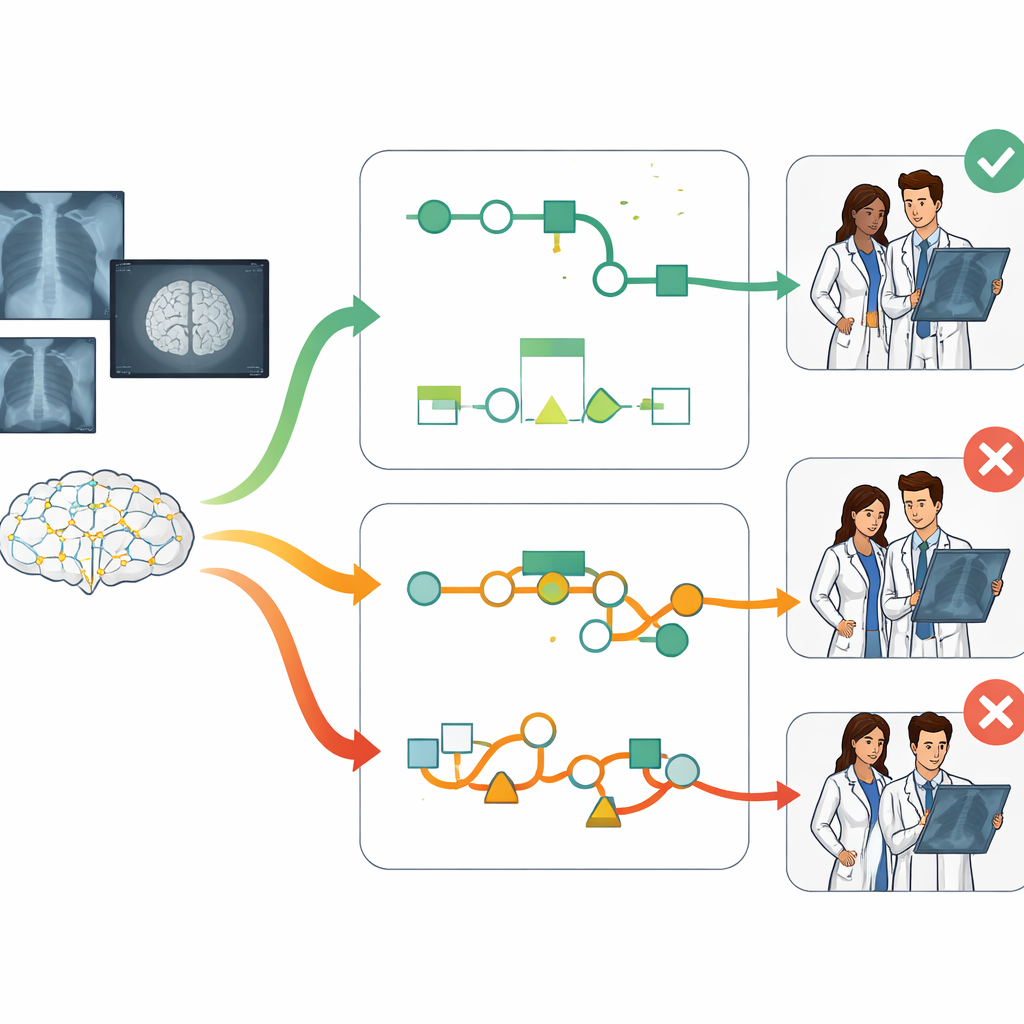

De onderzoekers richtten zich op grote taalmodellen, of LLM's — AI-systemen die natuurlijke taal kunnen lezen en schrijven en in dit geval ook medische beelden kunnen bekijken. In plaats van de AI als een black box te behandelen die één antwoord oplevert, testten ze drie verschillende manieren waarop de AI haar advies aan radiologen kon presenteren. In één formaat noemde de AI eenvoudigweg haar meest waarschijnlijke diagnose. In een ander formaat gaf zij een lijst met meerdere mogelijke diagnoses, vergelijkbaar met de mentale checklist van een arts. In het derde format liep ze stap voor stap door haar redenering, en legde uit hoe details uit de scan en de voorgeschiedenis van de patiënt tot de conclusie leidden. Het team wilde weten welke van deze verklaringsstijlen het beste het menselijk oordeel ondersteunde in plaats van het te vervangen.

Een grote test met casussen uit de praktijk

Om dit te onderzoeken, voerden de auteurs een gerandomiseerd experiment uit met 101 praktiserende radiologen in de Verenigde Staten. Elke radioloog beoordeelde 20 echte patiëntencasussen afkomstig uit een educatiereeks gepubliceerd door een vooraanstaand medisch tijdschrift. Elke casus bevatte een korte klinische beschrijving plus één of meer CT- of MRI-beelden, en de artsen moesten een vrije-tekstdiagnose invoeren, zoals ze dat in de praktijk zouden doen. Sommige radiologen kregen helemaal geen AI-hulp. Anderen zagen AI-advies in één van de drie formats: een kale diagnose, een gerangschikte lijst van vijf mogelijke diagnoses, of een gedetailleerde stap-voor-stapverklaring. De gebruikte AI was een multimodale versie van GPT-4 die zowel tekst als beelden aankan. Al zijn output — inclusief fouten — werd ongefilterd getoond om gebruik in de echte wereld na te bootsen.

Stap-voor-stapredenering verhoogt de nauwkeurigheid

De centrale vondst is duidelijk: de stijl van verklaring maakte veel uit. Radiologen die het keten-van-denken-formaat zagen — de stap-voor-stapredenering — waren merkbaar nauwkeuriger dan degenen die zonder AI werkten en ook nauwkeuriger dan degenen die alleen een enkele diagnose of een lijst met alternatieven te zien kregen. Gemiddeld verbeterde ondersteuning met keten-van-denken de diagnostische nauwkeurigheid met meer dan 12 procentpunten ten opzichte van geen AI-hulp en met 7 tot 10 punten ten opzichte van de andere AI-formaten. Deze verbeteringen bleven bestaan na correctie voor factoren zoals aantal jaren ervaring, subspecialistische opleiding en de tijd die artsen aan elke casus besteedden, wat suggereert dat de wijze van presenteren van informatie de prestaties van artsen wezenlijk kan beïnvloeden.

Goed advies opvolgen en slecht advies verwerpen

De studie onderzocht ook hoe artsen reageerden wanneer de AI gelijk of ongelijk had. Bij de differentiële diagnoselijst volgden radiologen vaak de eerste suggestie van de AI, zelfs wanneer die onjuist was — een patroon van overmatig vertrouwen dat bekendstaat als automatiseringsbias. Het keten-van-denken-formaat daarentegen stimuleerde een meer selectieve afhankelijkheid. Wanneer de diagnose van de AI correct was, waren artsen zeer geneigd die over te nemen. Maar als er iets in de stap-voor-stapredenering leek te kloppen, waren ze eerder bereid de AI te overrulen en een andere keuze te maken. Met andere woorden: gedetailleerde redenering hielp artsen inschatten wanneer ze op de machine moesten leunen en wanneer ze op hun eigen expertise moesten vertrouwen.

Robuuste resultaten over vaardigheden en specialismen heen

De voordelen van stap-voor-stapverklaringen waren zichtbaar in uiteenlopende situaties. Radiologen met zowel kortere als langere loopbanen profiteerden, net als degenen met basis- of gevorderde computervaardigheden. Het patroon hield stand voor makkelijkere en moeilijkere casussen en zowel bij algemene radiologen als bij specialisten, zoals neuroradiologen of artsen die buikbeeldvorming doen. De auteurs voerden ook talrijke statistische controles uit — waarbij ze rekening hielden met de eigen nauwkeurigheid van de AI, de lengte van zijn uitingen en verschillende modelleringsaannames — en vonden dat de superioriteit van keten-van-denken-verklaringen opmerkelijk stabiel was.

Wat dit betekent voor patiënten en toekomstige AI-tools

Voor patiënten is de boodschap voorzichtig optimistisch: AI kan radiologen helpen, maar de manier waarop het zijn redenering communiceert is cruciaal. Alleen mogelijkheden opsommen of een zelfverzekerd klinkend antwoord geven is niet genoeg en kan artsen zelfs in de richting van onjuiste keuzes duwen. In dit gecontroleerde experiment hielp AI die "hardop denkt" in een duidelijke, stapsgewijze manier artsen beter te zien wanneer de machine gelijk had en wanneer niet, wat overall leidde tot minder diagnostische fouten. Naarmate ziekenhuizen AI verder integreren in klinische workflows, kan het ontwerpen van systemen die transparante, op redenering gerichte verklaringen prioriteren een belangrijke rol spelen in het veiliger en betrouwbaarder maken van medische diagnoses.

Bronvermelding: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Trefwoorden: radiologiediagnose, medische AI, grote taalmodellen, keten-van-denken-verklaringen, klinische besluitvorming ondersteuning