Clear Sky Science · pt

O efeito de explicações médicas de grandes modelos de linguagem na acurácia diagnóstica em radiologia

Por que este estudo importa

Hospitais modernos estão adotando rapidamente ferramentas poderosas de inteligência artificial baseadas em texto para ajudar médicos a interpretar informações médicas complexas. Radiologistas, que analisam exames como tomografias e ressonâncias magnéticas, vivem sob pressão constante para fornecer respostas rápidas e precisas. Este estudo faz uma pergunta simples, porém importante: se um sistema de IA não apenas fornece um diagnóstico, mas também explica seu raciocínio, isso realmente ajuda os médicos a tomar decisões melhores — e qual estilo de explicação funciona melhor?

Diferentes formas de a IA “conversar” com os médicos

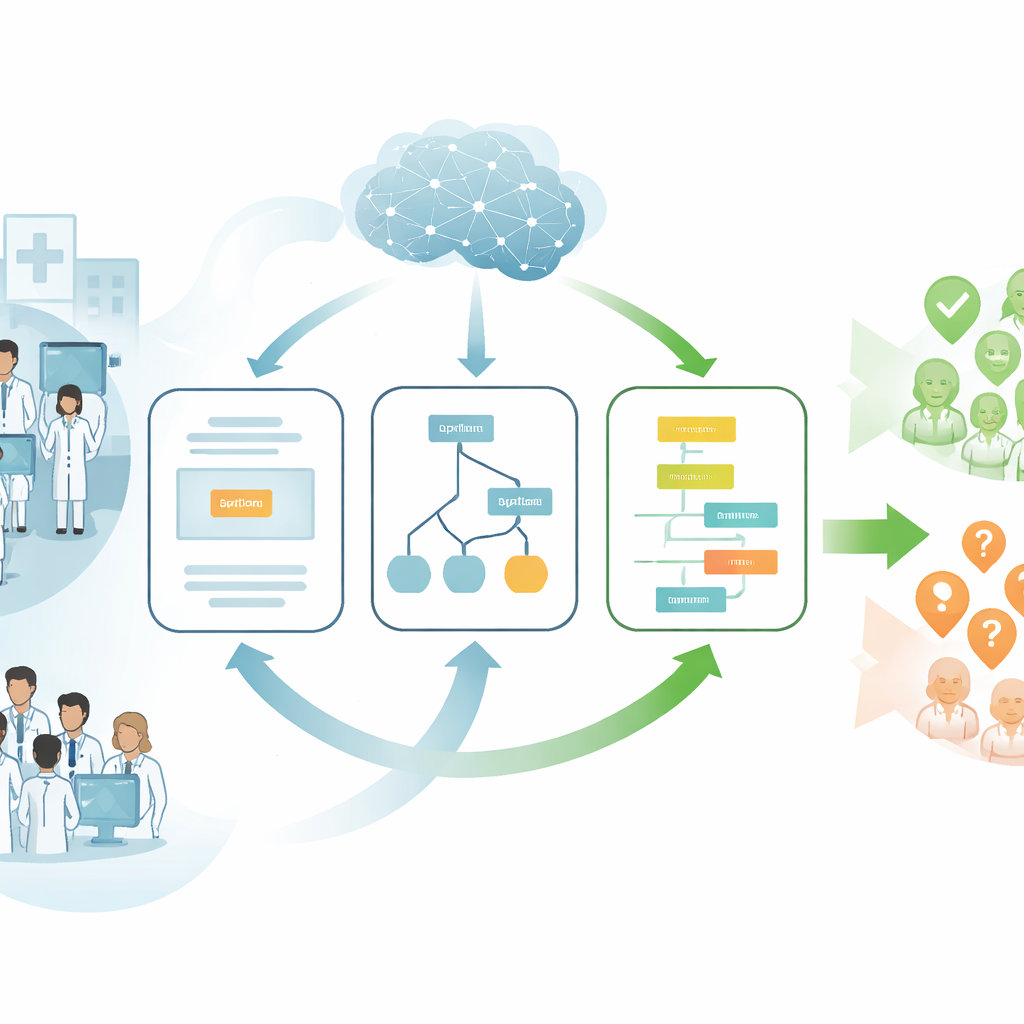

Os pesquisadores focaram em grandes modelos de linguagem, ou LLMs — sistemas de IA que podem ler e escrever linguagem natural e, neste caso, também analisar imagens médicas. Em vez de tratar a IA como uma caixa-preta que devolve uma única resposta, testaram três modos diferentes de apresentar o conselho ao radiologista. Em um formato, a IA simplesmente indicava seu diagnóstico mais provável. Em outro, listava várias hipóteses diagnósticas, como uma checagem mental que um médico faria. No terceiro, percorria seu raciocínio passo a passo, mostrando como detalhes do exame e da história do paciente levaram à conclusão. A equipe queria saber qual desses estilos de explicação apoiaria melhor o julgamento humano em vez de substituí-lo.

Um grande teste com casos reais de radiologia

Para investigar isso, os autores realizaram um experimento randomizado com 101 radiologistas em exercício nos Estados Unidos. Cada radiologista avaliou 20 casos reais de pacientes retirados de uma série educacional publicada por um periódico médico de destaque. Cada caso incluía uma breve descrição clínica e uma ou mais imagens de TC ou RM, e os médicos precisavam digitar um diagnóstico em texto livre, como fariam na prática. Alguns radiologistas não receberam ajuda da IA. Outros viram o conselho da IA em um dos três formatos: um diagnóstico isolado, uma lista ranqueada de cinco diagnósticos possíveis ou uma explicação detalhada passo a passo. A IA usada era uma versão multimodal do GPT-4 capaz de lidar com texto e imagens. Todas as saídas — incluindo erros — foram mostradas tal como geradas para imitar o uso no mundo real.

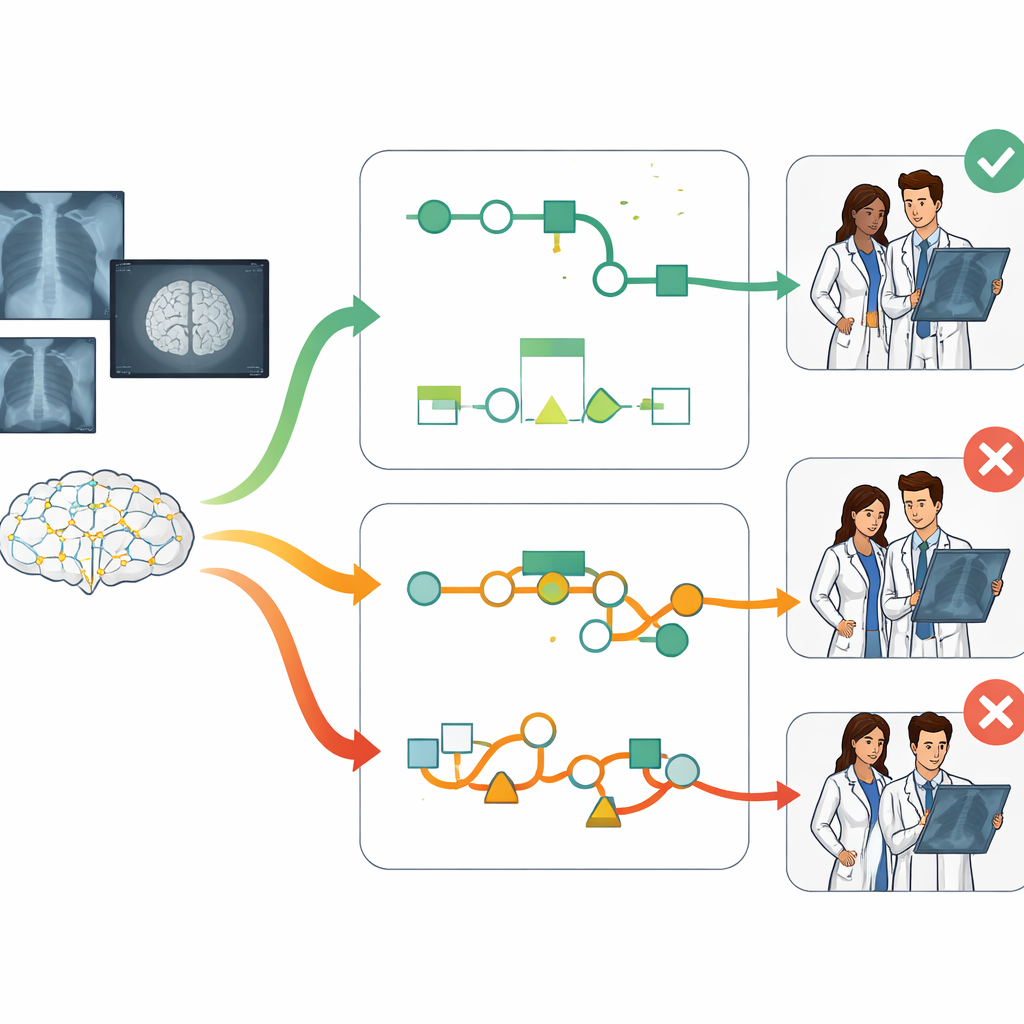

Raciocínio passo a passo aumenta a acurácia

O achado central é claro: o estilo de explicação fez grande diferença. Radiologistas que viram o estilo de cadeia de raciocínio — o raciocínio passo a passo — foram significativamente mais precisos do que aqueles que trabalharam sem IA e também mais precisos que os que viram apenas um diagnóstico único ou uma lista de alternativas. Em média, o suporte em cadeia de raciocínio melhorou a acurácia diagnóstica em mais de 12 pontos percentuais em relação à ausência de IA e em 7 a 10 pontos em relação aos outros formatos de IA. Esses ganhos se mantiveram mesmo após controlar fatores como anos de experiência, treinamento de subespecialidade e tempo gasto em cada caso, sugerindo que a forma de apresentação da informação pode alterar de maneira significativa o desempenho dos médicos.

Seguir bons conselhos e rejeitar conselhos ruins

O estudo também examinou como os médicos reagiram quando a IA estava certa ou errada. Com a lista de diagnóstico diferencial, os radiologistas tendiam a seguir a sugestão principal da IA mesmo quando ela estava incorreta — um padrão de confiança excessiva conhecido como viés de automação. Em contraste, o formato em cadeia de raciocínio incentivou uma confiança mais seletiva. Quando o diagnóstico da IA estava correto, os médicos eram muito propensos a concordar. Mas quando algo no raciocínio passo a passo parecia errado, eles estavam mais dispostos a sobrepor a decisão da IA e escolher outra alternativa. Em outras palavras, o raciocínio detalhado ajudou os médicos a julgar quando apoiar-se na máquina e quando confiar em sua própria expertise.

Resultados robustos entre habilidades e especialidades

As vantagens das explicações passo a passo foram observadas em uma ampla gama de situações. Radiologistas com carreiras mais curtas e mais longas se beneficiaram, assim como aqueles com habilidades computacionais básicas ou avançadas. O padrão se manteve para casos mais fáceis e mais difíceis e tanto para radiologistas gerais quanto para especialistas, como neurorradiologistas ou especialistas em imagem abdominal. Os autores também realizaram diversas checagens estatísticas — controlando pela própria acurácia da IA, pelo comprimento das saídas e por diferentes pressupostos de modelagem — e constataram que a superioridade das explicações em cadeia de raciocínio foi notavelmente estável.

O que isso significa para pacientes e futuras ferramentas de IA

Para os pacientes, a mensagem é cautelosamente otimista: a IA pode ajudar radiologistas, mas a forma como comunica seu raciocínio é crucial. Simplesmente listar possibilidades ou fornecer uma resposta que soa confiante não é suficiente e pode até levar médicos a escolhas incorretas. Neste experimento controlado, uma IA que “pensa em voz alta” de forma clara e sequencial ajudou os médicos a detectar melhor quando a máquina estava certa e quando estava errada, resultando em menos erros diagnósticos no conjunto. À medida que hospitais continuam a integrar IA nos fluxos clínicos, projetar sistemas que priorizem explicações transparentes e centradas no raciocínio pode desempenhar um papel fundamental para tornar os diagnósticos médicos mais seguros e confiáveis.

Citação: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Palavras-chave: diagnóstico em radiologia, IA médica, grandes modelos de linguagem, explicações em cadeia de raciocínio, suporte à decisão clínica