Clear Sky Science · it

L’effetto delle spiegazioni mediche fornite dai grandi modelli linguistici sulla precisione diagnostica in radiologia

Perché questo studio è importante

Gli ospedali moderni stanno adottando rapidamente potenti strumenti di intelligenza artificiale basati su testo per aiutare i medici a interpretare informazioni cliniche complesse. I radiologi, che interpretano esami come TAC e risonanze magnetiche, sono sotto continua pressione per fornire risposte rapide e accurate. Questo studio pone una domanda semplice ma cruciale: se un sistema di IA non solo fornisce una diagnosi ma ne spiega anche il ragionamento, questo aiuta davvero i medici a prendere decisioni migliori — e quale stile di spiegazione funziona meglio?

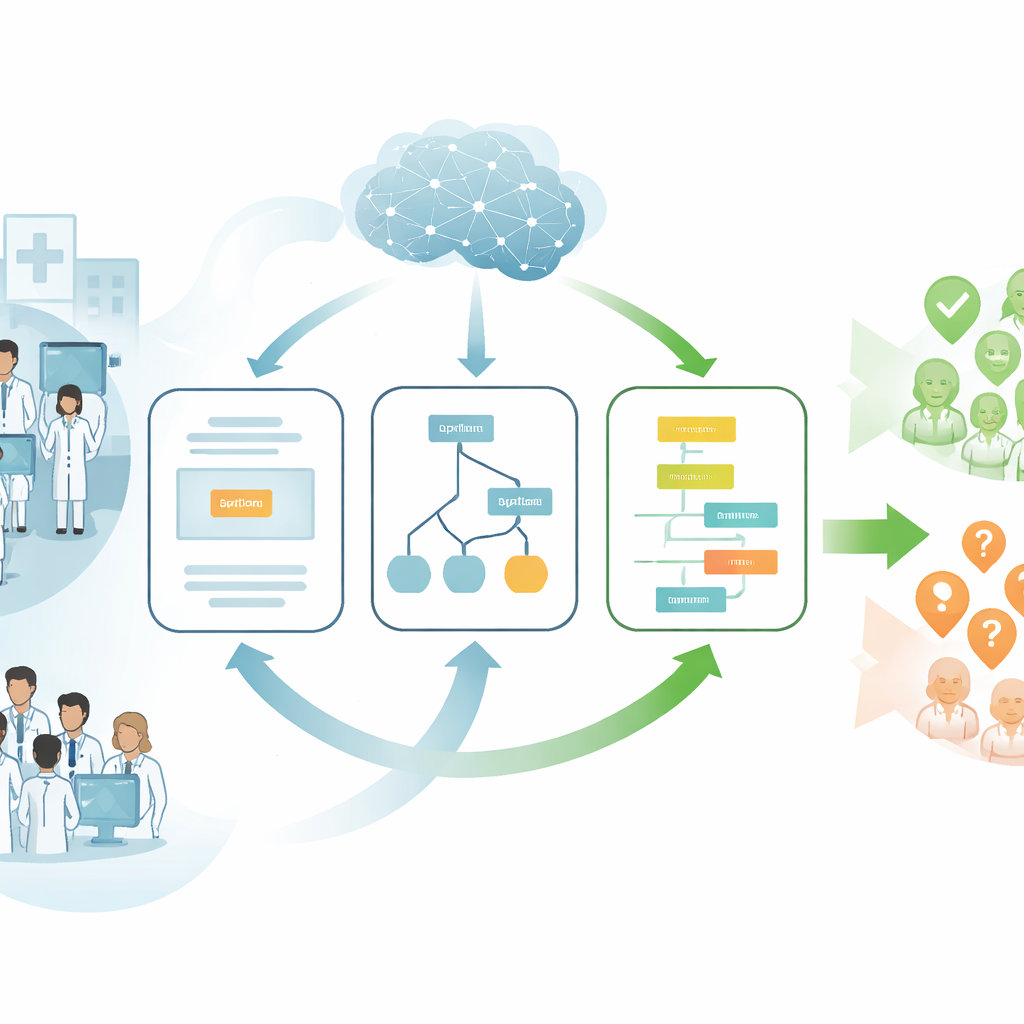

Diverse modalità con cui un’IA può “parlare” ai medici

I ricercatori si sono concentrati sui grandi modelli linguistici, o LLM — sistemi di IA che possono leggere e scrivere linguaggio naturale e, in questo caso, anche analizzare immagini mediche. Invece di trattare l’IA come una scatola nera che fornisce una singola risposta, hanno testato tre modalità diverse con cui poteva presentare i propri suggerimenti ai radiologi. In un formato l’IA ha semplicemente indicato la diagnosi migliore. In un altro ha elencato diverse possibili diagnosi, come una checklist mentale del medico. Nel terzo ha illustrato passo dopo passo il proprio ragionamento, mostrando come i dettagli della scansione e la storia del paziente portassero alla conclusione. Il gruppo voleva capire quale di questi stili di spiegazione sostenesse meglio il giudizio umano anziché sostituirlo.

Un ampio test con casi radiologici reali

Per indagare la questione, gli autori hanno condotto un esperimento randomizzato con 101 radiologi in attività negli Stati Uniti. Ogni radiologo ha esaminato 20 casi clinici reali tratti da una serie didattica pubblicata da una rivista medica di riferimento. Ogni caso includeva una breve descrizione clinica e una o più immagini TAC o RM, e i medici dovevano inserire una diagnosi in testo libero, proprio come nella pratica quotidiana. Alcuni radiologi non hanno ricevuto alcun aiuto dall’IA. Altri hanno visto il consiglio dell’IA in uno dei tre formati: una diagnosi secca, una lista graduata di cinque possibili diagnosi, o una spiegazione dettagliata passo dopo passo. L’IA utilizzata era una versione multimodale di GPT-4 in grado di gestire testo e immagini. Tutti i suoi output — inclusi gli errori — sono stati mostrati così come erano per riprodurre l’uso reale.

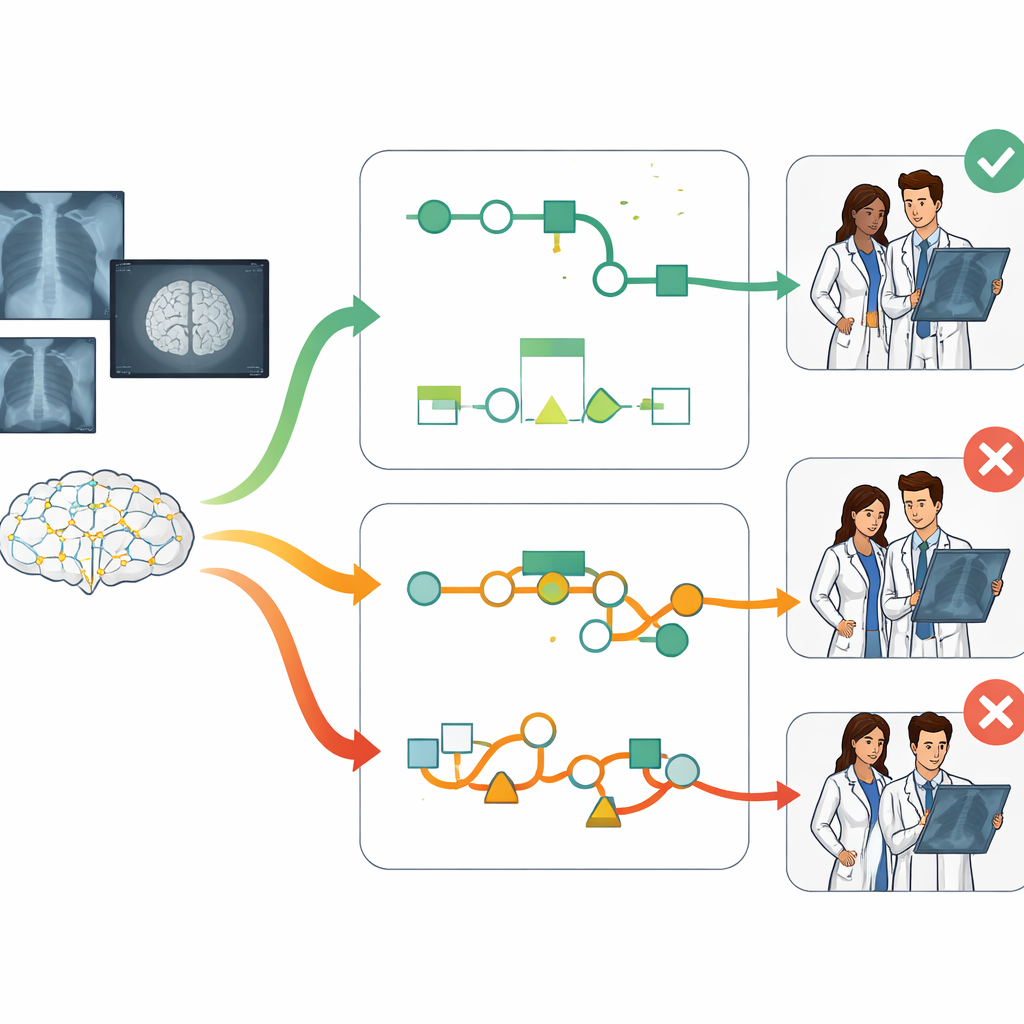

Il ragionamento passo dopo passo aumenta la precisione

Il risultato centrale è netto: lo stile di spiegazione ha grande importanza. I radiologi che hanno visto lo stile catena di pensiero — il ragionamento passo dopo passo — sono risultati decisamente più accurati rispetto a quelli che lavoravano senza IA e anche più accurati rispetto a chi ha visto solo una singola diagnosi o una lista di alternative. In media, il supporto con catena di pensiero ha migliorato la precisione diagnostica di oltre 12 punti percentuali rispetto all’assenza di aiuto dell’IA e di 7-10 punti rispetto agli altri formati di IA. Questi miglioramenti hanno resistito anche dopo aver tenuto conto di fattori come gli anni di esperienza, la formazione di sottospecialità e il tempo dedicato dai medici a ciascun caso, suggerendo che il modo in cui l’informazione è presentata può modificare in modo significativo le prestazioni cliniche.

Seguire i buoni consigli e rifiutare i cattivi

Lo studio ha anche analizzato come i medici si comportassero quando l’IA era corretta o sbagliava. Con la lista di diagnosi differenziali, i radiologi tendevano a seguire il suggerimento principale dell’IA anche quando era errato, un fenomeno di eccessiva fiducia noto come bias di automazione. Al contrario, il formato con la catena di pensiero incoraggiava una dipendenza più selettiva. Quando la diagnosi dell’IA era corretta, i medici erano molto propensi ad allinearsi; ma quando qualcosa nel ragionamento passo dopo passo appariva scorretto, erano più inclini a sovrascrivere l’IA e scegliere una risposta diversa. In altre parole, il ragionamento dettagliato aiutava i medici a valutare quando affidarsi alla macchina e quando fidarsi della propria esperienza.

Risultati robusti attraverso competenze e specialità

I vantaggi delle spiegazioni passo dopo passo sono emersi in molteplici situazioni. Hanno beneficiato sia radiologi con carriere più brevi sia quelli con più esperienza, così come chi possedeva competenze informatiche di base o avanzate. Il pattern si è mantenuto per casi più semplici e più complessi e sia per radiologi generali sia per specialisti, come neuroradiologi o esperti di imaging addominale. Gli autori hanno inoltre eseguito numerosi controlli statistici — controllando per l’accuratezza dell’IA, la lunghezza dei suoi output e diverse assunzioni di modellizzazione — e hanno trovato che la superiorità delle spiegazioni in catena di pensiero era sorprendentemente stabile.

Cosa significa per i pazienti e gli strumenti di IA futuri

Per i pazienti, il messaggio è cautamente ottimistico: l’IA può aiutare i radiologi, ma il modo in cui comunica il proprio ragionamento è cruciale. Limitarsi a elencare possibilità o a fornire una risposta che suona sicura non basta e può persino indurre i medici verso scelte errate. In questo esperimento controllato, l’IA che “pensa ad alta voce” in modo chiaro e progressivo ha aiutato i medici a riconoscere meglio quando la macchina aveva ragione e quando sbagliava, riducendo complessivamente gli errori diagnostici. Man mano che gli ospedali integrano l’IA nei flussi di lavoro clinici, progettare sistemi che privilegino spiegazioni trasparenti e incentrate sul ragionamento potrebbe svolgere un ruolo chiave nel rendere le diagnosi mediche più sicure e affidabili.

Citazione: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Parole chiave: diagnosi radiologica, IA medica, grandi modelli linguistici, spiegazioni passo dopo passo, supporto decisionale clinico