Clear Sky Science · de

Die Wirkung medizinischer Erklärungen von großen Sprachmodellen auf die Diagnosegenauigkeit in der Radiologie

Warum diese Studie wichtig ist

Moderne Krankenhäuser führen schnell leistungsfähige, textbasierte KI-Tools ein, um Ärzten zu helfen, komplexe medizinische Informationen zu verstehen. Radiologen, die medizinische Aufnahmen wie CT- und MRT-Bilder interpretieren, stehen unter ständigem Druck, schnell und präzise Antworten zu liefern. Diese Studie stellt eine einfache, aber wichtige Frage: Wenn ein KI-System nicht nur eine Diagnose liefert, sondern auch seine Überlegungen erklärt, hilft das den Ärzten tatsächlich, bessere Entscheidungen zu treffen — und welcher Erklärungsstil ist am effektivsten?

Verschiedene Arten, wie eine KI mit Ärzten „spricht“

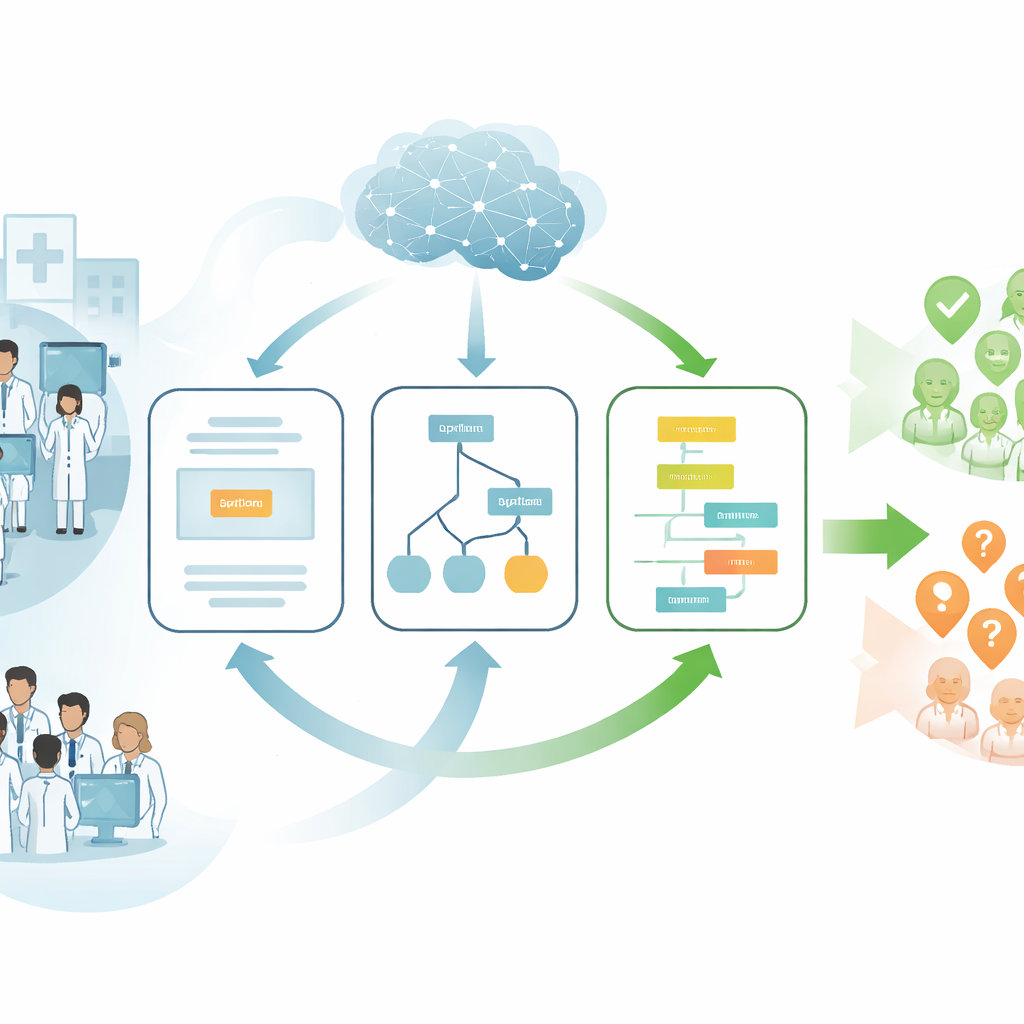

Die Forschenden konzentrierten sich auf große Sprachmodelle, kurz LLMs — KI-Systeme, die natürliche Sprache lesen und schreiben können und in diesem Fall auch medizinische Bilder betrachten. Statt die KI als Black Box zu behandeln, die nur eine einzige Antwort ausgibt, testeten sie drei verschiedene Formen, in denen sie Radiologinnen und Radiologen ihre Empfehlung präsentieren konnte. In einem Format nannte die KI schlicht ihre wahrscheinlichste Diagnose. In einem anderen listete sie mehrere mögliche Diagnosen auf, ähnlich einer mentalen Checkliste eines Arztes. Im dritten führte sie Schritt für Schritt ihre Schlussfolgerungen aus und zeigte, wie Details aus dem Scan und der Patientengeschichte zur Diagnose geführt hatten. Das Team wollte wissen, welcher dieser Erklärungsstile die menschliche Urteilsbildung am besten unterstützt, statt sie zu ersetzen.

Ein großer Test mit realen radiologischen Fällen

Um das zu untersuchen, führten die Autorinnen und Autoren ein randomisiertes Experiment mit 101 praktizierenden Radiologen in den Vereinigten Staaten durch. Jeder Radiologe begutachtete 20 reale Patientenfälle aus einer Fortbildungsreihe, die in einer führenden medizinischen Fachzeitschrift veröffentlicht wurde. Jeder Fall enthielt eine kurze klinische Beschreibung sowie ein oder mehrere CT- oder MRT-Bilder, und die Ärztinnen und Ärzte mussten eine Freitextdiagnose eingeben, so wie im echten Leben. Einige Radiologen erhielten überhaupt keine KI-Hilfe. Andere sahen die KI-Empfehlung in einem der drei Formate: eine nackte Diagnose, eine nach Rang geordnete Liste von fünf möglichen Diagnosen oder eine detaillierte Schritt-für-Schritt-Erklärung. Verwendet wurde eine multimodale Version von GPT-4, die sowohl Text als auch Bilder verarbeiten kann. Alle Ausgaben der KI — einschließlich Fehlern — wurden unverändert angezeigt, um die reale Nutzung nachzuahmen.

Schritt-für-Schritt-Argumentation steigert die Genauigkeit

Das zentrale Ergebnis ist klar: Der Erklärungsstil machte einen großen Unterschied. Radiologen, die die Ketten-von-Gedanken-Erklärungen — also die schrittweise Argumentation — sahen, waren signifikant genauer als diejenigen ohne KI-Hilfe und auch genauer als diejenigen, die nur eine einzelne Diagnose oder eine Liste von Alternativen erhielten. Im Durchschnitt verbesserte die Ketten-von-Gedanken-Unterstützung die diagnostische Genauigkeit um mehr als 12 Prozentpunkte gegenüber keiner KI-Hilfe und um 7 bis 10 Punkte gegenüber den anderen KI-Formaten. Diese Verbesserungen blieben bestehen, selbst nachdem Faktoren wie Berufserfahrung, Facharztausbildung und die für jeden Fall aufgewendete Zeit berücksichtigt wurden, was darauf hindeutet, dass die Art der Informationsdarstellung die Leistung der Ärztinnen und Ärzte merklich verändern kann.

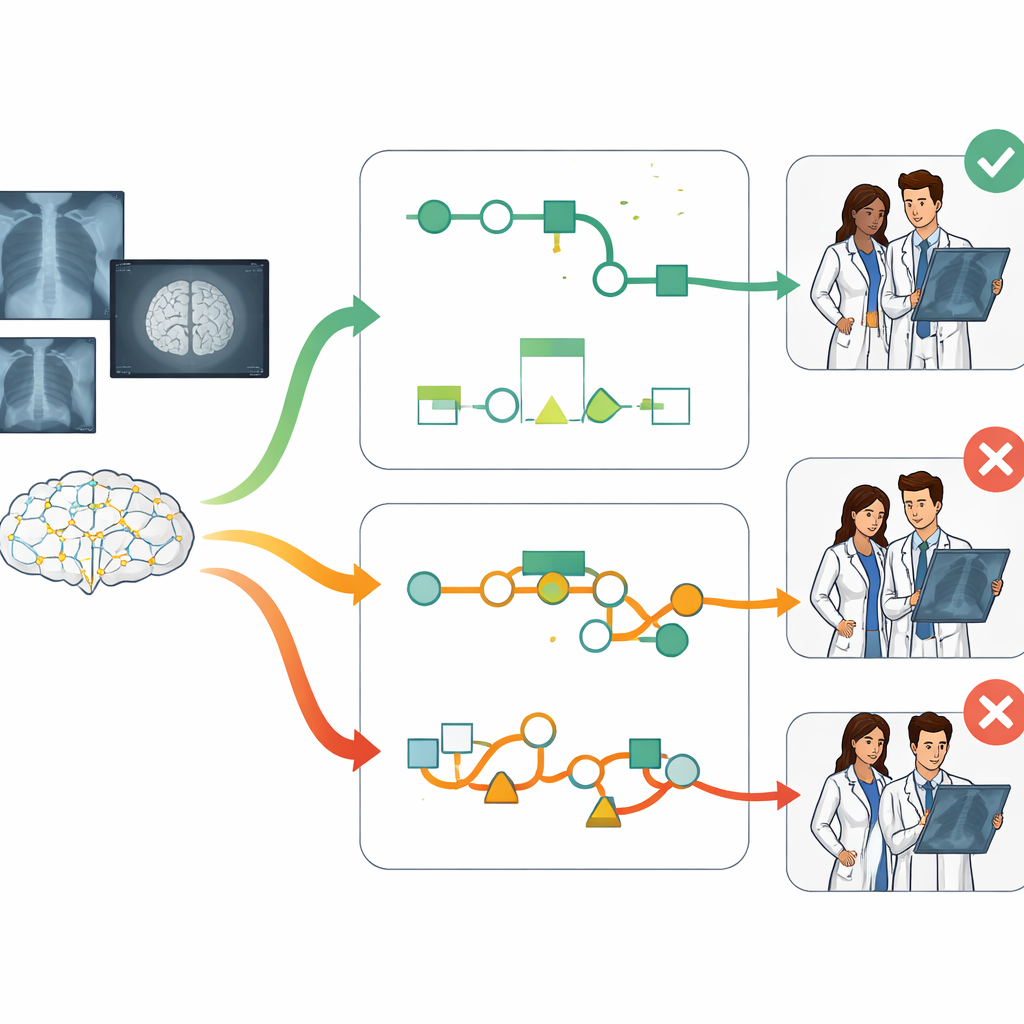

Gute Ratschläge befolgen und schlechte zurückweisen

Die Studie untersuchte auch, wie Ärztinnen und Ärzte reagierten, wenn die KI richtig oder falsch lag. Bei der Differenzialdiagnoseliste neigten Radiologen dazu, dem obersten Vorschlag der KI zu folgen, selbst wenn dieser falsch war — ein Muster übermäßigen Vertrauens, bekannt als Automationsbias. Im Gegensatz dazu förderte das Ketten-von-Gedanken-Format eine selektivere Nutzung. War die Diagnose der KI korrekt, stimmten die Ärztinnen und Ärzte sehr wahrscheinlich zu. Wirkte jedoch etwas in der schrittweisen Begründung fehlerhaft, waren sie eher bereit, die KI zu übergehen und eine andere Antwort zu wählen. Anders gesagt half die detaillierte Argumentation den Ärzten zu beurteilen, wann sie sich auf die Maschine verlassen sollten und wann sie auf ihr eigenes Urteil vertrauen sollten.

Robuste Ergebnisse über Fähigkeiten und Fachrichtungen hinweg

Die Vorteile der Schritt-für-Schritt-Erklärungen zeigten sich in einer breiten Palette von Situationen. Radiologen mit kürzeren und längeren Karriereverläufen profitierten gleichermaßen, ebenso diejenigen mit grundlegenden oder fortgeschrittenen Computerkenntnissen. Das Muster hielt bei leichteren und schwierigeren Fällen sowie bei Allgemeinradiologen und Spezialisten, etwa in der Neuroradiologie oder der abdominalen Bildgebung, an. Die Autorinnen und Autoren führten zudem zahlreiche statistische Prüfungen durch — wobei sie die Genauigkeit der KI selbst, die Länge ihrer Ausgaben und verschiedene Modellannahmen kontrollierten — und fanden, dass die Überlegenheit der Ketten-von-Gedanken-Erklärungen bemerkenswert stabil war.

Was das für Patienten und zukünftige KI-Tools bedeutet

Für Patientinnen und Patienten ist die Botschaft vorsichtig optimistisch: KI kann Radiologinnen und Radiologen helfen, aber die Art und Weise, wie sie ihre Schlussfolgerungen vermittelt, ist entscheidend. Einfach Möglichkeiten aufzulisten oder eine selbstsicher klingende Antwort zu geben, reicht nicht aus und kann Ärztinnen und Ärzte sogar in Richtung falscher Entscheidungen lenken. In diesem kontrollierten Experiment half die KI, die „laut nachdachte“ — also in einer klaren, schrittweisen Weise argumentierte — den Ärztinnen und Ärzten besser zu erkennen, wann die Maschine richtig lag und wann sie falsch lag, was insgesamt zu weniger Diagnosefehlern führte. Wenn Krankenhäuser KI weiterhin in klinische Arbeitsabläufe integrieren, könnte das Design von Systemen, die transparente, auf Argumentation fokussierte Erklärungen priorisieren, eine Schlüsselrolle dabei spielen, medizinische Diagnosen sicherer und verlässlicher zu machen.

Zitation: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Schlüsselwörter: radiologische Diagnose, medizinische KI, große Sprachmodelle, Ketten-von-Gedanken-Erklärungen, klinische Entscheidungsunterstützung