Clear Sky Science · pl

Wpływ medycznych wyjaśnień generowanych przez duże modele językowe na trafność diagnoz w radiologii

Dlaczego to badanie ma znaczenie

Współczesne szpitale szybko wdrażają potężne narzędzia sztucznej inteligencji oparte na tekście, by pomagać lekarzom w interpretacji złożonych informacji medycznych. Radiolodzy, którzy analizują badania obrazowe, takie jak tomografia komputerowa (CT) czy rezonans magnetyczny (MRI), są pod stałą presją, by dostarczać szybkie i trafne odpowiedzi. Badanie stawia proste, lecz istotne pytanie: jeśli system AI nie tylko podaje diagnozę, lecz także tłumaczy swoje rozumowanie, czy rzeczywiście pomaga to lekarzom w podejmowaniu lepszych decyzji — i jaki styl wyjaśnień działa najlepiej?

Różne sposoby komunikacji AI z lekarzami

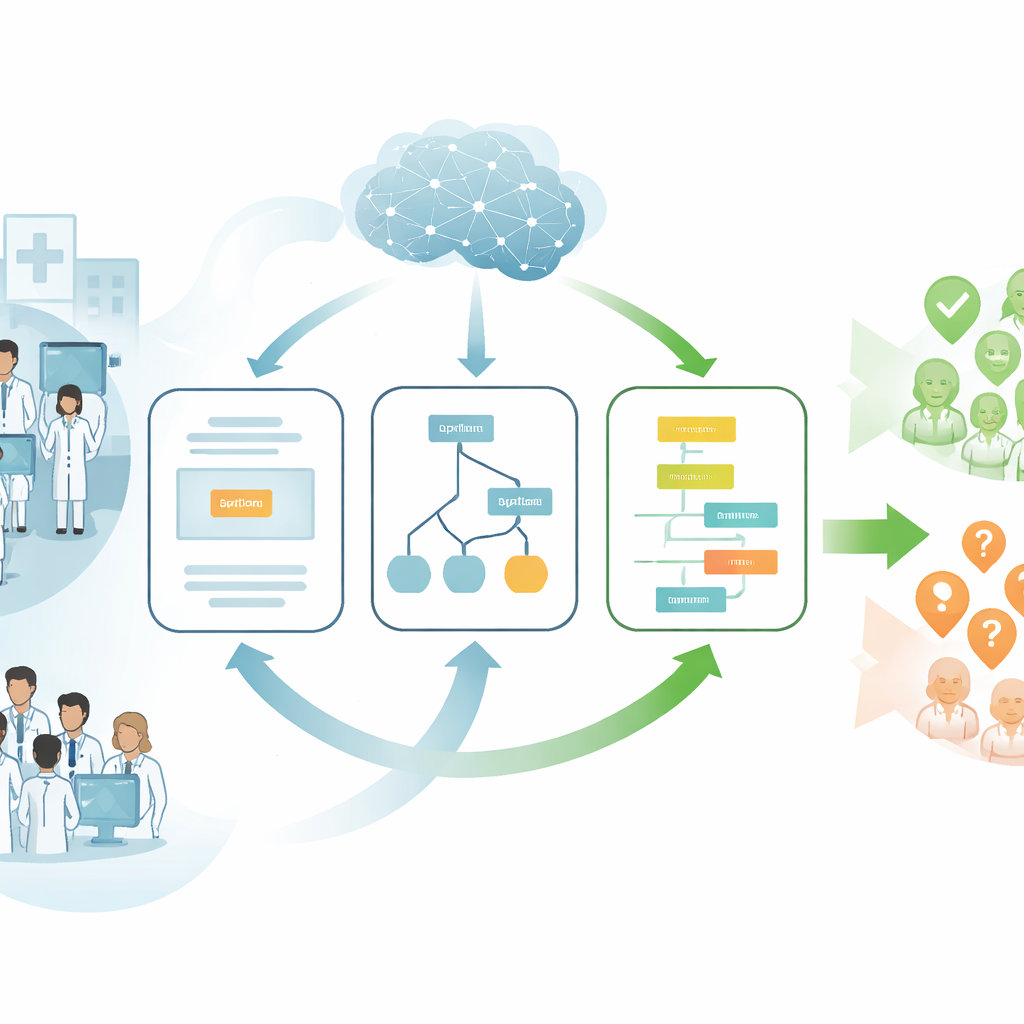

Naukowcy skupili się na dużych modelach językowych (LLM) — systemach AI potrafiących czytać i pisać w języku naturalnym, a w tym badaniu także analizować obrazy medyczne. Zamiast traktować AI jako czarną skrzynkę, która zwraca jedną odpowiedź, przetestowali trzy różne formaty prezentacji zaleceń radiologom. W jednym formacie AI podawało jedynie swoją najbardziej prawdopodobną diagnozę. W innym wymieniało kilka możliwych rozpoznań, podobnie jak lista kontrolna w myśli lekarza. W trzecim wyjaśniało krok po kroku swoje rozumowanie, pokazując, jak szczegóły z obrazu i historia chorego prowadzą do wniosku. Zespół chciał ustalić, który styl wyjaśnień najlepiej wspiera ludzkie osądy zamiast je zastępować.

Duży test na rzeczywistych przypadkach radiologicznych

Aby to zbadać, autorzy przeprowadzili randomizowany eksperyment z udziałem 101 praktykujących radiologów w Stanach Zjednoczonych. Każdy radiolog oceniał 20 rzeczywistych przypadków pacjentów zaczerpniętych z cyklu edukacyjnego opublikowanego przez wiodące czasopismo medyczne. Każdy przypadek zawierał krótką informację kliniczną oraz jedno lub więcej badań CT lub MRI, a lekarze musieli wpisać diagnozę w formie tekstu swobodnego, tak jak w praktyce. Część radiologów nie otrzymała żadnej pomocy AI. Inni widzieli porady AI w jednym z trzech formatów: jedynie diagnozę, uszeregowaną listę pięciu możliwych rozpoznań lub szczegółowe wyjaśnienie krok po kroku. Wykorzystany model AI był multimodalną wersją GPT-4, potrafiącą przetwarzać tekst i obrazy. Wszystkie jej wyniki — włącznie z błędami — były pokazywane bez zmian, aby naśladować użycie w rzeczywistych warunkach.

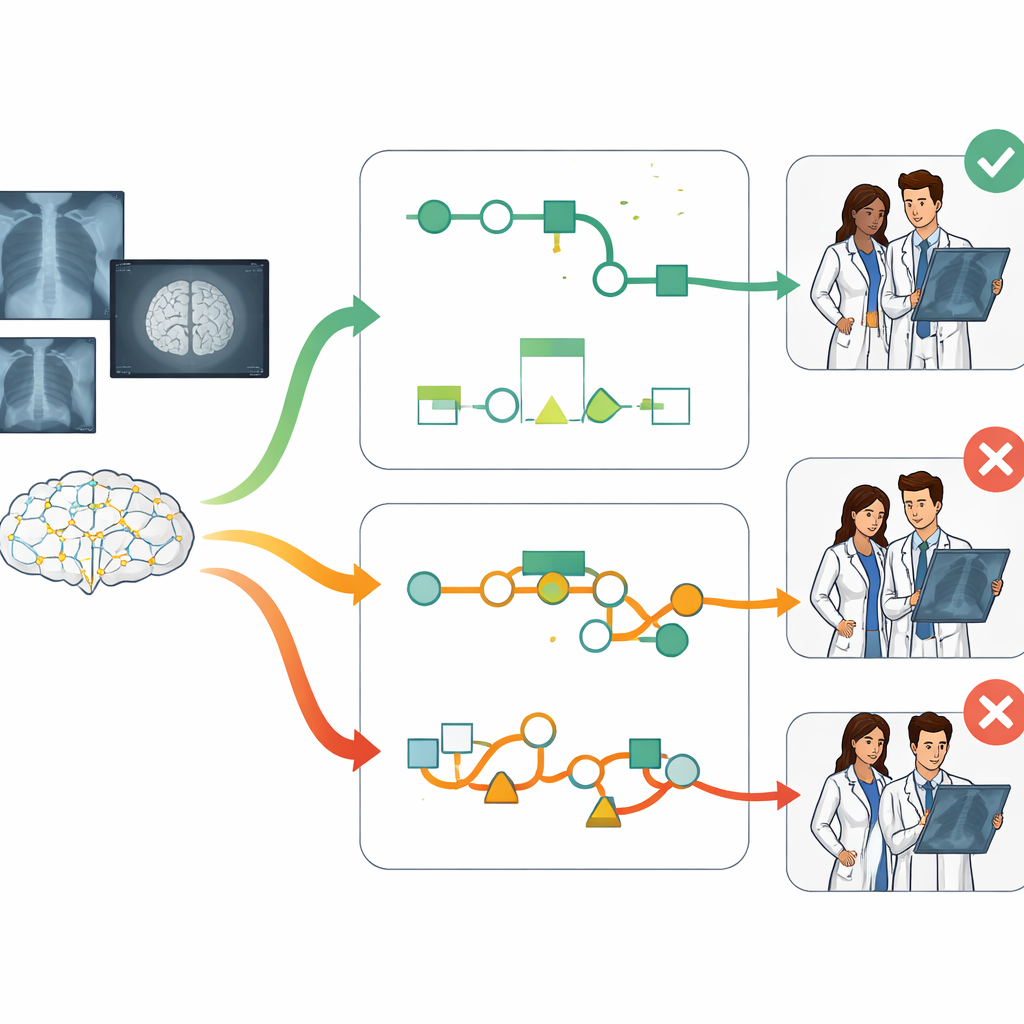

Rozumowanie krok po kroku zwiększa trafność

Główne odkrycie jest jednoznaczne: styl wyjaśnień miał duże znaczenie. Radiolodzy, którzy widzieli wyjaśnienia w formie łańcucha myślenia — rozumowanie krok po kroku — byli zauważalnie bardziej trafni niż ci pracujący bez wsparcia AI, a także bardziej trafni niż osoby, które otrzymały jedynie pojedynczą diagnozę lub listę alternatyw. Średnio wsparcie w formie łańcucha myślenia poprawiło trafność diagnostyczną o ponad 12 punktów procentowych w porównaniu z brakiem pomocy AI i o 7–10 punktów w porównaniu z innymi formatami AI. Te korzyści utrzymywały się nawet po uwzględnieniu czynników takich jak lata doświadczenia, szkolenie w podspecjalnościach oraz czas poświęcony na każdy przypadek, co sugeruje, że sposób prezentacji informacji może istotnie wpływać na wyniki pracy lekarzy.

Podejmowanie dobrych rad i odrzucanie złych

Badanie analizowało również, jak lekarze reagowali, gdy AI miała rację lub błądziła. Przy liście rozważań różnicowych radiolodzy mieli tendencję do kierowania się górną sugestią AI nawet wtedy, gdy była ona błędna — wzorzec nadmiernego zaufania znany jako uprzedzenie automatyzacji. Natomiast format łańcucha myślenia sprzyjał bardziej selektywnemu poleganiu na maszynie. Gdy diagnoza AI była poprawna, lekarze rzadko się z nią nie zgadzali. Ale gdy coś w krokowym rozumowaniu wydawało się nie w porządku, chętniej ją odrzucali i wybierali inną odpowiedź. Innymi słowy, szczegółowe rozumowanie pomagało lekarzom ocenić, kiedy polegać na maszynie, a kiedy zaufać własnej wiedzy.

Solidne wyniki w różnych umiejętnościach i specjalnościach

Zalety wyjaśnień krok po kroku były widoczne w szerokim spektrum sytuacji. Korzyści odnotowano zarówno u radiologów z krótszym, jak i dłuższym stażem, podobnie u osób z podstawowymi i zaawansowanymi umiejętnościami komputerowymi. Wzorzec utrzymywał się dla łatwiejszych i trudniejszych przypadków oraz dla radiologów ogólnych i tych pracujących w wyspecjalizowanych dziedzinach, takich jak neuroradiologia czy obrazowanie jamy brzusznej. Autorzy przeprowadzili także liczne kontrole statystyczne — kontrolując trafność AI, długość jej odpowiedzi i różne założenia modelowe — i stwierdzili, że przewaga wyjaśnień łańcucha myślenia była wyjątkowo stabilna.

Co to oznacza dla pacjentów i przyszłych narzędzi AI

Dla pacjentów przesłanie jest ostrożnie optymistyczne: AI może wspierać radiologów, ale kluczowe jest, jak przekazuje swoje rozumowanie. Sama lista możliwości czy pewnie brzmiąca odpowiedź nie wystarczą i mogą nawet skłaniać lekarzy do błędnych decyzji. W kontrolowanym eksperymencie AI, które „myślało na głos” w jasny, krokowy sposób, pomagało lekarzom lepiej rozpoznać, kiedy maszyna ma rację, a kiedy się myli, co prowadziło do mniejszej liczby błędów diagnostycznych. W miarę jak szpitale będą integrować AI z procesami klinicznymi, projektowanie systemów priorytetyzujących przejrzyste, skoncentrowane na rozumowaniu wyjaśnienia może odegrać kluczową rolę w zwiększaniu bezpieczeństwa i wiarygodności diagnoz medycznych.

Cytowanie: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Słowa kluczowe: diagnoza radiologiczna, medyczna sztuczna inteligencja, duże modele językowe, wyjaśnienia łańcucha myślenia, wsparcie decyzji klinicznych