Clear Sky Science · es

El efecto de las explicaciones médicas de los modelos de lenguaje grande en la precisión diagnóstica en radiología

Por qué importa este estudio

Los hospitales modernos están adoptando rápidamente potentes herramientas de inteligencia artificial basadas en texto para ayudar a los médicos a interpretar información médica compleja. Los radiólogos, que interpretan exploraciones médicas como TC y resonancias magnéticas, están sometidos a la presión constante de ofrecer respuestas rápidas y precisas. Este estudio plantea una pregunta sencilla pero importante: si un sistema de IA no solo ofrece un diagnóstico sino que además explica su razonamiento, ¿ayuda eso realmente a los médicos a tomar mejores decisiones—y qué estilo de explicación funciona mejor?

Diferentes maneras en que una IA puede "hablar" con los médicos

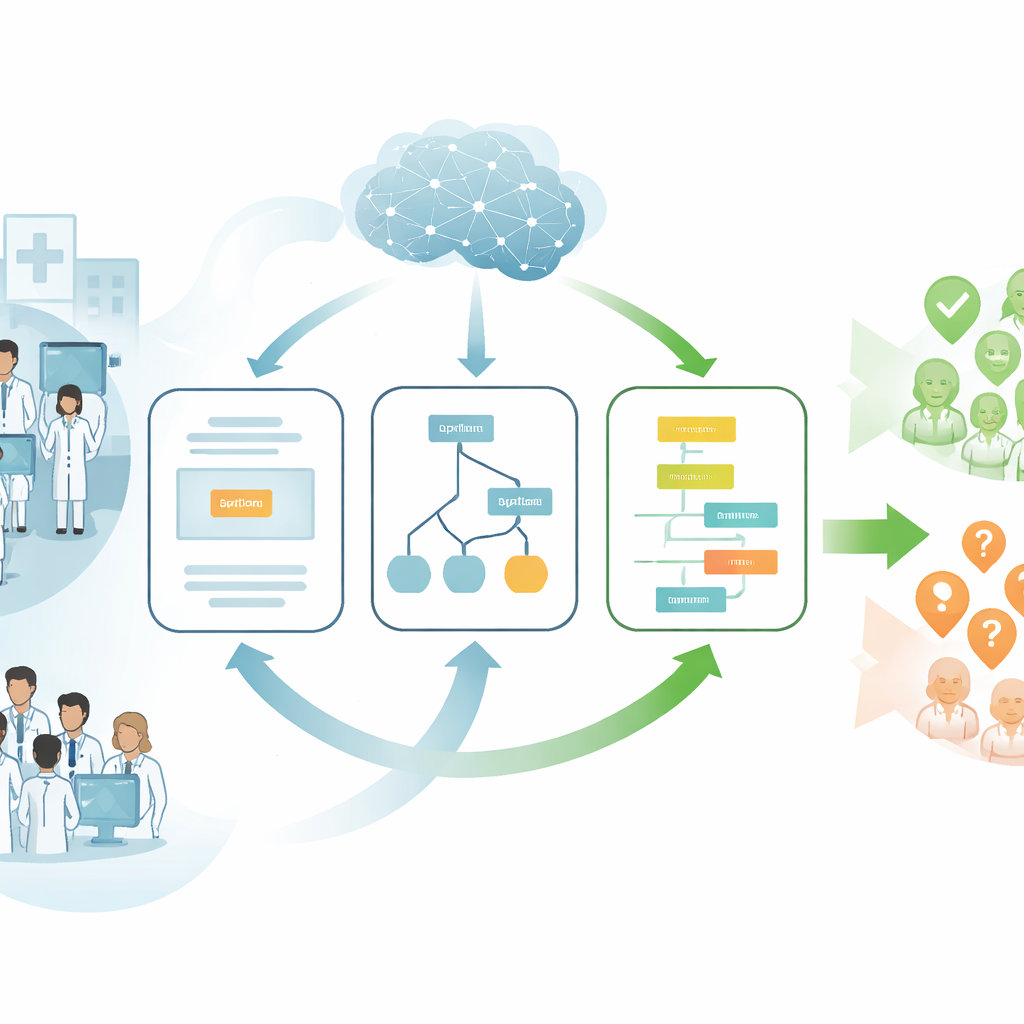

Los investigadores se centraron en modelos de lenguaje grande, o LLM—sistemas de IA que pueden leer y escribir lenguaje natural y que, en este caso, también interpretan imágenes médicas. En vez de tratar la IA como una caja negra que escupe una única respuesta, probaron tres formas distintas en que podía presentar su consejo a los radiólogos. En un formato, la IA simplemente daba su diagnóstico más probable. En otro, enumeraba varios diagnósticos posibles, algo similar a la lista mental de verificación de un médico. En el tercero, desglosaba su razonamiento paso a paso, mostrando cómo los detalles de la exploración y la historia clínica del paciente conducían a su conclusión. El equipo quería saber cuál de estos estilos de explicación apoyaría mejor el juicio humano en lugar de sustituirlo.

Una prueba amplia con casos reales de radiología

Para investigar esto, los autores realizaron un experimento aleatorizado con 101 radiólogos en activo en Estados Unidos. Cada radiólogo revisó 20 casos reales de pacientes extraídos de una serie educativa publicada por una revista médica de referencia. Cada caso incluía una breve descripción clínica y una o más imágenes de TC o resonancia, y los médicos debían redactar un diagnóstico en texto libre, tal como lo harían en la práctica. Algunos radiólogos no recibieron ayuda de la IA. Otros vieron el consejo de la IA en uno de los tres formatos: un diagnóstico aislado, una lista ordenada de cinco diagnósticos posibles, o una explicación detallada paso a paso. La IA utilizada era una versión multimodal de GPT-4 capaz de manejar texto e imágenes. Todas sus salidas—incluidos los errores—se mostraron tal cual para imitar el uso en el mundo real.

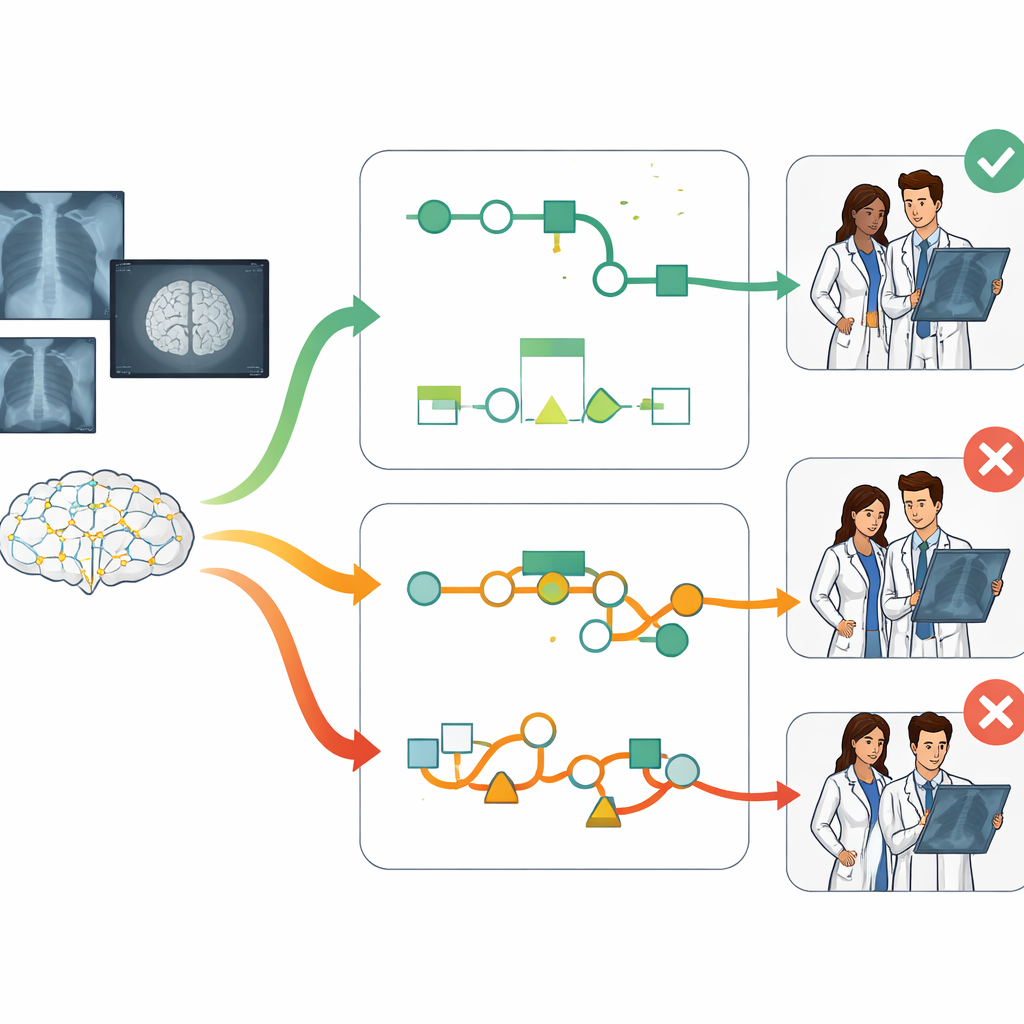

El razonamiento paso a paso mejora la precisión

El hallazgo central es claro: el estilo de explicación importó mucho. Los radiólogos que vieron el estilo en cadena de pensamiento—el razonamiento paso a paso—fueron notablemente más precisos que los que trabajaron sin IA y también más precisos que los que vieron solo un diagnóstico o una lista de alternativas. En promedio, el apoyo en cadena de pensamiento mejoró la precisión diagnóstica en más de 12 puntos porcentuales respecto a no contar con IA y en 7 a 10 puntos respecto a los otros formatos de IA. Estas mejoras se mantuvieron incluso tras controlar factores como los años de experiencia, la subespecialidad y el tiempo que los médicos dedicaron a cada caso, lo que sugiere que la manera de presentar la información puede cambiar de forma significativa el rendimiento clínico.

Seguir buenos consejos y rechazar los malos

El estudio también analizó cómo respondían los médicos cuando la IA acertaba o se equivocaba. Con la lista de diagnóstico diferencial, los radiólogos tendían a seguir la sugerencia principal de la IA incluso cuando era incorrecta, un patrón de confianza excesiva conocido como sesgo de automatización. En cambio, el formato en cadena de pensamiento fomentó una dependencia más selectiva. Cuando el diagnóstico de la IA era correcto, los médicos tenían mucha probabilidad de aceptarlo. Pero cuando algo en el razonamiento paso a paso parecía erróneo, estaban más dispuestos a sobreponer su criterio y elegir una respuesta distinta. En otras palabras, el razonamiento detallado ayudó a los médicos a juzgar cuándo apoyarse en la máquina y cuándo confiar en su propia experiencia.

Resultados sólidos a través de habilidades y especialidades

Las ventajas de las explicaciones paso a paso se observaron en una amplia gama de situaciones. Se beneficiaron radiólogos con carreras tanto más cortas como más largas, así como aquellos con habilidades informáticas básicas o avanzadas. El patrón se mantuvo en casos más fáciles y más complejos y tanto en radiólogos generales como en especialistas, por ejemplo, en neurorradiología o imagen abdominal. Los autores también realizaron numerosos controles estadísticos—controlando la propia precisión de la IA, la longitud de sus salidas y diferentes supuestos de modelado—y encontraron que la superioridad de las explicaciones en cadena de pensamiento era notablemente estable.

Qué significa esto para los pacientes y las futuras herramientas de IA

Para los pacientes, el mensaje es cautelosamente optimista: la IA puede ayudar a los radiólogos, pero la forma en que comunica su razonamiento es crucial. Simplemente enumerar posibilidades o dar una respuesta con tono seguro no es suficiente y puede incluso empujar a los médicos hacia decisiones incorrectas. En este experimento controlado, la IA que “pensaba en voz alta” de forma clara y por pasos ayudó a los médicos a detectar mejor cuándo la máquina tenía razón y cuándo no, reduciendo en conjunto los errores diagnósticos. A medida que los hospitales integren la IA en los flujos de trabajo clínicos, diseñar sistemas que prioricen explicaciones transparentes y centradas en el razonamiento podría desempeñar un papel clave para que los diagnósticos médicos sean más seguros y fiables.

Cita: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Palabras clave: diagnóstico en radiología, IA médica, modelos de lenguaje grande, explicaciones en cadena de pensamiento, soporte a la decisión clínica