Clear Sky Science · tr

Büyük dil modellerinin tıbbi açıklamalarının radyolojide tanısal doğruluk üzerindeki etkisi

Bu çalışma neden önemli

Modern hastaneler, doktorların karmaşık tıbbi bilgiyi anlamalarına yardımcı olmak için güçlü metin tabanlı yapay zeka araçlarını hızla benimsiyor. BT ve MR gibi tıbbi görüntüleri yorumlayan radyologlar, hızlı ve doğru yanıtlar verme baskısı altında. Bu çalışma basit ama önemli bir soruyu soruyor: bir yapay zeka sistemi sadece bir tanı vermekle kalmayıp düşünme sürecini de açıklarsa, bu gerçekten doktorların daha iyi karar vermesine yardımcı olur mu—ve hangi açıklama tarzı en iyi sonucu verir?

Yapay zekanın doktorlarla "konuşma" biçimleri

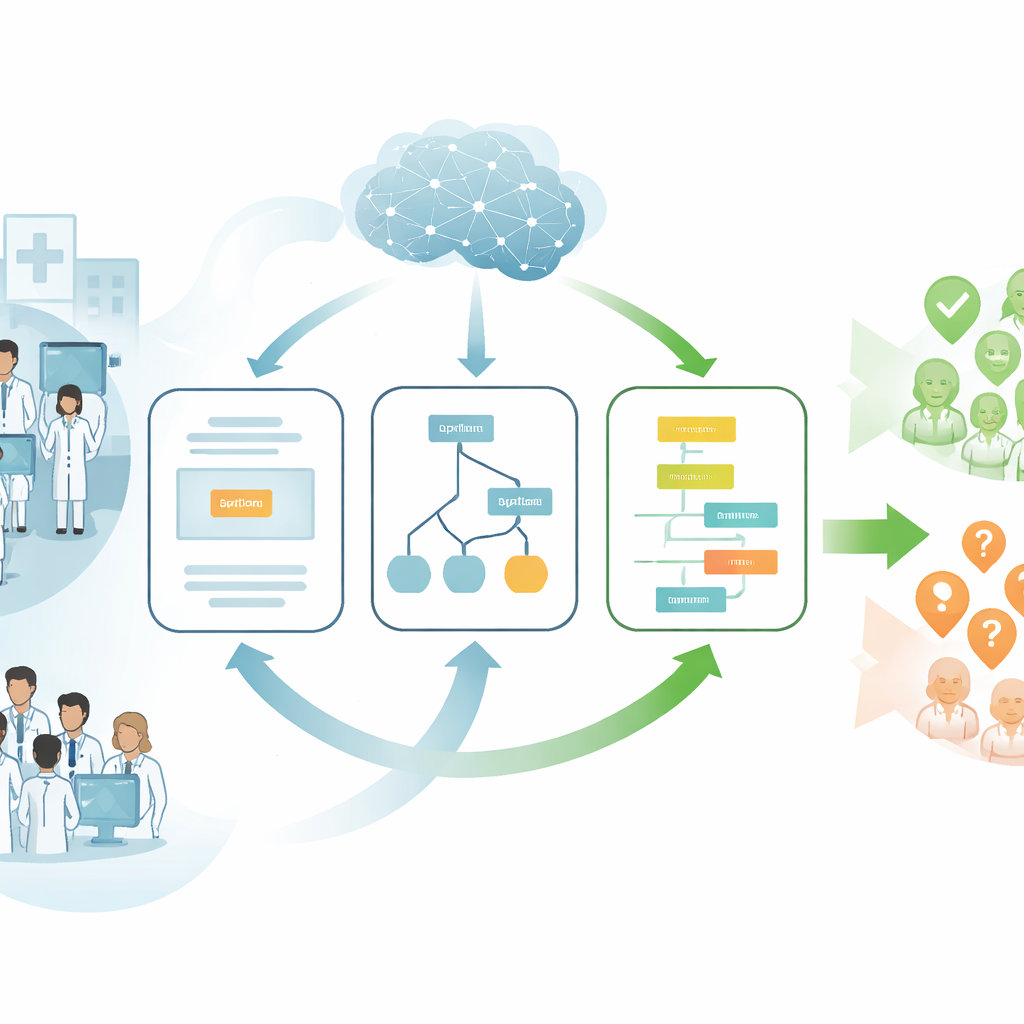

Araştırmacılar, doğal dili okuyup yazabilen ve bu durumda tıbbi görüntülere de bakabilen büyük dil modelleri (LLM'ler) üzerine odaklandı. Yapay zekayı tek bir cevap veren kara kutu olarak görmek yerine, radyologlara tavsiyelerini sunabileceği üç farklı yolu test ettiler. Bir formatta yapay zeka yalnızca en iyi tahmin ettiği tanıyı adlandırdı. Başka bir formatta, bir doktorun zihinsel kontrol listesi gibi birkaç olası tanıyı sıraladı. Üçüncüde ise, taramadan ve hastanın öyküsünden elde edilen ayrıntıların sonuca nasıl yol açtığını adım adım açıklayan bir mantık yürütme sundu. Ekip, bu açıklama stillerinden hangisinin insan yargısını ikame etmek yerine en iyi şekilde destekleyeceğini bilmek istedi.

Gerçek dünya radyoloji vakalarıyla büyük bir test

Bunu araştırmak için yazarlar, Amerika Birleşik Devletleri'nde çalışan 101 radyologla rastgele atamalı bir deney gerçekleştirdi. Her radyolog, önde gelen bir tıp dergisi tarafından yayımlanan bir eğitim serisinden alınmış 20 gerçek hasta vakasını gözden geçirdi. Her vaka kısa bir klinik açıklama ve bir veya daha fazla BT ya da MR görüntüsü içeriyordu; doktorlar gerçek hayatta olduğu gibi serbest metinle bir tanı yazmak zorundaydı. Bazı radyologlar hiç yapay zeka yardımı almadı. Diğerleri, üç formattan birinde yapay zeka önerisi gördü: yalın bir tanı, beş olası tanının sıralandığı bir liste veya ayrıntılı bir adım adım açıklama. Kullanılan yapay zeka, metin ve görüntüleri işleyebilen çok modlu bir GPT-4 sürümüydü. Tüm çıktıları—hatalar da dahil—gerçek kullanım koşullarını taklit etmek için olduğu gibi gösterildi.

Adım adım akıl yürütme doğruluğu artırıyor

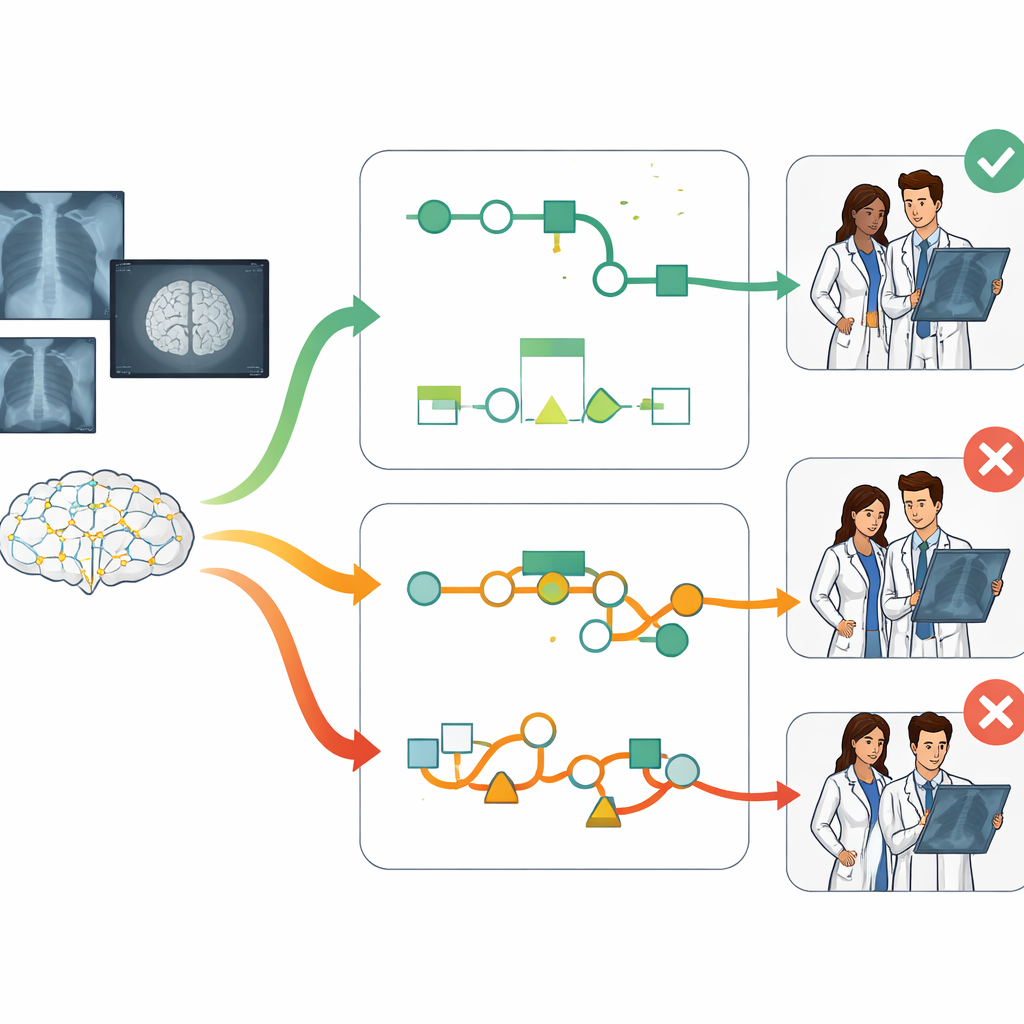

Merkezi bulgu açık: açıklama stili büyük ölçüde etkiliydi. Düşünce zinciri stili—adım adım akıl yürütme—gören radyologlar, yapay zekasız çalışanlara göre ve yalnızca tek bir tanı ya da alternatifler listesi görenlere göre belirgin şekilde daha doğru sonuç verdi. Ortalama olarak, düşünce zinciri desteği tanı doğruluğunu yapay zeka desteği olmayan duruma göre 12 puandan fazla, diğer yapay zeka formatlarına göre ise 7 ila 10 puan arasında artırdı. Bu kazanımlar, deneyim yılları, uzmanlık alanı eğitimi ve doktorların her vaka üzerinde harcadığı süre gibi faktörler göz önüne alındığında da devam etti; bu da bilgilerin sunuluş biçiminin doktorların başarısını anlamlı biçimde değiştirebileceğini gösteriyor.

İyi tavsiyeyi takip etmek ve kötü tavsiyeyi reddetmek

Çalışma ayrıca yapay zeka doğru veya yanlış olduğunda doktorların nasıl yanıt verdiğini de inceledi. Farklı tanı listesiyle, radyologlar yapay zekanın en üst önerisini yanlış olduğunda bile takip etme eğilimindeydi; bu, otomasyon yanlılığı olarak bilinen aşırı güvenme örneğiydi. Buna karşılık, düşünce zinciri formatı daha seçici bir güvenme davranışını teşvik etti. Yapay zekanın tanısı doğru olduğunda doktorlar büyük olasılıkla onunla aynı fikirde oldu. Ancak adım adım akıl yürütmede bir şeyler yanlış görünüyorsa, yapay zekayı geçersiz kılmaya ve farklı bir yanıt seçmeye daha istekliydiler. Başka bir deyişle, ayrıntılı akıl yürütme doktorların makineye ne zaman dayanacaklarını ve ne zaman kendi uzmanlıklarına güveneceklerini değerlendirmelerinde yardımcı oldu.

Beceriler ve uzmanlık alanları arasında sağlam sonuçlar

Adım adım açıklamaların avantajları çok çeşitli durumlarda görüldü. Hem daha kısa hem de daha uzun kariyere sahip radyologlar fayda sağladı; aynı şekilde temel veya ileri düzey bilgisayar becerilerine sahip olanlar da yarar gördü. Bu desen daha kolay ve daha zor vakalar için, genel radyologlar ve nöro-radyoloji ya da abdominal görüntüleme gibi uzmanlaşmış alanlarda çalışanlar için de geçerliydi. Yazarlar ayrıca yapay zekanın kendi doğruluğunu, çıktı uzunluğunu ve farklı modelleme varsayımlarını kontrol eden çok sayıda istatistiksel test çalıştırdı ve düşünce zinciri açıklamalarının üstünlüğünün dikkat çekici biçimde kararlı olduğunu buldu.

Bu durum hastalar ve gelecek yapay zeka araçları için ne anlama geliyor

Hastalar için mesaj temkinli iyimserlik: Yapay zeka radyologlara yardımcı olabilir, ama akıl yürütmesini nasıl iletişim kurduğuna dikkat etmek kritik. Olasılıkları basitçe listelemek ya da kendinden emin bir cevap vermek yeterli değil ve hatta doktorları yanlış seçimlere yönlendirebilir. Bu kontrollü deneyde, açık ve adım adım şekilde "düşünen" yapay zeka, hekimlerin makinenin ne zaman doğru ne zaman yanlış olduğunu daha iyi görmesine yardımcı oldu ve genel olarak daha az tanı hatasına yol açtı. Hastaneler yapay zekayı klinik iş akışlarına entegre etmeye devam ederken, şeffaf ve akıl yürütmeye odaklı açıklamaları önceliklendiren sistemlerin tıbbi tanıları daha güvenli ve güvenilir kılmada önemli bir rol oynayabileceği düşünülüyor.

Atıf: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Anahtar kelimeler: radyoloji tanısı, tıbbi yapay zeka, büyük dil modelleri, düşünce zinciri açıklamaları, klinik karar desteği