Clear Sky Science · zh

PsychiatryBench:用于评估大型语言模型在精神病学领域表现的多任务基准

这项工作对心理健康与人工智能的重要性

心理健康问题影响着全球数亿人,但许多人仍然无法获得及时且高质量的护理。与此同时,基于大型语言模型(LLM)的强大聊天机器人正迅速进入医生办公室、疗法应用乃至日常搜索引擎。本文介绍了PsychiatryBench,这是一种评估这些系统究竟在多大程度上理解精神病学医学的新方法。它提出了一个简单却紧迫的问题:当今的人工智能工具能否以安全、可靠且接近专家水平的方式来分析复杂的心理健康病例?

基于真实临床知识的新测试

以往大多数评估人工智能在心理健康领域能力的尝试,依赖社交媒体帖子、小规模访谈记录,甚至由其他人工智能系统编造的对话。这些远不能与用于培训精神科医生的经过深思熟虑的病例史和考试题相提并论。PsychiatryBench 采用了不同的路径。作者构建了一个包含5,188道题目的题库,这些题目仅来自可信的精神病学教科书、病例集和自测指南。该基准覆盖十一类任务,从命名诊断和选择治疗到制定持续护理计划、回答基础知识问题以及随时间跟踪病例。焦点放在门诊环境中的成人和老年精神病学,在那里医生必须权衡重叠症状、药物副作用和长期管理,而不仅仅是应对戏剧性的紧急情况。

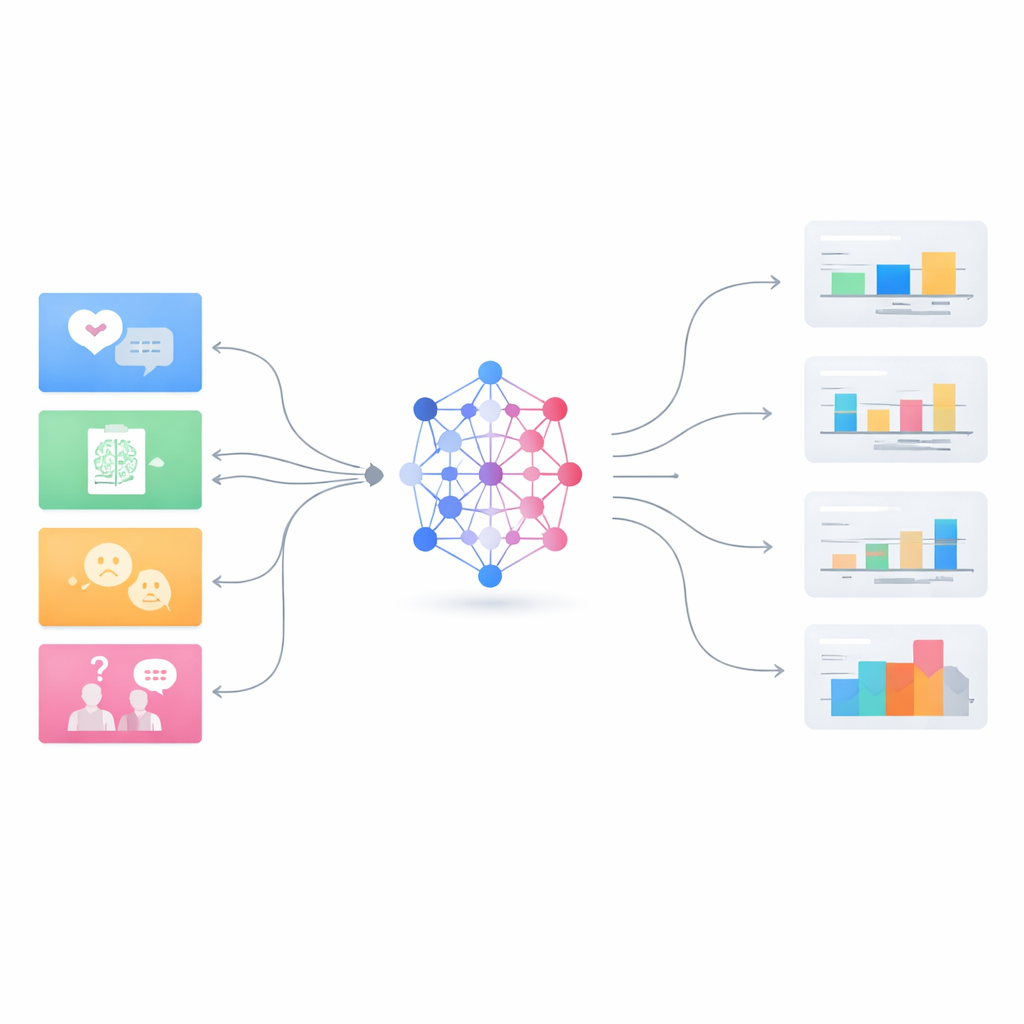

如何测试这些人工智能模型

研究团队评估了十五个领先的 LLM,包括来自大型科技公司的通用系统以及若干专门针对医学调整的模型。对于选择题等结构化任务,他们按常规方式对答案评分。对于开放性回答—例如“你会如何管理此病例?”—他们使用另一款强大的语言模型作为中立裁判,将每个答案与专家参考按0–100的相似度尺度进行比较。这使他们能够考察不仅是事实回忆能力,还有推理质量以及人工智能的临床逻辑与经验丰富的精神科医生的匹配程度。对于复杂考试形式,如需要将一组选项正确应用于多个病例的扩展匹配题,则采用了特殊的评分方法。

当今系统的能力与不足

在整个基准测试中,出现了一个明显的领先模型群体。较新的通用系统,如 GPT‑5 Medium 与处于“思考”模式的 Claude Sonnet 4.5,在平均得分上达到了约80%中段,并在诊断、治疗计划和多步随访问题等高要求任务上表现强劲。它们在非常不同的任务格式间也显示出相对稳定的表现,暗示了稳健的推理能力而非狭义的技巧学习。相比之下,较小或较旧的模型则远远落后,一些专注医疗的模型在事实性考试上得分很高,但在开放式临床推理上表现波动较大。即便是领先者也在最困难的任务上挣扎:对症状重叠的具体疾病进行细致分类,以及在需要从许多近似选项中选择时的试题。

医学人工智能中的通才—专才悖论

一项最引人注目的发现是,在复杂的精神病学推理任务中,广泛训练于多种类型文本的通用模型往往胜过专门训练于生物医学文献的模型。像 MedGemma 这样的专科医学模型在知识密集型任务(如多项选择题和详细的疾病标签)上表现优异,但在反映真实诊所访问的灵活叙事任务上通常落后。“通才—专才悖论”表明,仅仅接触大量医学文本并不足以胜任;能够整合情境、处理不确定性并修正假设——这是强通用模型所具备的能力——对精神病学尤为关键。同时,研究表明增加更多“思考”步骤对某些架构有帮助而对另一些则无效,这提示有用的推敲能力必须经过精心设计,而不能简单地强制施加。

局限性、保障措施与下一步

尽管得分令人鼓舞,作者强调这些系统尚不适合做无人监督的临床决策。基准基于润色过的教科书病例,而非凌乱的真实病历、危机情形或文化多样的呈现方式。它没有测试聊天机器人在面对正在自杀的个体时是否会处理不当、是否会强化妄想或以侵蚀信任的方式作出反应。评分本身依赖另一个人工智能裁判,这也引入了偏差。因此,PsychiatryBench 应被视为基础性的实验室测试,而非安全合格证。作者认为,目前 LLM 最适合在严格人工监督下用于支持教育、文档整理和早期头脑风暴。

这对患者和临床医生意味着什么

对普通读者来说,结论既带来希望又需谨慎。现代语言模型开始在某些专家精神病学推理环节上接近人类水平,尤其是在结构化、类教科书场景中。它们已经可以帮助学生练习、协助临床医生总结信息并提出基于指南的选项。但它们在微妙诊断、多标签分类和处理模糊病例方面仍有可预见的盲点——这些正是错误最可能造成严重后果的领域。PsychiatryBench 对这些强项与弱点提供了透明的检视方式,有助于追踪进展并设计更安全的系统。简单来说,研究表明人工智能有望成为心理健康护理中的有用助手,但前提是其能力必须被如实衡量,其角色始终置于受过训练的专业人员监督之下。

引用: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

关键词: 精神病学基准, 大型语言模型, 心理健康人工智能, 临床推理, 医学评估数据集