Clear Sky Science · ar

PsychiatryBench: معيار متعدد المهام لنماذج اللغة الكبيرة في الطب النفسي

لماذا هذا العمل مهم للصحة النفسية والذكاء الصناعي

تؤثر مشكلات الصحة النفسية على مئات الملايين من الناس حول العالم، ومع ذلك لا يتلقى كثيرون رعاية عالية الجودة وفي الوقت المناسب. وفي الوقت نفسه، بدأت روبوتات المحادثة القوية المبنية على نماذج اللغة الكبيرة تدخل سريعًا عيادات الأطباء وتطبيقات العلاج وحتى محركات البحث اليومية. يقدم هذا المقال PsychiatryBench، طريقة جديدة لاختبار مدى فهم هذه الأنظمة فعلاً لطب النفس. يطرح سؤالاً بسيطاً لكنه ملح: هل يمكن لأدوات الذكاء الاصطناعي الحالية أن تفكر في حالات الصحة النفسية المعقدة بطريقة آمنة وموثوقة وقريبة من معايير الخبراء؟

اختبار جديد مبني على معرفة سريرية حقيقية

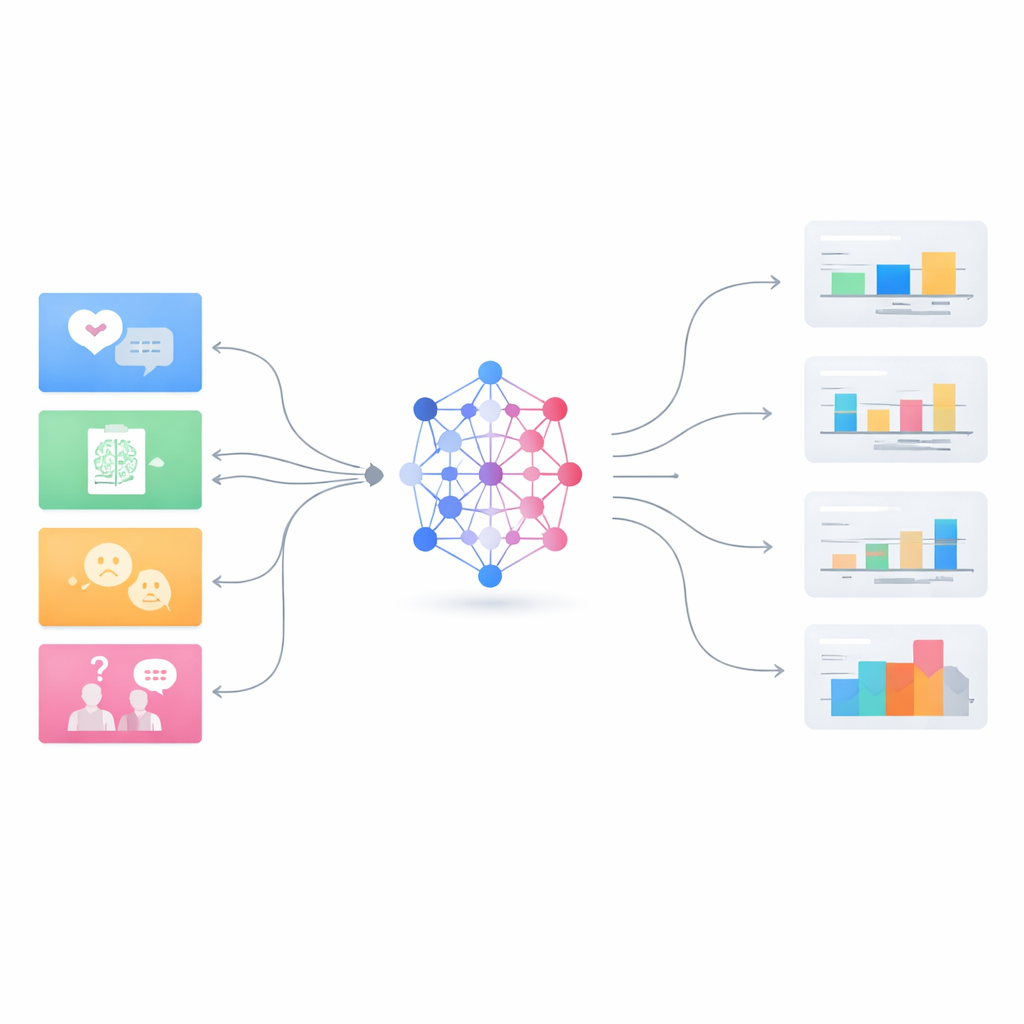

اعتمدت معظم المحاولات السابقة لقياس أداء الذكاء الاصطناعي في الصحة النفسية على منشورات وسائل التواصل الاجتماعي، أو نصوص مقابلات صغيرة، أو حتى محادثات اختلقها أنظمة ذكاء اصطناعي أخرى. هذه بعيدة عن تاريخ الحالات المدروس بعناية وأسئلة الامتحان المستخدمة في تدريب الأطباء النفسيين. يسلك PsychiatryBench طريقًا مختلفًا. بنى المؤلفون مجموعة من 5,188 سؤالًا مأخوذة فقط من كتب الطب النفسي الموثوقة وكتب الحالات وأدلة الامتحانات الذاتية. يغطي المعيار أحد عشر نوعًا من المهام، من تسمية التشخيص واختيار العلاج إلى التخطيط للرعاية المستمرة، والإجابة عن أسئلة المعرفة الأساسية، ومتابعة حالة مع مرور الوقت. التركيز على طب نفس البالغين والمسنين في إعدادات العيادات الخارجية، حيث يجب على الأطباء موازنة الأعراض المتداخلة والآثار الجانبية الدوائية والإدارة طويلة الأمد بدلًا من التركيز فقط على الطوارئ الدرامية.

كيف خضعت النماذج لاختبار الأداء

قيَّم الفريق خمسة عشر نموذجًا رائدًا للنماذج اللغوية الكبيرة، بما في ذلك أنظمة عامة من شركات تقنية كبرى وعدة نماذج مخصصة خصيصًا للطب. بالنسبة للمهام المهيكلة مثل الأسئلة متعددة الخيارات، قيّموا الإجابات بالطريقة المعتادة. بالنسبة للاستجابات المفتوحة—مثل «كيف ستدير هذه الحالة؟»—استخدموا نموذج لغة قوي آخر كقاضٍ محايد لمقارنة كل إجابة مع مرجع خبير على مقياس تشابه من 0 إلى 100. سمح ذلك بفحص ليس فقط استرجاع الوقائع بل أيضًا جودة الاستدلال ومدى تطابق منطق العناية بالمرضى لدى الذكاء الاصطناعي مع منطق الأطباء النفسيين ذوي الخبرة. استُخدمت طرق تسجيل خاصة لصيغ الامتحان المعقدة، مثل العناصر الموسعة المطابقة حيث يجب تطبيق قائمة خيارات واحدة بشكل صحيح على عدة سيناريوهات.

ما الذي تستطيع أنظمة اليوم فعله — وأين تقصر

عبر المعيار الكامل ظهر مجموعة واضحة من النماذج المتقدمة في القمة. حققت الأنظمة العامة الأحدث مثل GPT‑5 Medium وClaude Sonnet 4.5 في وضع «التفكير» درجات متوسطة في نطاق الثمانينات ووصلت لأداء قوي في مهام تتطلب جهدًا مثل التشخيص، وتخطيط العلاج، وأسئلة المتابعة متعددة الخطوات. أظهرت أيضًا أداءً مستقرًا نسبيًا عبر صيغ مهام مختلفة جدًا، ما يشير إلى استدلال قوي بدلًا من تعلم خدع ضيقة. بالمقابل، تخلفت النماذج الأصغر أو الأقدم كثيرًا، وأبدت بعض النماذج المخصصة طبيًا تفاوتات واسعة بين درجات عالية في الامتحانات المعرفية وأداء ضعيف في التفكير السريري المفتوح. حتى القادة واجهوا صعوبات في أصعب المهام: التصنيف الدقيق للاضطرابات ذات الأعراض المتداخلة، وأسئلة الامتحان التي تتطلب الاختيار من بين العديد من الخيارات المتقاربة جدًا.

مفارقة العمومي–التخصص في الذكاء الاصطناعي الطبي

أحد أبرز النتائج هو أن النماذج المدربة على نطاق واسع على أنواع متعددة من النصوص غالبًا ما تفوقت على النماذج المدربة خصيصًا على الأدبيات الطبية الحيوية عندما يتعلق الأمر بالتفكير النفسي المعقد. تفوقت النماذج الطبية المتخصصة مثل MedGemma في المهام التي تعتمد على المعرفة بكثافة مثل الأسئلة متعددة الخيارات وتسميات الاضطرابات التفصيلية، لكنها عمومًا كانت أقل أداء على المهام السردية والمرنة التي تحاكي الزيارات السريرية الحقيقية. تشير هذه «المفارقة بين العام والمتخصص» إلى أن التعرض الواسع للنصوص الطبية وحده لا يكفي؛ فالقدرة على دمج السياق، وإدارة عدم اليقين، ومراجعة الفرضيات—كما تفعل النماذج العامة القوية—حاسمة لطب النفس. وفي الوقت نفسه، تظهر الدراسة أن إضافة خطوات «تفكيرية» أكثر يساعد بعض البِنى المعمارية لكنه لا يساعد الأخرى، ما يشير إلى أن التفكير المفيد في الذكاء الاصطناعي يجب تصميمه بعناية، وليس فرضه فقط.

الحدود والضوابط وما التالي

على الرغم من الدرجات المشجعة، يؤكد المؤلفون أن هذه الأنظمة ليست جاهزة لاتخاذ قرارات سريرية بدون إشراف بشري. يستند المعيار إلى حالات مصقولة من الكتب الدراسية، وليس إلى سجلات العالم الحقيقي الفوضوية، أو الأزمات، أو العروض الثقافية المتنوعة. ولا يختبر ما إذا كان روبوت محادثة قد يتعامل بشكل سيئ مع شخص ينتحر فعالًا، أو يعزز الأوهام، أو يرد بطرق تقوّض الثقة. يعتمد التسجيل نفسه على قاضٍ ذكاء اصطناعي آخر، ما يضيف تحيُّزاته الخاصة. نتيجة لذلك، يجب النظر إلى PsychiatryBench كاختبار مختبر أساسي، وليس شهادة أمان. يجادل المؤلفون بأن النماذج اللغوية الكبيرة، في الوقت الحالي، هي الأنسب لدعم التعليم، والتوثيق، والعصف الذهني المبكر تحت إشراف بشري دقيق.

ماذا يعني هذا للمرضى والممارسين

بالنسبة للقراء غير المتخصصين، الخلاصة مُلحَظَة بين التفاؤل والتحذير. بدأت نماذج اللغة الحديثة تقترب من أجزاء من التفكير النفسي الخبير، خاصة في البيئات المهيكلة المشابهة للكتب الدراسية. يمكنها بالفعل مساعدة الطلاب على التدريب، ومساعدة الأطباء في إعداد الملخصات، وإظهار خيارات قائمة على الإرشادات. لكنها تظهر أيضًا نقاط ضعف متوقعة في التشخيص الدقيق، والتصنيف متعدد الوسوم، والتعامل مع الحالات الغامضة—وهي بالضبط المناطق التي قد تكون فيها الأخطاء أكثر ضررًا. يسلط PsychiatryBench الضوء على هذه النقاط القوية والضعيفة، مقدمًا طريقة شفافة لتتبع التقدم وتصميم أنظمة أكثر أمانًا. بعبارات بسيطة، تشير الدراسة إلى أن الذكاء الاصطناعي يمكن أن يصبح مساعدًا مفيدًا في الرعاية النفسية، لكن فقط إذا قيست قدراته بصدق وبقي دوره تحت إشراف متخصصين مدرَّبين.

الاستشهاد: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

الكلمات المفتاحية: معيار الطب النفسي, نماذج اللغة الكبيرة, الذكاء الاصطناعي في الصحة النفسية, التفكير السريري, مجموعات بيانات التقييم الطبي