Clear Sky Science · ja

PsychiatryBench: 精神医学における大規模言語モデル向けのマルチタスクベンチマーク

この研究がメンタルヘルスとAIにとって重要である理由

世界中で何億もの人々が精神的な問題に直面している一方で、多くは適時かつ高品質なケアを受けられていません。同時に、大規模言語モデル(LLM)に基づく強力なチャットボットが、医療現場、セラピーアプリ、日常的な検索エンジンに急速に導入されつつあります。本稿は、これらのシステムが精神医学をどれだけ本当に理解しているかを検証する新しい手法、PsychiatryBenchを紹介します。問うのは単純だが差し迫った疑問です:現在のAIツールは、複雑な精神保健の事例を専門家の水準に近い、安全で信頼できる形で理論立てて考えられるか?

実臨床の知見に基づく新しいテスト

これまでの多くの試みは、ソーシャルメディア投稿、小さな面接トランスクリプト、あるいは他のAIが作成した会話に頼ってきました。これらは精神科医の訓練に使われる慎重に推論された症例や試験問題からはほど遠いものです。PsychiatryBenchは別の道を取りました。著者らは信頼できる精神医学の教科書、症例集、自己学習用ガイドだけから抽出した5,188項目の問題セットを構築しました。ベンチマークは、診断名の記述や治療選択から、継続的ケアの計画、基礎知識の問答、時間を追う症例フォローまで、11種類のタスクを網羅します。対象は外来設定の成人・高齢者精神医学であり、劇的な救急対応だけでなく、重なり合う症状、薬の副作用、長期管理を評価することが求められる場面に焦点を当てています。

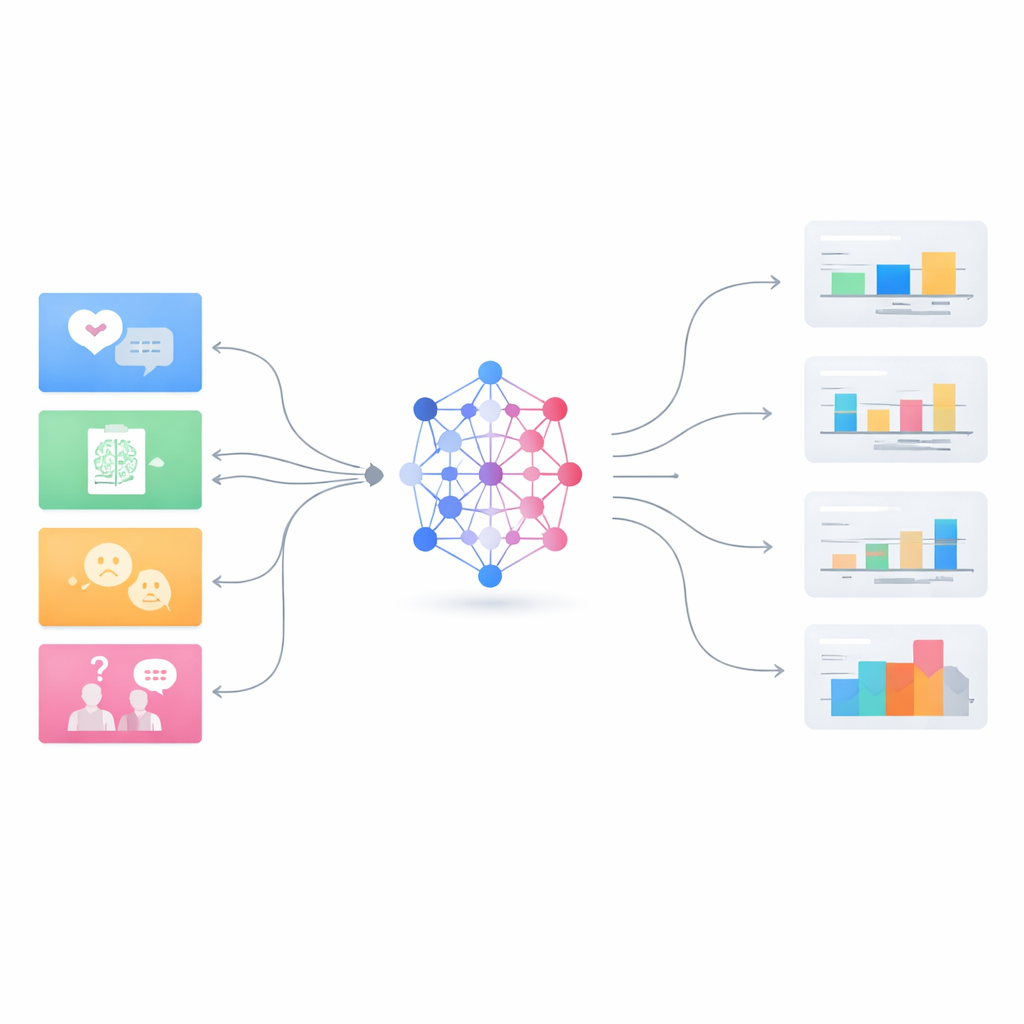

AIモデルの試験方法

チームは主要な一般向けシステムや医療特化型モデルを含む15の先端LLMを評価しました。選択式問題などの構造化タスクでは通常の採点法で解答を評価しました。対して「この症例をどのように管理するか」のような自由記述回答については、別の強力な言語モデルを中立的な判定者として用い、各解答を専門家参照解と0–100の類似度スケールで比較しました。これにより、事実の再現だけでなく、推論の質やAIの臨床論理が経験ある精神科医のそれにどれだけ近いかを調べることができました。複数の短文を各症例に当てはめる拡張一致形式のような複雑な試験形式には、特別な採点手法が用いられました。

現行システムの得意/不得意

ベンチマーク全体を通じて、明確な上位グループのモデルが浮かび上がりました。GPT‑5 MediumやClaude Sonnet 4.5の「思考」モードのような新しい一般向けシステムは、平均得点が80%台中盤に達し、診断、治療計画、多段階のフォローアップといった難度の高いタスクで高い成績を示しました。また、非常に異なるタスク形式にわたって比較的安定した性能を示し、狭いトリック学習ではなく堅牢な推論能力を示唆しました。対照的に、より小規模または旧型のモデルは大きく遅れ、医療特化モデルの中には事実重視の試験では高得点を出す一方で自由記述の臨床推論で弱さを見せるものもありました。リーダー格のモデルでも、症状が重複する特定疾患の微細な分類や、多数のほぼ類似選択肢から選ぶ問題といった最難関タスクには苦戦しました。

医療AIにおけるジェネラリスト–スペシャリストのパラドックス

最も注目すべき発見の一つは、多様な種類のテキストで広く訓練されたモデルが、複雑な精神科的推論において生物医療文献に特化して訓練されたモデルをしばしば上回ったことです。MedGemmaのような専門医療モデルは、選択式問題や詳細な障害ラベル付けといった知識重視のタスクに優れていましたが、実際の診療訪問を模した柔軟で物語的なタスクでは一般向けの強力なモデルに劣る傾向がありました。この「ジェネラリスト–スペシャリストのパラドックス」は、単に医療テキストに多く接するだけでは不十分であり、文脈を統合し、不確実性を扱い、仮説を修正する能力—強力な一般モデルが示すような能力—が精神医学には重要であることを示唆します。同時に、研究は「思考」ステップを増やすことがあるアーキテクチャには有効でも、すべてに効くわけではないことを示しており、有用な熟慮をAIに導入するには慎重な設計が必要であることをほのめかしています。

限界、保護策、そして次に来るもの

奨励される成績にもかかわらず、著者らはこれらのシステムが監督なしに臨床判断を下す準備ができているわけではないと強調します。ベンチマークは洗練された教科書症例を基にしており、現実の煩雑な医療記録、危機的状況、文化的に多様な呈示を反映するものではありません。チャットボットが自殺リスクの高い人に誤対応するか、妄想を強化するか、信頼を損なう反応をするかどうかはテストしていません。採点自体が別のAI判定者に依存しているため、その偏りも持ち込みます。したがって、PsychiatryBenchは安全性の証明ではなく基礎的なラボテストと見なすべきです。著者らは、現時点ではLLMは教育、文書化、初期のブレインストーミングを慎重な人間の監督下で支援するのが最も適していると主張しています。

患者と臨床家にとっての意味

一般読者にとっての結論は、希望と注意喚起の両面を持ちます。現代の言語モデルは、特に構造化され教科書的な設定では、専門家の精神科的推論の一部を近似し始めています。すでに学生の演習支援、臨床家のサマリー作成支援、ガイドラインに基づく選択肢の提示などに役立ちます。しかし、微妙な診断、多ラベル分類、曖昧な症例への対応といった領域には予測可能な盲点があり、これらは誤りが最も有害になり得る部分でもあります。PsychiatryBenchはこれらの強みと弱点に光を当て、進展を追跡し安全なシステム設計を促す透明な手段を提供します。平たく言えば、AIはメンタルヘルスケアの有用なアシスタントになり得るが、その能力を正直に測り、役割を訓練を受けた専門家の監督下に厳格に置くことが前提だということを示唆しています。

引用: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

キーワード: 精神医学ベンチマーク, 大規模言語モデル, メンタルヘルスAI, 臨床的推論, 医療評価データセット