Clear Sky Science · pl

PsychiatryBench: wielozadaniowy benchmark dla LLM w psychiatrii

Dlaczego ta praca ma znaczenie dla zdrowia psychicznego i AI

Problemy ze zdrowiem psychicznym dotykają setek milionów ludzi na całym świecie, a mimo to wielu z nich nie otrzymuje terminowej, wysokiej jakości opieki. Równocześnie potężne chatboty oparte na dużych modelach językowych (LLM) szybko pojawiają się w gabinetach lekarskich, aplikacjach terapeutycznych, a nawet w codziennych wyszukiwarkach. Ten artykuł przedstawia PsychiatryBench — nowy sposób testowania, na ile te systemy rzeczywiście rozumieją psychiatrę. Pada proste, lecz pilne pytanie: czy współczesne narzędzia AI potrafią analizować złożone przypadki zdrowia psychicznego w sposób bezpieczny, wiarygodny i zbliżony do standardów ekspertów?

Nowy test oparty na rzeczywistej wiedzy klinicznej

Wcześniejsze próby oceny AI w obszarze zdrowia psychicznego opierały się głównie na postach w mediach społecznościowych, niewielkich transkrypcjach wywiadów lub nawet rozmowach wygenerowanych przez inne systemy AI. To dalekie od starannie uzasadnionych historii przypadków i pytań egzaminacyjnych, których używa się do szkolenia psychiatrów. PsychiatryBench obrał inną drogę. Autorzy przygotowali zestaw 5 188 pytań pochodzących wyłącznie z zaufanych podręczników psychiatrii, książek z przypadkami oraz przewodników do samodzielnej nauki. Benchmark obejmuje jedenaście typów zadań — od rozpoznania diagnozy i wyboru leczenia, przez planowanie opieki, aż po pytania z wiedzy podstawowej i śledzenie przebiegu przypadku w czasie. Skupia się na psychiatrii dorosłych i geriatrii w warunkach ambulatoryjnych, gdzie lekarze muszą ważyć nakładające się objawy, skutki uboczne leków i długoterminowe zarządzanie, a nie tylko dramatyczne stany nagłe.

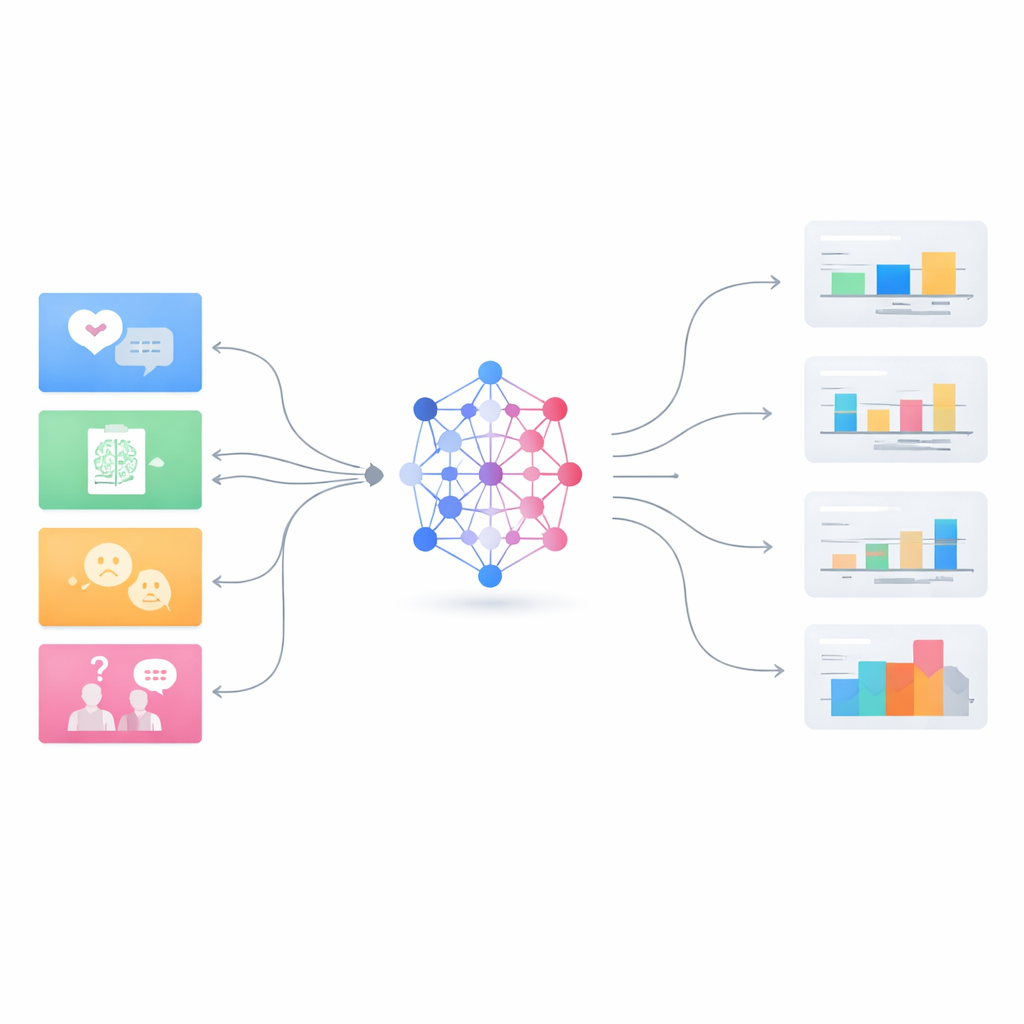

Jak poddano testom modele AI

Zespół ocenił piętnaście wiodących LLM, w tym systemy ogólnego przeznaczenia od dużych firm technologicznych oraz kilka modeli specjalnie dostrojonych do medycyny. Dla zadań ustrukturyzowanych, takich jak pytania wielokrotnego wyboru, wyniki punktowano standardowo. W przypadku odpowiedzi otwartych — np. „Jak byś poprowadził ten przypadek?” — użyto innego silnego modelu językowego jako neutralnego sędziego, który porównywał każdą odpowiedź z eksperckim wzorcem na skali podobieństwa 0–100. Pozwoliło to badać nie tylko zapamiętywanie faktów, lecz także jakość rozumowania i to, jak blisko logika kliniczna AI odpowiada podejściu doświadczonych psychiatrów. Dla złożonych formatów egzaminacyjnych, takich jak rozszerzone dopasowania, zastosowano specjalne metody punktacji — tam, gdzie jedna lista opcji musi być poprawnie przypisana do kilku krótkich opisów.

Co potrafią dzisiejsze systemy — i gdzie zawodzą

W całym benchmarku wyłoniła się wyraźna czołówka nowoczesnych modeli. Nowsze systemy ogólnego zastosowania, takie jak GPT‑5 Medium i Claude Sonnet 4.5 w trybie „myślenia”, osiągały średnie wyniki na poziomie około 80–85% i radziły sobie dobrze w wymagających zadaniach, takich jak diagnoza, planowanie leczenia i wieloetapowe pytania o dalsze postępowanie. Pokazywały też stosunkowo stabilne wyniki w bardzo różnych formatach zadań, co sugeruje solidne rozumowanie, a nie wąsko ukierunkowane zapamiętywanie trików. W przeciwieństwie do nich mniejsze lub starsze modele znacząco odstawały, a niektóre modele medyczne wykazywały duże wahania — wysokie wyniki w testach faktograficznych i słabe w zadaniach otwartych wymagających rozumowania klinicznego. Nawet liderzy mieli trudności z najtrudniejszymi zadaniami: szczegółową klasyfikacją zaburzeń o nakładających się objawach oraz pytaniami egzaminacyjnymi, w których trzeba wybierać spośród wielu bardzo podobnych opcji.

Paradoks generalisty i specjalisty w medycznym AI

Jednym z najbardziej uderzających wniosków jest to, że modele trenowane szeroko na różnych typach tekstów często przewyższały modele szkolone konkretnie na literaturze biomedycznej w zadaniach wymagających złożonego rozumowania psychiatrycznego. Specjalistyczne modele medyczne, takie jak MedGemma, świetnie radziły sobie w zadaniach bogatych w wiedzę, na przykład w pytaniach wielokrotnego wyboru i szczegółowych etykietach zaburzeń, lecz zazwyczaj przegrywały w elastycznych, narracyjnych zadaniach odzwierciedlających realne wizyty w klinice. Ten „paradoks generalista–specjalista” sugeruje, że sama ekspozycja na teksty medyczne nie wystarcza; zdolność do integrowania kontekstu, radzenia sobie z niepewnością i rewizji hipotez — którą posiadają silne modele ogólne — jest kluczowa w psychiatrii. Jednocześnie badanie pokazuje, że dodanie większej liczby kroków „myślenia” pomaga w niektórych architekturach, ale nie w innych, co sugeruje, że użyteczne rozważanie w AI musi być starannie zaprojektowane, a nie jedynie wymuszone.

Ograniczenia, zabezpieczenia i co dalej

Mimo zachęcających wyników autorzy podkreślają, że te systemy nie są gotowe do podejmowania nieskoordynowanych decyzji klinicznych. Benchmark opiera się na dopracowanych przypadkach podręcznikowych, a nie na nieporządnych rzeczywistych kartotekach, kryzysach czy kulturowo zróżnicowanych prezentacjach. Nie sprawdza, czy chatbot nie poradziłby sobie z osobą aktywnie samobójczą, nie wzmacniałby urojeń ani nie odpowiadał w sposób podważający zaufanie. Sama punktacja opiera się na innym sędziowskim modelu AI, co wprowadza własne uprzedzenia. W rezultacie PsychiatryBench należy traktować jako podstawowy test laboratoryjny, a nie certyfikat bezpieczeństwa. Autorzy argumentują, że na razie LLM najlepiej nadają się do wspierania edukacji, dokumentacji i wczesnego burzy mózgów pod ścisłym nadzorem człowieka.

Co to oznacza dla pacjentów i klinicystów

Dla odbiorców niebędących specjalistami wniosek jest zarówno obiecujący, jak i ostrożny. Nowoczesne modele językowe zaczynają przypominać część eksperckiego rozumowania psychiatrycznego, szczególnie w uporządkowanych, podręcznikowych sytuacjach. Mogą już pomagać studentom w ćwiczeniach, wspierać klinicystów w sporządzaniu streszczeń i przedstawiać opcje oparte na wytycznych. Pokazują jednak przewidywalne słabe punkty w subtelnej diagnostyce, klasyfikacji wieloetykietowej i obsłudze niejednoznacznych przypadków — właśnie tam, gdzie błędy mogą być najbardziej szkodliwe. PsychiatryBench rzuca światło na te mocne i słabe strony, oferując przejrzysty sposób śledzenia postępów i projektowania bezpieczniejszych systemów. Mówiąc prosto: badanie sugeruje, że AI może stać się użytecznym asystentem w opiece nad zdrowiem psychicznym, ale tylko jeśli jej możliwości będą uczciwie oceniane, a rola pozostanie pod kontrolą wykwalifikowanych specjalistów.

Cytowanie: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Słowa kluczowe: benchmark psychiatryczny, duże modele językowe, AI w zdrowiu psychicznym, rozumowanie kliniczne, zbiory danych do oceny medycznej