Clear Sky Science · fr

PsychiatryBench : une référence multitâche pour les LLM en psychiatrie

Pourquoi ce travail compte pour la santé mentale et l’IA

Les problèmes de santé mentale touchent des centaines de millions de personnes dans le monde, et beaucoup ne reçoivent jamais de soins de qualité en temps utile. Parallèlement, des chatbots puissants fondés sur de grands modèles de langage (LLM) font rapidement leur entrée dans les cabinets médicaux, les applications de thérapie et même les moteurs de recherche du quotidien. Cet article présente PsychiatryBench, une nouvelle manière d’évaluer dans quelle mesure ces systèmes comprennent réellement la médecine psychiatrique. Il pose une question simple mais urgente : les outils d’IA actuels peuvent‑ils analyser des cas psychiatriques complexes d’une façon sûre, fiable et proche des standards d’experts ?

Un nouveau test construit à partir de connaissances cliniques réelles

La plupart des tentatives précédentes pour évaluer l’IA en santé mentale se fondaient sur des publications de réseaux sociaux, de petits transcrits d’entretiens, ou même des conversations générées par d’autres systèmes d’IA. Cela est loin des dossiers cliniques soigneusement argumentés et des questions d’examen utilisés pour former les psychiatres. PsychiatryBench adopte une approche différente. Les auteurs ont constitué un jeu de 5 188 questions tirées uniquement de manuels psychiatriques fiables, de recueils de cas et de guides d’auto‑évaluation. La référence couvre onze types de tâches, depuis l’énoncé d’un diagnostic et le choix d’un traitement jusqu’à la planification d’un suivi, en passant par des questions de connaissances fondamentales et le suivi d’un cas dans le temps. L’accent est mis sur la psychiatrie adulte et gériatrique en ambulatoire, où les médecins doivent apprécier des symptômes qui se chevauchent, des effets secondaires médicaux et la gestion à long terme plutôt que de se concentrer uniquement sur des urgences spectaculaires.

Comment les modèles d’IA ont été testés

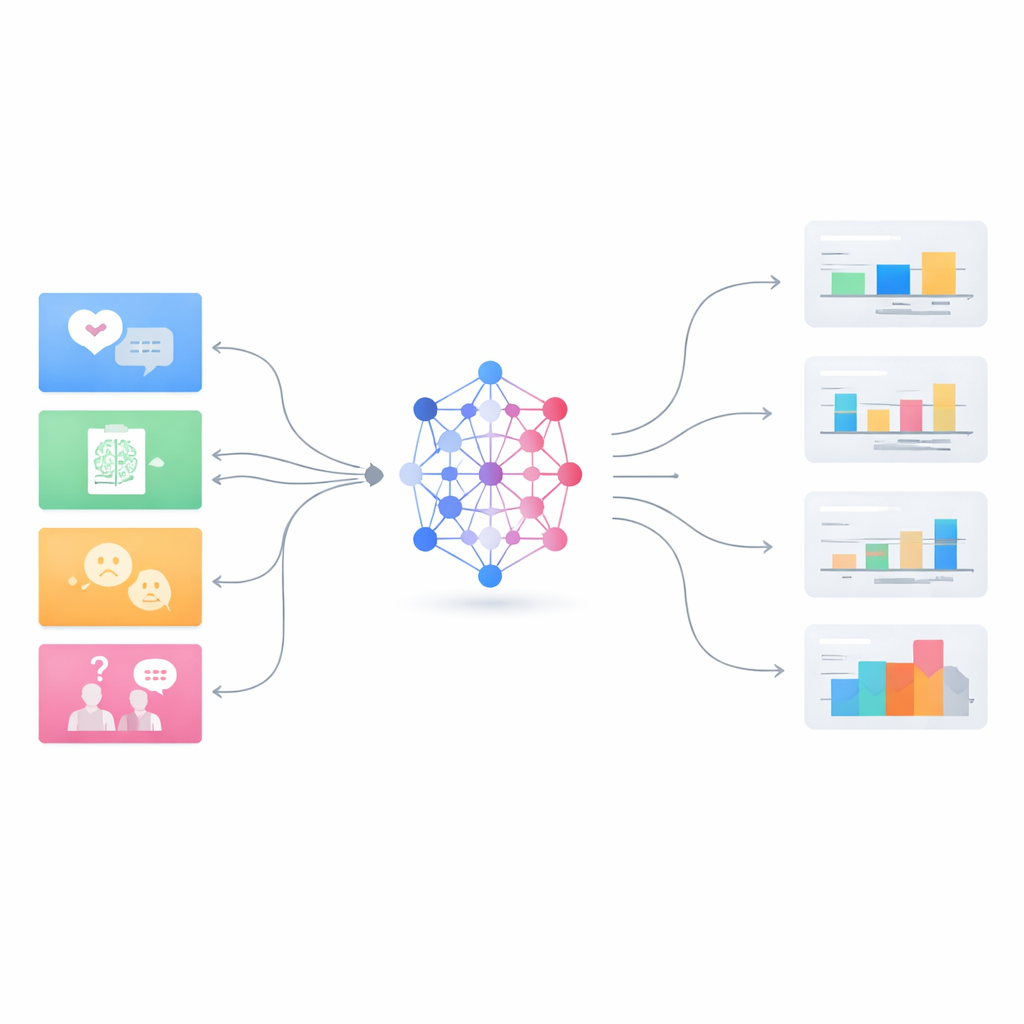

L’équipe a évalué quinze LLM de premier plan, comprenant des systèmes polyvalents de grandes entreprises technologiques et plusieurs modèles spécialement adaptés à la médecine. Pour les tâches structurées comme les QCM, ils ont noté les réponses de manière conventionnelle. Pour les réponses ouvertes — par exemple « Comment géreriez‑vous ce cas ? » — ils ont utilisé un autre modèle de langage puissant comme juge neutre pour comparer chaque réponse à une référence d’expert sur une échelle de similarité de 0 à 100. Cela leur a permis d’explorer non seulement la restitution des faits mais aussi la qualité du raisonnement et la proximité de la logique clinique de l’IA avec celle de psychiatres expérimentés. Des méthodes de notation spéciales ont été employées pour des formats d’examen complexes, tels que les items à appariement étendu où une même liste d’options doit être correctement appliquée à plusieurs vignettes.

Ce que les systèmes actuels savent faire — et où ils échouent

Sur l’ensemble de la référence, un groupe de modèles de pointe s’est clairement détaché. Des systèmes généralistes récents comme GPT‑5 Medium et Claude Sonnet 4.5 en mode « thinking » ont obtenu des scores moyens autour des 80–85 % et ont bien performé sur des tâches exigeantes telles que le diagnostic, la planification du traitement et les questions de suivi en plusieurs étapes. Ils ont aussi montré des performances relativement stables sur des formats de tâches très différents, ce qui suggère un raisonnement robuste plutôt qu’un simple apprentissage de tricks. En revanche, des modèles plus petits ou plus anciens ont nettement décroché, et certains modèles spécialisés en médecine ont montré de fortes variations entre de bons résultats aux examens factuels et des performances faibles en raisonnement clinique ouvert. Même les meilleurs ont peiné sur les tâches les plus difficiles : classification fine de troubles présentant des symptômes qui se chevauchent, et items d’examen nécessitant de choisir parmi de nombreuses options presque identiques.

Le paradoxe généraliste–spécialiste en IA médicale

Une des conclusions les plus marquantes est que les modèles entraînés sur une large variété de textes ont souvent surperformé les modèles entraînés spécifiquement sur la littérature biomédicale pour le raisonnement psychiatrique complexe. Les modèles médicaux spécialisés comme MedGemma excellent aux tâches riches en connaissances, telles que les QCM et l’étiquetage détaillé des troubles, mais ils restent généralement en retrait sur les tâches narratives et flexibles qui reflètent une consultation réelle. Ce « paradoxe généraliste–spécialiste » suggère que l’exposition au seul texte médical ne suffit pas ; la capacité d’intégrer le contexte, de gérer l’incertitude et de réviser des hypothèses — qualités des modèles généralistes puissants — est cruciale en psychiatrie. En même temps, l’étude montre que l’ajout d’étapes de « réflexion » aide certaines architectures mais pas d’autres, ce qui laisse entendre que la délibération utile en IA doit être conçue avec soin, et non simplement imposée.

Limites, garde‑fous et perspectives

Malgré des scores encourageants, les auteurs insistent sur le fait que ces systèmes ne sont pas prêts à prendre des décisions cliniques non supervisées. La référence s’appuie sur des cas de manuel soignés, et non sur des dossiers réels désordonnés, des crises ou des présentations culturellement diverses. Elle ne teste pas si un chatbot pourrait mal gérer une personne activement suicidaire, renforcer des idées délirantes ou répondre de façon à éroder la confiance. La notation elle‑même repose sur un autre juge IA, ce qui introduit ses propres biais. En conséquence, PsychiatryBench doit être vu comme un test de laboratoire fondamental, et non comme un certificat de sécurité. Les auteurs soutiennent que, pour l’instant, les LLM conviennent surtout à soutenir l’éducation, la documentation et le brainstorming préliminaire sous une supervision humaine attentive.

Ce que cela signifie pour les patients et les cliniciens

Pour un public non spécialiste, le message est à la fois porteur d’espoir et de prudence. Les modèles de langage modernes commencent à reproduire certaines composantes du raisonnement psychiatrique d’expert, en particulier dans des contextes structurés et proches des manuels. Ils peuvent déjà aider les étudiants à s’entraîner, assister les cliniciens pour des synthèses et mettre en avant des options fondées sur des recommandations. Mais ils présentent aussi des angles morts prévisibles en matière de diagnostics subtils, de classifications multi‑étiquettes et de prise en charge de cas ambigus — précisément les domaines où les erreurs peuvent être les plus nocives. PsychiatryBench met en lumière ces forces et faiblesses, offrant un moyen transparent de suivre les progrès et de concevoir des systèmes plus sûrs. En termes simples, l’étude suggère que l’IA peut devenir un assistant utile en santé mentale, mais uniquement si ses capacités sont mesurées honnêtement et si son rôle reste strictement encadré par des professionnels formés.

Citation: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Mots-clés: référence en psychiatrie, grands modèles de langage, IA et santé mentale, raisonnement clinique, ensembles de données d'évaluation médicale