Clear Sky Science · es

PsychiatryBench: un banco de pruebas multitarea para LLMs en psiquiatría

Por qué este trabajo importa para la salud mental y la IA

Los problemas de salud mental afectan a cientos de millones de personas en todo el mundo, y sin embargo muchas de ellas nunca reciben atención oportuna y de calidad. Al mismo tiempo, potentes chatbots basados en modelos de lenguaje grandes (LLMs) están entrando rápidamente en consultas médicas, aplicaciones de terapia e incluso en buscadores cotidianos. Este artículo presenta PsychiatryBench, una nueva forma de evaluar cuánto entienden realmente estos sistemas de la medicina psiquiátrica. Plantea una pregunta simple pero urgente: ¿pueden las herramientas de IA actuales razonar sobre casos complejos de salud mental de manera segura, fiable y cercana a los estándares de expertos?

Una nueva prueba construida a partir de conocimiento clínico real

La mayoría de intentos previos para evaluar la IA en salud mental se basaron en publicaciones de redes sociales, transcripciones de entrevistas pequeñas o incluso en conversaciones generadas por otros sistemas de IA. Estos están muy lejos de las historias clínicas razonadas y las preguntas de examen que se usan para formar a los psiquiatras. PsychiatryBench sigue una ruta diferente. Los autores construyeron un conjunto de 5.188 preguntas extraídas únicamente de libros de texto psiquiátricos de confianza, recopilaciones de casos y guías de autoevaluación. El benchmark cubre once tipos de tareas, desde nombrar un diagnóstico y escoger un tratamiento hasta planificar la atención continuada, responder preguntas de conocimiento fundamental y seguir un caso a lo largo del tiempo. El enfoque es la psiquiatría de adultos y geriátrica en atención ambulatoria, donde los médicos deben sopesar síntomas superpuestos, efectos secundarios médicos y manejo a largo plazo, más que solo emergencias dramáticas.

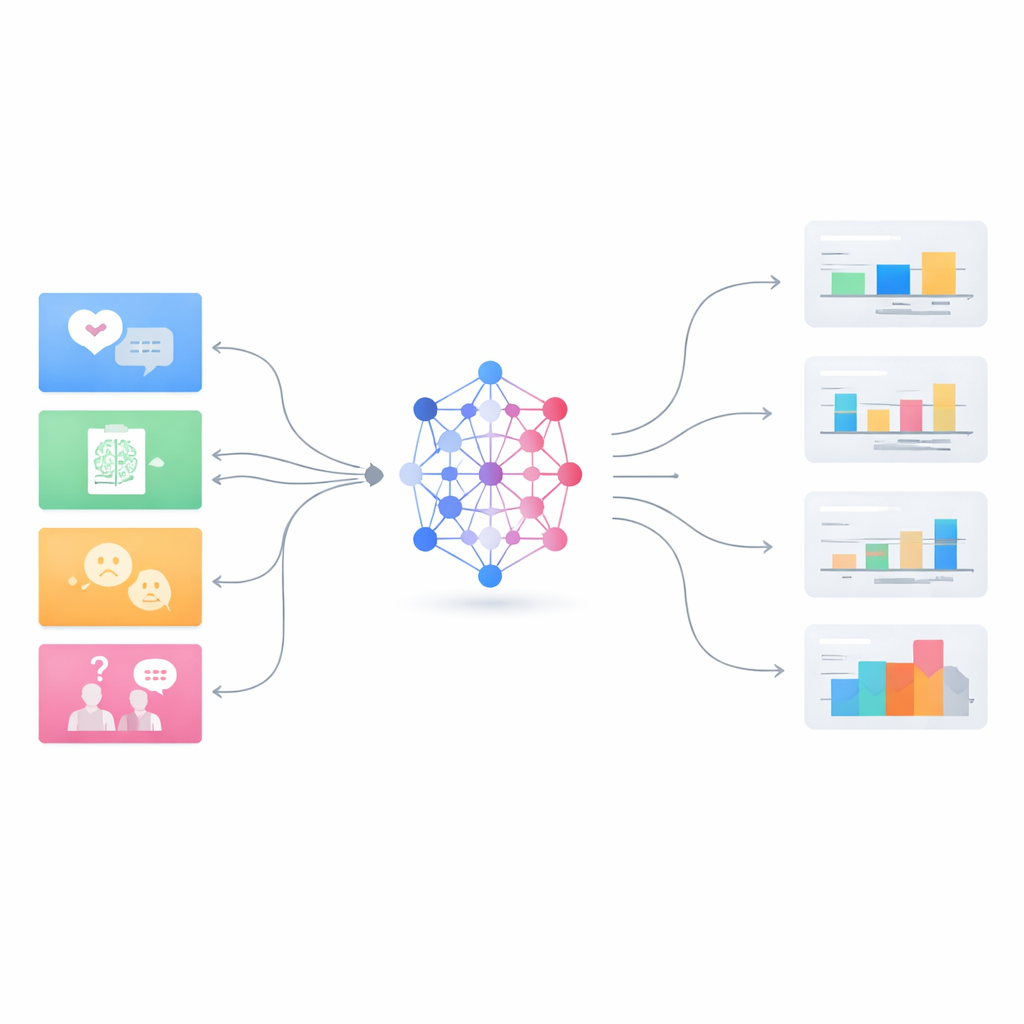

Cómo se pusieron a prueba los modelos de IA

El equipo evaluó quince LLMs líderes, incluidos sistemas de propósito general de grandes empresas tecnológicas y varios modelos adaptados específicamente a la medicina. Para tareas estructuradas como preguntas de opción múltiple, puntuaron las respuestas de la forma habitual. Para respuestas abiertas —por ejemplo “¿Cómo gestionaría este caso?”— emplearon otro modelo de lenguaje potente como juez neutral para comparar cada respuesta con una referencia experta en una escala de similitud de 0 a 100. Esto les permitió explorar no solo la recuperación de hechos sino también la calidad del razonamiento y cuánto coincidía la lógica clínica de la IA con la de psiquiatras experimentados. Se usaron métodos de puntuación especiales para formatos complejos de examen, como ítems de emparejamiento extendido en los que una lista de opciones debe aplicarse correctamente a varias viñetas.

Lo que pueden hacer los sistemas actuales —y dónde fallan

En todo el benchmark emergió claramente un grupo superior de modelos de vanguardia. Sistemas generales más nuevos, como GPT‑5 Medium y Claude Sonnet 4.5 en modo “thinking”, alcanzaron puntuaciones medias en torno al 80 y tantos por ciento y se desempeñaron bien en tareas exigentes como diagnóstico, planificación del tratamiento y preguntas de seguimiento en varios pasos. También mostraron un rendimiento relativamente estable en formatos de tarea muy distintos, lo que sugiere razonamiento robusto en lugar de aprendizaje de trucos concretos. En contraste, modelos más pequeños o antiguos se quedaron bastante rezagados, y algunos modelos específicos médicos mostraron oscilaciones amplias entre puntuaciones altas en exámenes de hechos y un rendimiento débil en razonamiento clínico abierto. Incluso los líderes tuvieron dificultades con las tareas más duras: clasificación fina de trastornos específicos con sintomatología superpuesta, y ítems de examen que requieren elegir entre muchas opciones casi similares.

La paradoja generalista–especialista en la IA médica

Uno de los hallazgos más llamativos es que los modelos entrenados de forma amplia con muchos tipos de texto a menudo superaron a los modelos entrenados específicamente en la literatura biomédica cuando se trató de razonamiento psiquiátrico complejo. Modelos médicos especializados como MedGemma destacaron en tareas basadas en conocimiento —por ejemplo preguntas de opción múltiple y etiquetas detalladas de trastornos—, pero generalmente se quedaron atrás en tareas narrativas y flexibles que imitan las visitas reales en clínica. Esta “paradoja generalista–especialista” sugiere que la mera exposición a texto médico no basta; la capacidad de integrar contexto, manejar incertidumbre y revisar hipótesis —como hacen los modelos generales potentes— es crucial para la psiquiatría. Al mismo tiempo, el estudio muestra que añadir más pasos de “pensamiento” ayuda a algunas arquitecturas pero no a otras, lo que indica que una deliberación útil en IA debe diseñarse cuidadosamente, no simplemente forzarse.

Límites, salvaguardas y qué viene después

A pesar de las puntuaciones alentadoras, los autores subrayan que estos sistemas no están listos para tomar decisiones clínicas no supervisadas. El benchmark se basa en casos pulidos de libros de texto, no en registros reales desordenados, crisis o presentaciones culturalmente diversas. No evalúa si un chatbot podría manejar mal a una persona con riesgo activo de suicidio, reforzar delirios o responder de maneras que erosionen la confianza. La propia puntuación depende de otro juez de IA, lo que introduce sesgos propios. Como resultado, PsychiatryBench debe interpretarse como una prueba de laboratorio fundamental, no como un certificado de seguridad. Los autores sostienen que, por ahora, los LLMs son más adecuados para apoyar la educación, la documentación y la generación inicial de ideas bajo la supervisión cuidadosa de humanos.

Qué significa esto para pacientes y clínicos

Para los lectores no especializados, la conclusión es a la vez esperanzadora y cautelosa. Los modelos de lenguaje modernos comienzan a aproximarse a partes del razonamiento psiquiátrico experto, especialmente en entornos estructurados y tipo libro de texto. Ya pueden ayudar a estudiantes a practicar, asistir a clínicos con resúmenes y ofrecer opciones basadas en guías. Pero también muestran puntos débiles previsibles en diagnóstico sutil, clasificación multilabel y manejo de casos ambiguos —precisamente las áreas donde los errores pueden ser más dañinos. PsychiatryBench ilumina estas fortalezas y debilidades, ofreciendo una vía transparente para seguir el progreso y diseñar sistemas más seguros. En términos sencillos, el estudio sugiere que la IA puede convertirse en un asistente útil en la atención de la salud mental, pero solo si sus capacidades se miden con honestidad y su papel permanece firmemente bajo la guía de profesionales formados.

Cita: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Palabras clave: benchmark de psiquiatría, modelos de lenguaje grandes, IA en salud mental, razonamiento clínico, conjuntos de datos para evaluación médica