Clear Sky Science · sv

PsychiatryBench: en multiuppgiftsmätare för LLM:er inom psykiatri

Varför detta arbete är viktigt för mental hälsa och AI

Psykisk ohälsa berör hundratals miljoner människor världen över, men många får aldrig snabb eller högkvalitativ vård. Samtidigt börjar kraftfulla chatbottar baserade på stora språkmodeller (LLM:er) snabbt dyka upp i läkarpraktiker, terapiappar och till och med vanliga sökmotorer. Denna artikel presenterar PsychiatryBench, ett nytt sätt att testa hur väl dessa system egentligen förstår psykiatrisk medicin. Den ställer en enkel men angelägen fråga: kan dagens AI‑verktyg resonera kring komplexa fall inom mental hälsa på ett sätt som är säkert, tillförlitligt och nära expertstandard?

Ett nytt test byggt på verklig klinisk kunskap

De flesta tidigare försök att bedöma AI inom mental hälsa förlitade sig på inlägg i sociala medier, små intervjutranskript eller till och med konversationer skapade av andra AI‑system. Dessa ligger långt ifrån de noggrant resonerade sjukhistorer och provfrågor som används för att utbilda psykiatrer. PsychiatryBench går en annan väg. Författarna byggde en frågesamling på 5 188 uppgifter, hämtade enbart från betrodda psykiatriböcker, fallböcker och självtestguider. Benchmarken täcker elva typer av uppgifter, från att namnge en diagnos och välja en behandling till att planera uppföljning, svara på grundläggande faktakunskapsfrågor och följa ett fall över tid. Fokus ligger på vuxen‑ och geriatrisk psykiatri i öppenvårdsmiljöer, där läkare måste väga överlappande symptom, medicinska biverkningar och långsiktig hantering snarare än enbart dramatiska nödsituationer.

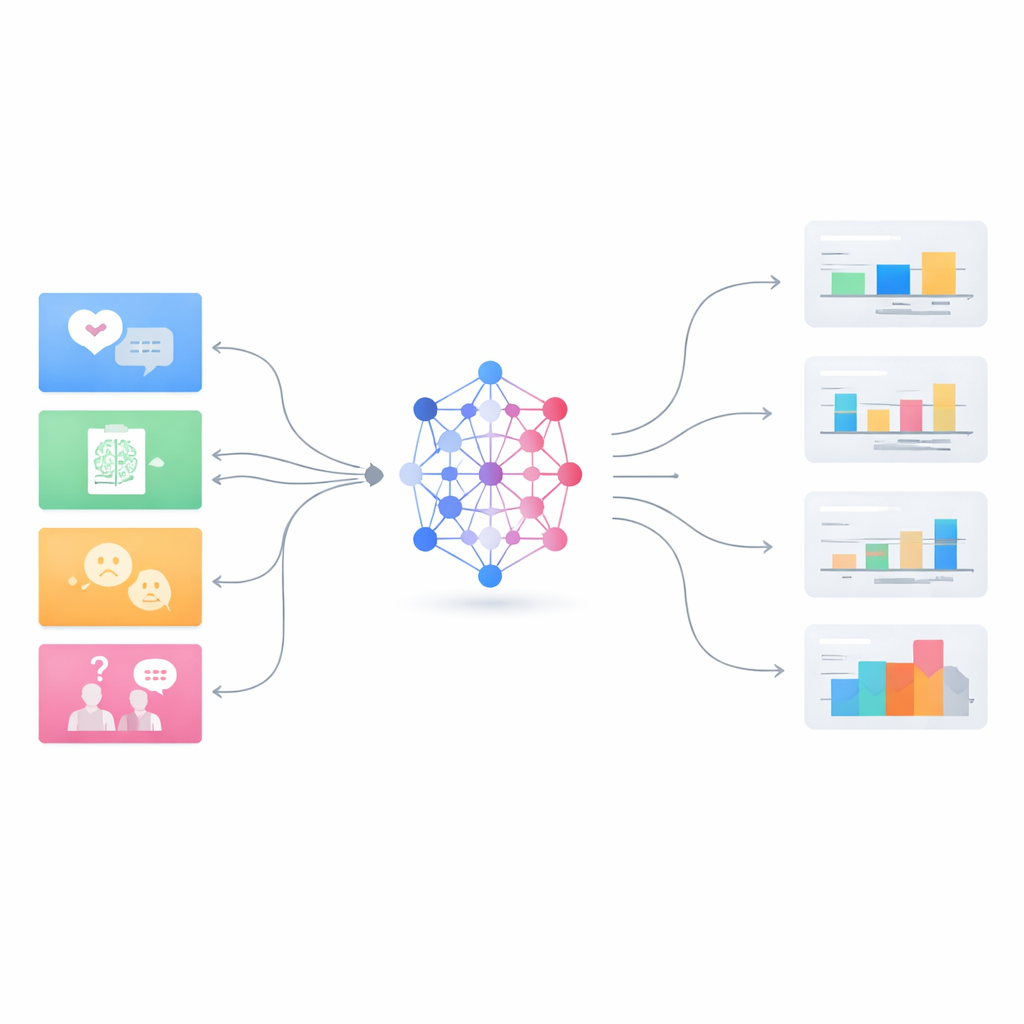

Hur AI‑modellerna testades

Teamet utvärderade femton ledande LLM:er, inklusive allmänna system från stora teknikföretag och flera modeller särskilt anpassade för medicin. För strukturerade uppgifter som flervalsfrågor poängsattes svar på sedvanligt sätt. För öppna svar—som ”Hur skulle du hantera detta fall?”—använde de en annan stark språkmodell som en neutral domare för att jämföra varje svar mot ett expertreferenssvar på en likhetsskala 0–100. Detta gjorde det möjligt att undersöka inte bara faktakunskap utan också kvaliteten på resonemanget och hur nära AI:ns kliniska logik låg den erfarna psykiatrers. Särskilda poängmetoder användes för komplexa provformat, såsom extended matching items där en lista med alternativ måste tillämpas korrekt på flera vignetter.

Vad dagens system klarar — och var de brister

Över hela benchmarken framträdde en tydlig topgrupp av de mest avancerade modellerna. Nyare allmänna system som GPT‑5 Medium och Claude Sonnet 4.5 i ”thinking”‑läge nådde genomsnittspoäng i mitten av 80‑procentintervallet och presterade starkt på krävande uppgifter som diagnostik, behandlingsplanering och flerstegsuppföljningsfrågor. De visade också relativt stabil prestanda över mycket olika uppgiftsformat, vilket tyder på robust resonemang snarare än snävt tricksinlärning. Mindre eller äldre modeller halkade betydligt efter, och vissa medicinskt specialiserade modeller uppvisade stora svängningar mellan höga poäng på faktabaserade prov och svag prestanda i öppna kliniska resonemangsuppgifter. Även ledarmodellerna hade svårt med de svåraste uppgifterna: finfördelad klassificering av specifika störningar med överlappande symptom och provfrågor som kräver val bland många nästan lika alternativ.

Generalist–specialist‑paradoxen inom medicinsk AI

Ett av de mest iögonfallande fynden är att modeller som tränats brett på många typer av text ofta överträffade modeller tränade specifikt på biomedicinsk litteratur när det gällde komplext psykiatriskt resonemang. Specialiserade medicinska modeller som MedGemma utmärkte sig vid kunskapstunga uppgifter som flervalsfrågor och detaljerade störningsetiketter, men de låg i allmänhet efter på flexibla, narrativa uppgifter som speglar verkliga klinikbesök. Denna ”generalist–specialist‑paradox” tyder på att rent exponering för medicinsk text inte räcker; förmågan att integrera kontext, hantera osäkerhet och revidera hypoteser—som starka generalmodeller gör—är avgörande för psykiatrin. Samtidigt visar studien att flera ”tänkande” steg hjälper vissa arkitekturer men inte andra, vilket antyder att brukbar deliberation i AI måste utformas omsorgsfullt, inte bara tvingas fram.

Begränsningar, skyddsåtgärder och vad som kommer härnäst

Trots uppmuntrande poäng betonar författarna att dessa system inte är redo att fatta osupervisade kliniska beslut. Benchmarken bygger på polerade lärobokscase, inte röriga verkliga journaler, kriser eller kulturellt mångfacetterade presentationer. Den testar inte om en chatbot kan hantera en aktivt suicidal person felaktigt, förstärka vanföreställningar eller svara på sådant sätt att förtroendet urholkas. Poängsättningen i sig förlitar sig på en annan AI‑domare, vilket introducerar egna snedvridningar. Som en följd bör PsychiatryBench ses som ett grundläggande laboratorietest, inte ett intyg på säkerhet. Författarna argumenterar för att LLM:er för närvarande bäst lämpar sig för att stödja utbildning, dokumentation och tidig idéfattning under noggrann mänsklig övervakning.

Vad detta betyder för patienter och kliniker

För allmänheten är slutsatsen både hoppfull och varningens ord. Moderna språkmodeller börjar närma sig delar av experters psykiatriska resonemang, särskilt i strukturerade, läroboksliknande miljöer. De kan redan hjälpa studenter att öva, bistå kliniker med sammanfattningar och lyfta fram riktlinjebaserade alternativ. Men de visar också förutsägbara blindfläckar i subtil diagnostik, multiflagsklassificering och hantering av tvetydiga fall—exakt de områden där misstag kan vara mest skadliga. PsychiatryBench belyser dessa styrkor och svagheter och erbjuder ett transparent sätt att följa framsteg och utforma säkrare system. Kort sagt antyder studien att AI kan bli en användbar assistent inom mentalvården, men endast om dess förmågor mäts ärligt och dess roll hålls tydligt under utbildade yrkespersoners överinseende.

Citering: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Nyckelord: psykiatribenchmark, stora språkmodeller, AI för mental hälsa, klinisk resonemang, dataset för medicinska utvärderingar