Clear Sky Science · nl

PsychiatryBench: een multi-task benchmark voor LLMs in de psychiatrie

Waarom dit werk belangrijk is voor geestelijke gezondheid en AI

Geestelijke gezondheidsproblemen raken honderden miljoenen mensen wereldwijd, maar velen krijgen nooit tijdige, hoogwaardige zorg. Tegelijkertijd dringen krachtige chatbots op basis van grote taalmodellen (LLM’s) snel door in dokterspraktijken, therapie-apps en zelfs alledaagse zoekmachines. Dit artikel introduceert PsychiatryBench, een nieuwe manier om te testen hoe goed deze systemen psychiatrische geneeskunde echt begrijpen. Het stelt een eenvoudige maar urgente vraag: kunnen de huidige AI-hulpmiddelen complexe casussen op het gebied van geestelijke gezondheid op een veilige, betrouwbare en deskundigheidsachtige manier doordenken?

Een nieuwe test opgebouwd uit echte klinische kennis

De meeste eerdere pogingen om AI in de geestelijke gezondheid te beoordelen vertrouwden op berichten van sociale media, kleine interviewtranscripten of zelfs gesprekken verzonnen door andere AI-systemen. Dat staat ver af van de zorgvuldig geredeneerde casushistorieën en examenvragen die psychiaters opleiden. PsychiatryBench kiest een andere route. De auteurs stelden een vragenset van 5.188 items samen die uitsluitend is ontleend aan vertrouwde psychiatrische handboeken, casusboeken en zelftoetsgidsen. De benchmark bestrijkt elf soorten taken, van het benoemen van een diagnose en het kiezen van een behandeling tot het plannen van voortdurende zorg, het beantwoorden van fundamentele kennisvragen en het volgen van een casus in de tijd. De focus ligt op volwassen- en geriatrische psychiatrie in poliklinische settings, waar artsen rekening moeten houden met overlappende symptomen, medische bijwerkingen en langdurig beheer in plaats van alleen met dramatische noodsituaties.

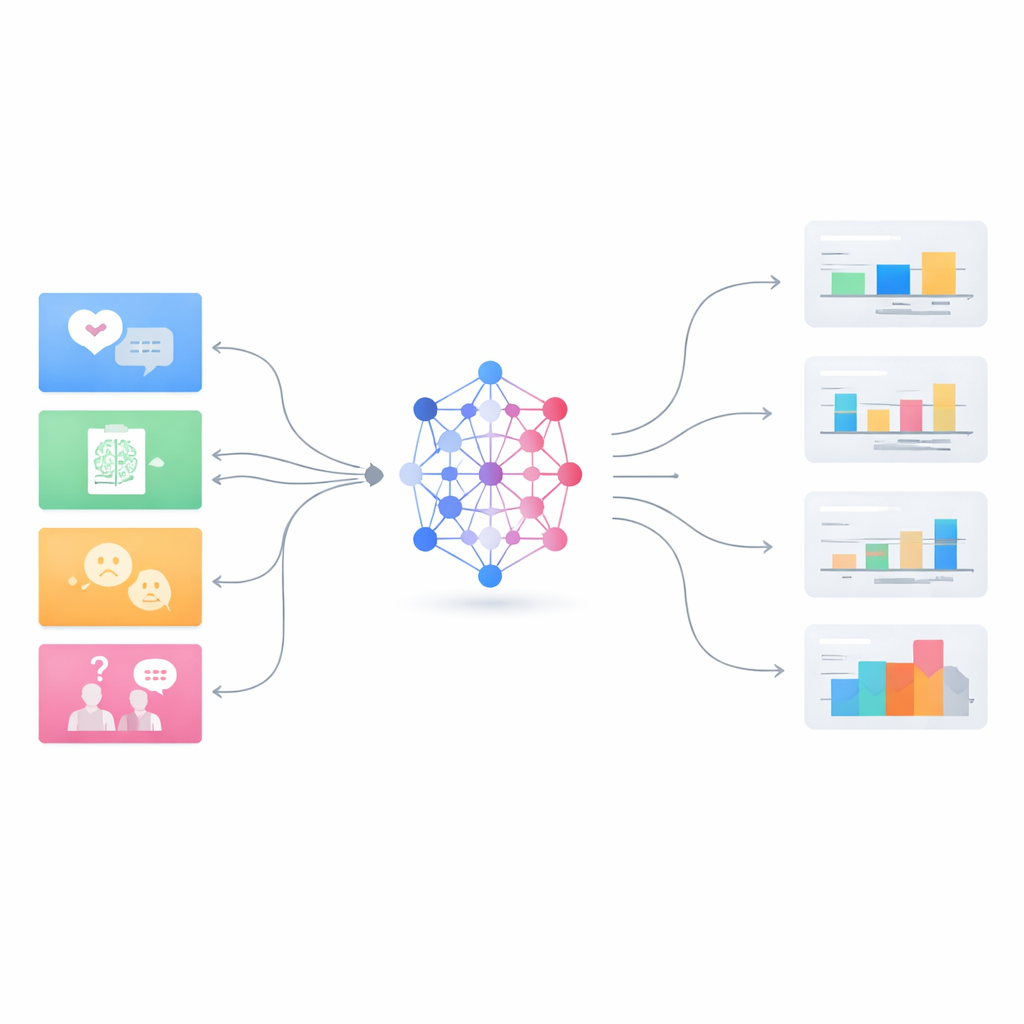

Hoe de AI-modellen werden getest

Het team evalueerde vijftien toonaangevende LLM’s, waaronder algemene systemen van grote techbedrijven en meerdere modellen die specifiek op de geneeskunde waren afgestemd. Voor gestructureerde taken zoals meerkeuzevragen beoordeelden ze antwoorden op de gebruikelijke manier. Voor open antwoorden — zoals “Hoe zou u deze casus behandelen?” — gebruikten ze een ander sterk taalmodel als neutrale beoordelaar om elk antwoord te vergelijken met een deskundige referentie op een schaal van 0–100 voor gelijkenis. Daarmee konden ze niet alleen feitelijke kennis peilen, maar ook de kwaliteit van het redeneren en hoe dicht de klinische logica van de AI bij die van ervaren psychiaters lag. Speciale scoremethoden werden toegepast voor complexe examenformaten, zoals extended matching items waarbij één lijst opties correct moet worden toegepast op meerdere vignetten.

Wat de systemen van vandaag kunnen — en waar ze tekortschieten

Over de volledige benchmark heen kwam een duidelijke kopgroep van grensverleggende modellen naar voren. Nieuwere algemene systemen zoals GPT‑5 Medium en Claude Sonnet 4.5 in „denken”-modus bereikten gemiddelde scores rond de midden‑80%-range en presteerden sterk op veeleisende taken zoals diagnose, behandelplanning en meerstaps vervolgvragen. Ze lieten ook relatief stabiele prestaties zien over zeer verschillende taken, wat wijst op robuust redeneren in plaats van smalle trucjes. Daartegenover bleven kleinere of oudere modellen ver achter, en sommige medisch‑specifieke modellen vertoonden grote schommelingen tussen hoge scores op feitelijke toetsen en zwakke prestaties op open klinisch redeneren. Zelfs de koplopers hadden moeite met de moeilijkste taken: fijnmazige classificatie van specifieke stoornissen met overlappende symptomen en examenvragen waarbij uit veel bijna gelijke opties gekozen moet worden.

Het generalist‑specialist paradox in medische AI

Een van de meest opvallende bevindingen is dat breed op veel tekstsoorten getrainde modellen vaak beter presteerden dan modellen die specifiek op biomedische literatuur waren getraind als het ging om complex psychiatrisch redeneren. Gespecialiseerde medische modellen zoals MedGemma blonken uit bij kennisintensieve taken zoals meerkeuzevragen en gedetailleerde stoornislabels, maar bleken over het algemeen achter te blijven bij flexibele, verhalende taken die een echte poliklinische afspraak spiegelen. Deze „generalist‑specialist paradox” suggereert dat blootstelling aan medische teksten alleen niet voldoende is; het vermogen om context te integreren, met onzekerheid om te gaan en hypothesen te herzien — zoals sterke algemene modellen doen — is cruciaal voor de psychiatrie. Tegelijk toont de studie dat het toevoegen van meer „denk”-stappen sommige architecturen helpt maar andere niet, wat erop wijst dat nuttige beraadslaging in AI zorgvuldig ontworpen moet worden en niet eenvoudigweg afgedwongen.

Beperkingen, waarborgen en wat volgt

Ondanks bemoedigende scores benadrukken de auteurs dat deze systemen nog niet klaar zijn om onbewaakt klinische beslissingen te nemen. De benchmark is gebaseerd op gepolijste tekstboekcases, niet op rommelige dossiers uit de praktijk, crises of cultureel diverse presentatievormen. Hij test niet of een chatbot mogelijk slecht zou omgaan met iemand die actief suïcidaal is, waanideeën zou versterken of op manieren zou reageren die vertrouwen ondermijnen. De scoring zelf steunt op een andere AI‑beoordelaar, wat eigen vooroordelen introduceert. Daarom moet PsychiatryBench worden gezien als een fundamentele laboratoriumtest, niet als een veiligheidskeurmerk. De auteurs betogen dat LLM’s voorlopig het best geschikt zijn voor ondersteuning van onderwijs, documentatie en vroege brainstormsessies onder zorgvuldige menselijke supervisie.

Wat dit betekent voor patiënten en clinici

Voor niet‑specialisten is de conclusie zowel hoopgevend als waarschuwend. Moderne taalmodellen beginnen delen van het deskundige psychiatrische redeneren te benaderen, vooral in gestructureerde, handboekachtige omgevingen. Ze kunnen studenten helpen oefenen, clinici assisteren bij samenvattingen en richtlijngebaseerde opties naar voren brengen. Maar ze tonen ook voorspelbare blinde vlekken in subtiele diagnostiek, multi‑label classificatie en het omgaan met ambigue gevallen — precies de gebieden waar fouten het schadelijkst kunnen zijn. PsychiatryBench werpt licht op deze sterktes en zwaktes en biedt een transparante manier om voortgang te volgen en veiligere systemen te ontwerpen. Simpel gezegd suggereert de studie dat AI een nuttige assistent in de geestelijke gezondheidszorg kan worden, maar alleen als zijn mogelijkheden eerlijk worden gemeten en zijn rol scherp onder toezicht van opgeleide professionals blijft.

Bronvermelding: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Trefwoorden: psychiatrie benchmark, large language models, AI voor geestelijke gezondheid, klinisch redeneren, datasets voor medische evaluatie