Clear Sky Science · it

PsychiatryBench: un benchmark multitask per LLM in psichiatria

Perché questo lavoro conta per la salute mentale e l’IA

I problemi di salute mentale riguardano centinaia di milioni di persone nel mondo, ma molti non ricevono cure tempestive e di qualità. Allo stesso tempo, potenti chatbot basati su modelli linguistici di grandi dimensioni (LLM) stanno rapidamente entrando negli studi medici, nelle app di terapia e persino nei motori di ricerca usati quotidianamente. Questo articolo presenta PsychiatryBench, un nuovo modo per verificare quanto questi sistemi comprendano davvero la medicina psichiatrica. Propone una domanda semplice ma urgente: gli strumenti di IA di oggi sono in grado di analizzare casi complessi di salute mentale in modo sicuro, affidabile e vicino agli standard degli esperti?

Un nuovo test costruito su conoscenze cliniche reali

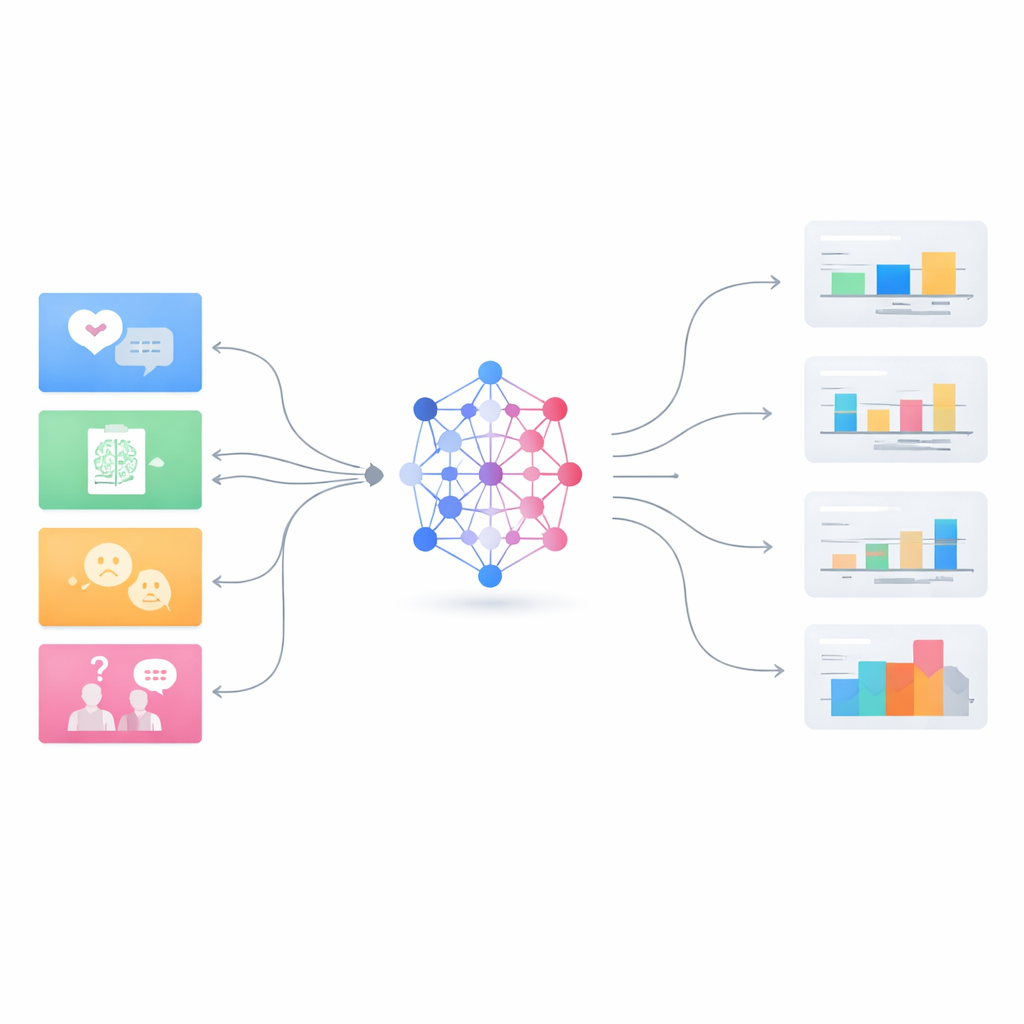

La maggior parte dei tentativi precedenti di valutare l’IA in ambito salute mentale si è basata su post di social media, piccole trascrizioni di interviste o persino conversazioni generate da altri sistemi di IA. Questi materiali sono lontani dalle storie cliniche ragionate e dalle domande d’esame usate per formare gli psichiatri. PsychiatryBench prende una strada diversa. Gli autori hanno costruito un set di 5.188 domande tratte esclusivamente da manuali psichiatrici affidabili, casebook e guide per l’autovalutazione. Il benchmark copre undici tipi di compiti, dal nominare una diagnosi e scegliere un trattamento al pianificare la cura continuativa, rispondere a quesiti di conoscenza di base e seguire un caso nel tempo. Il focus è sulla psichiatria adulta e geriatrica in setting ambulatoriali, dove i medici devono valutare sintomi sovrapposti, effetti collaterali medici e gestione a lungo termine piuttosto che soltanto emergenze drammatiche.

Come sono stati messi alla prova i modelli di IA

Il team ha valutato quindici LLM di punta, inclusi sistemi di uso generale sviluppati da grandi aziende tecnologiche e diversi modelli specificamente tarati per la medicina. Per compiti strutturati come le domande a scelta multipla, hanno valutato le risposte nel modo consueto. Per risposte aperte—come “Come gestirebbe questo caso?”—hanno utilizzato un altro potente modello linguistico come giudice neutrale per confrontare ogni risposta con un riferimento di esperto su una scala di similarità da 0 a 100. Questo ha permesso di sondare non solo il richiamo di fatti, ma anche la qualità del ragionamento e quanto la logica clinica dell’IA si avvicinasse a quella di psichiatri esperti. Sono stati impiegati metodi di punteggio speciali per formati d’esame complessi, come gli extended matching items in cui una lista di opzioni deve essere correttamente applicata a più vignette.

Cosa sanno fare i sistemi odierni — e dove sono carenti

Nel corso dell’intero benchmark è emerso un gruppo di punta chiaro. Sistemi generali più recenti come GPT‑5 Medium e Claude Sonnet 4.5 in modalità “thinking” hanno raggiunto punteggi medi intorno all’80% e hanno reso bene in compiti esigenti come diagnosi, pianificazione del trattamento e domande di follow‑up multi‑fase. Hanno inoltre mostrato performance relativamente stabili attraverso formati di compito molto diversi, suggerendo un ragionamento robusto piuttosto che apprendimento di trucchi specifici. Al contrario, modelli più piccoli o datati sono rimasti molto indietro, e alcuni modelli medicali specifici hanno mostrato forti oscillazioni tra punteggi elevati in esami fattuali e scarsa performance nel ragionamento clinico aperto. Perfino i migliori hanno avuto difficoltà con i compiti più duri: classificazioni dettagliate di disturbi specifici con sintomi sovrapposti e item d’esame che richiedono di scegliere tra molte opzioni quasi simili.

Il paradosso generalista–specialista nell’IA medica

Una delle scoperte più sorprendenti è che i modelli addestrati su una vasta gamma di testi spesso hanno superato i modelli formati specificamente sulla letteratura biomedica quando si trattava di ragionamento psichiatrico complesso. Modelli medici specializzati come MedGemma eccellevano in compiti ricchi di conoscenza, come le domande a scelta multipla e le etichette dettagliate di disturbo, ma generalmente risultavano inferiori nei compiti narrativi e flessibili che riflettono le visite cliniche reali. Questo “paradosso generalista–specialista” suggerisce che la sola esposizione a testi medici non è sufficiente; la capacità di integrare il contesto, gestire l’incertezza e rivedere le ipotesi—come fanno i forti modelli generali—è cruciale per la psichiatria. Allo stesso tempo, lo studio mostra che aggiungere più passaggi di “riflessione” aiuta alcune architetture ma non altre, lasciando intendere che una deliberazione utile nell’IA deve essere progettata con cura, non semplicemente forzata.

Limiti, salvaguardie e prossimi passi

Nonostante punteggi incoraggianti, gli autori sottolineano che questi sistemi non sono pronti a prendere decisioni cliniche non supervisionate. Il benchmark si basa su casi da manuale raffinati, non su cartelle reali disordinate, crisi o presentazioni culturalmente diverse. Non valuta se un chatbot potrebbe gestire male una persona attivamente suicida, rinforzare deliri o rispondere in modi che erodono la fiducia. Anche il sistema di punteggio, basato su un altro giudice IA, introduce i propri bias. Di conseguenza, PsychiatryBench va visto come un test di laboratorio fondamentale, non come un certificato di sicurezza. Gli autori sostengono che, per ora, gli LLM sono più adatti a supportare l’educazione, la documentazione e il brainstorming iniziale sotto attento controllo umano.

Cosa significa questo per pazienti e clinici

Per i lettori non specialisti, la conclusione è insieme promettente e cauta. I modelli linguistici moderni stanno cominciando ad approssimare parti del ragionamento psichiatrico esperto, specialmente in contesti strutturati e simili ai manuali. Possono già aiutare gli studenti a esercitarsi, assistere i clinici con riepiloghi e mettere in evidenza opzioni basate sulle linee guida. Ma mostrano anche punti ciechi prevedibili nella diagnosi sottile, nella classificazione multi‑etichetta e nella gestione di casi ambigui—proprio le aree dove gli errori possono essere più dannosi. PsychiatryBench mette in luce questi punti di forza e di debolezza, offrendo un modo trasparente per monitorare i progressi e progettare sistemi più sicuri. In termini semplici, lo studio suggerisce che l’IA può diventare un assistente utile nella cura della salute mentale, ma solo se le sue capacità vengono misurate onestamente e il suo ruolo rimane saldamente sotto la supervisione di professionisti formati.

Citazione: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Parole chiave: benchmark psichiatrico, modelli linguistici di grandi dimensioni, IA per la salute mentale, ragionamento clinico, dataset per valutazioni mediche