Clear Sky Science · ru

PsychiatryBench: многозадачный бенчмарк для LLM в психиатрии

Почему эта работа важна для психического здоровья и ИИ

Проблемы психического здоровья затрагивают сотни миллионов людей по всему миру, при этом многие так и не получают своевременной качественной помощи. Одновременно мощные чат‑боты на основе моделей большого языка (LLM) быстро появляются в кабинетах врачей, в терапевтических приложениях и даже в поисковых системах. В этой статье представлен PsychiatryBench — новый способ проверить, насколько действительно эти системы понимают психиатрическую медицину. Вопрос прост и срочен: могут ли современные инструменты ИИ разбирать сложные случаи психического здоровья так, чтобы это было безопасно, надежно и близко к экспертным стандартам?

Новый тест, созданный на основе клинических знаний

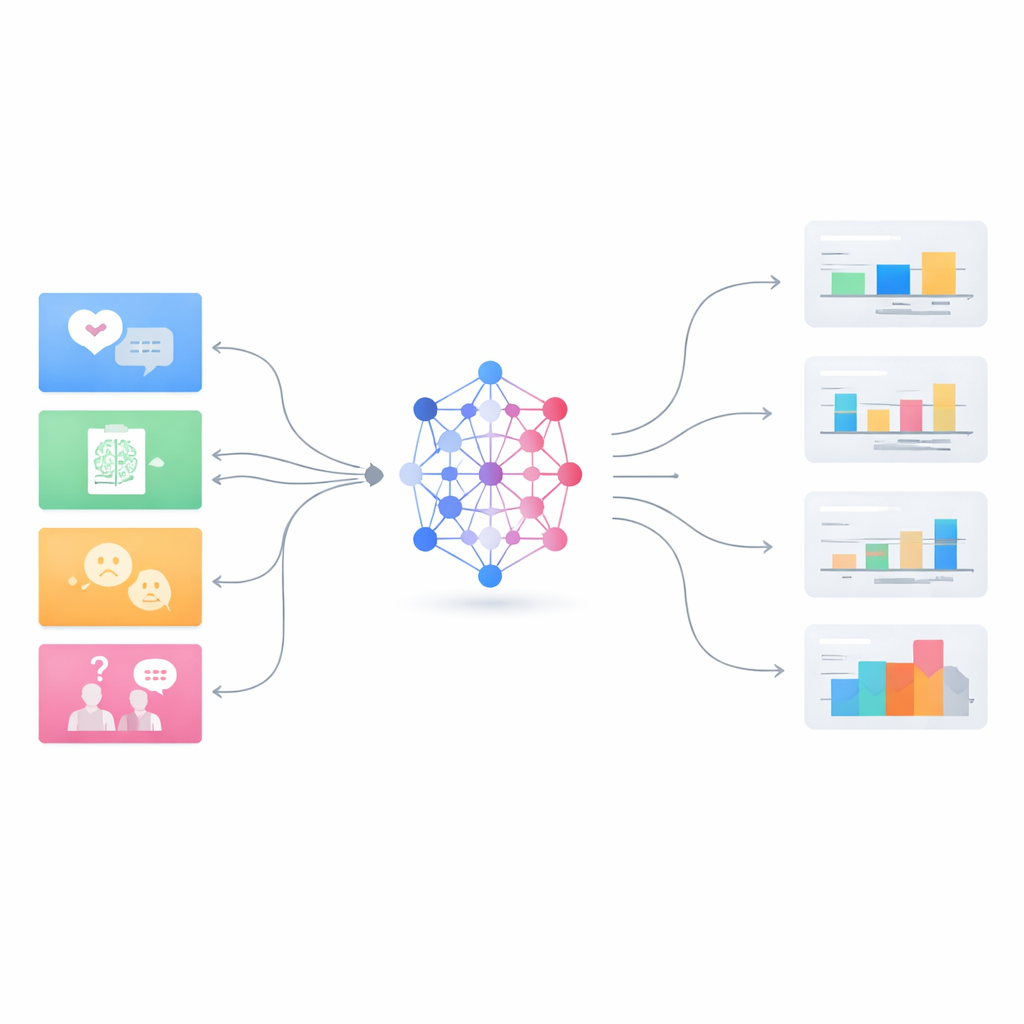

Большинство прежних попыток оценить ИИ в области психического здоровья опирались на посты в соцсетях, небольшие расшифровки интервью или даже беседы, сгенерированные другими ИИ. Это далеко от тщательно аргументированных историй болезни и экзаменационных вопросов, которыми обучают психиатров. PsychiatryBench идет иным путем. Авторы составили набор из 5 188 вопросов, взятых исключительно из проверенных психиатрических учебников, сборников клинических случаев и материалов для самопроверки. Бенчмарк охватывает одиннадцать типов заданий — от постановки диагноза и выбора лечения до планирования дальнейшей помощи, ответа на фундаментальные вопросы и наблюдения за развитием случая во времени. В фокусе — взрослое и гериатрическое направление амбулаторной психиатрии, где врачи должны учитывать перекрывающиеся симптомы, побочные эффекты медикаментов и долговременное ведение, а не только драматические экстренные ситуации.

Как проверяли ИИ‑модели

Команда оценивала пятнадцать ведущих LLM, включая универсальные системы от крупных технологических компаний и несколько моделей, специально настроенных на медицину. Для структурированных заданий, таких как вопросы с несколькими вариантами ответов, оценки ставили традиционным способом. Для открытых ответов — например «Как вы будете вести этот случай?» — использовали другую сильную языковую модель в роли нейтрального судьи, сравнивавшего каждый ответ с экспертной опорой по шкале сходства от 0 до 100. Это позволило исследовать не только воспоминание фактов, но и качество рассуждений и то, насколько клиническая логика ИИ совпадает с логикой опытных психиатров. Для сложных форматов экзамена, таких как расширенные сопоставительные задания, где один список вариантов нужно применить к нескольким виньеткам, использовались специальные методы оценки.

Что могут современные системы и где они слабее

По всему бенчмарку выделилась явная ведущая группа современных моделей. Новые универсальные системы, такие как GPT‑5 Medium и Claude Sonnet 4.5 в режиме «thinking», показали средние результаты в районе середины 80% и успешно справлялись с требовательными задачами — постановкой диагноза, планированием лечения и многошаговыми вопросами о последующем ведении. Они также демонстрировали относительно стабильную работу в очень разных форматах заданий, что говорит о надежности рассуждений, а не об обучении на узких уловках. В то же время более мелкие или устаревшие модели существенно отставали, а некоторые специализированные медицинские модели демонстрировали резкие колебания: высокие баллы в фактических экзаменах и слабые — в открытом клиническом рассуждении. Даже лидеры испытывали затруднения с самыми трудными заданиями: тонкой классификацией похожих расстройств и экзаменационными позициями, где нужно выбрать среди множества почти одинаковых вариантов.

Парадокс универсала и специалиста в медицинском ИИ

Одно из самых заметных наблюдений — модели, обученные на очень разнородных текстах, часто превосходили модели, натренированные специально на биомедицинской литературе, в задачах сложного психиатрического рассуждения. Специализированные медицинские модели вроде MedGemma преуспевали в задачах, требующих знания фактов, например в тестах с несколькими вариантами и детальной маркировке расстройств, но обычно отставали в гибких нарративных заданиях, которые имитируют реальные визиты в клинику. Этот «парадокс универсала‑специалиста» указывает на то, что простого объема медицинских текстов недостаточно; способность интегрировать контекст, оперировать неуверенностью и пересматривать гипотезы — как умеют сильные универсальные модели — критически важна для психиатрии. При этом исследование показывает, что добавление дополнительных «этапов мышления» помогает некоторым архитектурам, но не всем, что намекает: полезное обдумывание ИИ должно быть тщательно спроектировано, а не просто навязано.

Ограничения, предохранители и дальнейшие шаги

Несмотря на обнадеживающие результаты, авторы подчеркивают, что эти системы пока не готовы принимать клинические решения без надзора. Бенчмарк опирается на отредактированные учебные случаи, а не на неопрятные реальные записи, кризисные ситуации или культурно разнообразные проявления. Он не проверяет, не навредит ли чат‑бот человеку с активными суицидальными мыслями, не усилит ли бредовые идеи или не ответит ли так, что подорвет доверие. Сама оценка опирается на другого ИИ‑судью, что вносит собственные смещения. В результате PsychiatryBench следует рассматривать как базовый лабораторный тест, а не как сертификат безопасности. Авторы утверждают, что на данном этапе LLM лучше всего подходят для поддержки обучения, документирования и первичного мозгового штурма под внимательным контролем человека.

Что это значит для пациентов и клиницистов

Для неспециалистов выводы одновременно обнадеживают и настораживают. Современные языковые модели начинают приближаться к частям экспертного психиатрического рассуждения, особенно в структурированных, похожих на учебник ситуациях. Они уже могут помогать студентам практиковаться, поддерживать врачей в составлении резюме и предлагать варианты, основанные на руководствах. Но у них также есть предсказуемые слепые зоны — в тонких диагнозах, мульти‑меточной классификации и работе с неоднозначными случаями — именно в тех областях, где ошибки могут быть наиболее вредными. PsychiatryBench высвечивает эти сильные и слабые стороны, предлагая прозрачный способ отслеживать прогресс и проектировать более безопасные системы. Проще говоря, исследование показывает: ИИ может стать полезным помощником в психиатрической помощи, но только если его способности честно измерять и его роль строго контролируют обученные профессионалы.

Цитирование: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Ключевые слова: психиатрический бенчмарк, модели большого языка, ИИ в области психического здоровья, клиническое мышление, наборы данных для медицинской оценки