Clear Sky Science · de

PsychiatryBench: ein Multi‑Task‑Benchmark für LLMs in der Psychiatrie

Warum diese Arbeit für psychische Gesundheit und KI wichtig ist

Psychische Gesundheitsprobleme betreffen weltweit Hunderte Millionen Menschen, doch viele erhalten nie rechtzeitig hochwertige Versorgung. Gleichzeitig dringen leistungsfähige Chatbots auf Basis großer Sprachmodelle (LLMs) schnell in Arztpraxen, Therapie‑Apps und sogar allgemeine Suchmaschinen vor. Dieser Artikel stellt PsychiatryBench vor, eine neue Methode, um zu prüfen, wie gut diese Systeme Psychiatrie wirklich verstehen. Er stellt eine einfache, aber dringende Frage: Können heutige KI‑Werkzeuge komplexe Fälle psychischer Gesundheit so durchdenken, dass sie sicher, verlässlich und auf Expertenniveau sind?

Ein neuer Test, aufgebaut aus echtem klinischem Wissen

Viele frühere Versuche, KI im Bereich psychischer Gesundheit zu bewerten, stützten sich auf Beiträge in sozialen Medien, kleine Interviewtranskripte oder sogar von anderen KI‑Systemen erfundene Dialoge. Das steht in weiter Entfernung zu den sorgfältig begründeten Fallgeschichten und Prüfungsfragen, mit denen Psychiater ausgebildet werden. PsychiatryBench geht einen anderen Weg. Die Autoren stellten einen Fragenkatalog mit 5.188 Aufgaben zusammen, der ausschließlich aus vertrauenswürdigen psychiatrischen Lehrbüchern, Fallbüchern und Selbstprüfungsleitfäden stammt. Das Benchmark deckt elf Aufgabentypen ab: von der Benennung einer Diagnose und der Auswahl einer Behandlung bis hin zur Planung der weiterführenden Versorgung, zur Beantwortung grundlegender Wissensfragen und zum Verlauf eines Falls über die Zeit. Der Fokus liegt auf der Erwachsenen‑ und Gerontopsychiatrie im ambulanten Bereich, wo Ärztinnen und Ärzte überlappende Symptome, medizinische Nebenwirkungen und Langzeitmanagement abwägen müssen – nicht nur dramatische Notfälle.

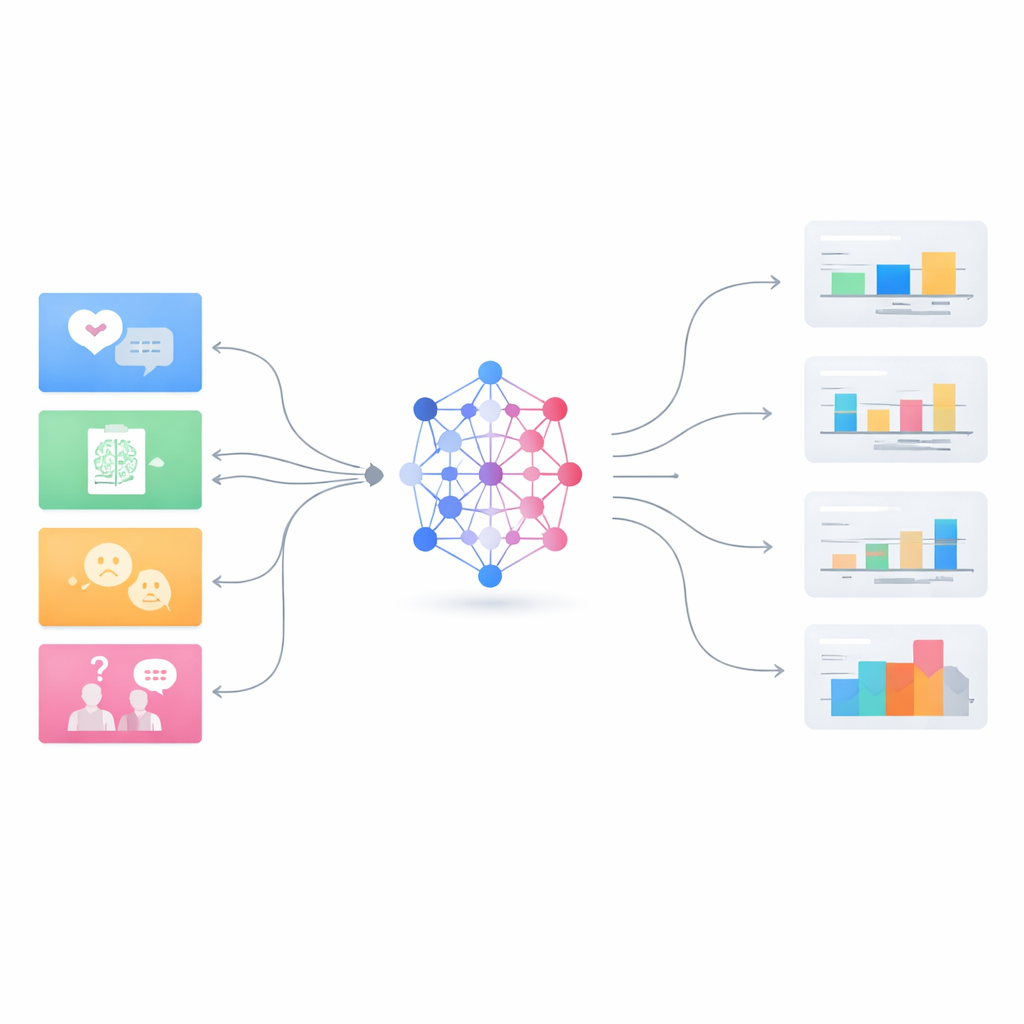

Wie die KI‑Modelle getestet wurden

Das Team bewertete fünfzehn führende LLMs, darunter allgemeine Systeme großer Tech‑Firmen und mehrere Modelle, die speziell für die Medizin angepasst wurden. Bei strukturierten Aufgaben wie Multiple‑Choice‑Fragen wurden die Antworten auf übliche Weise gewertet. Bei offenen Antworten – etwa „Wie würden Sie diesen Fall behandeln?“ – verwendeten sie ein weiteres leistungsstarkes Sprachmodell als neutralen Richter, um jede Antwort auf einer Ähnlichkeitsskala von 0–100 mit einer Expertenreferenz zu vergleichen. So konnten sie nicht nur Faktenabruf, sondern auch die Qualität des Denkens und wie eng die klinische Logik der KI der erfahrener Psychiater entsprach, untersuchen. Für komplexe Prüfungsformate, etwa Extended‑Matching‑Items, bei denen eine Optionsliste korrekt auf mehrere Vignetten angewendet werden muss, kamen spezielle Bewertungstechniken zum Einsatz.

Was heutige Systeme können — und wo sie versagen

Im gesamten Benchmark kristallisierte sich eine klare Spitzengruppe an Modellen heraus. Neuere generalistische Systeme wie GPT‑5 Medium und Claude Sonnet 4.5 im „Thinking“-Modus erreichten durchschnittliche Werte im mittleren 80‑Prozent‑Bereich und schnitten besonders gut bei anspruchsvollen Aufgaben wie Diagnose, Behandlungsplanung und mehrstufigen Folgefragen ab. Sie zeigten zudem relativ stabile Leistungen über sehr unterschiedliche Aufgabenformate hinweg, was auf robustes Schließen statt auf enges Tricklernen hindeutet. Demgegenüber lagen kleinere oder ältere Modelle deutlich zurück, und einige medizinisch spezialisierte Modelle schwankten stark zwischen hohen Ergebnissen bei faktischen Prüfungen und schwacher Leistung bei offenen klinischen Denkaufgaben. Selbst die Spitzenmodelle hatten Probleme mit den schwierigsten Aufgaben: feingliedrige Klassifikation eng überlappender Störungsbilder und Prüfungsitems, bei denen unter vielen nahezu ähnlichen Optionen gewählt werden muss.

Das Generalist‑Spezialist‑Paradox in medizinischer KI

Eines der auffälligsten Ergebnisse ist, dass breit auf viele Textarten trainierte Modelle bei komplexer psychiatrischer Argumentation teils besser abschnitten als Modelle, die speziell auf biomedizinische Literatur trainiert wurden. Spezialisierte medizinische Modelle wie MedGemma glänzten bei wissensintensiven Aufgaben wie Multiple‑Choice‑Fragen und detaillierten Störungsbezeichnungen, lagen aber allgemein zurück bei flexiblen, narrativen Aufgaben, die reale Klinikbesuche nachahmen. Dieses „Generalist‑Spezialist‑Paradox“ deutet darauf hin, dass bloße Exposition gegenüber medizinischem Text nicht ausreicht; die Fähigkeit, Kontext zu integrieren, mit Unsicherheit zu jonglieren und Hypothesen zu revidieren – wie sie starke Generalisten zeigen – ist für die Psychiatrie entscheidend. Zugleich zeigt die Studie, dass zusätzliche „Denk‑Schritte“ manchen Architekturen helfen, anderen aber nicht, was darauf hinweist, dass nützliches Überlegen in KI sorgfältig gestaltet werden muss und nicht einfach erzwungen werden kann.

Grenzen, Schutzmaßnahmen und der nächste Schritt

Trotz ermutigender Ergebnisse betonen die Autoren, dass diese Systeme nicht bereit sind, unüberwachte klinische Entscheidungen zu treffen. Das Benchmark basiert auf ausgearbeiteten Lehrbuchfällen, nicht auf unordentlichen realen Akten, Krisen oder kulturell vielfältigen Präsentationen. Es testet nicht, ob ein Chatbot eine akut suizidale Person falsch behandeln, Wahnideen bestärken oder auf eine Weise reagieren könnte, die Vertrauen untergräbt. Die Bewertung selbst stützt sich auf einen weiteren KI‑Richter, der eigene Verzerrungen einbringt. Daher sollte PsychiatryBench als grundlegender Labortest verstanden werden, nicht als Sicherheitszertifikat. Die Autoren argumentieren, dass LLMs derzeit am besten zur Unterstützung von Ausbildung, Dokumentation und frühzeitigen Ideenfindungen unter sorgfältiger menschlicher Aufsicht geeignet sind.

Was das für Patientinnen, Patienten und Klinikpersonal bedeutet

Für interessierte Laien ist die Botschaft zugleich hoffnungsvoll und warnend. Moderne Sprachmodelle nähern sich Teilen des expert:innenhaften psychiatrischen Denkens an, besonders in strukturierten, lehrbuchähnlichen Kontexten. Sie können bereits Studierende beim Üben unterstützen, Klinikerinnen und Klinikern beim Erstellen von Zusammenfassungen helfen und leitlinienbasierte Optionen aufzeigen. Gleichzeitig zeigen sie vorhersehbare Schwächen bei subtilen Diagnosen, Multi‑Label‑Klassifikation und dem Umgang mit mehrdeutigen Fällen – genau dort, wo Fehler am schädlichsten sein können. PsychiatryBench macht diese Stärken und Schwächen sichtbar und bietet eine transparente Möglichkeit, Fortschritte zu verfolgen und sicherere Systeme zu entwerfen. Einfach gesagt: Die Studie legt nahe, dass KI ein nützlicher Assistent in der psychischen Gesundheitsversorgung werden kann, aber nur, wenn ihre Fähigkeiten ehrlich gemessen und ihre Rolle fest unter der Aufsicht ausgebildeter Fachkräfte verbleibt.

Zitation: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Schlüsselwörter: Psychiatrie‑Benchmark, große Sprachmodelle, KI für psychische Gesundheit, klinisches Denken, Datensätze für medizinische Evaluation