Clear Sky Science · pt

PsychiatryBench: um benchmark multitarefa para LLMs em psiquiatria

Por que este trabalho importa para a saúde mental e a IA

Problemas de saúde mental afetam centenas de milhões de pessoas no mundo todo, mas muitas nunca recebem atendimento oportuno e de qualidade. Ao mesmo tempo, chatbots poderosos baseados em grandes modelos de linguagem (LLMs) estão entrando rapidamente em consultórios, aplicativos de terapia e até em motores de busca do dia a dia. Este artigo apresenta o PsychiatryBench, uma nova forma de testar o quanto esses sistemas realmente entendem da medicina psiquiátrica. Ele faz uma pergunta simples, porém urgente: as ferramentas de IA atuais conseguem analisar casos complexos de saúde mental de maneira segura, confiável e próxima aos padrões dos especialistas?

Um novo teste construído a partir de conhecimento clínico real

A maioria das tentativas anteriores de avaliar IA em saúde mental baseou‑se em publicações de redes sociais, pequenas transcrições de entrevistas ou até conversas geradas por outros sistemas de IA. Isso está longe das histórias clínicas e questões de prova cuidadosamente fundamentadas usadas para treinar psiquiatras. O PsychiatryBench segue um caminho diferente. Os autores construíram um conjunto de 5.188 itens de perguntas extraídas apenas de livros‑texto confiáveis de psiquiatria, coletâneas de casos e guias de autoavaliação. O benchmark cobre onze tipos de tarefas, desde nomear um diagnóstico e escolher um tratamento até planejar cuidados contínuos, responder perguntas de conhecimento fundamental e acompanhar um caso ao longo do tempo. O foco é a psiquiatria adulta e geriátrica em ambiente ambulatorial, onde os médicos precisam ponderar sintomas sobrepostos, efeitos colaterais médicos e manejo a longo prazo, em vez de apenas emergências dramáticas.

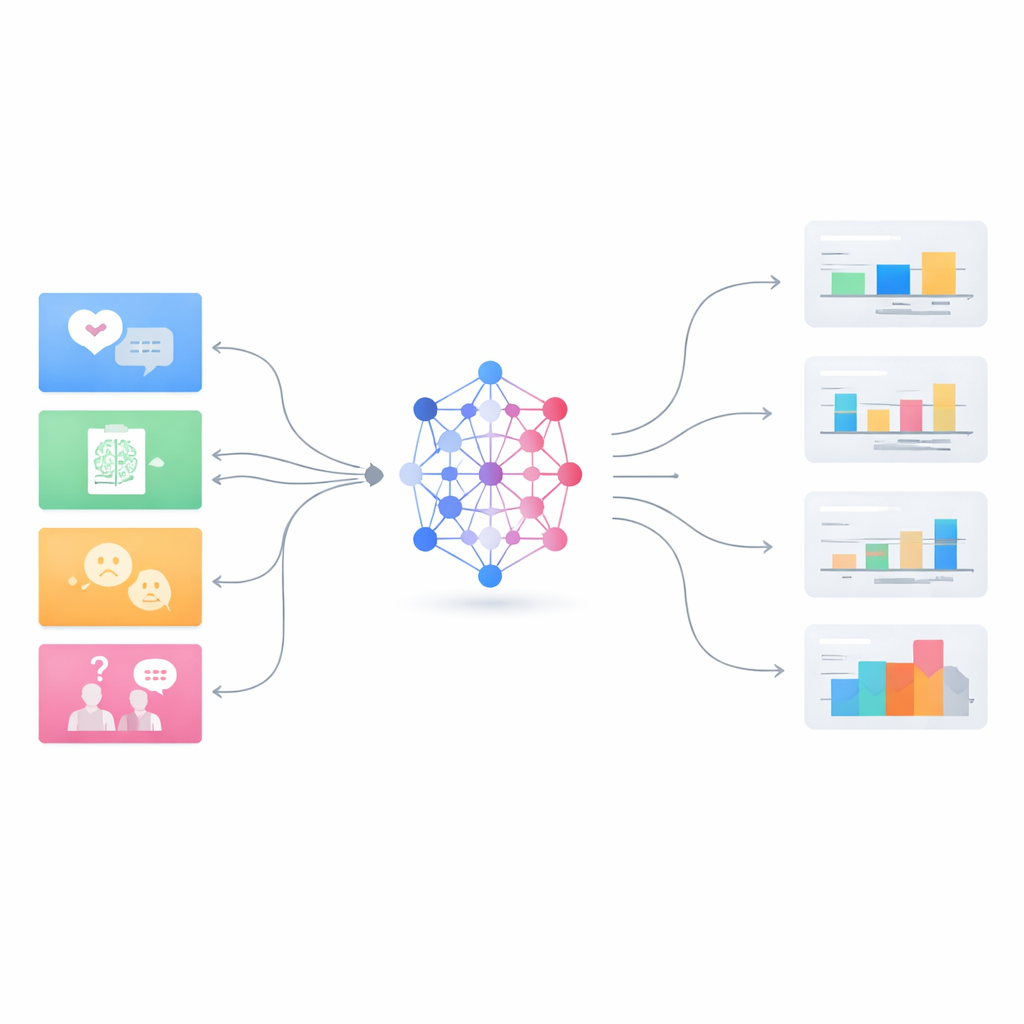

Como os modelos de IA foram testados

A equipe avaliou quinze LLMs líderes, incluindo sistemas de uso geral de grandes empresas de tecnologia e vários modelos ajustados especificamente para medicina. Para tarefas estruturadas, como questões de múltipla escolha, eles pontuaram as respostas da maneira habitual. Para respostas abertas — por exemplo, “Como você manejaria este caso?” — usaram outro modelo de linguagem forte como um juiz neutro para comparar cada resposta com uma referência de especialista em uma escala de similaridade de 0–100. Isso permitiu investigar não apenas a recuperação de fatos, mas também a qualidade do raciocínio e o quão próxima a lógica clínica da IA estava da de psiquiatras experientes. Métodos de pontuação especiais foram usados para formatos de exame complexos, como itens de correspondência estendida, em que uma lista de opções deve ser aplicada corretamente a vários vinhetas.

O que os sistemas atuais conseguem — e onde falham

No conjunto do benchmark, emergiu um grupo claro de modelos de ponta. Sistemas gerais mais novos, como GPT‑5 Medium e Claude Sonnet 4.5 no modo “thinking”, alcançaram pontuações médias na faixa dos 80% e tiveram bom desempenho em tarefas exigentes como diagnóstico, planejamento de tratamento e perguntas de acompanhamento em múltiplas etapas. Eles também mostraram desempenho relativamente estável em formatos de tarefa muito diferentes, sugerindo raciocínio robusto em vez de aprendizado de truques específicos. Em contraste, modelos menores ou mais antigos ficaram bem atrás, e alguns modelos médicos específicos exibiram grandes variações entre altas pontuações em exames factuais e desempenho fraco em raciocínio clínico aberto. Mesmo os líderes tiveram dificuldade nas tarefas mais difíceis: classificação detalhada de transtornos específicos com sintomas sobrepostos e itens de exame que exigem escolher entre muitas opções quase semelhantes.

O paradoxo generalista–especialista na IA médica

Uma das descobertas mais marcantes é que modelos treinados amplamente em muitos tipos de texto costumam superar modelos treinados especificamente em literatura biomédica quando se trata de raciocínio psiquiátrico complexo. Modelos médicos especializados, como o MedGemma, se destacaram em tarefas ricas em conhecimento, como questões de múltipla escolha e rótulos detalhados de transtornos, mas geralmente ficaram atrás em tarefas narrativas e flexíveis que imitam visitas clínicas reais. Esse “paradoxo generalista–especialista” sugere que a mera exposição a textos médicos não é suficiente; a capacidade de integrar contexto, lidar com incerteza e revisar hipóteses — como os modelos gerais fortes fazem — é crucial para a psiquiatria. Ao mesmo tempo, o estudo mostra que adicionar mais etapas de “pensamento” ajuda algumas arquiteturas, mas não outras, indicando que a deliberação útil na IA precisa ser projetada com cuidado, e não simplesmente forçada.

Limites, salvaguardas e os próximos passos

Apesar das pontuações encorajadoras, os autores ressaltam que esses sistemas não estão prontos para tomar decisões clínicas sem supervisão. O benchmark baseia‑se em casos lapidados de livros‑texto, não em prontuários do mundo real, crises ou apresentações culturalmente diversas. Ele não testa se um chatbot poderia lidar mal com uma pessoa ativamente suicida, reforçar delírios ou responder de formas que corroam a confiança. A própria pontuação depende de outro juiz de IA, o que introduz seus próprios vieses. Como resultado, o PsychiatryBench deve ser visto como um teste laboratorial fundamental, não como um certificado de segurança. Os autores argumentam que, por ora, os LLMs são mais adequados para apoiar educação, documentação e brainstorm inicial, sob cuidadosa supervisão humana.

O que isso significa para pacientes e clínicos

Para leitores leigos, a conclusão é ao mesmo tempo esperançosa e cautelosa. Modelos de linguagem modernos começam a aproximar partes do raciocínio psiquiátrico de especialistas, especialmente em ambientes estruturados e semelhantes a livros‑texto. Eles já podem ajudar estudantes a praticar, auxiliar clínicos com resumos e trazer opções baseadas em diretrizes. Mas também mostram pontos cegos previsíveis em diagnósticos sutis, classificação multilabel e manejo de casos ambíguos — exatamente as áreas onde erros podem ser mais prejudiciais. O PsychiatryBench lança luz sobre essas forças e fraquezas, oferecendo uma forma transparente de acompanhar o progresso e projetar sistemas mais seguros. Em termos simples, o estudo sugere que a IA pode se tornar um assistente útil na saúde mental, mas somente se suas capacidades forem medidas honestamente e seu papel permanecer firmemente sob a orientação de profissionais treinados.

Citação: Fouda, A.E., Hassan, A.A., Hanafy, R.J. et al. PsychiatryBench: a multi-task benchmark for LLMs in psychiatry. npj Digit. Med. 9, 320 (2026). https://doi.org/10.1038/s41746-026-02582-w

Palavras-chave: benchmark de psiquiatria, grandes modelos de linguagem, IA em saúde mental, raciocínio clínico, conjuntos de dados de avaliação médica