Clear Sky Science · zh

分析基于推理的监督对人脸反欺骗的影响

假脸为何关系到日常安全

人脸识别用于解锁手机、开启办公门禁并保护敏感数据。但这些系统容易被简单手段欺骗,例如拿出打印照片、在平板上播放视频或戴上逼真的面具。本研究探讨了一种新方法,通过在学习识别假脸的同时让系统以清晰语言“解释”其决策,使系统既更难被欺骗,又更易于人类理解。

将人脸检测变成可解释的叙述

目前大多数反欺骗工具像黑盒子:只给出“真实”或“伪造”的结果,却很少说明原因。作者基于视觉—语言模型,这类人工智能既能查看图像又能生成文本。在训练过程中,模型不仅判断人脸是真实还是伪造,还生成简短解释,描述其依据的视觉线索,例如异常纹理、扁平的光照或看起来不自然的反光。这些解释不仅是展示:它们成为影响模型注意力分配的教学信号的一部分。

构建会“思考出声”的基准

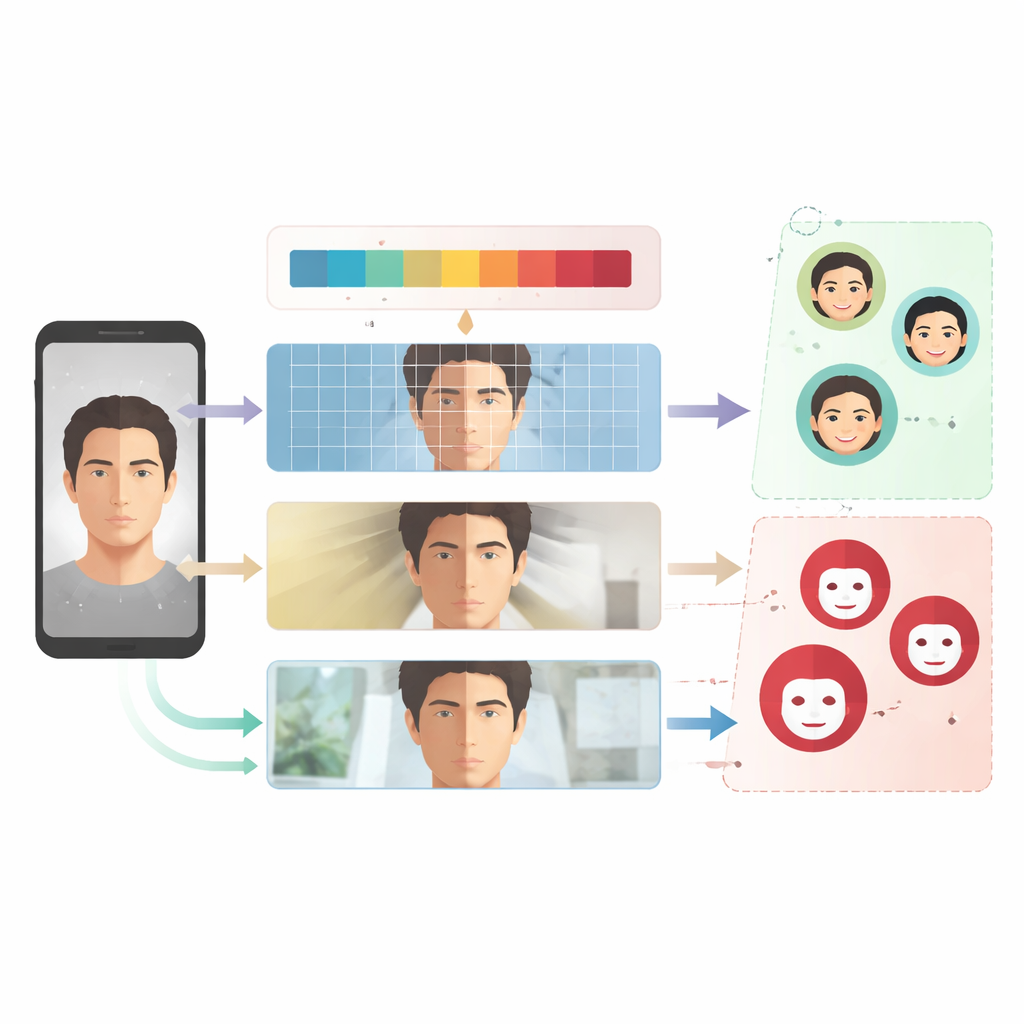

为了在受控条件下研究该想法,团队为四个广泛使用的人脸反欺骗数据集(涵盖打印照片和重放视频等常见攻击)补充了详细的文本描述。使用 GPT-4o,他们为每张图像生成两类说明。“普通”说明给出简短的一般性理由,而“推理式”说明则按六个明确步骤展开:初步观察、伪影检测、特征分析、光照与阴影、背景语境和最终判断。通过固定图像数据和底层神经网络,仅改变说明的风格,研究者能够分离出解释结构如何影响模型最终学习到的内容。

用理由进行教学如何改变模型

训练过程变成双重任务。一个损失项奖励正确的真实/伪造判定,另一个奖励准确的解释生成,且以分类为主要目标。作者还采用了轻量级微调方法,仅更新小型适配器层和输出头,使大型预训练主干基本保持不变。他们将仅用普通说明训练的模型与混合使用普通与推理说明的模型在若干具有挑战性的“在部分数据集上训练、在另一个数据集上测试”的协议下进行比较。这种设置模拟了现实场景,其中未来的攻击可能与过去不完全相同。

何时解释有益——何时有害

在多项测试中,尤其是标准的 MCIO 留一法协议下,接触过推理式说明的模型在检测伪造方面更准确,并且在不熟悉的数据集上犯错更少。在若干情况下,它们甚至超过了为跨数据集稳健性设计的专门先进防御方法。受推理引导的模型似乎更一致地关注伪造特有的线索,例如纹理不规则、像素化或不自然的光照。然而,研究也揭示了一个缺点:如果说明反复强调对新型攻击并不重要的特征——例如当新攻击使用三维面具时仍强调印刷质感——模型可能会继承这种偏差而表现失误,表明“教学脚本”既能帮助也能误导。

衡量解释的局限

作者指出,他们主要通过另一种语言模型来解读生成的解释,从而判断解释质量是否暗示了正确的真实或伪造标签。但这并不能完全解决解释是否忠实于视觉系统实际看到的内容,或其对监控安全系统的人类操作员是否真正有用的问题。他们还强调,使用强大的语言模型来生成和评估解释可能引入细微偏差——例如过度强调频繁出现的视觉模式——从而影响在不同人群和录制条件下的公平性或性能。

对更安全人脸识别的意义

通俗地说,这项工作表明,在训练期间让 AI 系统“说明原因”可以改变其识别假脸的学习方式——通常能提升其应对新的、未见过攻击的能力——而无需让模型更大或更复杂。与此同时,我们教授的推理类型很重要:结构化解释可以像方向盘一样引导模型,但如果指向了错误的线索,当攻击变化时模型可能偏离正确轨道。研究建议把解释视为不仅是用户友好的附加项,而是工程师可调节的强力旋钮,用以在未来安全系统中在鲁棒性、可解释性和偏差之间做权衡。

引用: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

关键词: 人脸反欺骗, 可解释人工智能, 视觉-语言模型, 生物特征安全, 呈现攻击