Clear Sky Science · sv

Analysera effekten av resonemangsbaserad tillsyn på ansiktsanti‑spoofing

Varför falska ansikten spelar roll för vardaglig säkerhet

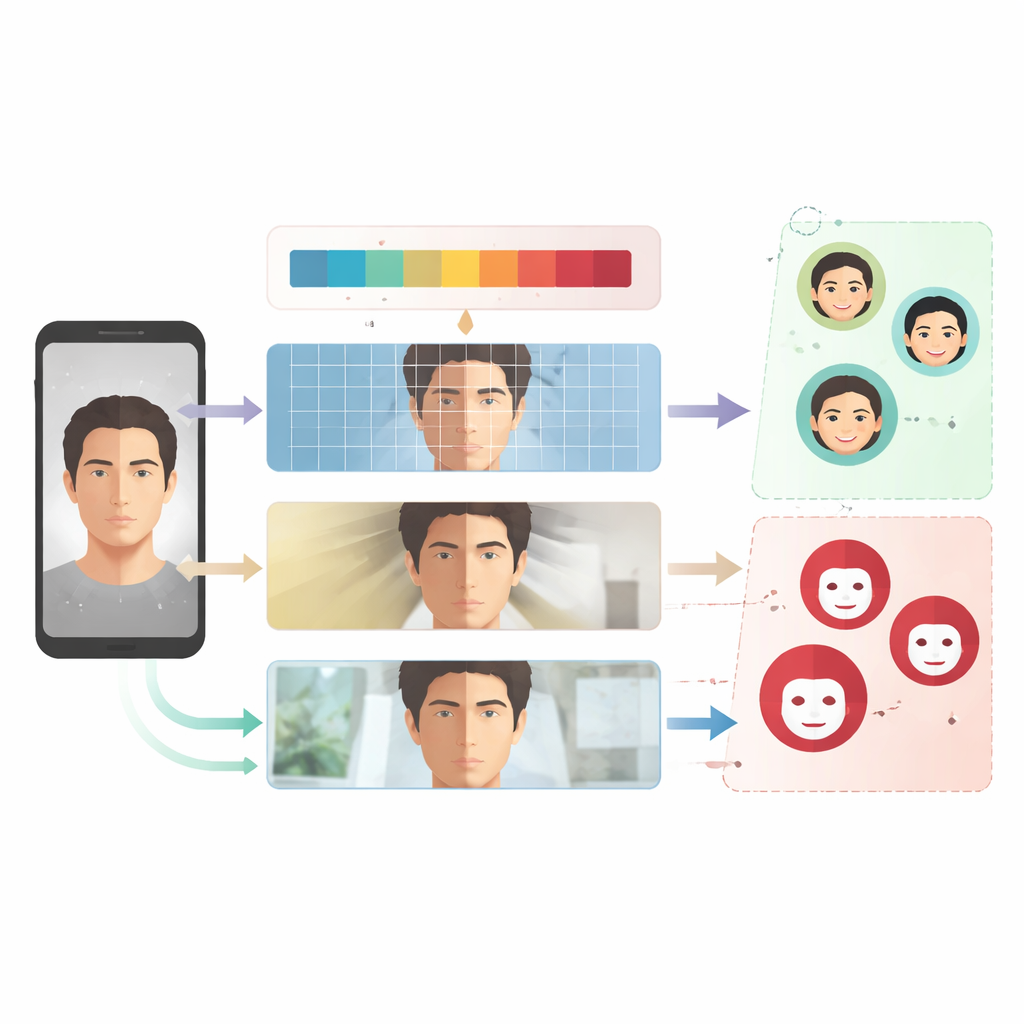

Ansiktsigenkänning låser upp telefoner, öppnar kontorsdörrar och skyddar känslig data. Men dessa system kan luras med enkla knep, som att visa upp ett tryckt foto, spela upp en video på en surfplatta eller bära en realistisk mask. Denna studie undersöker ett nytt sätt att göra sådana system svårare att vilseleda och lättare för människor att förstå, genom att lära dem att "förklara" sina beslut med vanlig text samtidigt som de lär sig att upptäcka falska ansikten.

Förvandla ansiktskontroller till förklarande berättelser

De flesta nuvarande anti‑spoofingverktyg beter sig som svarta lådor: de ger ut "äkta" eller "falskt" men säger lite om varför. Författarna bygger istället på en vision–språk‑modell, en typ av AI som både kan tolka bilder och generera text. Under träning bestämmer modellen inte bara om ett ansikte är levande eller manipulerat, utan producerar också en kort förklaring som beskriver de visuella ledtrådar den använde, såsom märkliga texturer, platt belysning eller reflektioner som inte ser naturliga ut. Dessa förklaringar är inte bara för syns skull; de blir en del av undervisningssignalen som formar vad modellen uppmärksammar.

Bygga ett riktmärke som tänker högt

För att studera idén i kontrollerade former berikar teamet fyra välanvända datasätt för ansiktsanti‑spoofing—som täcker vanliga attacker som tryckta foton och uppspelade videor—med detaljerade textbeskrivningar. Med hjälp av GPT‑4o genererar de två typer av bildtexter för varje bild. "Vanilla"‑captioner ger en kort, generell motivering, medan "resonerande" bildtexter går igenom sex tydliga steg: första intryck, artefaktdetektion, funktionsanalys, belysning och skuggor, kontext och slutligt omdöme. Genom att hålla bilddata och den underliggande neurala nätverksarkitekturen fasta och endast ändra stilen på dessa bildtexter kan forskarna isolera hur förklaringsstrukturen påverkar vad modellen slutligen lär sig.

Hur undervisning med skäl förändrar modellen

Träningen blir nu en dubbel uppgift. En förlustterm belönar korrekta beslut om levande/fake, och en annan belönar korrekt förklaringsgenerering, där klassificeringen behandlas som huvudmålet. Författarna använder också en lättvikts finjusteringsmetod så att endast små adapterlager och utdatahuvuden uppdateras, medan den stora förtränade ryggraden i stort sett lämnas orörd. De jämför modeller tränade enbart med vanilla‑captioner med modeller tränade med en blandning av vanilla och resonerande captioner över flera utmanande "träna på vissa dataset, testa på ett annat"‑protokoll. Detta upplägg efterliknar verkliga förhållanden, där framtida attacker kanske inte ser exakt ut som tidigare.

När förklaringar hjälper — och när de hindrar

I många tester, särskilt standardprotokollen MCIO leave‑one‑out, upptäcker modeller som exponeras för resonerande captioner spoofing mer precist och gör färre misstag på främmande dataset. I vissa fall överträffar de till och med specialiserade topppresterande försvar som är designade för robusthet över dataset. De resoneringsstyrda modellerna verkar fokusera mer konsekvent på spoof‑specifika ledtrådar såsom texturavvikelser, pixligheter eller onaturlig belysning. Studien avslöjar dock också en nackdel: om förklaringarna upprepade gånger betonar funktioner som inte är viktiga för en ny typ av attack — till exempel tryckliknande texturer när den nya attacken använder 3D‑masker — kan modellen ärva denna bias och fela, vilket visar att "undervisningsmanuset" kan vilseleda lika mycket som det kan hjälpa.

Begränsningar i att mäta förklaringar

Författarna noterar att de främst bedömer förklaringskvalitet i termer av huruvida texten antyder korrekt levande‑ eller spoof‑etikett, genom att använda en annan språkmodell för att läsa och tolka de genererade förklaringarna. Detta tar inte fullt ut itu med huruvida resonemanget är troget det visionära systemet faktiskt såg, eller huruvida det verkligen är användbart för mänskliga operatörer som övervakar säkerhetssystem. De framhåller också att användningen av kraftfulla språkmodeller för att skapa och tolka förklaringar kan introducera subtila bias — till exempel en överbetoning av frekvent nämnda visuella mönster — som kan påverka rättvisa eller prestanda över olika demografiska grupper och inspelningsförhållanden.

Vad detta betyder för säkrare ansiktsigenkänning

I vardagliga termer visar arbetet att få ett AI‑system att "säga varför" under träning kan förändra hur det lär sig att upptäcka falska ansikten — och ofta förbättra dess förmåga att hantera nya, osedda attacker — utan att göra modellen större eller mer komplex. Samtidigt spelar typen av resonemang vi lär ut roll: strukturerade förklaringar kan fungera som en styrspak, men om de pekar mot felaktiga ledtrådar kan modellen spåra ur när attacker förändras. Studien föreslår att se förklaringar inte bara som användarvänliga tillägg, utan som kraftfulla rattar som ingenjörer kan fininställa för att väga robusthet, tolkbarhet och bias i framtida säkerhetssystem.

Citering: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Nyckelord: ansiktsanti‑spoofing, förklarbar AI, vision‑språk‑modeller, biometrisk säkerhet, presentationsattacker