Clear Sky Science · de

Analyse der Wirkung von begründungsbasierter Supervision auf Face Anti-Spoofing

Warum gefälschte Gesichter für die alltägliche Sicherheit wichtig sind

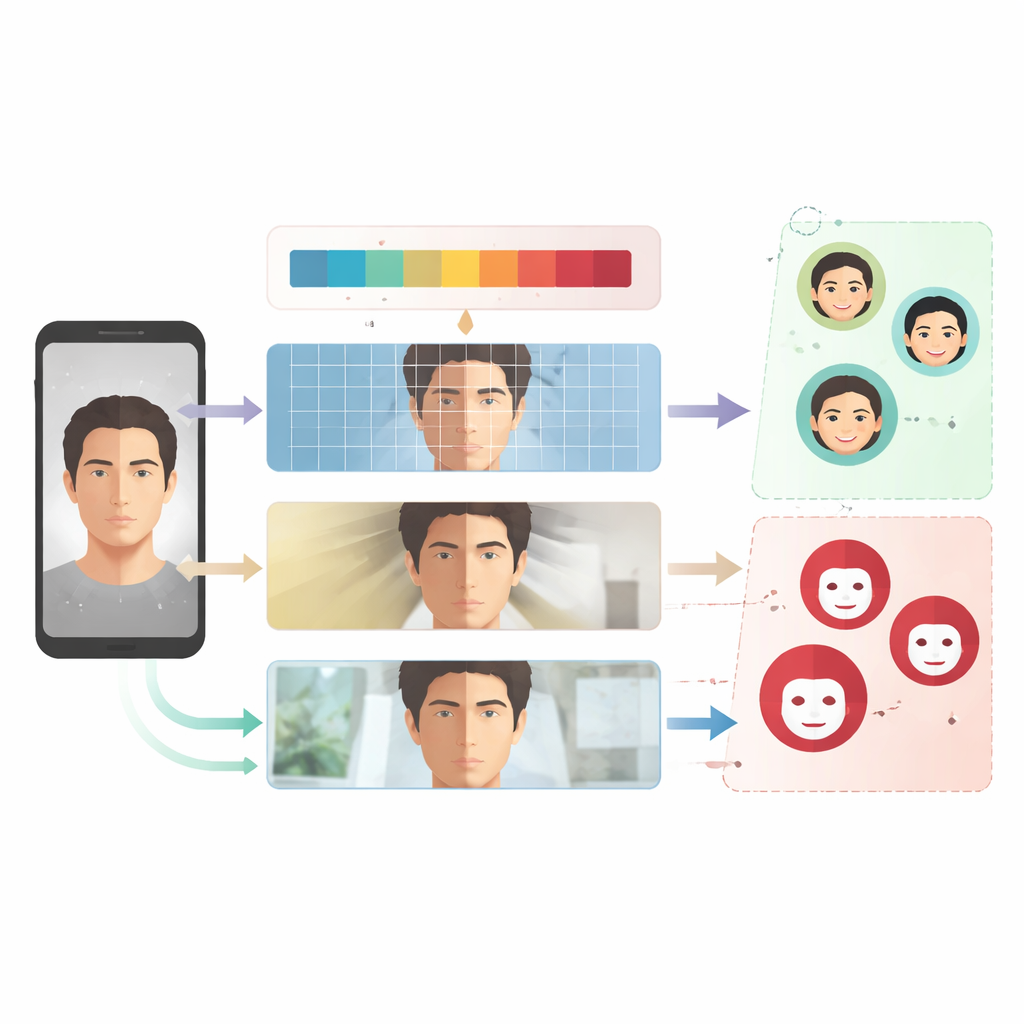

Gesichtserkennung entsperrt Telefone, öffnet Bürotüren und schützt sensible Daten. Diese Systeme lassen sich jedoch mit einfachen Tricks täuschen, etwa durch das Halten eines ausgedruckten Fotos, das Abspielen eines Videos auf einem Tablet oder das Tragen einer realistisch wirkenden Maske. Diese Studie untersucht einen neuen Ansatz, um solche Systeme schwerer zu überlisten und gleichzeitig für Menschen verständlicher zu machen, indem man sie dazu bringt, während des Lernens ihre Entscheidungen in klarer Sprache zu „erklären“.

Gesichtsprüfungen in erklärbare Geschichten verwandeln

Die meisten aktuellen Anti‑Spoofing‑Werkzeuge verhalten sich wie Black Boxes: Sie liefern „echt“ oder „gefälscht“, geben aber kaum Hinweise auf die Gründe. Die Autorinnen und Autoren setzen stattdessen auf ein Vision‑Language‑Modell, eine KI, die sowohl Bilder analysieren als auch Text generieren kann. Während des Trainings entscheidet das Modell nicht nur, ob ein Gesicht live oder gefälscht ist, sondern erzeugt auch eine kurze Erklärung, die die visuellen Hinweise beschreibt, die es verwendet hat — etwa ungewöhnliche Texturen, flache Beleuchtung oder unnatürliche Reflexionen. Diese Erklärungen sind nicht bloß Beiwerk; sie werden Teil des Lehrsignals, das bestimmt, worauf das Modell achtet.

Ein Benchmark, das seine Gedanken laut ausspricht, aufbauen

Um diese Idee kontrolliert zu untersuchen, ergänzt das Team vier weit verbreitete Face‑Anti‑Spoofing‑Datensätze — die gängige Angriffe wie gedruckte Fotos und wiedergegebene Videos abdecken — um detaillierte Textbeschreibungen. Mit GPT‑4o generieren sie für jedes Bild zwei Arten von Bildunterschriften. „Vanilla“-Beschriftungen bieten eine kurze, allgemeine Begründung, während „reasoning‑style“-Beschriftungen sechs klare Schritte durchgehen: erster Blick, Artefakterkennung, Merkmalsanalyse, Beleuchtung und Schatten, Kontext und abschließendes Urteil. Indem sie die Bilddaten und das zugrundeliegende neuronale Netz konstant halten und nur den Stil dieser Beschriftungen ändern, können die Forschenden isolieren, wie die Struktur der Erklärungen das letztliche Lernen des Modells beeinflusst.

Wie Lehren mit Gründen das Modell verändert

Das Training wird nun zu einer Doppelaufgabe. Ein Verlustterm belohnt korrekte Live-/Spoof‑Entscheidungen, ein anderer belohnt die genaue Generierung von Erklärungen, wobei die Klassifikation als primäres Ziel behandelt wird. Die Autorinnen und Autoren verwenden außerdem eine leichte Feinabstimmungsmethode, sodass nur kleine Adapter‑Layer und Ausgabeköpfe aktualisiert werden, während der große vortrainierte Backbone weitgehend unverändert bleibt. Sie vergleichen Modelle, die nur mit Vanilla‑Beschriftungen trainiert wurden, mit Modellen, die mit einer Mischung aus Vanilla‑ und Reasoning‑Beschriftungen trainiert wurden, über mehrere anspruchsvolle Protokolle „auf einigen Datensätzen trainieren, auf einem anderen testen“. Dieses Setup ahmt reale Bedingungen nach, bei denen künftige Angriffe nicht genau wie frühere aussehen.

Wann Erklärungen helfen — und wann sie schaden

In vielen Tests, insbesondere bei den standardmäßigen MCIO‑Leave‑One‑Out‑Protokollen, finden Modelle, die Reasoning‑Style‑Beschriftungen ausgesetzt waren, Spoofs genauer und machen weniger Fehler auf unbekannten Datensätzen. In einigen Fällen übertreffen sie sogar spezialisierte State‑of‑the‑Art‑Abwehrmechanismen, die auf Cross‑Dataset‑Robustheit ausgelegt sind. Die reasoning‑geleiteten Modelle scheinen beständiger auf Spoof‑spezifische Hinweise wie Texturunregelmäßigkeiten, Pixelierung oder unnatürliche Beleuchtung zu fokussieren. Die Studie deckt jedoch auch einen Nachteil auf: Wenn die Erklärungen wiederholt Merkmale betonen, die bei einer neuen Angriffsart unwichtig sind — etwa druckähnliche Texturen, während der neue Angriff 3D‑Masken verwendet — kann das Modell diese Verzerrung übernehmen und scheitern. Das zeigt, dass das „Lehrskript“ ebenso irreführend wie hilfreich sein kann.

Grenzen der Messung von Erklärungen

Die Autorinnen und Autoren weisen darauf hin, dass sie die Qualität der Erklärungen hauptsächlich danach beurteilen, ob der Text das korrekte Live‑ oder Spoof‑Label impliziert, wobei ein weiteres Sprachmodell die generierten Erklärungen liest und interpretiert. Das beantwortet nicht vollständig, ob die Begründung treu dem ist, was das Visionsystem tatsächlich gesehen hat, oder ob sie für menschliche Bediener von Sicherheitssystemen wirklich hilfreich ist. Sie heben außerdem hervor, dass die Nutzung leistungsfähiger Sprachmodelle zur Erstellung und Interpretation von Erklärungen subtile Verzerrungen einführen kann — zum Beispiel die Überbetonung häufig genannter visueller Muster —, die Fairness oder Leistung über verschiedene demografische Gruppen und Aufnahmebedingungen hinweg beeinflussen könnten.

Was das für sicherere Gesichtserkennung bedeutet

Alltäglich gesprochen zeigt diese Arbeit, dass das Veranlassen eines KI‑Systems, während des Trainings „zu sagen, warum“, ändern kann, wie es lernt, gefälschte Gesichter zu erkennen — und oft seine Fähigkeit verbessert, mit neuen, ungesehenen Angriffen umzugehen — ohne das Modell größer oder komplexer zu machen. Gleichzeitig zählt, welche Art von Begründung wir lehren: Strukturierte Erklärungen können wie ein Steuerungsrad wirken, aber wenn sie auf die falschen Hinweise zeigen, kann das Modell bei wechselnden Angriffen vom Kurs abkommen. Die Studie schlägt vor, Erklärungen nicht nur als benutzerfreundliche Zusätze zu sehen, sondern als mächtige Einstellschrauben, die Ingenieurinnen und Ingenieure nutzen können, um Robustheit, Interpretierbarkeit und Verzerrung in zukünftigen Sicherheitssystemen auszutarieren.

Zitation: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Schlüsselwörter: Face Anti-Spoofing, erklärbare KI, Vision‑Language‑Modelle, biometrische Sicherheit, Präsentationsangriffe