Clear Sky Science · ar

تحليل تأثير الإشراف القائم على الاستدلال على كشف التزييف في الوجوه

لماذا تهم الوجوه المزيفة لأمننا اليومي

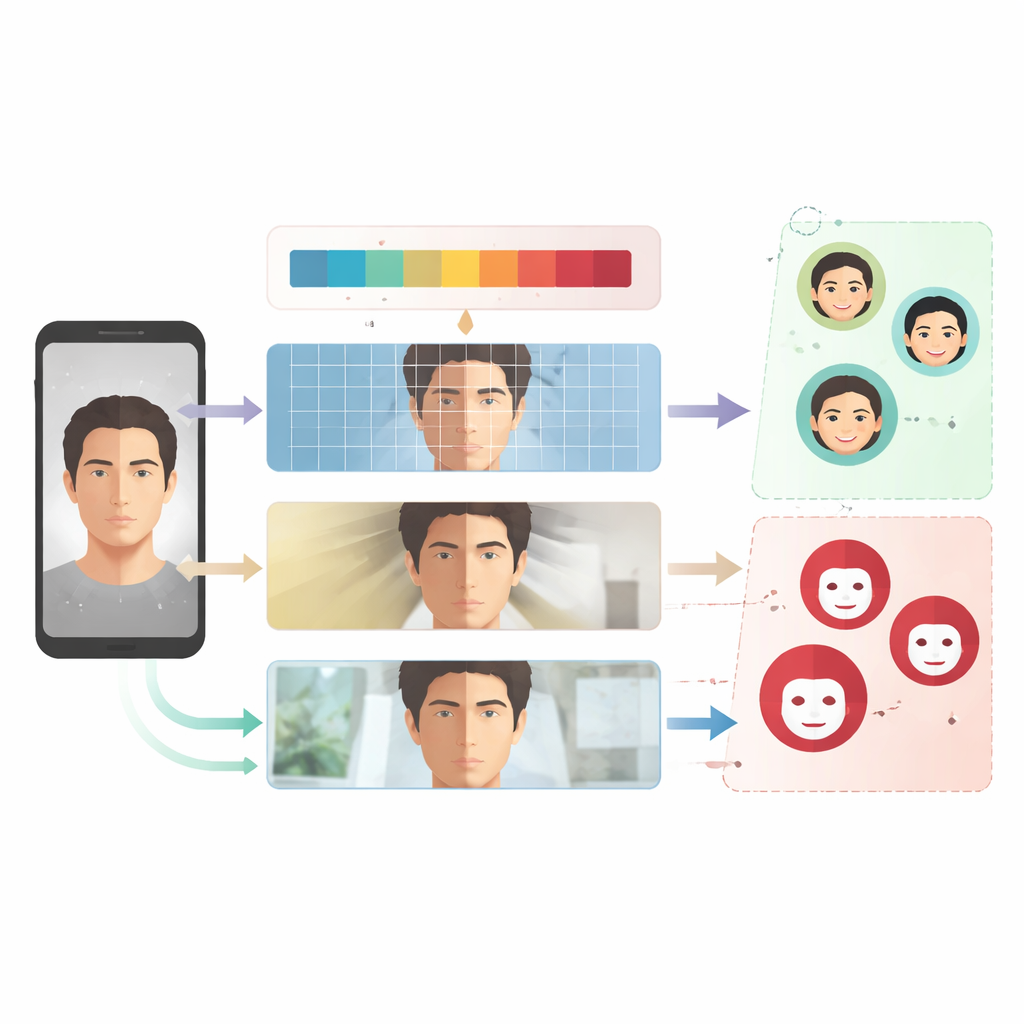

تُستخدم أنظمة التعرف على الوجه لفتح الهواتف، وفتح أبواب المكاتب، وحماية البيانات الحساسة. لكن هذه الأنظمة يمكن خداعها بحيل بسيطة، مثل إظهار صورة مطبوعة، أو عرض فيديو على جهاز لوحي، أو ارتداء قناع واقعي. تبحث هذه الدراسة في نهج جديد يجعل هذه الأنظمة أصعب خداعاً وأسهل للفهم من قبل البشر عبر تعليمها «شرح» قراراتها بلغة واضحة أثناء تعلمها التمييز بين الوجوه الحقيقية والمزيفة.

تحويل فحوصات الوجه إلى روايات قابلة للتفسير

تعمل معظم أدوات مكافحة التزييف الحالية كصناديق سوداء: تُصدر نتيجة «حقيقي» أو «مزيف» لكنها لا تشرح السبب. يبني المؤلفون بدلاً من ذلك على نموذج رؤية–لغة، وهو نوع من الذكاء الاصطناعي يمكنه النظر إلى الصور وتوليد نص. أثناء التدريب، لا يكتفي النموذج بتحديد ما إذا كانت الوجه حيّاً أم مزيفاً، بل ينتج أيضاً تفسيراً قصيراً يصف الدلائل البصرية التي اعتمد عليها، مثل قوام غريب، أو إضاءة مسطحة، أو انعكاسات غير طبيعية. هذه التفسيرات ليست للعرض فقط؛ بل تصبح جزءاً من إشارة التدريب التي توجه ما يركز عليه النموذج.

بناء معيار مرجعي يفكر بصوت عالٍ

لدراسة هذه الفكرة بطريقة مسيطرة، يوسع الفريق أربعة مجموعات بيانات شائعة لكشف تزييف الوجوه — تغطي هجمات معتادة مثل الصور المطبوعة والفيديوهات المعاد تشغيلها — بوصف نصي مفصّل. باستخدام GPT-4o، يولّدون نوعين من التسميات لكل صورة. تسميات «ساذجة» تقدم مبرراً قصيراً عاماً، بينما تسميات «أسلوب الاستدلال» تتبع ست خطوات واضحة: النظرة الأولى، كشف الشوائب، تحليل الميزات، الإضاءة والظلال، السياق، والحكم النهائي. عبر إبقاء بيانات الصور والهيكل العصبي تحتها ثابتين وتغيير أسلوب هذه التسميات فقط، يمكن للباحثين عزل كيف يؤثر بنية التفسير على ما يتعلمه النموذج في النهاية.

كيف يغيّر التعليم المدعوم بالأسباب النموذج

يصبح تدريب النظام الآن مهمة مزدوجة. أحد مكونات الخسارة يكافئ القرارات الصحيحة بشأن حيّ/مزيف، وآخر يكافئ توليد تفسيرات دقيقة، مع اعتبار التصنيف الهدف الأساسي. كما يستخدم المؤلفون طريقة ضبط دقيقة خفيفة بحيث يتم تحديث طبقات محول صغيرة ورؤوس المخرجات فقط، مع ترك العمود الفقري المدرب مسبقاً إلى حد كبير دون تغيير. يقارنون نماذج تم تدريبها بتسميات ساذجة فقط بنماذج تم تدريبها بمزيج من التسميات الساذجة وتسميات الاستدلال عبر عدة بروتوكولات تحدي «التدريب على بعض المجموعات، الاختبار على مجموعة مختلفة». يحاكي هذا الإعداد ظروف العالم الحقيقي، حيث قد لا تشبه الهجمات المستقبلية الهجمات السابقة تماماً.

متى تساعد التفسيرات — ومتى تضر

عبر العديد من الاختبارات، وبالأخص في بروتوكولات MCIO القياسية التي تستبعد مجموعة واحدة، تكشف النماذج المعرضة لتسميات أسلوب الاستدلال عن مزيد من الدقة في اكتشاف التزييف وتقلل الأخطاء على مجموعات بيانات غير مألوفة. في بعض الحالات، تتفوق حتى على دفاعات متخصصة متقدمة مصممة للتماسك عبر المجموعات. تبدو النماذج الموجهة بالاستدلال مركزة بشكل أكثر اتساقاً على دلائل خاصة بالتزييف مثل عدم انتظام القوام، أو التشويش في البكسلات، أو الإضاءة غير الطبيعية. مع ذلك، تكشف الدراسة عن جانب سلبي: إذا كررت التفسيرات التأكيد على ميزات ليست مهمة في نوع هجوم جديد — مثلاً قوام يشبه الطباعة بينما يستخدم الهجوم الجديد أقنعة ثلاثية الأبعاد — فقد يرث النموذج هذا التحيز ويتعثر، مما يبيّن أن «نص التعليم» يمكن أن يضلّل بقدر ما يمكن أن يساعد.

حدود قياس التفسيرات

يلاحظ المؤلفون أنهم يقيمون جودة التفسير أساساً من حيث ما إذا كان النص يعني التصنيف الصحيح حيّ/مزيف، مستخدمين نموذج لغة آخر لقراءة وتفسير التفسيرات المولدة. هذا لا يعالج بالكامل ما إذا كان الاستدلال أميناً لما رآه نظام الرؤية فعلاً، أو ما إذا كان مفيداً فعلاً للمشغلين البشريين الذين يراقبون أنظمة الأمان. كما يسلطون الضوء على أن استخدام نماذج لغة قوية لإنشاء وتفسير التفسيرات قد يدخل تحيّزات دقيقة — على سبيل المثال، المبالغة في التركيز على أنماط بصرية مذكورة كثيراً — قد تؤثر على الإنصاف أو الأداء عبر مجموعات سكانية وظروف تسجيل مختلفة.

ماذا يعني ذلك لجعل التعرف على الوجوه أكثر أماناً

بمصطلحات يومية، تُظهر هذه الدراسة أن جعل نظام الذكاء الاصطناعي «يشرح السبب» أثناء التدريب يمكن أن يغير ما يتعلمه عن اكتشاف الوجوه المزيفة — وغالباً ما يحسّن قدرته على التعامل مع هجمات جديدة غير مرئية سابقاً — دون زيادة حجم النموذج أو تعقيده. وفي الوقت نفسه، نوع الاستدلال الذي نعلّمه مهم: التفسيرات المهيكلة يمكن أن تعمل كعجلة قيادة، ولكن إذا أشارت إلى دلائل خاطئة، قد ينحرف النموذج عندما تتغير الهجمات. تقترح الدراسة اعتبار التفسيرات ليس فقط كإضافات صديقة للمستخدم، بل كأقراص تحكم قوية يمكن للمهندسين ضبطها للموازنة بين المتانة، وقابلية التفسير، والتحيّز في أنظمة الأمان المستقبلية.

الاستشهاد: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

الكلمات المفتاحية: كشف تزييف الوجوه, الذكاء الاصطناعي القابل للتفسير, نماذج الرؤية واللغة, أمن القياسات الحيوية, هجمات العرض التقديمي