Clear Sky Science · tr

Muhakemeye dayalı denetimin yüz sahtekarlığına etkisini analiz etmek

Sahte yüzler günlük güvenlik için neden önemli?

Yüz tanıma telefonları açar, ofis kapılarını açar ve hassas verileri korur. Ancak bu sistemler basit hilelerle kandırılabilir: basılı bir fotoğraf göstermek, bir tablette video oynatmak veya gerçekçi bir maske takmak gibi. Bu çalışma, bu tür sistemleri kandırmayı zorlaştırmanın ve insanlara daha anlaşılır hale getirmenin yeni bir yolunu inceliyor: sahte yüzleri tespit etmeyi öğrenirken kararlarını düz metinle “açıklamayı” öğretmek.

Yüz kontrollerini açıklanabilir öykülere dönüştürmek

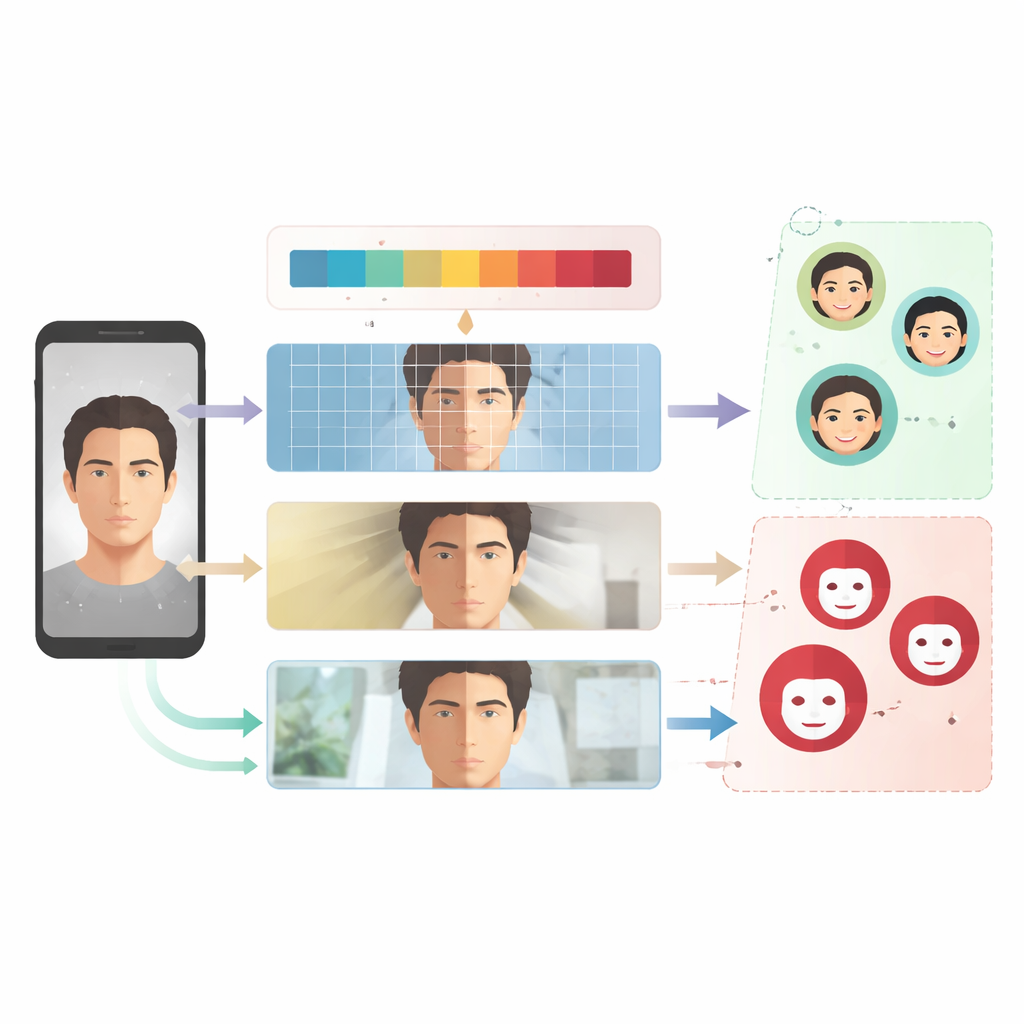

Mevcut çoğu sahtekarlık önleme aracı kara kutu gibi davranır: “gerçek” veya “sahte” sonucunu verir ama nedenini pek göstermez. Yazarlar bunun yerine görsellere bakıp metin üretebilen bir görsel–dil modeline dayanıyor. Eğitim sırasında model yalnızca yüzün canlı mı yoksa sahte mi olduğuna karar vermiyor; aynı zamanda kullandığı görsel ipuçlarını tarif eden kısa bir açıklama da üretiyor—örneğin tuhaf doku, düz aydınlatma veya doğal görünmeyen yansımalar gibi. Bu açıklamalar sadece gösteriş amaçlı değil; modelin nelere dikkat ettiğini şekillendiren öğretici sinyalin bir parçası oluyor.

Sesli düşünen bir kıyas tabanı oluşturmak

Bu fikri kontrollü şekilde incelemek için ekip, dört yaygın yüz sahtekarlığı veri setini—basılı fotoğraflar ve oynatılan videolar gibi yaygın saldırıları kapsayan—ayrıntılı metin açıklamalarla zenginleştiriyor. GPT-4o kullanarak her görüntü için iki tür başlık üretiyorlar. “Vanilya” başlıklar kısa, genel bir gerekçe sunarken, “muhakeme tarzı” başlıklar altı açık adımda ilerliyor: ilk bakış, artefakt tespiti, özellik analizi, aydınlatma ve gölgeler, bağlam ve son yargı. Görüntü verisini ve altta yatan sinir ağı sabit tutup yalnızca bu başlıkların üslubunu değiştirerek araştırmacılar açıklama yapısının modelin nihayetinde ne öğrendiğini nasıl etkilediğini izole edebiliyorlar.

Nedenlerle öğretmenin modeli nasıl değiştirdiği

Sistemin eğitimi artık çift görevli hale geliyor. Bir kayıp terimi doğru canlı/sahte kararları ödüllendirirken, diğeri doğru açıklama üretimini ödüllendiriyor; sınıflandırma ana hedef olarak ele alınıyor. Yazarlar ayrıca yalnızca küçük adaptör katmanları ve çıktı başlıklarının güncellendiği hafif bir ince ayar yöntemi kullanıyor; böylece büyük önceden eğitilmiş omurga büyük ölçüde dokunulmadan kalıyor. Sadece vanilya başlıklarla eğitilmiş modelleri ve vanilya ile muhakeme başlıklarının karışımıyla eğitilmiş modelleri, birkaç zor “bazı veri setlerinde eğit, farklı birinde test et” protokolü boyunca karşılaştırıyorlar. Bu düzenek, gelecekteki saldırıların geçmiştekilerle tam olarak aynı görünmeyebileceği gerçek dünya koşullarını taklit ediyor.

Açıklamalar ne zaman yardımcı olur—ve ne zaman zarar verir

Çok sayıda testte, özellikle standart MCIO leave-one-out protokollerinde, muhakeme tarzı başlıklara maruz kalan modeller sahtekarlıkları daha doğru tespit ediyor ve tanımadıkları veri setlerinde daha az hata yapıyor. Bazı durumlarda, bu modeller çapraz veri seti dayanıklılığı için tasarlanmış uzmanlaşmış son teknoloji savunmaları bile geride bırakıyor. Muhakeme yönlendirmeli modeller, doku düzensizlikleri, pikselleşme veya doğal olmayan aydınlatma gibi sahtekarlığa özgü ipuçlarına daha tutarlı şekilde odaklanıyor gibi görünüyor. Ancak çalışma bir dezavantajı da ortaya koyuyor: açıklamalar yeni bir saldırı türü için önemli olmayan özellikleri sürekli vurguluyorsa—örneğin yeni saldırı 3B maskeler kullanıyorsa baskı benzeri dokuları vurgulamak—model bu önyargıyı edinip hata yapabiliyor; yani “öğretici senaryo” hem yol gösterici hem de yanıltıcı olabiliyor.

Açıklamaları ölçmenin sınırları

Yazarlar açıklama kalitesini esasen üretilen metnin doğru canlı veya sahte etiketini ima edip etmediği açısından değerlendirdiklerini; bunun için başka bir dil modelini açıklamaları okumak ve yorumlamak üzere kullandıklarını belirtiyor. Bu, muhakemenin görsel sistemin gerçekte gördüğüne ne kadar sadık olduğu ya da güvenlik sistemlerini izleyen insan operatörler için gerçekten ne kadar yararlı olduğu sorusunu tam olarak çözmüyor. Ayrıca açıklamaları oluşturmak ve yorumlamak için güçlü dil modelleri kullanmanın, örneğin sıkça belirtilen görsel desenleri fazla vurgulama gibi, farklı demografik gruplar ve kayıt koşulları üzerinde adalet veya performansı etkileyebilecek ince önyargılar getirebileceğini vurguluyorlar.

Daha güvenli yüz tanıma için bunun anlamı

Günlük ifadeyle, bu çalışma bir yapay zekâ sistemine eğitim sırasında “neden” diye söylemeyi öğretmenin, sahte yüzleri nasıl öğrendiğini değiştirebileceğini—ve genellikle yeni, görülmemiş saldırılarla başa çıkma yeteneğini artırabileceğini—gösteriyor; üstelik modeli daha büyük veya daha karmaşık hale getirmeden. Aynı zamanda öğrettiğimiz muhakemenin türü önemli: yapılandırılmış açıklamalar bir direksiyon gibi davranabilir, ama yanlış ipuçlarına yönlendirirse saldırılar değiştiğinde model rotadan çıkabilir. Çalışma, açıklamaları yalnızca kullanıcı dostu eklentiler olarak görmek yerine, mühendislerin gelecekteki güvenlik sistemlerinde dayanıklılık, yorumlanabilirlik ve önyargı arasında denge kurmak için ayarlayabileceği güçlü düğmeler olarak görmeyi öneriyor.

Atıf: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Anahtar kelimeler: yüz sahtekarlığı önleme, açıklanabilir yapay zekâ, görsel-dil modelleri, biyometrik güvenlik, sunum saldırıları