Clear Sky Science · pt

Analisando o efeito da supervisão baseada em raciocínio na detecção de falsificação de faces

Por que rostos falsos importam para a segurança do dia a dia

O reconhecimento facial desbloqueia celulares, abre portas de escritório e protege dados sensíveis. Mas esses sistemas podem ser enganados por truques simples, como exibir uma foto impressa, reproduzir um vídeo em um tablet ou usar uma máscara realista. Este estudo investiga uma nova forma de tornar esses sistemas mais difíceis de enganar e mais fáceis de entender por humanos, ensinando-os a “explicar” suas decisões em linguagem acessível enquanto aprendem a identificar rostos falsos.

Transformando verificações faciais em narrativas explicáveis

A maioria das ferramentas anti-fraude atuais funciona como caixas-pretas: elas retornam “real” ou “falso”, mas dão poucas pistas sobre o porquê. Os autores, em vez disso, constroem sobre um modelo visão–linguagem, um tipo de IA capaz de analisar imagens e gerar texto. Durante o treinamento, o modelo não só decide se um rosto é legítimo ou falsificado, mas também produz uma explicação curta descrevendo os indícios visuais usados — como texturas estranhas, iluminação plana ou reflexos que parecem artificiais. Essas explicações não servem apenas como enfeite; elas passam a fazer parte do sinal de ensino que orienta onde o modelo deve focar a atenção.

Construindo um benchmark que pensa em voz alta

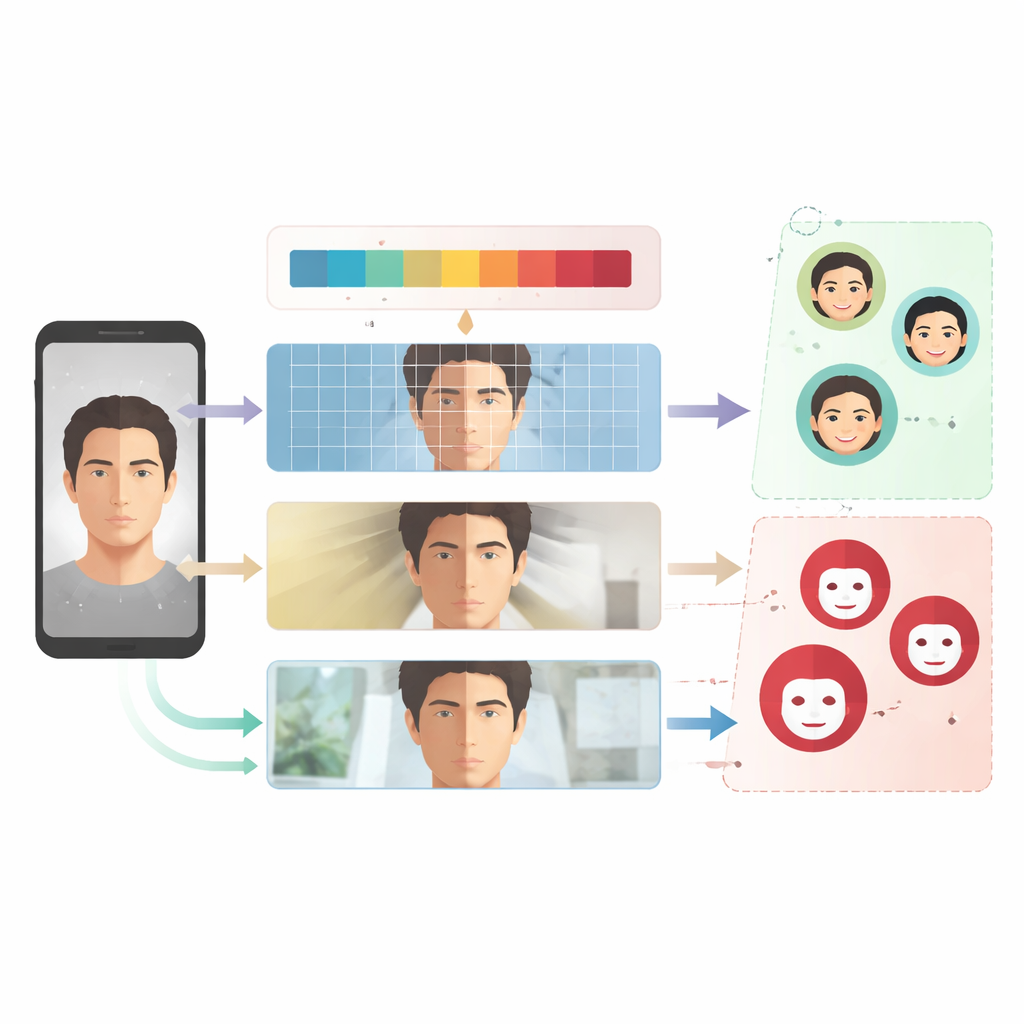

Para estudar a ideia de forma controlada, a equipe enriquece quatro conjuntos de dados amplamente usados em detecção de falsificação de faces — cobrindo ataques comuns como fotos impressas e vídeos reproduzidos — com descrições textuais detalhadas. Usando o GPT-4o, eles geram dois tipos de legendas para cada imagem. Legendas “vanilla” oferecem uma justificativa curta e geral, enquanto legendas em estilo “raciocínio” percorrem seis passos claros: observação inicial, detecção de artefatos, análise de características, iluminação e sombras, contexto e julgamento final. Mantendo os dados de imagem e a rede neural subjacente fixos e alterando apenas o estilo dessas legendas, os pesquisadores isolam como a estrutura da explicação afeta o que o modelo aprende.

Como ensinar com razões muda o modelo

O treinamento do sistema passa a ser uma tarefa dupla. Um termo de perda recompensa decisões corretas vivo/falso, e outro recompensa a geração precisa das explicações, com a classificação tratada como objetivo principal. Os autores também utilizam um método de fine-tuning leve para que apenas pequenas camadas adaptadoras e cabeças de saída sejam atualizadas, mantendo a espinha dorsal pré-treinada praticamente intacta. Eles comparam modelos treinados apenas com legendas vanilla com modelos treinados com uma mistura de legendas vanilla e de raciocínio em diversos protocolos desafiadores de “treine em alguns conjuntos, teste em outro”. Essa configuração imita condições do mundo real, em que ataques futuros podem não se parecer exatamente com os anteriores.

Quando explicações ajudam — e quando atrapalham

Em muitos testes, especialmente nos protocolos padrão MCIO leave-one-out, modelos expostos a legendas em estilo raciocínio detectam falsificações com maior precisão e cometem menos erros em bases de dados desconhecidas. Em alguns casos, chegam a superar defesas especializadas de última geração projetadas para robustez entre conjuntos de dados. Os modelos orientados por raciocínio parecem focar de forma mais consistente em indícios específicos de falsificação, como irregularidades de textura, pixelização ou iluminação não natural. No entanto, o estudo também revela uma desvantagem: se as explicações enfatizam repetidamente características que não são relevantes para um novo tipo de ataque — por exemplo, texturas semelhantes a impressões quando o ataque novo usa máscaras 3D — o modelo pode herdar esse viés e falhar, mostrando que o “roteiro de ensino” pode tanto ajudar quanto induzir ao erro.

Limites de medir explicações

Os autores observam que avaliam a qualidade das explicações principalmente no sentido de a escrita implicar o rótulo correto vivo ou falso, usando outro modelo de linguagem para ler e interpretar as explicações geradas. Isso não resolve plenamente se o raciocínio é fiel ao que o sistema visual realmente observou, nem se é verdadeiramente útil para operadores humanos que monitoram sistemas de segurança. Eles também destacam que usar modelos de linguagem poderosos para criar e interpretar explicações pode introduzir vieses sutis — por exemplo, superenfatizar padrões visuais mencionados com frequência — que podem afetar justiça ou desempenho em diferentes grupos demográficos e condições de gravação.

O que isso significa para um reconhecimento facial mais seguro

Em termos práticos, este trabalho mostra que fazer um sistema de IA “dizer por que” durante o treinamento pode mudar a forma como ele aprende a identificar rostos falsos — e frequentemente melhora sua capacidade de lidar com ataques novos e desconhecidos — sem tornar o modelo maior ou mais complexo. Ao mesmo tempo, o tipo de raciocínio que ensinamos importa: explicações estruturadas podem funcionar como um volante, mas se apontarem para pistas erradas, o modelo pode desviar quando os ataques mudarem. O estudo propõe ver as explicações não apenas como recursos amigáveis ao usuário, mas como botões poderosos que engenheiros podem ajustar para equilibrar robustez, interpretabilidade e viés em futuros sistemas de segurança.

Citação: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Palavras-chave: detecção de falsificação de faces, IA explicável, modelos visao-linguagem, segurança biométrica, ataques de apresentação