Clear Sky Science · fr

Analyse de l'effet de la supervision fondée sur le raisonnement sur la détection anti-usurpation faciale

Pourquoi les faux visages comptent pour la sécurité quotidienne

La reconnaissance faciale déverrouille les téléphones, ouvre les portes des bureaux et protège des données sensibles. Mais ces systèmes peuvent être trompés par des astuces simples, comme présenter une photo imprimée, diffuser une vidéo sur une tablette ou porter un masque réaliste. Cette étude examine une nouvelle façon de rendre ces systèmes à la fois plus difficiles à berner et plus compréhensibles par les humains en leur apprenant à « expliquer » leurs décisions en langage courant pendant qu’ils apprennent à détecter les visages falsifiés.

Transformer les contrôles faciaux en récits explicables

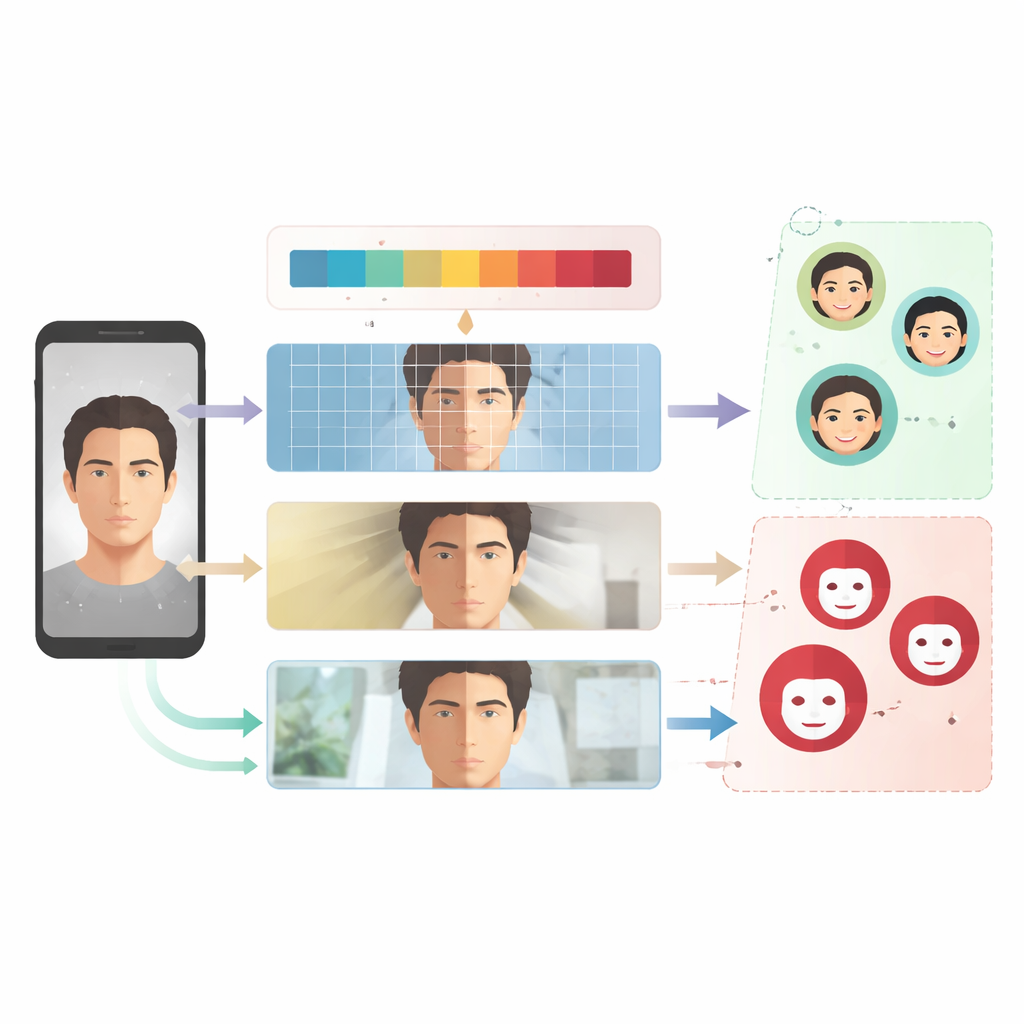

La plupart des outils anti-usurpation actuels fonctionnent comme des boîtes noires : ils donnent « réel » ou « faux » sans dire pourquoi. Les auteurs s’appuient au contraire sur un modèle vision–langage, un type d’IA capable à la fois d’analyser des images et de générer du texte. Pendant l’entraînement, le modèle ne se contente pas de décider si un visage est réel ou usurpé : il produit aussi une courte explication décrivant les indices visuels utilisés, comme des textures étranges, un éclairage plat ou des réflexions peu naturelles. Ces explications ne sont pas purement cosmétiques ; elles deviennent une partie du signal d’apprentissage qui oriente l’attention du modèle.

Construire un benchmark qui pense à voix haute

Pour étudier l’idée de manière contrôlée, l’équipe enrichit quatre jeux de données largement utilisés pour l’anti-usurpation faciale — couvrant des attaques courantes comme les photos imprimées et les vidéos rejouées — avec des descriptions textuelles détaillées. À l’aide de GPT-4o, ils génèrent deux types de légendes pour chaque image. Les légendes « classiques » offrent une justification courte et générale, tandis que les légendes « de style raisonnement » détaillent six étapes claires : première impression, détection d’artéfacts, analyse des caractéristiques, éclairage et ombres, contexte, et jugement final. En maintenant fixes les données d’image et l’architecture du réseau neuronal sous-jacent et en ne changeant que le style de ces légendes, les chercheurs peuvent isoler l’impact de la structure des explications sur ce que le modèle apprend finalement.

Comment l’enseignement par les raisons modifie le modèle

L’entraînement devient désormais une tâche duale. Un terme de perte récompense les décisions correctes vivant/usurpé, et un autre récompense la génération d’explications précises, la classification restant l’objectif principal. Les auteurs utilisent aussi une méthode de fine-tuning légère de sorte que seules de petites couches adaptatrices et des têtes de sortie sont mises à jour, laissant la grande colonne vertébrale pré-entraînée en grande partie intacte. Ils comparent des modèles entraînés uniquement avec des légendes classiques à des modèles entraînés avec un mélange de légendes classiques et de légendes « raisonnement » selon plusieurs protocoles exigeants de type « entraîner sur certains jeux, tester sur un autre ». Ce dispositif imite des conditions réelles, où des attaques futures peuvent ne pas ressembler exactement à celles du passé.

Quand les explications aident — et quand elles nuisent

Dans de nombreux tests, en particulier les protocoles standard MCIO leave-one-out, les modèles exposés à des légendes de type raisonnement détectent les usurpations plus précisément et commettent moins d’erreurs sur des jeux de données inédits. Dans certains cas, ils surpassent même des défenses spécialisées à la pointe conçues pour la robustesse inter-jeux. Les modèles guidés par le raisonnement semblent se concentrer plus systématiquement sur des indices spécifiques aux usurpations tels que des irrégularités de texture, une pixellisation ou un éclairage anormal. Cependant, l’étude révèle aussi un inconvénient : si les explications insistent de façon répétée sur des caractéristiques peu pertinentes pour une nouvelle attaque — par exemple des textures d’impression alors que la nouvelle attaque utilise des masques 3D —, le modèle peut hériter de ce biais et échouer. Cela montre que le « script pédagogique » peut aussi bien induire en erreur qu’aider.

Limites de la mesure des explications

Les auteurs notent qu’ils évaluent principalement la qualité des explications en fonction de si le texte implique correctement l’étiquette vivant ou usurpé, en utilisant un autre modèle de langue pour lire et interpréter les explications générées. Cela n’aborde pas pleinement la question de savoir si le raisonnement est fidèle à ce que le système visuel a réellement perçu, ni s’il est véritablement utile aux opérateurs humains qui surveillent les systèmes de sécurité. Ils soulignent également que l’utilisation de modèles de langue puissants pour créer et interpréter des explications peut introduire des biais subtils — par exemple, la surpondération de motifs visuels fréquemment mentionnés — susceptibles d’affecter l’équité ou les performances sur différents groupes démographiques et conditions d’enregistrement.

Ce que cela signifie pour une reconnaissance faciale plus sûre

En termes concrets, ce travail montre que faire « dire pourquoi » à un système d’IA pendant l’entraînement peut modifier la façon dont il apprend à repérer les visages falsifiés — et améliore souvent sa capacité à gérer des attaques nouvelles et non vues — sans rendre le modèle plus grand ou plus complexe. En parallèle, le type de raisonnement enseigné compte : des explications structurées peuvent jouer le rôle d’un volant de direction, mais si elles pointent vers de mauvais indices, le modèle peut dévier lorsque les attaques changent. L’étude propose de considérer les explications non seulement comme des aides conviviales, mais comme des réglages puissants que les ingénieurs peuvent calibrer pour arbitrer robustesse, interprétabilité et biais dans les futurs systèmes de sécurité.

Citation: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Mots-clés: anti-usurpation faciale, IA explicable, modèles vision-texte, sécurité biométrique, attaques de présentation