Clear Sky Science · es

Analizando el efecto de la supervisión basada en razonamiento en la detección de suplantación facial

Por qué las caras falsas importan para la seguridad cotidiana

El reconocimiento facial desbloquea teléfonos, abre puertas de oficinas y protege datos sensibles. Pero estos sistemas pueden engañarse con trucos sencillos, como mostrar una foto impresa, reproducir un vídeo en una tableta o llevar una máscara realista. Este estudio examina una nueva forma de hacer que dichos sistemas sean más difíciles de engañar y más comprensibles para las personas, enseñándoles a “explicar” sus decisiones en lenguaje natural mientras aprenden a detectar caras falsas.

Convertir las comprobaciones faciales en relatos explicables

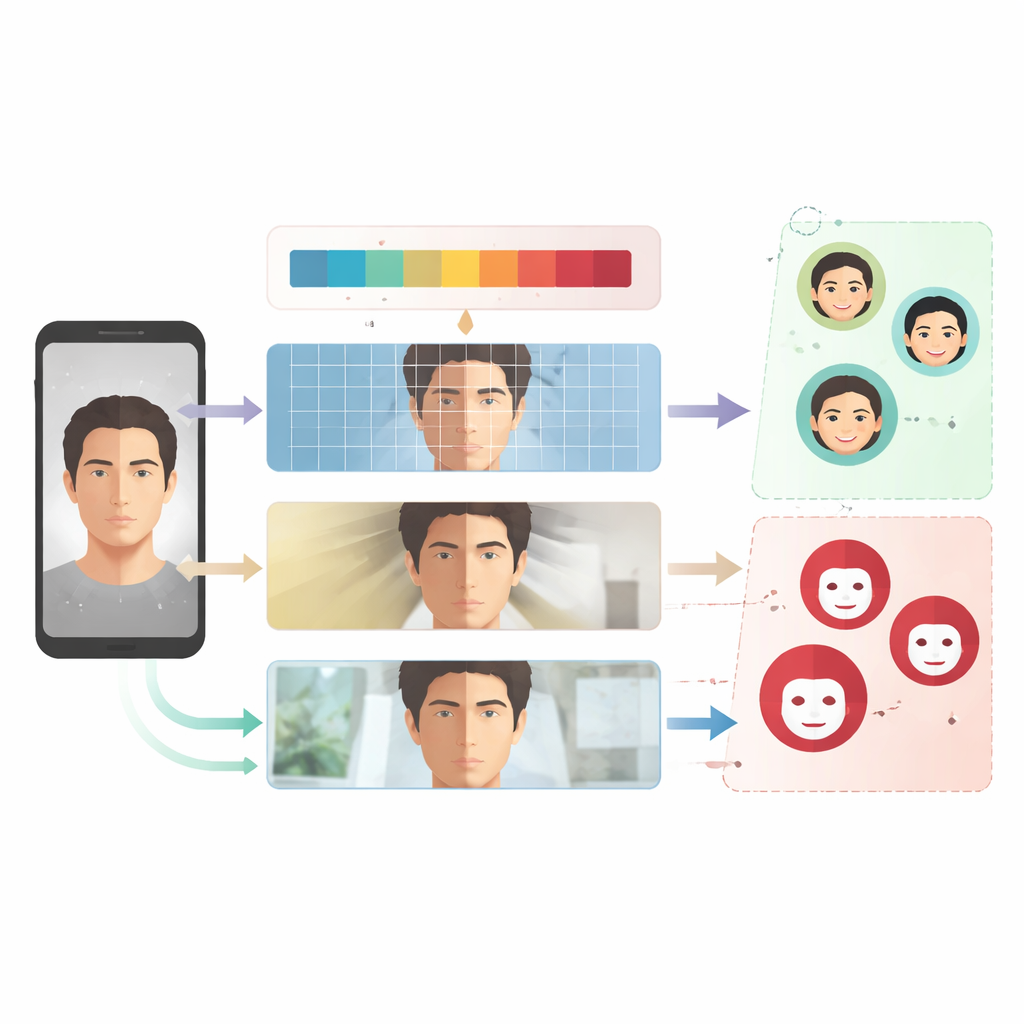

La mayoría de las herramientas actuales de anti-spoofing actúan como cajas negras: dan como salida “real” o “falsa” pero ofrecen pocas pistas sobre el porqué. Los autores, en cambio, parten de un modelo visión–lenguaje, un tipo de IA que puede tanto analizar imágenes como generar texto. Durante el entrenamiento, el modelo no solo decide si una cara es real o suplantada, sino que también produce una breve explicación que describe las pistas visuales que utilizó, como texturas extrañas, iluminación plana o reflejos poco naturales. Estas explicaciones no son solo cosméticas; pasan a formar parte de la señal de enseñanza que orienta en qué presta atención el modelo.

Construir un banco de pruebas que piense en voz alta

Para estudiar esta idea de forma controlada, el equipo enriquece cuatro conjuntos de datos de anti-spoofing facial ampliamente usados —que abarcan ataques comunes como fotos impresas y vídeos reproducidos— con descripciones textuales detalladas. Utilizando GPT-4o, generan dos tipos de subtítulos para cada imagen. Los subtítulos “vanilla” ofrecen una justificación breve y general, mientras que los subtítulos de “estilo razonamiento” recorren seis pasos claros: primera impresión, detección de artefactos, análisis de características, iluminación y sombras, contexto y juicio final. Manteniendo fijos los datos de imagen y la red neuronal subyacente y cambiando solo el estilo de estos subtítulos, los investigadores pueden aislar cómo la estructura de la explicación afecta lo que el modelo aprende finalmente.

Cómo cambia el modelo cuando se enseña con razones

El entrenamiento del sistema se convierte ahora en una tarea dual. Un término de pérdida recompensa las decisiones correctas de real/suplantado y otro recompensa la generación precisa de explicaciones, tratando la clasificación como el objetivo principal. Los autores también emplean un método de ajuste fino ligero de modo que solo se actualizan pequeñas capas adaptadoras y las cabezas de salida, dejando en gran medida intacta la columna vertebral preentrenada. Comparan modelos entrenados solo con subtítulos vanilla con modelos entrenados con una mezcla de subtítulos vanilla y de razonamiento en varios protocolos exigentes de “entrena en algunos conjuntos, prueba en otro diferente”. Esta configuración imita condiciones reales, donde futuros ataques pueden no parecerse exactamente a los pasados.

Cuándo las explicaciones ayudan—y cuándo perjudican

En muchas pruebas, especialmente en los protocolos estándar MCIO de dejar-uno-fuera, los modelos expuestos a subtítulos de estilo razonamiento detectan suplantaciones con mayor precisión y cometen menos errores en conjuntos de datos no familiares. En algunos casos, incluso superan a defensas especializadas de última generación diseñadas para robustez entre conjuntos. Los modelos guiados por razonamiento parecen centrarse de forma más consistente en pistas específicas de suplantación, como irregularidades de textura, pixelado o iluminación antinatural. Sin embargo, el estudio también descubre una desventaja: si las explicaciones enfatizan repetidamente características que no son importantes para un nuevo tipo de ataque —por ejemplo, texturas de impresión cuando el nuevo ataque usa máscaras 3D—, el modelo puede heredar ese sesgo y fallar, mostrando que el “guion docente” puede inducir a error tanto como ayudar.

Los límites de medir las explicaciones

Los autores señalan que juzgan principalmente la calidad de las explicaciones en términos de si el texto implica la etiqueta correcta de real o suplantado, usando otro modelo de lenguaje para leer e interpretar las explicaciones generadas. Esto no aborda por completo si el razonamiento es fiel a lo que el sistema de visión realmente vio, ni si resulta verdaderamente útil para los operadores humanos que supervisan los sistemas de seguridad. También subrayan que usar modelos de lenguaje potentes para crear e interpretar explicaciones puede introducir sesgos sutiles —por ejemplo, sobreenfatizar patrones visuales mencionados con frecuencia— que podrían afectar la equidad o el rendimiento en distintos grupos demográficos y condiciones de grabación.

Qué implica esto para un reconocimiento facial más seguro

En términos cotidianos, este trabajo muestra que lograr que un sistema de IA “diga por qué” durante el entrenamiento puede cambiar cómo aprende a detectar caras falsas —y a menudo mejorar su capacidad para afrontar ataques nuevos y no vistos— sin hacer el modelo más grande o complejo. Al mismo tiempo, importa el tipo de razonamiento que enseñamos: las explicaciones estructuradas pueden actuar como un volante, pero si señalan hacia pistas equivocadas, el modelo puede desviarse cuando cambien los ataques. El estudio propone ver las explicaciones no solo como complementos amigables para el usuario, sino como potentes diales que los ingenieros pueden ajustar para negociar robustez, interpretabilidad y sesgos en futuros sistemas de seguridad.

Cita: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Palabras clave: detección de suplantación facial, IA explicable, modelos visión-lenguaje, seguridad biométrica, ataques de presentación