Clear Sky Science · pl

Analiza wpływu nadzoru opartego na rozumowaniu na wykrywanie fałszywych twarzy

Dlaczego fałszywe twarze mają znaczenie dla codziennego bezpieczeństwa

Rozpoznawanie twarzy odblokowuje telefony, otwiera drzwi w biurach i chroni wrażliwe dane. Systemy te można jednak oszukać prostymi sztuczkami, takimi jak pokazanie wydrukowanego zdjęcia, odtworzenie wideo na tablecie czy użycie realistycznej maski. W tej pracy badano nowe podejście, które ma na celu uczynienie takich systemów trudniejszymi do oszukania i łatwiejszymi do zrozumienia przez ludzi — poprzez uczenie ich, aby podczas nauki potrafiły „wyjaśniać” swoje decyzje prostym językiem.

Zmiana kontroli twarzy w zrozumiałe opowieści

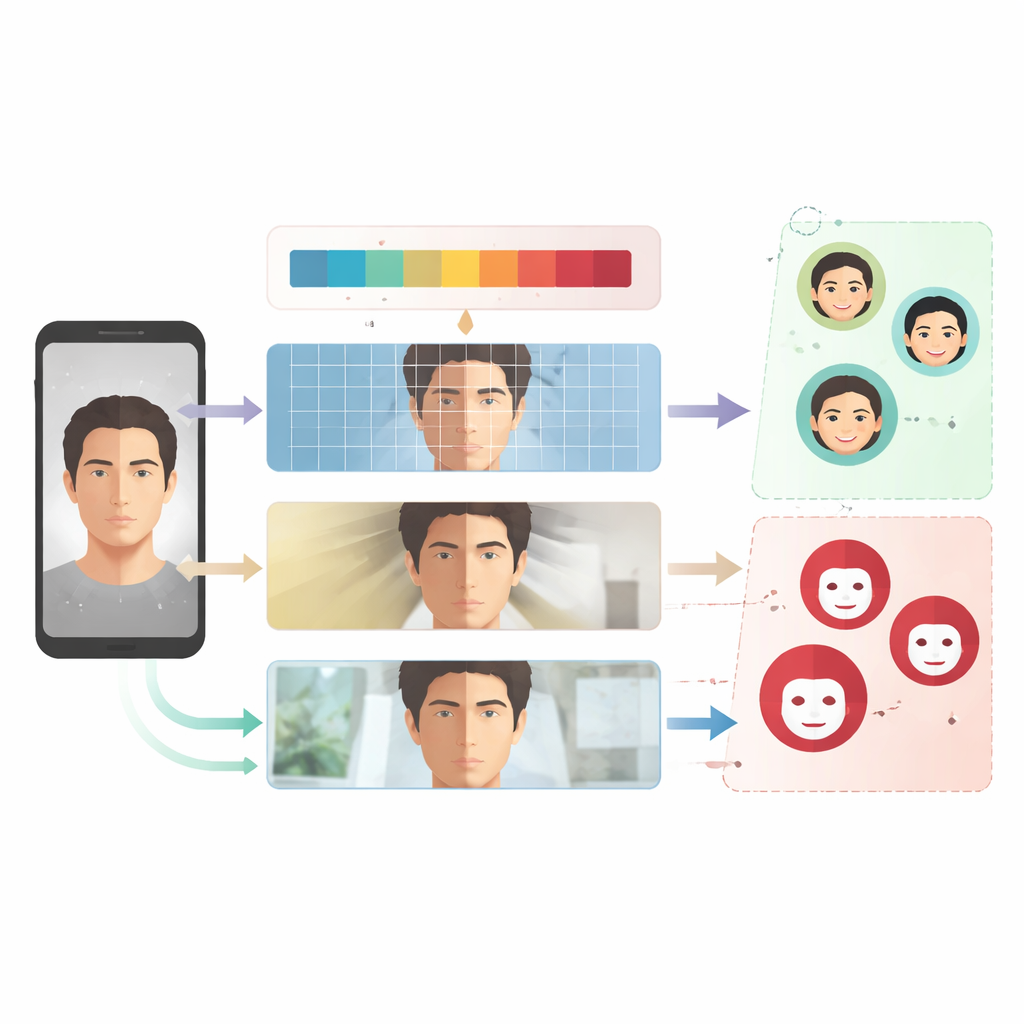

Większość obecnych narzędzi do wykrywania spoofingu działa jak czarne skrzynki: zwracają „prawdziwe” lub „fałszywe”, nie tłumacząc dlaczego. Autorzy bazują na modelu wizja–język, rodzaju SI, która potrafi zarówno analizować obrazy, jak i generować tekst. W trakcie treningu model nie tylko decyduje, czy twarz jest żywa czy sfałszowana, lecz także tworzy krótkie wyjaśnienie opisujące wykorzystane wskazówki wizualne, takie jak nietypowe tekstury, płaskie oświetlenie czy nienaturalne refleksy. Te wyjaśnienia nie służą tylko pokazowi; stają się częścią sygnału nauczania, który kształtuje uwagę modelu.

Budowanie benchmarku, który myśli na głos

Aby zbadać ten pomysł w kontrolowany sposób, zespół wzbogaca cztery powszechnie używane zbiory danych do wykrywania spoofingu — obejmujące typowe ataki, takie jak wydrukowane zdjęcia i odtwarzane wideo — o szczegółowe opisy tekstowe. Z użyciem GPT-4o generują dwa rodzaje podpisów dla każdego obrazu. „Waniliowe” podpisy dają krótkie, ogólne uzasadnienie, podczas gdy podpisy w stylu rozumowania przechodzą przez sześć wyraźnych kroków: pierwsze spojrzenie, wykrywanie artefaktów, analiza cech, oświetlenie i cienie, kontekst i ostateczny werdykt. Utrzymując dane obrazowe i podstawową sieć neuronową bez zmian, a modyfikując wyłącznie styl tych podpisów, badacze mogą wyizolować wpływ struktury wyjaśnień na to, czego model w efekcie się uczy.

Jak nauczanie z uzasadnieniami zmienia model

Trening systemu staje się zadaniem podwójnym. Jeden składnik funkcji straty nagradza poprawne decyzje live/spoof, a drugi nagradza trafne generowanie wyjaśnień, przy czym klasyfikacja traktowana jest jako główny cel. Autorzy stosują też lekką metodę dopasowania, więc aktualizowane są jedynie niewielkie warstwy adapterów i głowy wyjściowe, a duży, wstępnie wytrenowany rdzeń pozostaje w większości nietknięty. Porównują modele trenowane wyłącznie na waniliowych podpisach z modelami trenowanymi mieszanką podpisów waniliowych i rozumowania według kilku trudnych protokołów „trenuj na niektórych zbiorach, testuj na innym”. Takie ustawienie naśladuje warunki rzeczywiste, gdzie przyszłe ataki mogą nie przypominać dokładnie tych z przeszłości.

Kiedy wyjaśnienia pomagają — i kiedy szkodzą

W wielu testach, szczególnie w standardowych protokołach MCIO typu leave-one-out, modele wystawione na podpisy w stylu rozumowania wykrywają spoofing dokładniej i popełniają mniej błędów na nieznanych zbiorach. W niektórych przypadkach przewyższają nawet wyspecjalizowane, najnowsze obrony zaprojektowane pod kątem odporności międzyzbiorowej. Modele kierowane rozumowaniem wydają się bardziej konsekwentnie koncentrować na wskazówkach specyficznych dla spoofingu, takich jak nieregularności tekstury, pikselizacja czy nienaturalne oświetlenie. Jednak badanie ujawnia też wadę: jeśli wyjaśnienia wielokrotnie podkreślają cechy nieistotne dla nowego typu ataku — na przykład tekstury przypominające wydruk, gdy nowy atak wykorzystuje maski 3D — model może przejąć to uprzedzenie i zawieść, pokazując, że „skrypt nauczania” może zarówno pomagać, jak i wprowadzać w błąd.

Ograniczenia pomiaru wyjaśnień

Autorzy zauważają, że jakość wyjaśnień oceniają głównie pod kątem tego, czy tekst implikuje poprawną etykietę live lub spoof, używając innego modelu językowego do odczytu i interpretacji wygenerowanych wyjaśnień. To nie rozwiązuje w pełni problemu, czy rozumowanie jest wierne temu, co system wizualny rzeczywiście zobaczył, ani czy naprawdę pomaga ludzkim operatorom monitorującym systemy bezpieczeństwa. Wskazują też, że użycie potężnych modeli językowych do tworzenia i interpretowania wyjaśnień może wprowadzać subtelne uprzedzenia — na przykład nadmierne podkreślanie często wspominanych wzorców wizualnych — które mogą wpływać na sprawiedliwość lub wydajność wobec różnych grup demograficznych i warunków nagrań.

Co to oznacza dla bezpieczniejszego rozpoznawania twarzy

W praktycznym ujęciu praca pokazuje, że skłonienie systemu SI do „mówienia dlaczego” podczas treningu może zmienić sposób, w jaki uczy się rozpoznawać fałszywe twarze — i często poprawić zdolność radzenia sobie z nowymi, niewidzianymi wcześniej atakami — bez zwiększania rozmiaru czy złożoności modelu. Jednocześnie ważne jest, jakie rozumowanie nauczymy: ustrukturyzowane wyjaśnienia mogą działać jak kierownica, ale jeśli wskazują na niewłaściwe wskazówki, model może zboczyć z kursu, gdy ataki się zmienią. Badanie proponuje traktować wyjaśnienia nie tylko jako przyjazne dla użytkownika dodatki, lecz jako potężne pokrętła, które inżynierowie mogą regulować, by wyważyć odporność, interpretowalność i uprzedzenia w przyszłych systemach bezpieczeństwa.

Cytowanie: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Słowa kluczowe: odporność na fałszywe twarze, wyjaśnialna SI, modele wizja‑język, bezpieczeństwo biometryczne, ataki prezentacyjne