Clear Sky Science · nl

Analyse van het effect van redengevende supervisie op face anti-spoofing

Waarom valse gezichten belangrijk zijn voor alledaagse beveiliging

Gezichtsherkenning ontgrendelt telefoons, opent kantoordeuren en beschermt gevoelige gegevens. Maar deze systemen zijn te misleiden met eenvoudige trucs, zoals het voorhouden van een afgedrukte foto, het afspelen van een video op een tablet of het dragen van een realistisch masker. Deze studie onderzoekt een nieuwe manier om dergelijke systemen zowel moeilijker te misleiden als gemakkelijker te begrijpen voor mensen: door ze tijdens het leren in gewone taal te laten “uitleggen” waarom ze denken dat een gezicht echt of nep is.

Gezichtscontroles omzetten in verklaarbare verhalen

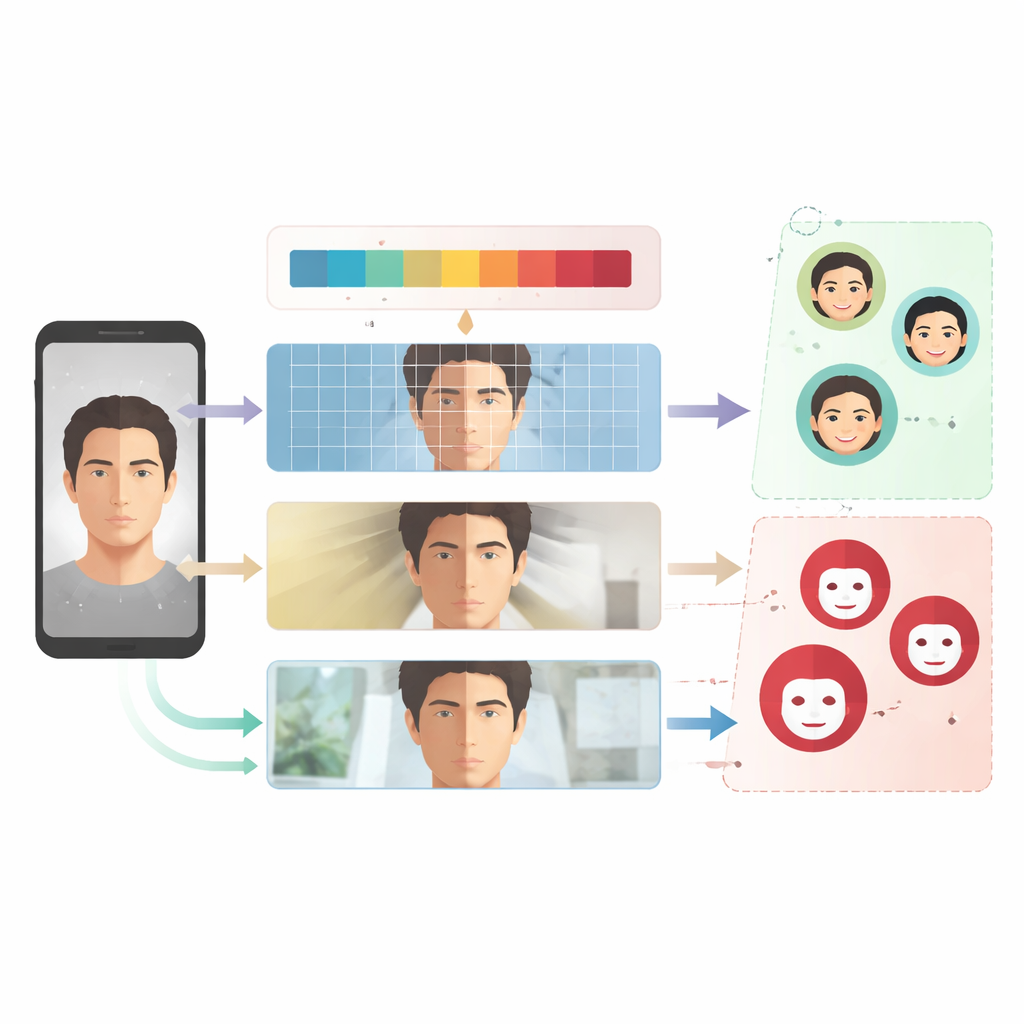

De meeste huidige anti-spoofingtools werken als black boxes: ze geven “echt” of “nep” terug maar geven weinig aanwijzing waarom. De auteurs bouwen in plaats daarvan voort op een visie–taalmodel, een type AI dat zowel beelden kan analyseren als tekst kan genereren. Tijdens het trainen bepaalt het model niet alleen of een gezicht live of gespooft is, maar genereert het ook een korte verklaring die de visuele aanwijzingen beschrijft die het gebruikte, zoals vreemde texturen, vlakke verlichting of reflecties die onnatuurlijk lijken. Deze verklaringen zijn niet alleen cosmetisch; ze worden onderdeel van het leersignaal dat bepaalt waar het model op let.

Een benchmark bouwen die hardop nadenkt

Om dit idee gecontroleerd te bestuderen, verrijkt het team vier veelgebruikte face anti-spoofingdatasets — die veelvoorkomende aanvallen zoals afgedrukte foto’s en afgespeelde video’s omvatten — met gedetailleerde tekstbeschrijvingen. Met GPT-4o genereren ze twee soorten bijschriften voor elke afbeelding. “Vanilla”-bijschriften bieden een korte, algemene rechtvaardiging, terwijl “redengevende” bijschriften in zes duidelijke stappen doorlopen: eerste indruk, detectie van artefacten, feature-analyse, licht en schaduwen, context en eindbeoordeling. Door de afbeeldingsdata en het onderliggende neurale netwerk hetzelfde te houden en alleen de stijl van deze bijschriften te veranderen, kunnen de onderzoekers isoleren hoe de structuur van uitleg beïnvloedt wat het model uiteindelijk leert.

Hoe lesgeven met redenen het model verandert

Het trainen van het systeem wordt nu een duale taak. De ene verliesfunctie beloont correcte live/spoof-beslissingen, en een andere beloont accurate uitleggeneratie, waarbij classificatie als het hoofddoel wordt behandeld. De auteurs gebruiken ook een lichte fine-tuningmethode zodat alleen kleine adapterlagen en outputheads worden bijgewerkt, terwijl het grote voorgetrainde backbone grotendeels ongewijzigd blijft. Ze vergelijken modellen die alleen met vanilla-bijschriften zijn getraind met modellen die een mix van vanilla en redengevende bijschriften gebruiken, over meerdere uitdagende ‘train op sommige datasets, test op een andere’ protocollen. Deze opzet bootst reële omstandigheden na, waar toekomstige aanvallen er mogelijk anders uitzien dan eerdere.

Wanneer verklaringen helpen — en wanneer ze schaden

In veel tests, met name de standaard MCIO leave-one-out protocollen, detecteren modellen die zijn blootgesteld aan redengevende bijschriften spoofs nauwkeuriger en maken ze minder fouten op onbekende datasets. In sommige gevallen presteren ze zelfs beter dan gespecialiseerde state-of-the-art verdedigingsmethoden die gericht zijn op cross-dataset robuustheid. De door redenvoering geleide modellen lijken zich consistenter te richten op spoof-specifieke aanwijzingen zoals textuuronregelmatigheden, pixelatie of onnatuurlijke verlichting. De studie onthult echter ook een nadeel: als de verklaringen herhaaldelijk kenmerken benadrukken die niet belangrijk zijn voor een nieuw type aanval — bijvoorbeeld print-achtige texturen wanneer de nieuwe aanval 3D-maskers gebruikt — kan het model deze bias overnemen en falen. Dit toont aan dat het ‘lesgeven’ zowel kan misleiden als helpen.

Beperkingen bij het meten van verklaringen

De auteurs merken op dat ze de kwaliteit van verklaringen voornamelijk beoordelen op basis van of de tekst het juiste live- of spoof-label impliceert, waarbij ze een ander taalmodel gebruiken om de gegenereerde verklaringen te lezen en te interpreteren. Dit pakt niet volledig aan of de redenering trouw is aan wat het visiesysteem daadwerkelijk zag, of of het echt behulpzaam is voor menselijke operatoren die beveiligingssystemen monitoren. Ze benadrukken ook dat het gebruik van krachtige taalmodellen om verklaringen te creëren en te interpreteren subtiele biases kan introduceren — bijvoorbeeld door vaak genoemde visuele patronen te overaccentueren — wat eerlijkheid of prestaties op verschillende demografische groepen en opnamecondities kan beïnvloeden.

Wat dit betekent voor veiligere gezichtsherkenning

In praktische termen laat dit werk zien dat het een AI-systeem tijdens training laten “uitleggen waarom” kan veranderen hoe het leert nepgezichten te herkennen — en vaak de capaciteit verbetert om met nieuwe, ongeziene aanvallen om te gaan — zonder het model groter of complexer te maken. Tegelijkertijd doet het soort redenering dat we aanleren ertoe: gestructureerde verklaringen kunnen fungeren als een stuurwiel, maar als ze naar de verkeerde aanwijzingen wijzen, kan het model van koers raken wanneer aanvallen veranderen. De studie stelt voor verklaringen niet louter als gebruiksvriendelijke extra’s te zien, maar als krachtige knoppen die ingenieurs kunnen afstemmen om robuustheid, interpreteerbaarheid en bias in toekomstige beveiligingssystemen tegen elkaar af te wegen.

Bronvermelding: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Trefwoorden: face anti-spoofing, verklaarbare AI, visie-taalmodellen, biometrische beveiliging, presentatie-aanvallen