Clear Sky Science · it

Analisi dell’effetto della supervisione basata sul ragionamento nel contrasto alle frodi facciali

Perché i volti falsi sono importanti per la sicurezza quotidiana

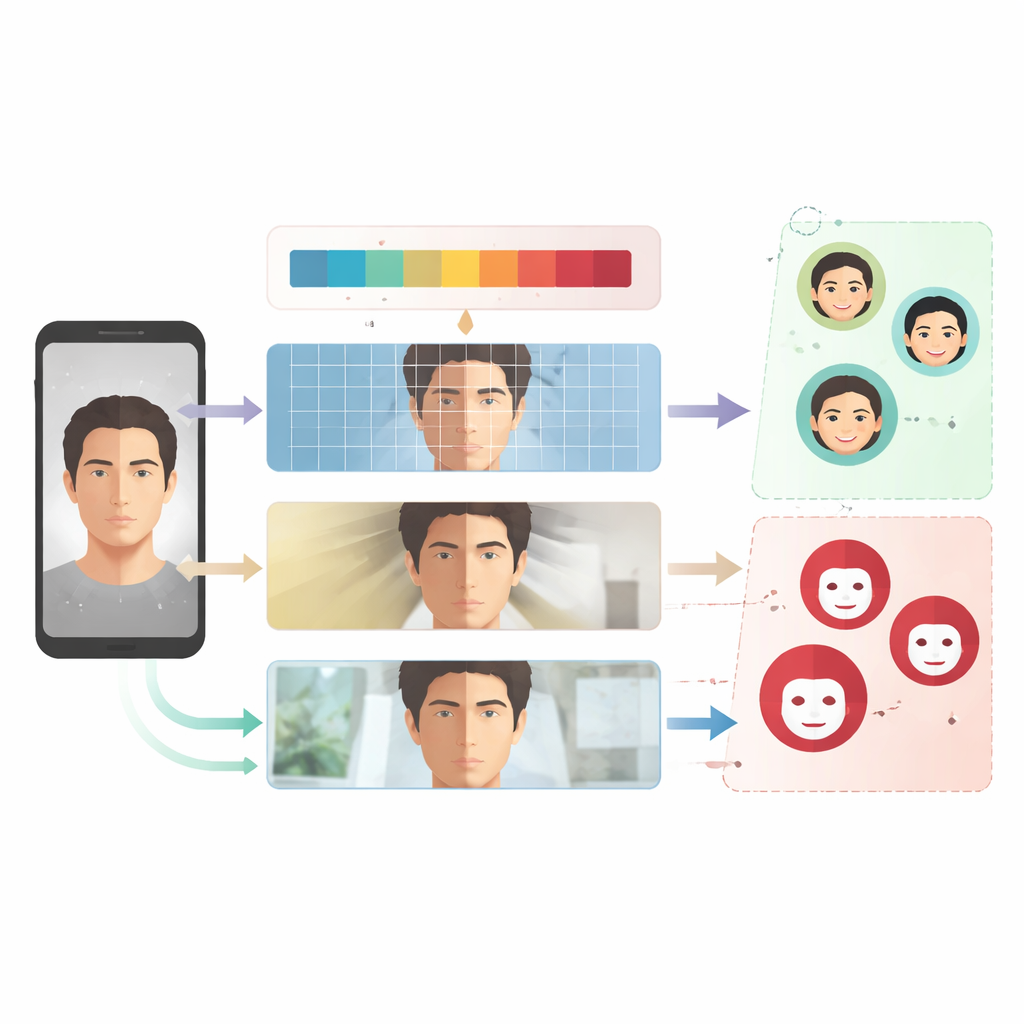

Il riconoscimento facciale sblocca telefoni, apre porte d’ufficio e protegge dati sensibili. Ma questi sistemi possono essere ingannati con stratagemmi semplici, come mostrare una foto stampata, riprodurre un video su un tablet o indossare una maschera realistica. Questo studio esamina un nuovo modo per rendere tali sistemi sia più difficili da ingannare sia più comprensibili per gli esseri umani, insegnando loro a “spiegare” le proprie decisioni in linguaggio naturale mentre imparano a riconoscere i volti falsi.

Trasformare i controlli facciali in storie spiegate

La maggior parte degli strumenti anti-spoofing attuali funziona come una scatola nera: restituiscono “reale” o “falso” ma danno poche indicazioni sul perché. Gli autori si basano invece su un modello visione–linguaggio, un tipo di IA in grado sia di analizzare immagini sia di generare testo. Durante l’addestramento, il modello non soltanto decide se un volto è reale o contraffatto, ma produce anche una breve spiegazione che descrive gli indizi visivi usati, come texture inconsistenti, illuminazione piatta o riflessi innaturali. Queste spiegazioni non sono solo ornamentali; diventano parte del segnale di apprendimento che determina a cosa il modello presta attenzione.

Costruire un benchmark che pensa ad alta voce

Per studiare questa idea in modo controllato, il team arricchisce quattro dataset ampiamente usati per l’anti-spoofing facciale—che coprono attacchi comuni come foto stampate e video riprodotti—con descrizioni testuali dettagliate. Usando GPT-4o, generano due tipi di didascalie per ciascuna immagine. Le didascalie “vanilla” offrono una breve giustificazione generale, mentre le didascalie in stile “reasoning” seguono sei passaggi chiari: prima osservazione, rilevamento di artefatti, analisi delle caratteristiche, illuminazione e ombre, contesto e giudizio finale. Mantenendo fissi i dati di immagine e la rete neurale sottostante e cambiando solo lo stile di queste didascalie, i ricercatori possono isolare come la struttura delle spiegazioni influenzi ciò che il modello apprende.

Come l’insegnamento basato su ragioni modifica il modello

L’addestramento del sistema diventa ora un compito doppio. Un termine di perdita ricompensa decisioni corrette live/spoof e un altro premia la generazione di spiegazioni accurate, con la classificazione trattata come obiettivo principale. Gli autori impiegano anche un metodo di fine-tuning leggero, aggiornando solo piccoli layer adapter e testate di output, lasciando in gran parte intatto il backbone pre-addestrato. Confrontano modelli addestrati solo con didascalie vanilla con modelli addestrati con una miscela di didascalie vanilla e reasoning attraverso diversi protocolli sfidanti di “allenare su alcuni dataset, testare su un altro”. Questa configurazione imita condizioni reali, in cui gli attacchi futuri potrebbero non somigliare esattamente a quelli passati.

Quando le spiegazioni aiutano — e quando danneggiano

In molti test, specie nei protocolli standard MCIO leave-one-out, i modelli esposti a didascalie in stile reasoning rilevano i falsi con maggiore accuratezza e commettono meno errori su dataset non familiari. In alcuni casi superano persino difese specializzate all’avanguardia progettate per la robustezza cross-dataset. I modelli guidati dal ragionamento sembrano concentrarsi più coerentemente su indizi specifici di spoofing come irregolarità di texture, pixelazione o illuminazione innaturale. Tuttavia, lo studio mette in luce anche un risvolto negativo: se le spiegazioni enfatizzano ripetutamente caratteristiche non rilevanti per un nuovo tipo di attacco — per esempio texture simili alla stampa quando l’attacco nuovo utilizza maschere 3D — il modello può ereditare questo bias e fallare, dimostrando che lo “script didattico” può fuorviare tanto quanto aiutare.

Limiti nella misurazione delle spiegazioni

Gli autori osservano che giudicano principalmente la qualità delle spiegazioni in base al fatto che il testo implichi l’etichetta corretta live o spoof, usando un altro modello linguistico per leggere e interpretare le spiegazioni generate. Questo non risolve pienamente se il ragionamento sia fedele a ciò che il sistema visivo ha effettivamente osservato, né se sia realmente utile agli operatori umani che monitorano i sistemi di sicurezza. Sottolineano inoltre che usare modelli linguistici potenti per creare e interpretare spiegazioni può introdurre bias sottili — per esempio sovra-enfatizzare pattern visivi frequentemente menzionati — che potrebbero influire su equità o prestazioni su differenti gruppi demografici e condizioni di registrazione.

Cosa significa per un riconoscimento facciale più sicuro

In termini pratici, questo lavoro mostra che far “dire il perché” a un sistema di IA durante l’addestramento può modificare il modo in cui impara a riconoscere i volti falsi — e spesso migliorarne la capacità di affrontare attacchi nuovi e non visti — senza rendere il modello più grande o complesso. Allo stesso tempo, il tipo di ragionamento che insegniamo conta: spiegazioni strutturate possono agire come un volante, ma se indicano gli indizi sbagliati il modello può deviare quando gli attacchi cambiano. Lo studio propone di vedere le spiegazioni non solo come aggiunte user-friendly, ma come potenti manopole che gli ingegneri possono regolare per bilanciare robustezza, interpretabilità e bias nei futuri sistemi di sicurezza.

Citazione: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Parole chiave: anti-spoofing facciale, IA spiegabile, modelli visione-linguaggio, sicurezza biometrica, attacchi di presentazione