Clear Sky Science · ru

Анализ влияния обучения с рассуждениями на противодействие подделке лиц

Почему поддельные лица важны для повседневной безопасности

Распознавание лиц разблокирует телефоны, открывает офисные двери и защищает конфиденциальные данные. Но эти системы можно обмануть простыми приемами — например, показывая печатную фотографию, воспроизводя видео на планшете или надевая реалистичную маску. В этом исследовании рассматривается новый подход, который делает такие системы одновременно труднее обмануть и понятнее для людей: обучать их «объяснять» свои решения простым языком в процессе обучения распознаванию подделок.

Преобразование проверок лиц в объяснимые истории

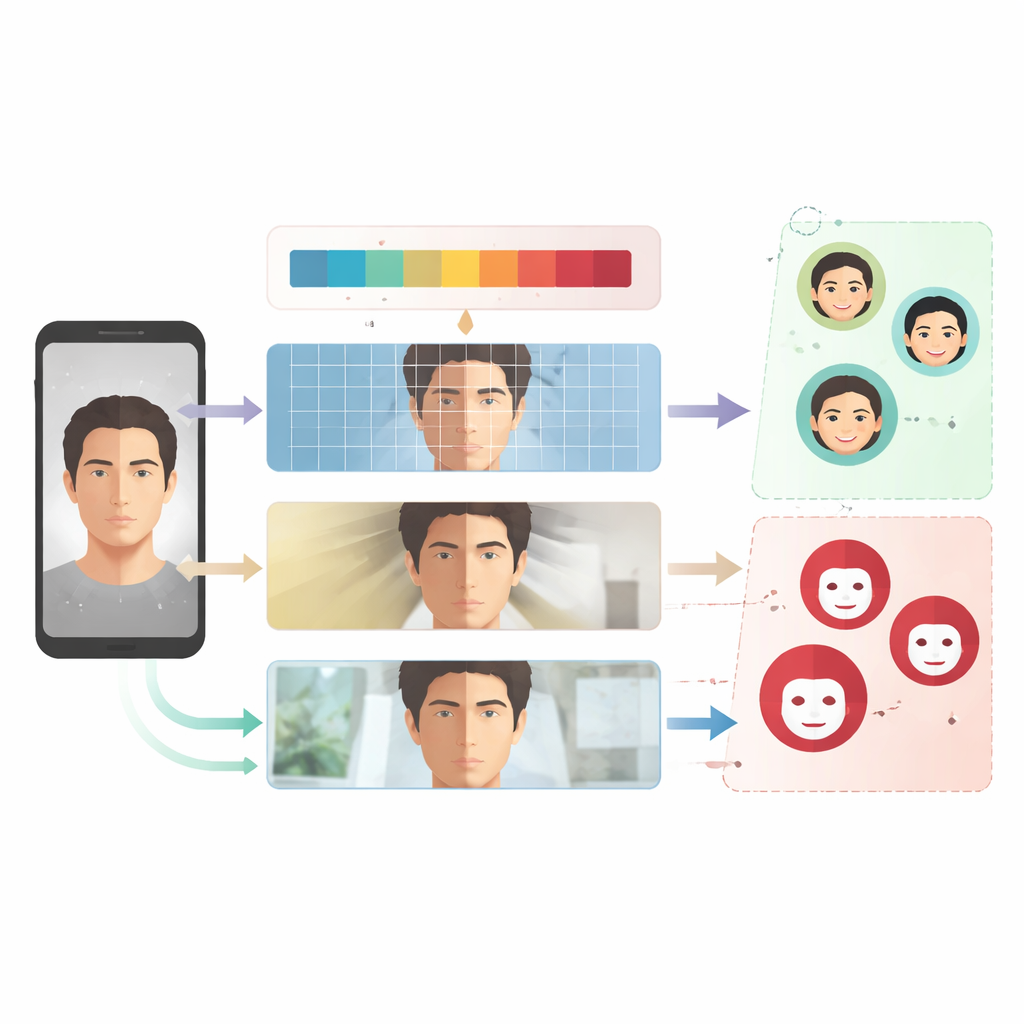

Большинство современных средств противодействия подделке работают как черные ящики: они выдают «реально» или «подделка», но не дают подсказок почему. Авторы же опираются на модель «зрение — язык», тип ИИ, который может анализировать изображения и генерировать текст. В процессе обучения модель не только решает, живое ли лицо или подделка, но и выдает короткое объяснение визуальных признаков, на которых основывалось решение — например, необычные текстуры, плоское освещение или отражения, которые выглядят неестественно. Эти объяснения служат не просто демонстрацией; они становятся частью сигнала обучения, формирующего внимание модели.

Создание эталона, который думает вслух

Чтобы изучить эту идею в контролируемых условиях, команда обогатила четыре широко используемых датасета по противодействию подделке лиц — охватывающих распространенные атаки, такие как печатные фото и воспроизведение видео — подробными текстовыми описаниями. С помощью GPT-4o они сгенерировали два типа подписей к каждому изображению. «Обычные» подписи дают короткое, общее обоснование, в то время как «в стиле рассуждений» проходят через шесть четких шагов: первый взгляд, обнаружение артефактов, анализ признаков, освещение и тени, контекст и итоговый вердикт. Сохраняя неизменными данные изображений и базовую нейросеть и меняя только стиль подписей, исследователи смогли выделить, как структура объяснений влияет на то, чему модель в итоге учится.

Как обучение с причинами меняет модель

Теперь обучение системы становится двойной задачей. Одна составляющая функции потерь вознаграждает за правильные решения «живое/подделка», а другая — за точную генерацию объяснений, при этом классификация рассматривается как основная цель. Авторы также используют легкий метод донастройки, так что обновляются только небольшие адаптерные слои и выходные головы, а крупная предобученная часть остаётся в основном нетронутой. Они сравнивают модели, обученные только с обычными подписями, и модели, обученные смесью обычных и рассуждающих подписей, по нескольким сложным протоколам «обучись на некоторых наборах, тестируй на другом». Такая схема имитирует реальные условия, где будущие атаки могут выглядеть иначе, чем прежние.

Когда объяснения помогают — и когда вредят

По результатам многочисленных тестов, особенно стандартных протоколов MCIO «оставь-один-вне», модели, получавшие подписи в стиле рассуждений, точнее выявляют подделки и реже ошибаются на незнакомых датасетах. В некоторых случаях они даже превосходят специализированные передовые защиты, разработанные для кросс-датасетной устойчивости. Модели, направляемые рассуждениями, кажутся более стабильными в фокусе на признаках подделки, таких как нерегулярности текстуры, пикселизация или неестественное освещение. Вместе с тем исследование выявляет и отрицательный аспект: если объяснения постоянно акцентируют признаки, неважные для нового типа атаки — например, текстуры, похожие на печать, когда новая атака использует 3D-маски — модель может унаследовать этот уклон и ошибаться, что показывает: «скрипт обучения» может как помогать, так и вводить в заблуждение.

Ограничения измерения объяснений

Авторы отмечают, что они в основном оценивают качество объяснений с точки зрения того, подразумевает ли текст правильную метку «живое» или «подделка», используя другую языковую модель для чтения и интерпретации сгенерированных объяснений. Это не полностью отвечает на вопрос, насколько рассуждения соответствуют тому, что действительно «видела» визуальная система, или насколько они полезны для людей, контролирующих системы безопасности. Они также подчеркивают, что использование мощных языковых моделей для создания и интерпретации объяснений может вносить тонкие смещения — например, переоценку часто упоминаемых визуальных шаблонов — которые способны повлиять на справедливость или производительность в отношении разных демографических групп и условий записи.

Что это значит для более безопасного распознавания лиц

Проще говоря, работа показывает: требование к ИИ «сказать, почему» в процессе обучения может изменить то, как он учится распознавать поддельные лица — и часто улучшить его способность справляться с новыми, ранее не встречавшимися атаками — при этом не увеличивая размер или сложность модели. Одновременно важно, какие именно рассуждения мы преподавали: структурированные объяснения могут служить рулем, но если они указывают на неверные подсказки, модель может сбиться с курса при изменении атак. Исследование предлагает рассматривать объяснения не просто как удобную функцию для пользователя, а как мощные регуляторы, которые инженеры могут настраивать для баланса между устойчивостью, интерпретируемостью и смещением в будущих системах безопасности.

Цитирование: Min, J., Lim, K., Kim, M. et al. Analyzing the effect of reasoning-based supervision on face anti-spoofing. Sci Rep 16, 13360 (2026). https://doi.org/10.1038/s41598-026-43800-5

Ключевые слова: противодействие подделке лиц, объяснимая ИИ, модели «зрение — язык», биометрическая безопасность, атаки презентации