Clear Sky Science · tr

Bilimsel fikir üretiminde minimal bağlamla LLM'lerin ayrışan düşünme yeteneklerini değerlendirme

Günlük Bilim Meraklıları İçin Neden Önemli

Modern yapay zekâ etrafındaki heyecanın büyük kısmı, sınavlarda ve testlerde gösterdiği aparan başarıdan kaynaklanıyor. Oysa bilimsel atılımlar nadiren sınav sorularını doğru cevaplamaktan doğar; genellikle tek bir kelime ya da sezgiyle tetiklenen tuhaf, yarım kalmış fikirlerle başlar. Bu makale, sonuçları büyük olabilecek, ayakları yere basan bir soru soruyor: günümüzün büyük dil modellerine yalnızca küçük bir ipucu—tek bir bilimsel anahtar kelime—verildiğinde gerçekten taze, makul araştırma fikirleri üretebiliyorlar mı ve bu “yaratıcılık kıvılcımı” yapay zekâ zekâsının olağan ölçümleriyle nasıl ilişkilendiriliyor?

Sınav Çözen Makinelerden Fikir Ortaklarına

Mevcut kıyasların çoğu yapay zekâyı süper bir öğrenci gibi ele alıyor: modellere tam özetler veya problem tanımları gibi zengin bağlamlar veriliyor ve sonra doğru cevabı bulup bulmadıkları puanlanıyor. Bu yaklaşım ağırlıklı olarak yakınsayan düşünmeyi ölçüyor: seçenekleri tek bir çözüme daraltmak. Yazarlar, bilimin erken aşamalarının çok farklı göründüğünü savunuyor. Bir bilim insanı genellikle neredeyse hiçbir şeyle—sadece bir konu kelimesiyle—başlar ve sonra düzinelerce olası soru ve yön çağrışımı yapar. Makinelerde bu tür ayrışan düşünmeyi yakalamak için LiveIdeaBench adında yeni bir kıyas sunuyorlar; bu kıyas bilinçli olarak bağlamı yalnızca “mikroskopi” veya “hava tahmini” gibi tek bir bilimsel anahtar kelimeye indirger ve modellerden kısa, somut araştırma fikirleri önermelerini ister.

Yeni Kıyas Nasıl Çalışıyor

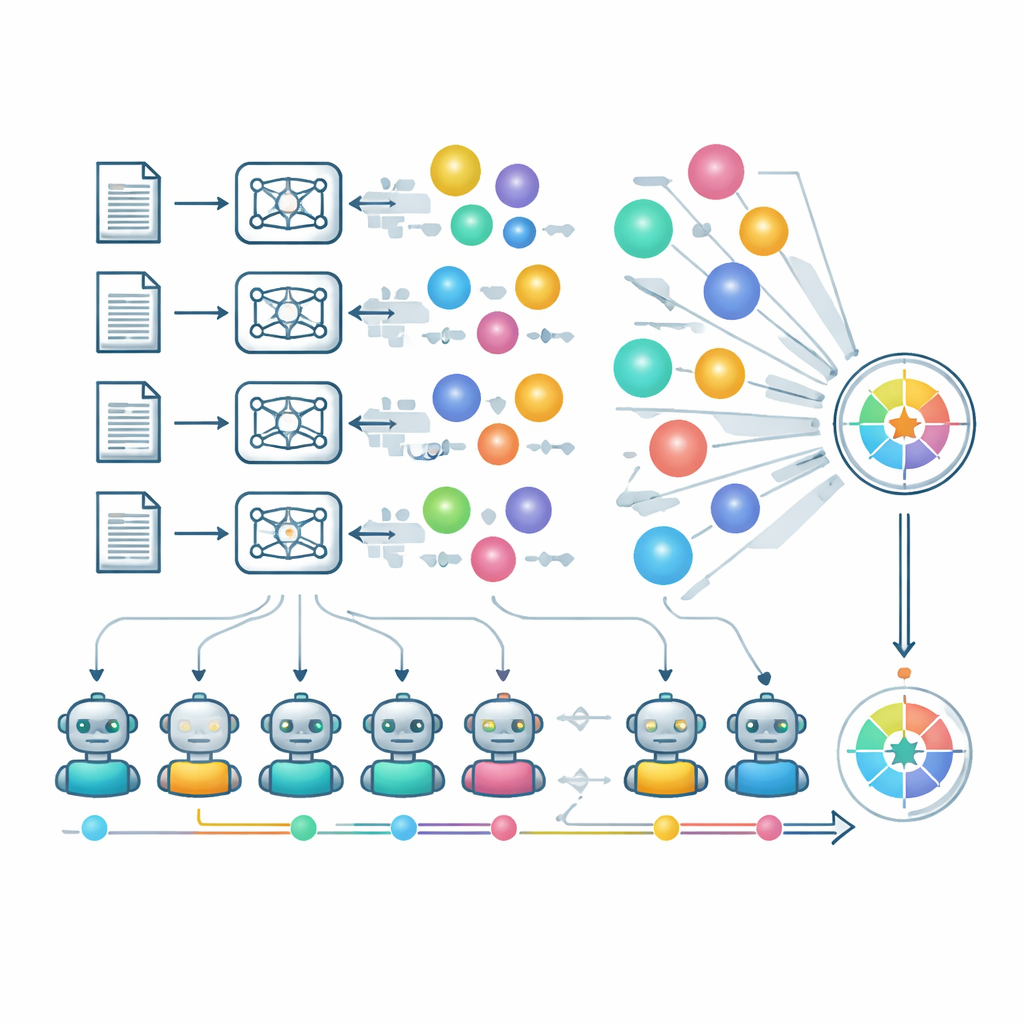

LiveIdeaBench, fiziikten tıpa ve sosyal bilimlere kadar 22 alanda 1180 popüler bilimsel anahtar kelimeyi kapsıyor. Her anahtar kelime için 40’tan fazla önde gelen dil modeline kısa bilimsel fikirler üretmeleri yönlendiriliyor. Dinamik bir üst performans modellerinden oluşan jüri paneli, ardından her fikri beş yaratıcılık ilhamlı boyutta değerlendiriyor: özgünlük, uygulanabilirlik, ifade netliği, aynı ipucundan kaç farklı fikir üretilebildiği (akışkanlık) ve çok farklı konular arasında ne kadar tutarlı performans gösterebildiği (esneklik). Her fikir birden fazla jüri tarafından puanlanıyor ve bireysel model yanlılığını azaltmak için puanlar ortalanıyor. Kıyas düzenli olarak hem kullandığı anahtar kelimeler hem de değerlendirdiği modeller açısından güncelleniyor; böylece mevcut bilim ve yapay zekâ yeteneğinin hareketli sınırını takip ediyor.

AI Yaratıcılığı Hakkında Sonuçların Ortaya Koydukları

Yazarların büyük ölçekli testleri, LiveIdeaBench performansının standart “genel zeka” sıralamalarından çarpıcı biçimde farklı göründüğünü gösteriyor. Matematik, kodlama ve muhakemede çok iyi olan bazı tanınmış modeller, minimal ipuçlarından çeşitli, yenilikçi bilimsel fikirler üretmede parlamıyor. Genel puanları mütevazı olan ve nispeten küçük modeller de dahil bazıları ise beklenmedik şekilde güçlü ayrışan düşünme sergiliyor; bazen yaratıcılıkla ilişkili ölçümlerde önde gelen sistemlerle eşleşiyor veya onları geçebiliyor. Çalışma ayrıca fikirlerin ne kadar cesur olduğu ile ne kadar güvenli olduğu arasında bir takas olduğunu buluyor: çok özgün yönler öneren modeller uygulanabilirlikte zayıf olabilirken, diğerleri daha pratik ama daha az şaşırtıcı fikirleri tercih ediyor. Önemli olarak, daha uzun, daha ayrıntılı yanıtlar her zaman daha iyi fikirler üretmiyor; kelime hacminin kendisi kaliteyle sadece zayıf bir ilişki gösteriyor.

Değerlendirme Mekaniğinin İçine Bakmak

Uzman değerlendirmesine ölçeklenebilir bir yaklaşım sunmak için yazarlar büyük ölçüde “jüri olarak LLM’ler”e dayanıyor. Özenle seçilmiş güçlü modeller grubu özgünlük, uygulanabilirlik ve netliği bağımsız olarak puanlıyor ve ayrı bir süreç aynı modelden aynı anahtar kelime için üretilen birden çok fikrin gerçekten farklı mı yoksa yalnızca yeniden ifade mi olduğunu kontrol ediyor. Esneklik, bir modelin tanıdık alanların dışındaki zayıf bölgelerinde de puanlarının nasıl korunduğuna bakılarak yakalanıyor. Ekip ayrıca mimari, eğitim stratejileri ve güvenlik politikalarının yaratıcı çıktıyı nasıl etkilediğini analiz ediyor. Daha sıkı güvenlik filtrelerine sahip modeller bazen belirli hassas anahtar kelimeler için yanıt vermeyi reddediyor ve sorumlu davranmalarına rağmen puanlarını düşürüyor. Yazarlar, yapay zekâ jüri kullanmanın yaltaklanma ve tanımadıkları bilimsel alanlardaki kör noktalar gibi riskler taşıdığını, ancak uzmanlaşmış bir matematik alanında insan uzmanlarla ön anlaşma gösterdiklerini belirtiyor.

AI Destekli Keşiflerin Geleceği İçin Çıkarımlar

Bir uzman olmayan için temel çıkarım basit ama güçlü: sınavlarda iyi olmak, bir yapay zekâyı yeni bilimler için beyin fırtınası yapacak iyi bir ortak yapmaz. Ayrışan düşünme—tek bir ipucundan birçok farklı, anlamlı araştırma fikri üretebilme yeteneği—kısmen bağımsız bir beceri olarak ortaya çıkıyor ve mevcut kıyasların büyük ölçüde göz ardı ettiği bir alan.

Atıf: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Anahtar kelimeler: Yapay zeka yaratıcılığı, ayrışan düşünme, bilimsel fikir üretimi, büyük dil modelleri, kıyaslama