Clear Sky Science · es

Evaluación de la capacidad de pensamiento divergente de los LLM para la generación de ideas científicas con contexto mínimo

Por qué importa para los aficionados a la ciencia

Gran parte del entusiasmo en torno a la IA moderna proviene de su aparente brillantez en exámenes y pruebas. Pero los avances científicos rara vez nacen de responder preguntas tipo test; comienzan con ideas extrañas y a medio formar, encendidas por una sola palabra o corazonada. Este artículo plantea una pregunta sencilla pero de gran alcance: cuando se da a los modelos de lenguaje actuales apenas una pista—a solas una palabra clave científica—¿pueden realmente generar nuevas ideas de investigación plausibles, y cómo se relaciona esa "chispa creativa" con las medidas habituales de inteligencia de la IA?

De máquinas que resuelven pruebas a compañeros de ideas

La mayoría de los benchmarks actuales tratan a la IA como un súper estudiante: se alimenta a los modelos con contexto rico—como resúmenes completos o descripciones de problemas—y luego se evalúa si obtienen la respuesta correcta. Esa configuración mide principalmente el pensamiento convergente: reducir las opciones hasta una solución única. Los autores sostienen que las etapas iniciales de la ciencia son muy distintas. Un científico a menudo parte de casi nada más que una palabra temática y luego asocia libremente decenas de posibles preguntas y direcciones. Para capturar este tipo de pensamiento divergente en máquinas, presentan LiveIdeaBench, un nuevo benchmark que reduce deliberadamente el contexto a una sola palabra clave científica—como “microscopía” o “predicción meteorológica”—y pide a los modelos que propongan ideas de investigación breves y concretas.

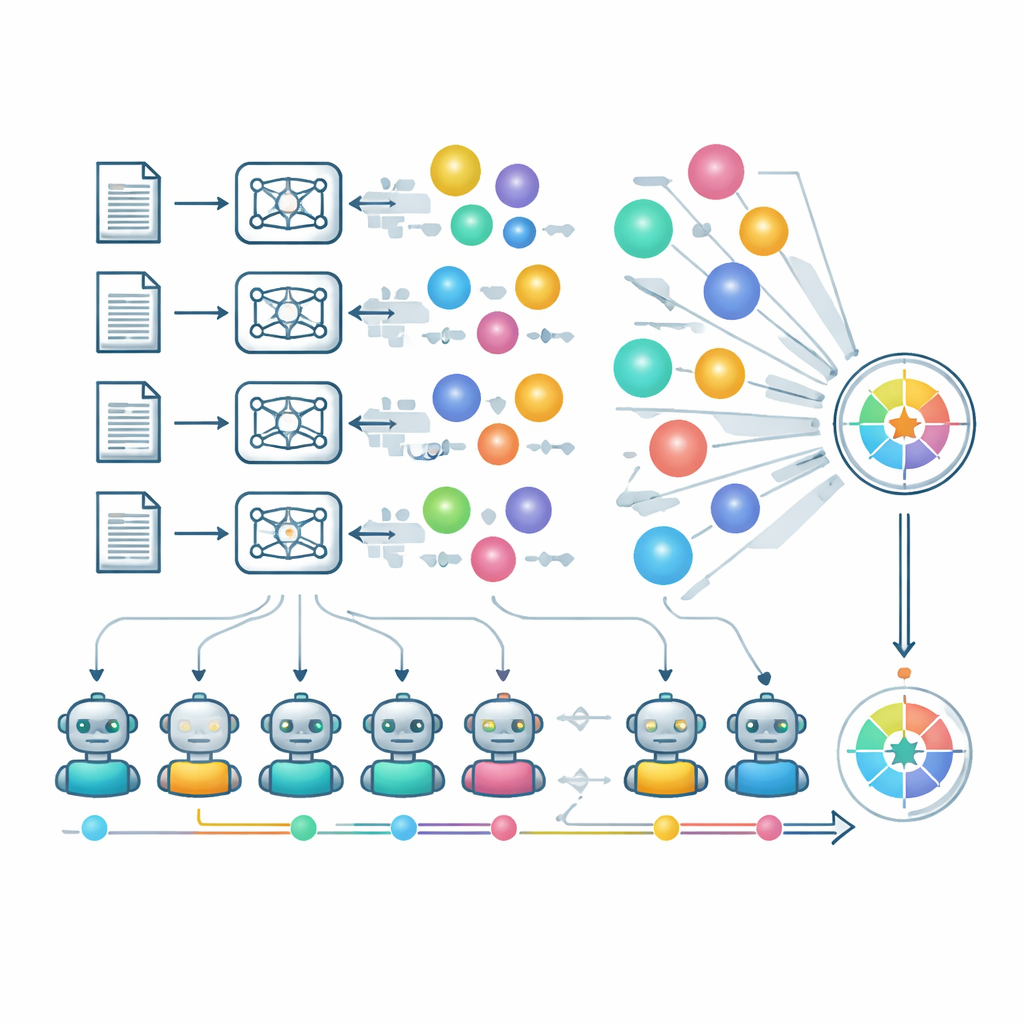

Cómo funciona el nuevo benchmark

LiveIdeaBench abarca 1.180 palabras clave científicas populares en 22 campos, desde física hasta medicina y ciencias sociales. Para cada palabra clave, más de 40 modelos de lenguaje líderes son solicitados para generar ideas científicas compactas. Un panel dinámico de modelos de alto rendimiento actúa luego como "jurado" y valora cada idea según cinco dimensiones inspiradas en la creatividad: cuán original es, si parece factible, cuán claramente está expresada, cuántas ideas distintas puede producir el modelo a partir de la misma pista (fluidez) y con qué consistencia puede desempeñarse en temas muy diferentes (flexibilidad). Varios jueces puntúan cada idea y las puntuaciones se promedian para reducir el sesgo individual de los modelos. El benchmark se actualiza regularmente, tanto en las palabras clave que utiliza como en los modelos que evalúa, de modo que sigue la frontera móvil de la ciencia y la capacidad de la IA actuales.

Qué revelan los resultados sobre la creatividad de la IA

Las pruebas a gran escala de los autores muestran que el rendimiento en LiveIdeaBench difiere notablemente de las clasificaciones en las tablas de "inteligencia general" habituales. Algunos modelos conocidos por sobresalir en matemáticas, programación y razonamiento no destacan al generar ideas científicas variadas y novedosas a partir de indicios mínimos. Otros con puntuaciones generales modestas, incluidos modelos comparativamente pequeños, muestran un pensamiento divergente sorprendentemente fuerte, a veces igualando o incluso superando a los sistemas líderes en medidas relacionadas con la creatividad. El estudio también encuentra un intercambio entre lo audaz y lo seguro: los modelos que proponen direcciones muy originales pueden ser más débiles en factibilidad, mientras que otros prefieren ideas más prácticas pero menos sorprendentes. Es importante: respuestas más largas y elaboradas no producen de forma fiable mejores ideas; el mero volumen de palabras se relaciona débilmente con la calidad.

Un vistazo a la mecánica de la evaluación

Para aproximar la revisión experta a gran escala, los autores se apoyan intensamente en "LLM como jueces." Un grupo seleccionado de modelos potentes puntúa de forma independiente originalidad, factibilidad y claridad, y un proceso separado verifica si múltiples ideas del mismo modelo y palabra clave son realmente diferentes o solo reformulaciones. La flexibilidad se captura observando cómo se mantienen las puntuaciones de un modelo en sus áreas más débiles, no solo en dominios familiares. El equipo también analiza cómo la arquitectura, las estrategias de entrenamiento y las políticas de seguridad influyen en la producción creativa. Los modelos con filtros de seguridad más estrictos a veces se niegan a responder para ciertas palabras clave sensibles, lo que perjudica sus puntuaciones pese a un comportamiento responsable. Los autores señalan que usar jueces de IA conlleva riesgos—como la adulación y puntos ciegos en territorios científicos poco familiares—pero muestran un acuerdo preliminar con expertos humanos en un dominio matemático especializado.

Implicaciones para el futuro del descubrimiento asistido por IA

Para un no especialista, la conclusión principal es sencilla pero potente: ser bueno en exámenes no convierte automáticamente a una IA en un buen compañero para la generación de ideas científicas. El pensamiento divergente—la capacidad de generar muchas ideas de investigación diferentes y significativas a partir de una sola pista—emerge como una habilidad en parte independiente que los benchmarks actuales ignoran en gran medida.

Cita: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Palabras clave: creatividad de la IA, pensamiento divergente, generación de ideas científicas, modelos de lenguaje grandes, evaluación comparativa