Clear Sky Science · sv

Utvärdering av LLM:ers divergent tänkande för generering av vetenskapliga idéer med minimal kontext

Varför detta spelar roll för vardagliga vetenskapsintresserade

Mycket av upphetsningen kring modern AI kommer från dess till synes briljanta prestationer på prov och tester. Men vetenskapliga genombrott uppstår sällan genom att besvara quizfrågor; de börjar ofta med märkliga, halvfärdiga idéer som väcks av ett enda ord eller en aning. Denna artikel ställer en jordnära fråga med stora konsekvenser: när du ger dagens stora språkmodeller bara en liten ledtråd — ett enstaka vetenskapligt nyckelord — kan de då faktiskt brainstorma fram nya, trovärdiga forskningsidéer, och hur relaterar den där ”kreativa gnistan” till de vanliga måtten på AI-intelligens?

Från provlösa maskiner till idésällskap

De flesta nuvarande benchmark-tester behandlar AI som en superstudent: modeller matas med rik kontext — som hela abstrakt eller problembeskrivningar — och bedöms sedan på om de hittar rätt svar. Den uppläggningen mäter framför allt konvergent tänkande: att begränsa alternativ till en enda lösning. Författarna menar att de tidiga stadierna av vetenskap ser annorlunda ut. En forskare börjar ofta med nästan ingenting mer än ett ämnesord och associerar fritt fram dussintals möjliga frågor och riktningar. För att fånga denna typ av divergent tänkande i maskiner introducerar de LiveIdeaBench, en ny benchmark som avsiktligt reducerar kontexten till just ett vetenskapligt nyckelord — som ”mikroskopi” eller ”väderprognoser” — och ber modeller föreslå korta, konkreta forskningsidéer.

Hur den nya benchmarken fungerar

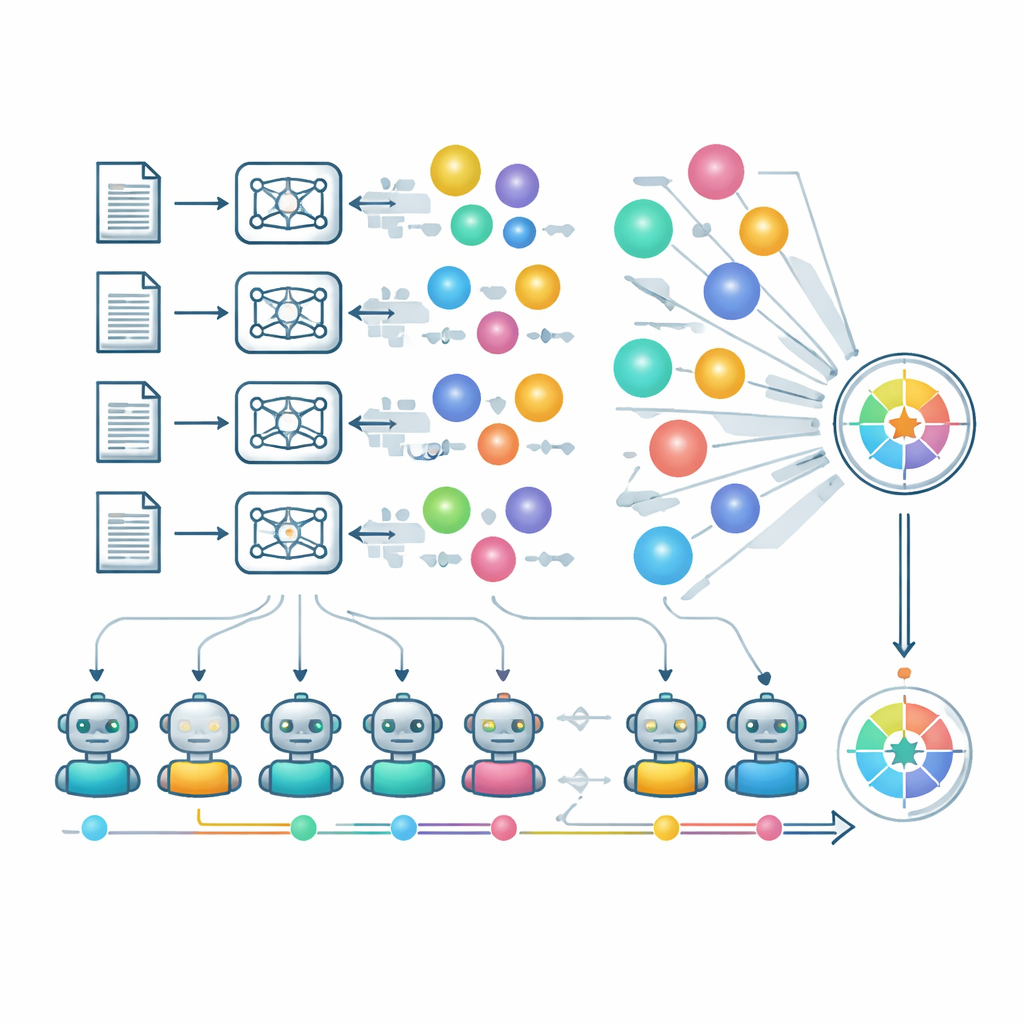

LiveIdeaBench omfattar 1180 populära vetenskapliga nyckelord över 22 fält, från fysik till medicin och samhällsvetenskap. För varje nyckelord uppmanas mer än 40 ledande språkmodeller att generera kompakta vetenskapliga idéer. En dynamisk panel av topprankade modeller tjänar sedan som ”domare” som betygsätter varje idé längs fem kreativitetsskapade dimensioner: hur originell den är, om den verkar genomförbar, hur tydligt den är uttryckt, hur många distinkta idéer modellen kan producera från samma ledtråd (flöde), och hur konsekvent den presterar över mycket olika ämnen (flexibilitet). Flera domare poängsätter varje idé och poängen genomsnittas för att minska individuell modellbias. Benchmarken uppdateras regelbundet, både vad gäller de nyckelord som används och de modeller som utvärderas, så att den följer den rörliga framkanten av aktuell vetenskap och AI-kapacitet.

Vad resultaten avslöjar om AI-kreativitet

Författarnas storskaliga tester visar att prestationer på LiveIdeaBench ser slående annorlunda ut jämfört med rankningar på standardlistor för ”allmän intelligens”. Vissa välkända modeller som briljerar i matematik, kodning och resonemang lyser inte när det gäller att generera varierade, nya vetenskapliga idéer från minimala promptar. Andra med blygsammare generella poäng, inklusive relativt små modeller, visar överraskande starkt divergent tänkande och matchar ibland eller till och med slår ledande system på kreativitetrelaterade mått. Studien finner också en avvägning mellan hur djärva och hur säkra idéerna är: modeller som föreslår mycket originella riktningar kan vara svagare på genomförbarhet, medan andra föredrar mer praktiska men mindre överraskande idéer. Viktigt är att längre, mer utförliga svar inte pålitligt ger bättre idéer; ordvolymen är bara svagt relaterad till kvalitet.

En inblick i utvärderingsmekaniken

För att approximera expertgranskning i skala lutar sig författarna tungt på ”LLM som domare”. En kurerad grupp av starka modeller betygsätter oberoende originalitet, genomförbarhet och tydlighet, och en separat process kontrollerar om flera idéer från samma modell och nyckelord verkligen är olika eller bara omskrivningar. Flexibilitet fångas genom att se hur en modells poäng står sig i dess svagare områden, inte bara i välbekanta domäner. Teamet analyserar också hur arkitektur, träningsstrategier och säkerhetspolicyer påverkar kreativ output. Modeller med striktare säkerhetsfilter vägrar ibland att svara på vissa känsliga nyckelord, vilket försämrar deras poäng trots ansvarsfullt beteende. Författarna noterar att användning av AI-domare medför risker — såsom fjäskeri och blinda fläckar i okänd vetenskaplig terräng — men visar preliminär överensstämmelse med mänskliga experter inom ett specialiserat matematikområde.

Konsekvenser för framtiden för AI-assisterad upptäckt

För en icke-specialist är huvudslutsatsen enkel men kraftfull: att vara bra på tester gör inte automatiskt en AI till en bra partner för att brainstorma ny vetenskap. Divergent tänkande — förmågan att spåna fram många olika, meningsfulla forskningsidéer utifrån en enda ledtråd — framträder som en delvis självständig färdighet som nuvarande benchmark-tester i hög grad förbiser.

Citering: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Nyckelord: AI-kreativitet, divergent tänkande, generering av vetenskapliga idéer, stora språkmodeller, benchmarking