Clear Sky Science · pl

Ocena zdolności modeli LLM do myślenia dywergencyjnego w generowaniu pomysłów naukowych na minimalnym kontekście

Dlaczego to ma znaczenie dla miłośników nauki na co dzień

Wiele entuzjazmu wokół współczesnej sztucznej inteligencji wynika z jej pozornej biegłości w testach i egzaminach. Jednak przełomy naukowe rzadko wynikają z odpowiadania na pytania testowe; zaczynają się od dziwnych, niepełnych pomysłów wywołanych jednym słowem albo przeczuciem. Artykuł stawia praktyczne pytanie o dalekosiężnych konsekwencjach: jeśli damy dzisiejszym dużym modelom językowym tylko drobny sygnał — pojedyncze naukowe słowo-klucz — czy potrafią faktycznie burzę mózgów nad świeżymi, wiarygodnymi pomysłami badawczymi, i jak ten „iskra kreatywności” odnosi się do zwykłych miar inteligencji AI?

Od maszyn rozwiązujących testy do towarzyszy pomysłów

Większość obecnych benchmarków traktuje AI jak znakomitego ucznia: modele dostają bogaty kontekst — na przykład całe streszczenia lub opisy problemów — a potem ocenia się, czy wskazały właściwe rozwiązanie. Taki układ mierzy głównie myślenie konwergencyjne: zawężanie opcji do jednej odpowiedzi. Autorzy argumentują, że wczesne etapy pracy naukowej wyglądają zupełnie inaczej. Naukowiec często zaczyna praktycznie od niczego poza słowem-kluczem, a następnie swobodnie kojarzy dziesiątki możliwych pytań i kierunków. Aby uchwycić tego rodzaju myślenie dywergencyjne u maszyn, wprowadzają LiveIdeaBench — nowy benchmark, który celowo redukuje kontekst do jednego naukowego słowa-klucza, takiego jak „mikroskopia” czy „prognozowanie pogody”, i prosi modele o zaproponowanie krótkich, konkretnych pomysłów badawczych.

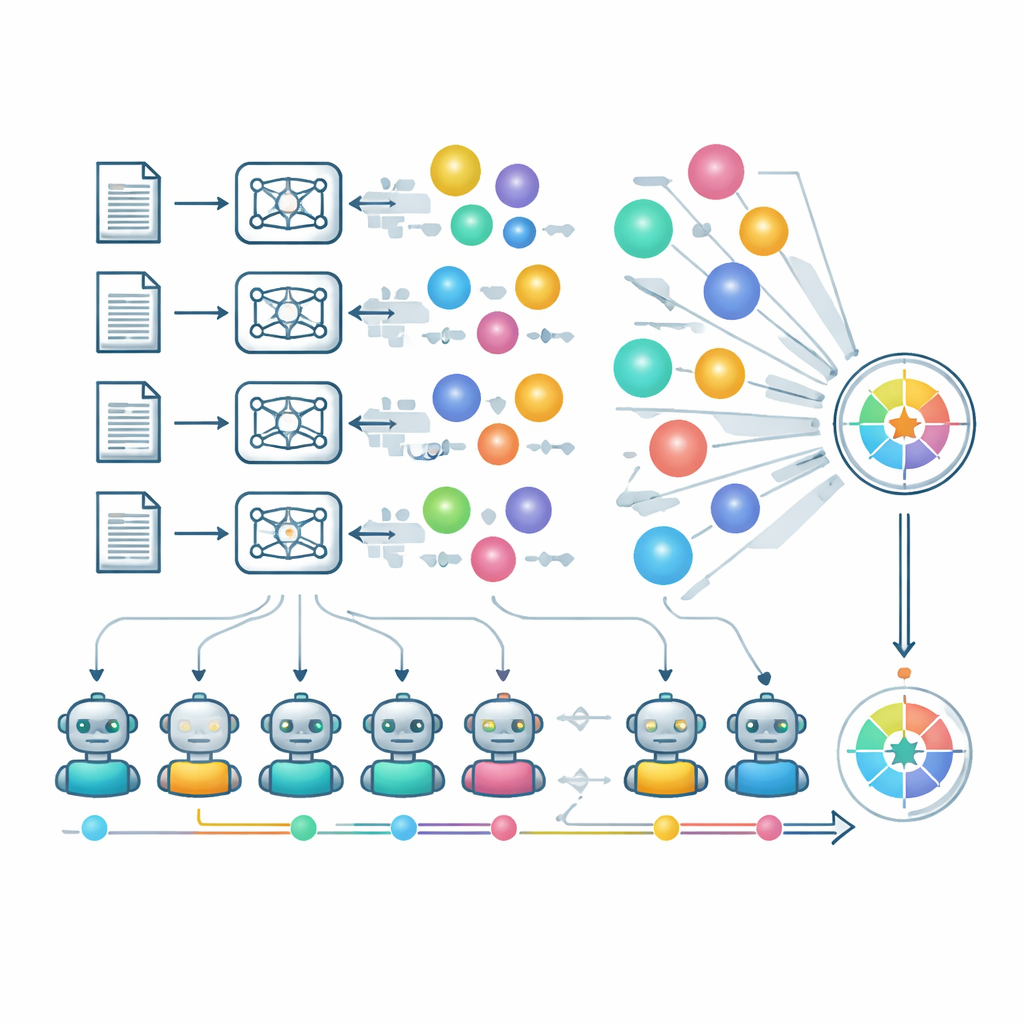

Jak działa nowy benchmark

LiveIdeaBench obejmuje 1180 popularnych słów-kluczy z 22 dziedzin, od fizyki po medycynę i nauki społeczne. Dla każdego słowa ponad 40 wiodących modeli językowych jest proszonych o wygenerowanie zwartego pomysłu naukowego. Dynamiczny panel najlepiej radzących sobie modeli działa następnie jako „sędziowie”, oceniając każdy pomysł wzdłuż pięciu wymiarów inspirowanych kreatywnością: oryginalności, wykonalności, jasności wyrażenia, liczby odrębnych pomysłów, które model potrafi wygenerować z tego samego sygnału (płynność), oraz konsekwencji wyników w bardzo różnych tematach (elastyczność). Kilku sędziów ocenia każdy pomysł, a wyniki są uśredniane, by zredukować indywidualne uprzedzenia modeli. Benchmark jest regularnie aktualizowany — zarówno pod kątem używanych słów-kluczy, jak i ocenianych modeli — aby podążać za przesuwającą się granicą współczesnej nauki i możliwości AI.

Co wyniki mówią o kreatywności AI

Testy na dużą skalę przeprowadzone przez autorów pokazują, że wyniki na LiveIdeaBench różnią się wyraźnie od rankingów na standardowych tablicach wyników „ogólnej inteligencji”. Niektóre znane modele, które błyszczą w matematyce, kodowaniu i rozumowaniu, nie radzą sobie tak dobrze w generowaniu różnorodnych, nowych pomysłów naukowych na minimalne wskazówki. Inne, o umiarkowanych wynikach ogólnych, w tym stosunkowo niewielkie modele, wykazują zaskakująco silne myślenie dywergencyjne, czasem dorównując lub przewyższając czołowe systemy w miarach związanych z kreatywnością. Badanie wykrywa także kompromis między odwagą a bezpieczeństwem pomysłów: modele proponujące bardzo oryginalne kierunki mogą mieć słabsze wyniki w wykonalności, podczas gdy inne preferują praktyczniejsze, lecz mniej zaskakujące propozycje. Co ważne, dłuższe, bardziej rozwinięte odpowiedzi nie gwarantują lepszych pomysłów; sama objętość słów jest słabo skorelowana z jakością.

Wgląd w mechanikę oceny

Aby przybliżyć recenzję ekspercką na dużą skalę, autorzy mocno polegają na „LLM jako sędziach”. Wyselekcjonowana grupa silnych modeli niezależnie ocenia oryginalność, wykonalność i jasność, a oddzielny proces sprawdza, czy wiele pomysłów z tego samego modelu i słowa-klucza rzeczywiście jest różnorodnych, a nie tylko parafrazą. Elastyczność mierzy się, obserwując, jak wyniki modelu utrzymują się w jego słabszych obszarach, nie tylko w dobrze znanych domenach. Zespół analizuje również, jak architektura, strategie treningowe i polityki bezpieczeństwa wpływają na twórcze wyniki. Modele z bardziej rygorystycznymi filtrami bezpieczeństwa czasami odmawiają odpowiedzi na pewne wrażliwe słowa-klucze, co obniża ich wyniki mimo odpowiedzialnego zachowania. Autorzy zauważają, że użycie sędziów AI niesie ze sobą ryzyka — jak schlebianie czy luki w nieznanym obszarze naukowym — ale wykazują wstępną zgodność z opiniami ludzkich ekspertów w wyspecjalizowanej dziedzinie matematyki.

Implikacje dla przyszłości wsparcia odkryć naukowych przez AI

Dla osoby nietechnicznej główny wniosek jest prosty, lecz istotny: dobre wyniki w testach nie czynią automatycznie z AI dobrego partnera do burzy mózgów nad nową nauką. Myślenie dywergencyjne — zdolność wygenerowania wielu różnych, sensownych pomysłów badawczych na podstawie pojedynczego sygnału — ujawnia się jako częściowo niezależna umiejętność, której współczesne benchmarki w dużej mierze nie uwzględniają.

Cytowanie: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Słowa kluczowe: kreatywność AI, myślenie dywergencyjne, generowanie pomysłów naukowych, duże modele językowe, benchmarking