Clear Sky Science · nl

Het beoordelen van LLMs' divergentie-denkvermogens voor het genereren van wetenschappelijke ideeën met minimale context

Waarom dit ertoe doet voor gewone wetenschapliefhebbers

Een groot deel van de opwinding rond moderne AI komt voort uit de schijnbare briljantheid op tests en examens. Maar wetenschappelijke doorbraken ontstaan zelden door quizvragen te beantwoorden; ze beginnen met vreemde, halfgevormde ideeën die worden aangewakkerd door een enkel woord of vermoeden. Dit artikel stelt een nuchtere vraag met grote gevolgen: als je de huidige grote taalmodellen slechts een klein spoor geeft—een enkel wetenschappelijk trefwoord—kunnen ze dan echt nieuwe, plausibele onderzoeksideeën bedenken, en hoe verhoudt die "creatieve vonk" zich tot de gebruikelijke maten van AI-intelligentie?

Van testoplossende machines naar ideeënpartners

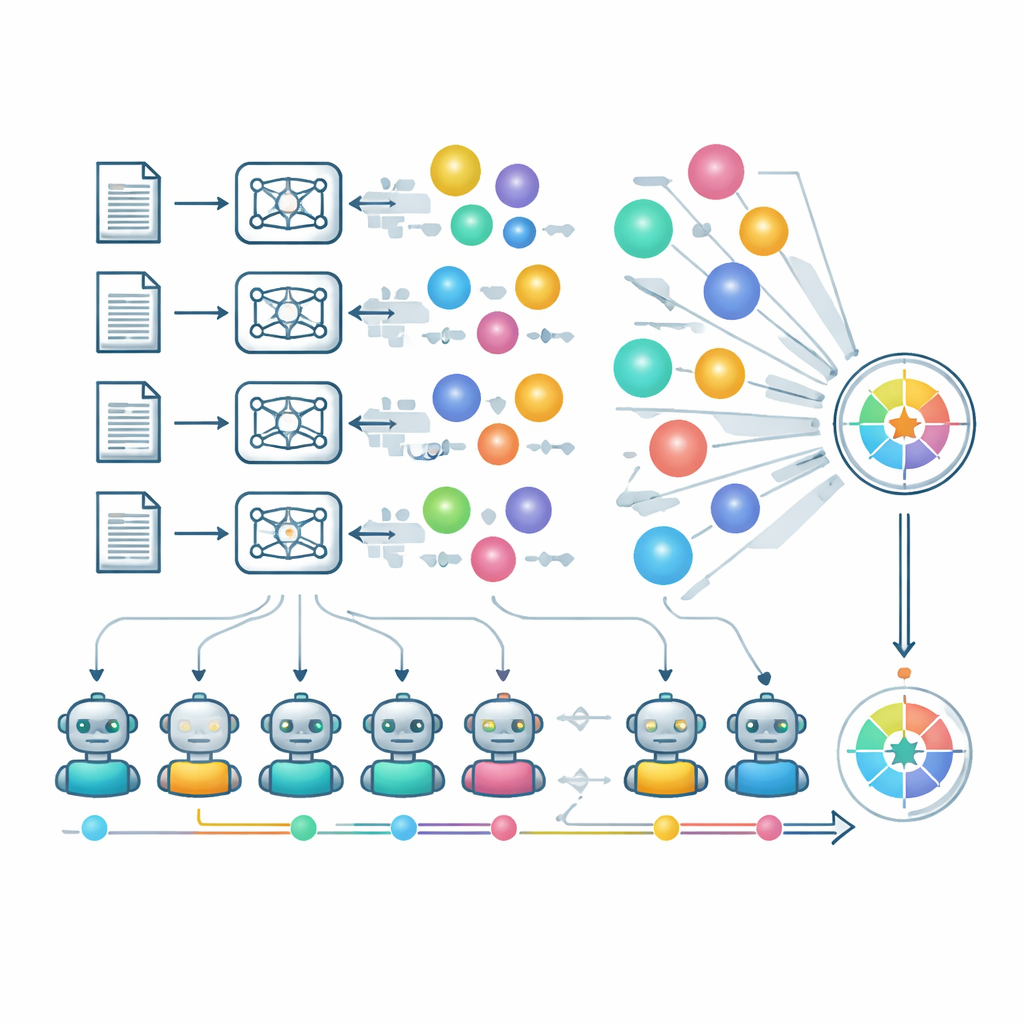

De meeste huidige benchmarks behandelen AI als een superstudent: modellen krijgen rijke context—zoals volledige abstracts of probleemomschrijvingen—en worden vervolgens beoordeeld op of ze het juiste antwoord vinden. Die opzet meet vooral convergent denken: het terugbrengen van opties tot een enkele oplossing. De auteurs betogen dat de vroege stadia van wetenschap er heel anders uitzien. Een onderzoeker begint vaak met bijna niets meer dan een onderwerpwoord en associeert vervolgens tientallen mogelijke vragen en richtingen. Om dit soort divergent denken in machines vast te leggen, presenteren ze LiveIdeaBench, een nieuwe benchmark die de context doelbewust terugbrengt tot slechts één wetenschappelijk trefwoord—zoals “microscopie” of “weervoorspelling”—en modellen vraagt korte, concrete onderzoeksideeën voor te stellen.

Hoe de nieuwe benchmark werkt

LiveIdeaBench bestrijkt 1180 populaire wetenschappelijke trefwoorden over 22 velden, van natuurkunde tot geneeskunde en sociale wetenschappen. Voor elk trefwoord wordt meer dan 40 toonaangevende taalmodellen gevraagd compacte wetenschappelijke ideeën te genereren. Een dynamische groep van topmodellen fungeert vervolgens als "keurders" die elk idee beoordelen langs vijf door creativiteit geïnspireerde dimensies: hoe origineel het is, of het haalbaar lijkt, hoe duidelijk het is geformuleerd, hoeveel verschillende ideeën het model uit dezelfde aanzet kan produceren (vlotheid), en hoe consistent het presteert over zeer verschillende onderwerpen (flexibiliteit). Meerdere keurders scoren elk idee en de scores worden gemiddeld om individuele modelbias te verminderen. De benchmark wordt regelmatig bijgewerkt, zowel in de gebruikte trefwoorden als in de geëvalueerde modellen, zodat hij de bewegende grens van actuele wetenschap en AI-capaciteit volgt.

Wat de resultaten onthullen over AI-creativiteit

De grootschalige tests van de auteurs laten zien dat prestaties op LiveIdeaBench opvallend anders ogen dan ranglijsten op standaard "algemene intelligentie" leaderboards. Sommige bekende modellen die uitblinken in wiskunde, coderen en redeneren, schitteren niet in het genereren van gevarieerde, nieuwe wetenschappelijke ideeën vanuit minimale aanwijzingen. Andere modellen met bescheidener algemene scores, waaronder relatief kleine modellen, tonen verrassend sterke divergentie-denkvermogen en evenaren soms leidende systemen op creativiteitsgerelateerde maten. De studie vindt ook een afweging tussen hoe gedurfd en hoe veilig ideeën zijn: modellen die zeer originele richtingen voorstellen kunnen zwakker scoren op haalbaarheid, terwijl andere meer praktische maar minder verrassende ideeën prefereren. Belangrijk is dat langere, meer uitgewerkte antwoorden niet betrouwbaar betere ideeën opleveren; de puur hoeveelheid woorden hangt slechts zwak samen met kwaliteit.

Een kijkje in de evaluatiemechanieken

Om expertisebeoordeling op schaal te benaderen, leunen de auteurs sterk op "LLMs als keurders." Een samengestelde groep sterke modellen beoordeelt onafhankelijk originaliteit, haalbaarheid en duidelijkheid, en een apart proces controleert of meerdere ideeën van hetzelfde model en trefwoord daadwerkelijk verschillend zijn of slechts herschrijvingen. Flexibiliteit wordt vastgelegd door te kijken hoe de scores van een model standhouden in zijn zwakkere domeinen, niet alleen in bekende vakgebieden. Het team analyseert ook hoe architectuur, trainingsstrategieën en veiligheidsbeleid de creatieve output beïnvloeden. Modellen met strengere veiligheidsfilters weigeren soms te antwoorden op bepaalde gevoelige trefwoorden, wat hun scores schaadt ondanks verantwoord gedrag. De auteurs merken op dat het gebruik van AI-keurders risico's met zich meebrengt—zoals vleierij en blinde vlekken in onbekend wetenschappelijk terrein—maar tonen voorlopige overeenstemming met menselijke experts in een gespecialiseerd wiskundedomein.

Implicaties voor de toekomst van AI-geassisteerde ontdekkingen

Voor een niet-specialist is de kernboodschap eenvoudig maar krachtig: goed zijn in tests maakt een AI niet automatisch tot een goede partner voor het bedenken van nieuwe wetenschap. Divergent denken—het vermogen om vanuit een enkele aanwijzing vele verschillende, betekenisvolle onderzoeksideeën te genereren—blijkt een deels onafhankelijke vaardigheid te zijn die huidige benchmarks grotendeels negeren.

Bronvermelding: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Trefwoorden: AI-creativiteit, divergent denken, genereren van wetenschappelijke ideeën, grote taalmodellen, benchmarking