Clear Sky Science · it

Valutare le capacità di pensiero divergente degli LLM per la generazione di idee scientifiche con contesto minimo

Perché questo conta per gli appassionati di scienza nella vita di tutti i giorni

Gran parte dell'entusiasmo attorno all'IA moderna deriva dalla sua apparente brillantezza nei test e negli esami. Ma le scoperte scientifiche raramente nascono dal rispondere a quiz; iniziano con idee strane e a metà, stimolate da una singola parola o da un'intuizione. Questo articolo pone una domanda concreta con grandi conseguenze: se si dà ai moderni large language model solo un piccolo indizio—una parola chiave scientifica isolata—possono davvero generare idee di ricerca nuove e plausibili, e come si collega quella «scintilla creativa» alle solite misure di intelligenza artificiale?

Da macchine che risolvono test a compagni di idee

La maggior parte dei benchmark attuali tratta l'IA come un super-studente: i modelli ricevono contesti ricchi—come abstract completi o descrizioni di problemi—e poi vengono valutati sul trovare la risposta corretta. Quel tipo di impostazione misura principalmente il pensiero convergente: restringere le opzioni fino a una sola soluzione. Gli autori sostengono che le fasi iniziali della ricerca scientifica siano molto diverse. Uno scienziato spesso parte con quasi nulla se non una parola tematica, e poi associa liberamente dozzine di possibili domande e direzioni. Per cogliere questo tipo di pensiero divergente nelle macchine, introducono LiveIdeaBench, un nuovo benchmark che riduce deliberatamente il contesto a una sola parola chiave scientifica—come “microscopia” o “previsioni meteorologiche”—e chiede ai modelli di proporre idee di ricerca brevi e concrete.

Come funziona il nuovo benchmark

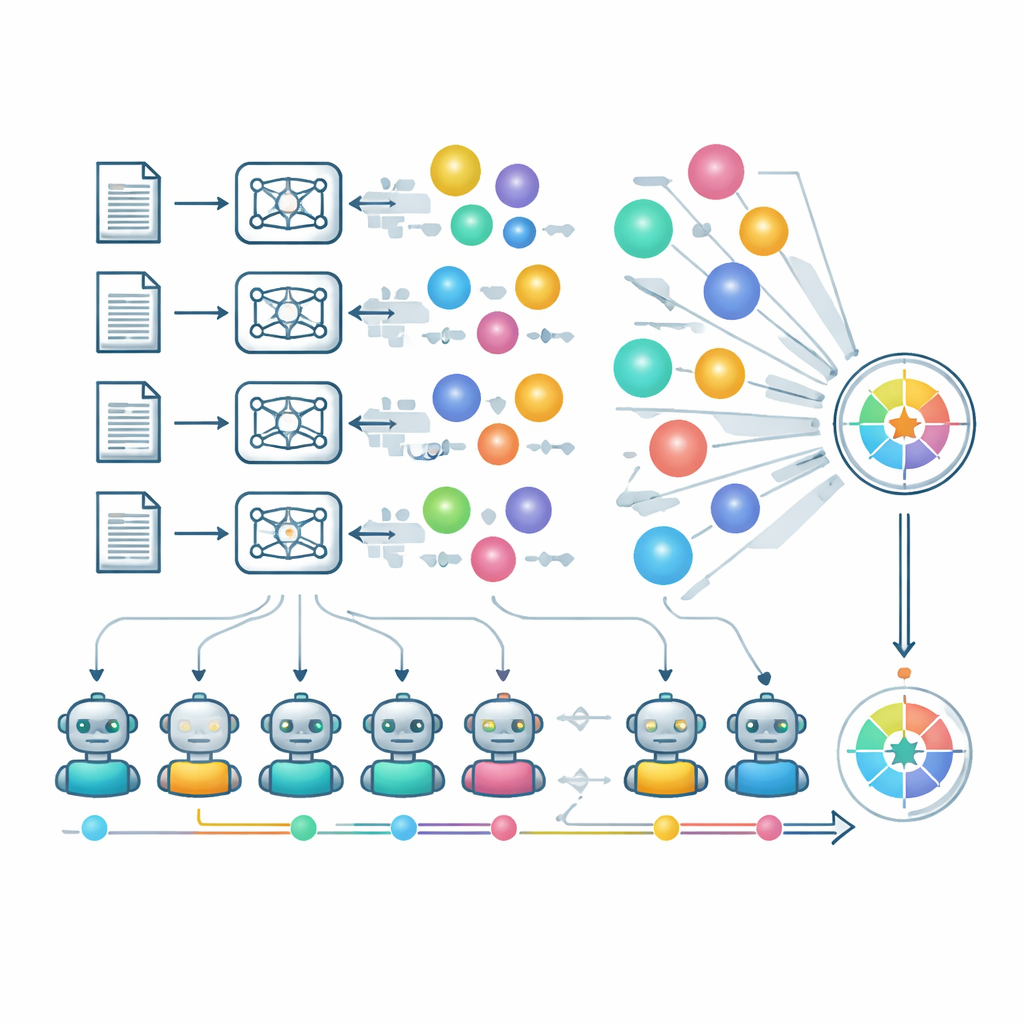

LiveIdeaBench copre 1180 parole chiave scientifiche popolari in 22 campi, dalla fisica alla medicina e alle scienze sociali. Per ciascuna parola chiave, oltre 40 modelli di linguaggio di primo piano vengono invitati a generare idee scientifiche compatte. Un panel dinamico di modelli ad alte prestazioni funge poi da «giudici» che valutano ogni idea lungo cinque dimensioni ispirate alla creatività: quanto è originale, se sembra fattibile, quanto è espressa chiaramente, quante idee distinte il modello riesce a produrre dallo stesso spunto (fluenza) e quanto coerentemente si comporta su argomenti molto diversi (flessibilità). Più giudici valutano ogni idea e i punteggi vengono mediati per ridurre i bias dei singoli modelli. Il benchmark viene aggiornato regolarmente, sia nelle parole chiave utilizzate sia nei modelli valutati, così da seguire il confine in movimento delle capacità attuali di scienza e IA.

Cosa rivelano i risultati sulla creatività dell'IA

I test su larga scala degli autori mostrano che le prestazioni su LiveIdeaBench appaiono sorprendentemente diverse dalle classifiche dei tradizionali leaderboard di «intelligenza generale». Alcuni modelli noti per eccellere in matematica, programmazione e ragionamento non brillano nel generare idee scientifiche varie e nuove a partire da prompt minimi. Altri, con punteggi generali modesti, inclusi modelli relativamente piccoli, mostrano un pensiero divergente sorprendentemente forte, a volte eguagliando o addirittura superando i sistemi leader nelle misure legate alla creatività. Lo studio individua inoltre un compromesso tra quanto le idee sono audaci e quanto sono sicure: i modelli che suggeriscono direzioni molto originali possono risultare più deboli in termini di fattibilità, mentre altri privilegiano idee più pratiche ma meno sorprendenti. È importante notare che risposte più lunghe e più elaborate non producono in modo affidabile idee migliori; la mera quantità di parole è solo debolmente correlata alla qualità.

Uno sguardo ai meccanismi di valutazione

Per approssimare la revisione esperta su larga scala, gli autori si affidano molto agli «LLM come giudici». Un gruppo selezionato di modelli potenti valuta in modo indipendente originalità, fattibilità e chiarezza, e un processo separato verifica se più idee provenienti dallo stesso modello e dalla stessa parola chiave sono davvero diverse o semplici riformulazioni. La flessibilità viene catturata osservando come i punteggi di un modello tengono nelle sue aree più deboli, non solo nei domini familiari. Il team analizza anche come architettura, strategie di addestramento e politiche di sicurezza influenzino l'output creativo. I modelli con filtri di sicurezza più severi a volte si rifiutano di rispondere per certe parole chiave sensibili, danneggiando i loro punteggi nonostante un comportamento responsabile. Gli autori osservano che usare giudici IA comporta rischi—come la sicofanzia e punti ciechi in territori scientifici poco familiari—ma mostrano un accordo preliminare con esperti umani in un dominio matematico specializzato.

Implicazioni per il futuro della scoperta assistita dall'IA

Per un non specialista, la conclusione principale è semplice ma importante: essere bravi nei test non rende automaticamente un'IA un buon partner per il brainstorming scientifico. Il pensiero divergente—la capacità di generare molte idee di ricerca diverse e significative a partire da un singolo spunto—emerge come una competenza in parte indipendente che i benchmark attuali in gran parte ignorano.

Citazione: Ruan, K., Wang, X., Hong, J. et al. Evaluating LLMs' divergent thinking capabilities for scientific idea generation with minimal context. Nat Commun 17, 3625 (2026). https://doi.org/10.1038/s41467-026-70245-1

Parole chiave: creatività dell'IA, pensiero divergente, generazione di idee scientifiche, large language model, benchmarking