Clear Sky Science · sv

AI-driven BlindSpot VisionGuide-system på Raspberry Pi för att öka självständigheten hos synskadade användare

Hjälper människor att förlita sig mindre på synen

För miljontals människor med begränsad eller ingen syn kan vardagliga uppgifter som seende personer tar för givna—att känna igen en väns ansikte, förstå vad som finns i ett rum eller helt enkelt ta del av nyheter—vara utmattande eller omöjliga utan hjälp. Denna artikel presenterar BlindSpot‑VisionGuide, ett kompakt system byggt på en kostnadseffektiv Raspberry Pi-dator som lyssnar efter röstkommandon, tittar genom en kamera och svarar med talad vägledning. Genom att omvandla visuell information till ljud i realtid syftar det till att ge synskadade användare mer självständighet hemma, på jobbet och när de är ute och rör sig.

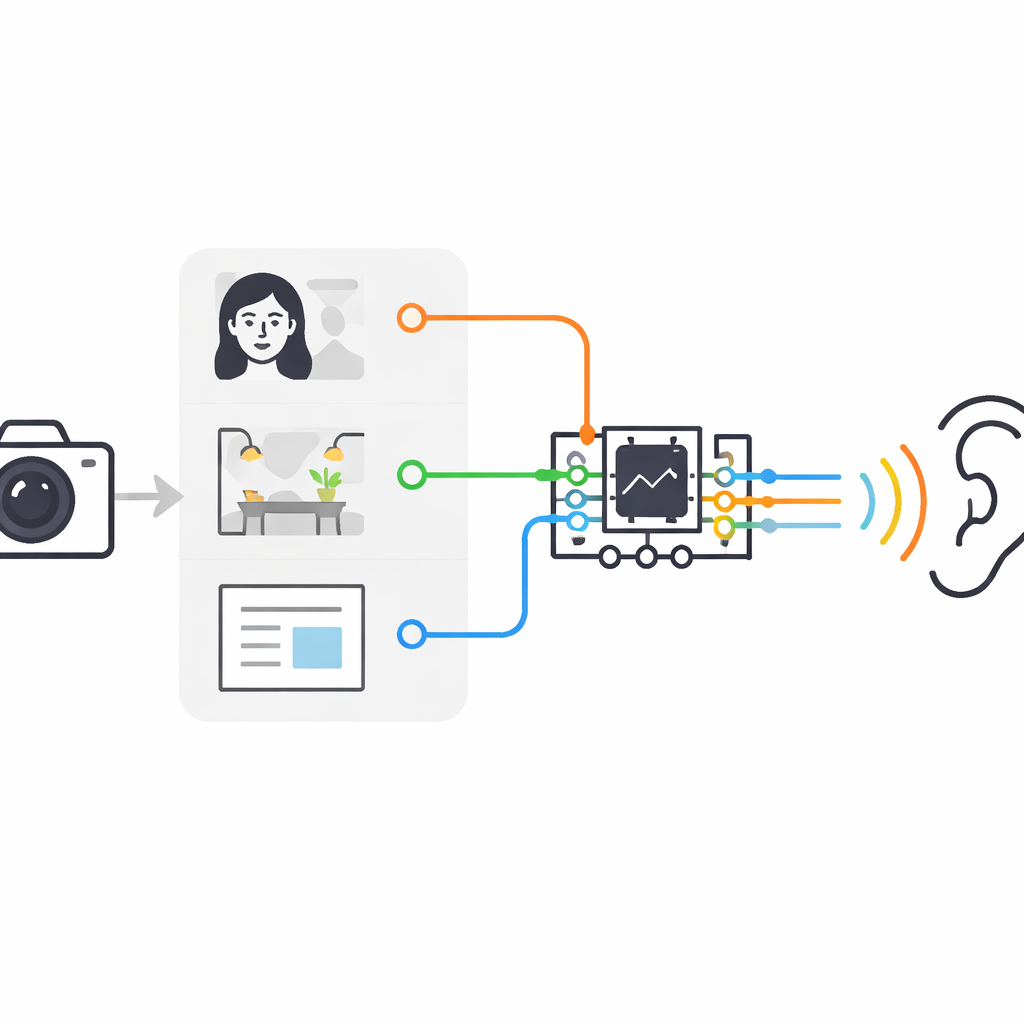

En liten låda, tre användbara funktioner

BlindSpot‑VisionGuide samlar tre huvudfunktioner i en enda enhet. För det första kan den känna igen bekanta ansikten, så att användaren kan veta vem som kommit in i rummet utan att vänta på en presentation. För det andra kan den beskriva vad kameran ser i enkelt språk, till exempel en person som sitter vid ett bord eller en fågel som vilar på ett räcke. För det tredje kan den hämta rubriker och korta sammanfattningar från nätbaserade tidningar och läsa upp dem. Allt detta körs på en Raspberry Pi 5, en kreditkortsstor dator som ofta används i hobbyprojekt, ihop med en liten kamera, mikrofon och högtalare eller hörlurar.

Tala istället för att trycka

Istället för skärmar, knappar eller beröringsgester förlitar sig systemet nästan helt på röst. Raspberry Pi lyssnar kontinuerligt efter enkla talade kommandon som ”starta ansiktsmodulen” eller ”kör tidningsmodulen”. När användaren aktiverar ansiktsigenkänning fångar kameran livevideo, mjukvaran isolerar ansikten, jämför dem med ett litet lokalt galleri med kända personer och talar sedan upp den närmaste matchningen. För scenbeskrivning får användaren en kort paus för att rikta kameran; systemet tar då en bild och skickar den genom en avancerad bild-till-text-modell som skapar en naturligt formulerad mening, vilken omvandlas till tal. För nyheter kontaktar systemet en onlinetjänst, filtrerar senaste artiklar—efter land, datum och andra alternativ—och läser sedan varje titel och sammanfattning med en jämn, tydlig röst.

Hur de smarta delarna samverkar

Bakom kulisserna lutar sig BlindSpot‑VisionGuide mot moderna AI-verktyg men använder dem på ett mycket praktiskt, ingenjörsorienterat sätt. För ansiktsigenkänning omvandlar det varje ansikte till ett kompakt numeriskt ”fingeravtryck” med hjälp av ett djupt nätverk och jämför sedan detta fingeravtryck med lagrade exempel. I tester med 20 frivilliga och 300 bilder kände det igen personer korrekt i ungefär 94 % av fallen och svarade vanligtvis på under en kvart sekund per ansikte. För bildtexter använder det en kraftfull modell kallad BLIP, som kombinerar en visuell modul och en språkmodul. Detta ger rika beskrivningar, men på den lilla Raspberry Pi krävs cirka 4,5 sekunder för att tala upp en bildtext—snabbt nog för att förstå en stillastående scen, men ännu inte för splitsekundsbeslut som att korsa en trafikerad gata. Tidningsmodulen förlitar sig på webbprogrammeringsgränssnitt snarare än sköra webbupptagningsmetoder, vilket möjliggör pålitlig åtkomst till aktuella nyheter samtidigt som mängden personlig data som skickas över nätet begränsas.

Att balansera hastighet, kraft och integritet

En central utmaning är att rymma alla tre funktionerna i en liten, lågdriftsdator utan att förlita sig på avlägsna molntjänster. Författarna behandlar detta som ett systemtekniskt problem snarare än en tävling om allt större neurala nätverk. Endast en modul körs åt gången, och de delar kamera, mikrofon och talmotor för att hålla minnesanvändning och batteriförbrukning under kontroll. Ansiktsigenkänning och scenbeskrivning fungerar helt offline när modellerna väl är lagrade på enheten, vilket hjälper till att skydda användarens integritet. Den enda regelbundna internetanvändningen är för att hämta färska nyheter, och även där kan systemet cacha artiklar så att de kan spelas upp senare utan anslutning. Användartester med 15 synskadade deltagare bedömde den övergripande användbarheten som ”utmärkt” i ett standardiserat frågeformulär, med höga uppgiftsframgångsgrader och relativt låg mental arbetsbelastning.

Vad detta betyder för vardagen

Enkelt uttryckt visar BlindSpot‑VisionGuide att en kostnadseffektiv, fickstor dator kan erbjuda en uppsättning användbara ”ögon och öron” för någon som inte kan förlita sig på synen. Den uppfinner inga nya inlärningsalgoritmer; istället visar den att befintliga verktyg för ansikte, språk och tal kan kombineras omsorgsfullt för att köras lokalt, reagera tillräckligt snabbt i många vardagssituationer och respektera användarens integritet. Systemet är ännu inte lämpligt för snabb, säkerhetskritisk navigering, och det förlitar sig fortfarande på internet för live‑nyheter och på tal enbart på engelska. Men när hårdvaruacceleratorer, snabbare modeller och flerspråkiga röster blir vanligare kan denna typ av integrerad, röststyrd låda bli en praktisk följeslagare för synskadade användare, hjälpa dem att känna igen människor, förstå sin omgivning och hålla sig informerade med mycket mindre beroende av andra.

Citering: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Nyckelord: hjälpteknik, synnedsättning, Raspberry Pi, datorseende, text-till-tal