Clear Sky Science · nl

AI-aangedreven BlindSpot VisionGuide-systeem op Raspberry Pi ter vergroting van de zelfstandigheid van slechtziende gebruikers

Mensen helpen minder van zicht afhankelijk te zijn

Voor miljoenen mensen met beperkt of geen zicht kunnen dagelijkse taken die ziende mensen vanzelfsprekend vinden — het herkennen van het gezicht van een vriend, begrijpen wat er in een kamer staat, of simpelweg het bijlezen van het nieuws — vermoeiend of onmogelijk zijn zonder hulp. Dit artikel introduceert BlindSpot‑VisionGuide, een compact systeem gebouwd op een goedkope Raspberry Pi-computer dat luistert naar spraakopdrachten, kijkt via een camera en reageert met gesproken aanwijzingen. Door visuele informatie in realtime om te zetten naar geluid, streeft het ernaar blinde en slechtziende gebruikers meer zelfstandigheid te geven thuis, op het werk en onderweg.

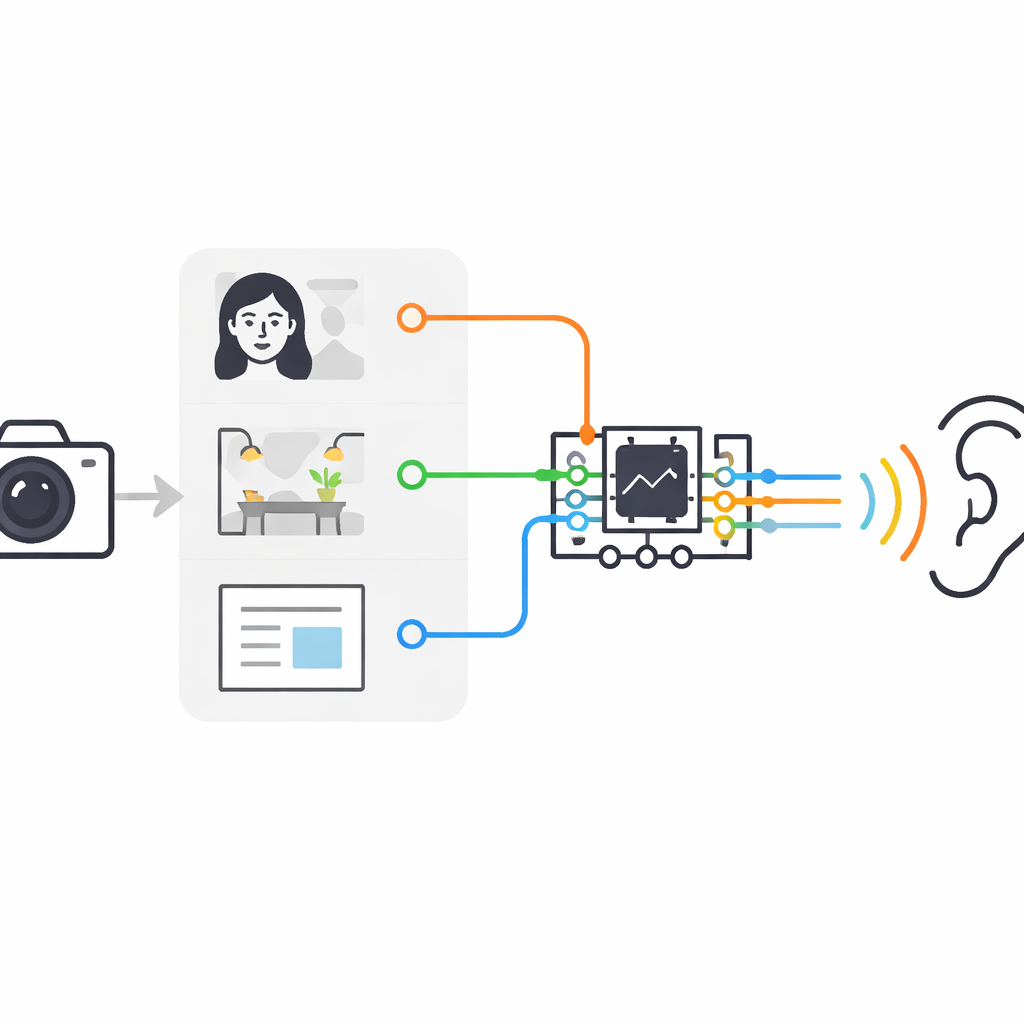

Eén klein kastje, drie nuttige mogelijkheden

BlindSpot‑VisionGuide bundelt drie hoofdvaardigheden in één apparaat. Ten eerste kan het bekende gezichten herkennen, zodat een gebruiker kan horen wie de kamer is binnengekomen zonder op een introductie te wachten. Ten tweede kan het beschrijven wat de camera ziet in gewone taal, bijvoorbeeld een persoon die aan een tafel zit of een vogel die op een leuning rust. Ten derde kan het koppen en korte samenvattingen ophalen van online kranten en die hardop voorlezen. Dit alles draait op een Raspberry Pi 5, een creditcardformaat computer die vaak in hobbyprojecten wordt gebruikt, in combinatie met een kleine camera, microfoon en luidspreker of koptelefoon.

Praten in plaats van tikken

In plaats van schermen, knoppen of aanrakingen vertrouwt het systeem vrijwel volledig op spraak. De Raspberry Pi luistert continu naar eenvoudige gesproken opdrachten zoals “start de gezichtsmodule” of “start de krantenmodule.” Wanneer de gebruiker gezichtsherkenning activeert, legt de camera live video vast, isoleert de software gezichten, vergelijkt ze met een kleine on-device galerij van bekende personen en spreekt vervolgens de dichtstbijzijnde match uit. Voor scenebeschrijving krijgt de gebruiker een korte pauze om de camera te richten; het systeem maakt dan een foto en voert die door een geavanceerd beeld-naar-tekstmodel dat een natuurlijk klinkende zin genereert, waarna die zin in spraak wordt omgezet. Voor nieuws maakt het systeem contact met een online dienst, filtert recente artikelen — op land, datum en andere opties — en leest vervolgens elke titel en samenvatting in een rustige, duidelijke stem voor.

Hoe de slimme onderdelen samenwerken

Achter de schermen leunt BlindSpot‑VisionGuide op moderne kunstmatige intelligentie, maar gebruikt die op een zeer praktische, engineeringgerichte manier. Voor gezichtsherkenning zet het elk gezicht om in een compact numeriek “vingerafdruk” met behulp van een diep netwerk en vergelijkt die vingerafdruk vervolgens met opgeslagen voorbeelden. In tests met 20 vrijwilligers en 300 afbeeldingen herkende het mensen in ongeveer 94% van de gevallen correct en gaf het doorgaans binnen een kwart seconde per gezicht een antwoord. Voor beeldonderschriften gebruikt het een krachtig model genaamd BLIP, dat een visueel module en een taalmodule combineert. Dit levert rijke beschrijvingen op, maar op de kleine Raspberry Pi heeft het ongeveer 4,5 seconden nodig om een onderschrift uit te spreken — snel genoeg om een statische scène te begrijpen, maar nog niet voor beslissingen in fracties van een seconde, zoals het oversteken van een drukke straat. De krantenmodule vertrouwt op web-API's in plaats van kwetsbare webscraping, wat betrouwbare toegang tot actuele nieuwsberichten mogelijk maakt en tegelijkertijd de hoeveelheid persoonlijke gegevens die over het netwerk wordt verzonden beperkt.

Balanceren van snelheid, energieverbruik en privacy

Een belangrijke uitdaging is het combineren van alle drie de mogelijkheden in een klein, energiezuinig systeem zonder afhankelijk te zijn van verre cloudservers. De auteurs benaderen dit als een systeemtechnisch probleem in plaats van een wedloop naar steeds grotere neurale netwerken. Slechts één module draait tegelijk, waarbij de camera, microfoon en spraakengine worden gedeeld om geheugenverbruik en batterijverlies onder controle te houden. Gezichtsherkenning en scenebeschrijving werken volledig offline zodra de modellen op het apparaat zijn opgeslagen, wat helpt de privacy van gebruikers te beschermen. Het enige regelmatige internetgebruik is het ophalen van vers nieuws, en zelfs daarbij kan het systeem artikelen cachen zodat ze later zonder verbinding opnieuw kunnen worden afgespeeld. Gebruikerstests met 15 visueel beperkte deelnemers beoordeelden de algehele bruikbaarheid als “uitstekend” op een standaardvragenlijst, met hoge succespercentages voor taken en relatief lage mentale belasting.

Wat dit betekent voor het dagelijks leven

Kort gezegd toont BlindSpot‑VisionGuide aan dat een goedkope, zakformaat computer een reeks nuttige “ogen en oren” kan bieden voor iemand die niet op zicht kan vertrouwen. Het vindt geen nieuwe leeralgoritmen uit; in plaats daarvan bewijst het dat bestaande gezichts-, taal- en spraaktools zorgvuldig kunnen worden gecombineerd om lokaal te draaien, snel genoeg te reageren voor veel alledaagse situaties en de privacy van gebruikers te respecteren. Het systeem is nog niet geschikt voor snelle, veiligheidkritische navigatie en is nog afhankelijk van internet voor live nieuws en van spraak alleen in het Engels. Maar naarmate hardwareversnellers, snellere modellen en meertalige stemmen gebruikelijker worden, zou dit soort geïntegreerde, spraakgestuurde apparaat een praktisch hulpmiddel kunnen worden voor visueel beperkte gebruikers, hen helpend mensen te herkennen, hun omgeving te begrijpen en geïnformeerd te blijven met veel minder afhankelijkheid van anderen.

Bronvermelding: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Trefwoorden: hulpmiddelen, visuele beperking, Raspberry Pi, computervisie, tekst-naar-spraak