Clear Sky Science · fr

Système BlindSpot VisionGuide piloté par IA sur Raspberry Pi pour accroître l’autonomie des personnes malvoyantes

Aider les personnes à se passer davantage de la vue

Pour des millions de personnes ayant une vision réduite ou absente, des tâches quotidiennes que les voyants tiennent pour acquises — reconnaître le visage d’un ami, comprendre ce qu’il y a dans une pièce ou simplement se tenir informé des actualités — peuvent être épuisantes ou impossibles sans aide. Cet article présente BlindSpot‑VisionGuide, un système compact bâti sur un ordinateur à faible coût Raspberry Pi qui écoute des commandes vocales, regarde via une caméra et répond par des indications parlées. En transformant l’information visuelle en son en temps réel, il vise à offrir aux personnes malvoyantes davantage d’autonomie à la maison, au travail et en déplacement.

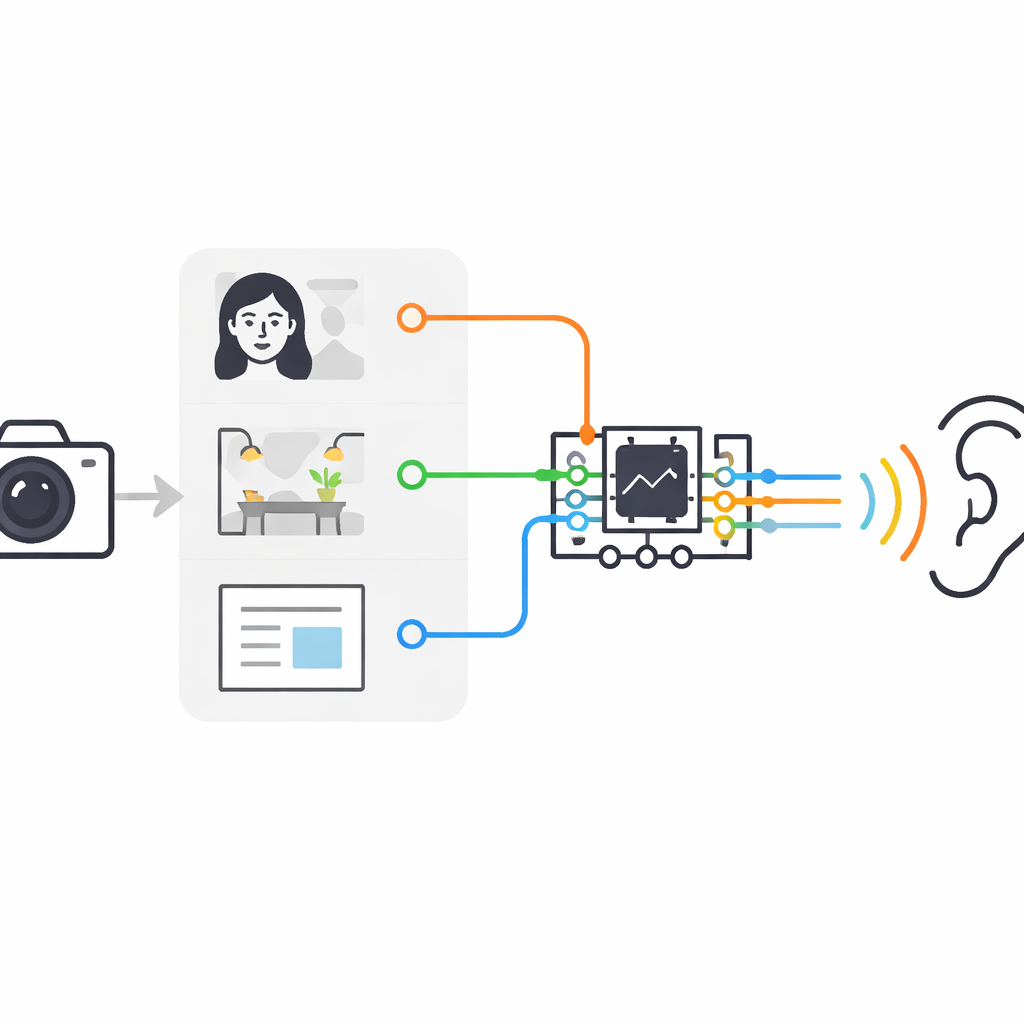

Une petite boîte, trois fonctionnalités utiles

BlindSpot‑VisionGuide regroupe trois capacités principales dans un seul appareil. D’abord, il peut reconnaître des visages familiers, permettant à l’utilisateur de savoir qui est entré dans la pièce sans attendre une présentation. Ensuite, il peut décrire en langage clair ce que la caméra voit, par exemple une personne assise à une table ou un oiseau posé sur une rambarde. Enfin, il peut récupérer des titres et courts résumés depuis des journaux en ligne et les lire à voix haute. Le tout fonctionne sur un Raspberry Pi 5, un ordinateur de la taille d’une carte de crédit souvent utilisé dans des projets amateurs, associé à une petite caméra, un microphone et un haut‑parleur ou des écouteurs.

Parler plutôt que taper

Plutôt que des écrans, des boutons ou des gestes tactiles, le système repose presque entièrement sur la voix. Le Raspberry Pi écoute en continu des commandes vocales simples comme « lancer le module visages » ou « lancer le module journal ». Lorsque l’utilisateur active la reconnaissance faciale, la caméra capture une vidéo en direct, le logiciel isole les visages éventuels, les compare à une petite galerie locale de personnes connues, puis annonce à voix haute la correspondance la plus proche. Pour la description de scène, l’utilisateur dispose d’un bref moment pour viser la caméra ; le système prend alors une photo et la transmet à un modèle avancé image‑vers‑texte qui produit une phrase au son naturel, ensuite convertie en parole. Pour les actualités, le système contacte un service en ligne, filtre les articles récents — par pays, date et autres options — puis lit chaque titre et résumé d’une voix régulière et claire.

Comment les éléments intelligents fonctionnent ensemble

Dans les coulisses, BlindSpot‑VisionGuide s’appuie sur des outils d’intelligence artificielle modernes mais les utilise de façon très pratique et orientée ingénierie. Pour la reconnaissance faciale, il convertit chaque visage en une « empreinte » numérique compacte à l’aide d’un réseau profond, puis compare cette empreinte à des exemples stockés. Lors d’essais avec 20 volontaires et 300 images, il a correctement reconnu les personnes environ 94 % du temps et répondait généralement en moins d’un quart de seconde par visage. Pour les légendes d’image, il utilise un modèle puissant appelé BLIP, qui combine un module visuel et un module linguistique. Cela produit des descriptions riches, mais sur le petit Raspberry Pi il faut environ 4,5 secondes pour énoncer une légende — assez rapide pour comprendre une scène statique, mais pas encore pour des décisions instantanées comme traverser une rue très fréquentée. Le module d’actualités s’appuie sur des interfaces de programmation web plutôt que sur un web scraping fragile, ce qui permet un accès fiable aux informations à jour tout en limitant la quantité de données personnelles envoyées sur le réseau.

Équilibrer vitesse, puissance et vie privée

Un défi majeur consiste à intégrer ces trois capacités dans un ordinateur minuscule et basse consommation sans dépendre de serveurs cloud distants. Les auteurs considèrent cela comme un problème d’ingénierie système plutôt que comme une course aux réseaux neuronaux toujours plus grands. Un seul module s’exécute à la fois, partageant la caméra, le microphone et le moteur de synthèse vocale pour maîtriser l’usage de la mémoire et la consommation de batterie. La reconnaissance faciale et la description de scène fonctionnent entièrement hors ligne une fois les modèles stockés sur l’appareil, ce qui contribue à protéger la vie privée de l’utilisateur. La seule utilisation régulière d’internet concerne la récupération des actualités fraîches, et même là le système peut mettre en cache les articles afin qu’ils puissent être rejoués ultérieurement sans connexion. Des tests utilisateurs avec 15 participants malvoyants ont évalué l’utilisabilité globale comme « excellente » sur un questionnaire standard, avec des taux de réussite des tâches élevés et une charge mentale relativement faible.

Ce que cela signifie pour la vie quotidienne

En termes simples, BlindSpot‑VisionGuide montre qu’un ordinateur peu coûteux et de la taille d’une poche peut offrir un ensemble d’« yeux et oreilles » utiles pour une personne qui ne peut pas se fier à la vision. Il n’invente pas de nouveaux algorithmes d’apprentissage ; il démontre plutôt que les outils existants de reconnaissance faciale, de langage et de synthèse vocale peuvent être soigneusement combinés pour fonctionner localement, répondre assez rapidement pour de nombreuses situations quotidiennes et respecter la vie privée de l’utilisateur. Le système n’est pas encore adapté à une navigation rapide et critique pour la sécurité, et il dépend toujours d’internet pour les actualités en direct ainsi que d’une sortie vocale uniquement en anglais. Mais à mesure que les accélérateurs matériels, les modèles plus rapides et les voix multilingues se répandront, ce type de boîtier intégré et piloté par la voix pourrait devenir un compagnon pratique pour les personnes malvoyantes, les aidant à reconnaître des personnes, comprendre leur environnement et rester informées tout en dépendant beaucoup moins des autres.

Citation: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Mots-clés: technologie d’assistance, déficience visuelle, Raspberry Pi, vision par ordinateur, texte en parole