Clear Sky Science · ja

視覚障害者の自立を高めるためのRaspberry Pi搭載AI支援 BlindSpot VisionGuide システム

視覚への依存を減らす支援

視力が限られている、または視覚を持たない何百万人もの人々にとって、友人の顔を認識する、部屋の中に何があるか把握する、あるいは単にニュースを知るといった日常の行為は、支援なしでは疲弊したり不可能だったりします。本論文は、低コストのRaspberry Piコンピュータ上に構築されたコンパクトなシステム、BlindSpot‑VisionGuideを紹介します。本システムは音声コマンドを受け付け、カメラで周囲を観察し、音声で案内を返します。視覚情報をリアルタイムで音に変換することで、家庭や職場、外出先で視覚障害のある利用者の自立性を高めることを目指します。

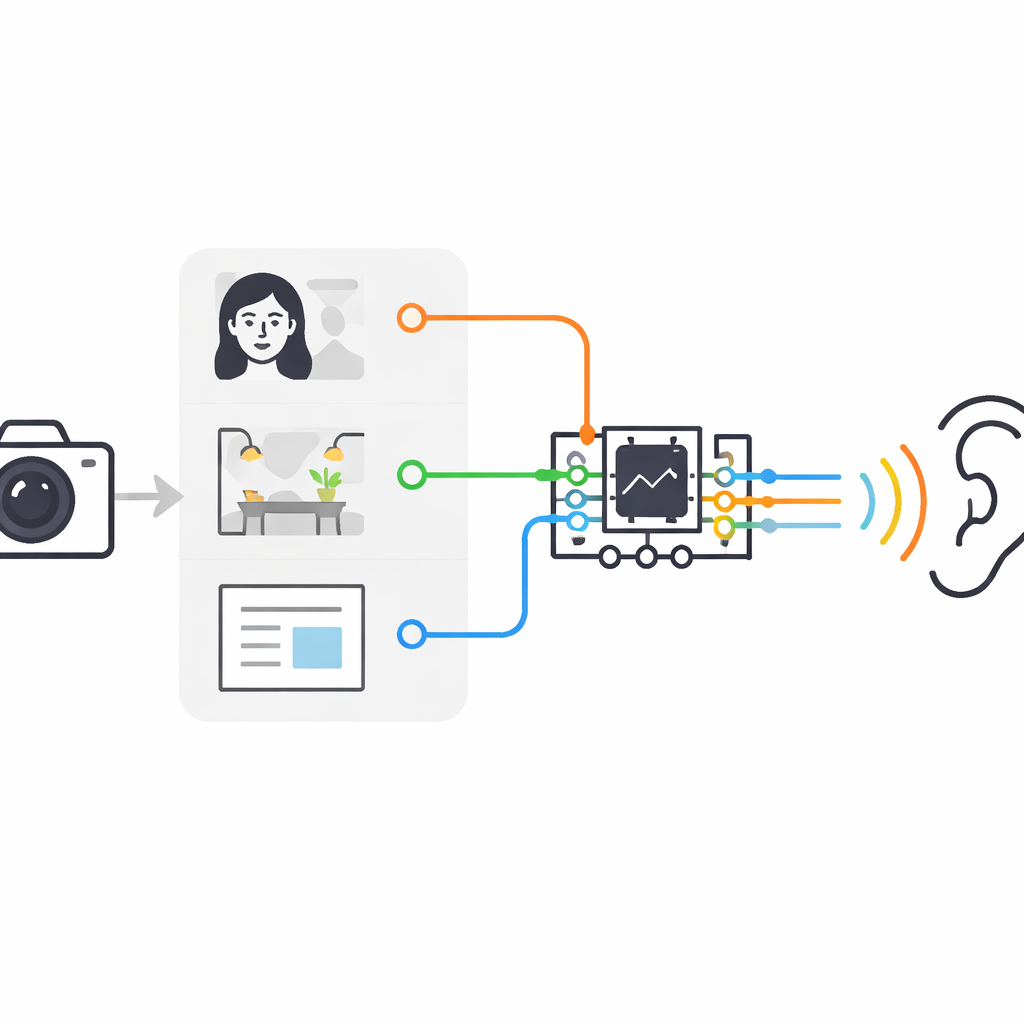

小さな箱に詰めた三つの機能

BlindSpot‑VisionGuideは三つの主要な機能を一台にまとめています。第一に、顔認識によって誰が部屋に入ってきたかを待たずに把握できます。第二に、カメラが捉えた光景を「机に座っている人」や「手すりに止まった鳥」のように平易な言葉で説明できます。第三に、オンラインの新聞から見出しや短い要約を取得して読み上げることができます。これらはすべて、ホビープロジェクトでよく使われるクレジットカード大のコンピュータであるRaspberry Pi 5と、小型カメラ、マイク、スピーカーまたはヘッドフォンを組み合わせて動作します。

タップではなく会話で操作

画面やボタン、タッチジェスチャーの代わりに、本システムはほぼ完全に音声に依存します。Raspberry Piは「顔モジュールを動かして」「新聞モジュールを実行して」のような単純な音声コマンドを常時待ち受けます。ユーザーが顔認識を起動すると、カメラがライブ映像を取得し、ソフトウェアが顔を切り出してオンデバイスの小さな既知人物ギャラリーと照合し、最も近い一致を音声で伝えます。シーン説明では、ユーザーがカメラの向け先を決めるための短い猶予を与えたのちに写真を撮り、高度な画像→テキストモデルに通して自然な文を生成し、それを音声化します。ニュースはオンラインサービスに接続して最近の記事を国別・日付別などのオプションで絞り込み、見出しと要約を落ち着いた明瞭な声で読み上げます。

各パーツが協調して働く仕組み

裏側では、BlindSpot‑VisionGuideは現代の人工知能ツールを活用していますが、それらを非常に実用的かつ工学的に配慮した方法で使用しています。顔認識では、各顔を深層ネットワークでコンパクトな数値的“指紋”に変換し、それを保存例と比較します。20人のボランティアと300枚の画像を用いた試験では、およそ94%の正答率を示し、顔一つあたり通常0.25秒未満で応答しました。画像キャプションにはBLIPと呼ばれる強力なモデルを使っており、視覚モジュールと言語モジュールを組み合わせて豊かな記述を生成します。ただし小型のRaspberry Pi上ではキャプションを音声化するのに約4.5秒を要し、静止した場面の理解には十分ですが、混雑した道路を渡るなど瞬時の判断が必要な状況にはまだ向きません。新聞モジュールは脆弱なウェブスクレイピングではなくウェブAPIを利用し、最新のニュースへ確実にアクセスしつつネットワーク上で送る個人データの量を抑えます。

速度、消費電力、プライバシーのバランス

重要な課題は、遠方のクラウドサーバーに頼らずに全三機能を小型で低消費電力のコンピュータに収めることです。著者らはこれを単なる大規模ニューラルネットワーク競争ではなくシステム工学の問題として扱っています。モジュールは同時に一つだけ動作し、カメラやマイク、音声エンジンを共有してメモリ使用量とバッテリーの消耗を抑えます。顔認識とシーン記述は一度モデルをデバイスに格納すれば完全にオフラインで動作し、利用者のプライバシーを保護します。定期的にインターネットを使うのは最新ニュースの取得だけであり、記事をキャッシュして接続なしでも再生できるようにすることも可能です。15人の視覚障害参加者を対象としたユーザーテストでは、標準的な質問票で全体の使いやすさが「優れている」と評価され、高いタスク達成率と比較的低い精神的負担が報告されました。

日常生活にとっての意義

簡潔に言えば、BlindSpot‑VisionGuideは低コストで携帯可能なコンピュータが、視覚に頼れない人にとって役立つ「目と耳」のセットを提供できることを示しています。新たな学習アルゴリズムを発明するのではなく、既存の顔認識、言語、音声ツールを注意深く組み合わせてローカル動作させることで、多くの日常場面で十分に素早く応答し、ユーザーのプライバシーを尊重できることを実証しています。本システムはまだ高速かつ安全が重要なナビゲーション用途には適しておらず、ライブニュース取得や英語のみの音声出力に依存する面も残ります。しかし、ハードウェアアクセラレータや高速モデル、多言語対応の音声が普及すれば、この種の音声駆動の統合デバイスは視覚障害者の実用的なコンパニオンとなり、他者への依存を減らして人物の認識、周囲の理解、情報取得を助ける可能性があります。

引用: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

キーワード: 支援技術, 視覚障害, Raspberry Pi, コンピュータビジョン, テキスト音声合成