Clear Sky Science · it

Sistema BlindSpot VisionGuide basato su IA su Raspberry Pi per aumentare l’indipendenza degli utenti ipovedenti

Aiutare le persone a dipendere meno dalla vista

Per milioni di persone con visione ridotta o assente, attività quotidiane che chi vede dà per scontate — riconoscere il volto di un amico, capire cosa c’è in una stanza o semplicemente aggiornarsi sulle notizie — possono essere estenuanti o impossibili senza aiuto. Questo articolo presenta BlindSpot‑VisionGuide, un sistema compatto costruito su un computer a basso costo Raspberry Pi che ascolta comandi vocali, osserva tramite una telecamera e risponde con indicazioni parlate. Trasformando le informazioni visive in suoni in tempo reale, mira a dare agli utenti ipovedenti maggiore indipendenza a casa, sul lavoro e in movimento.

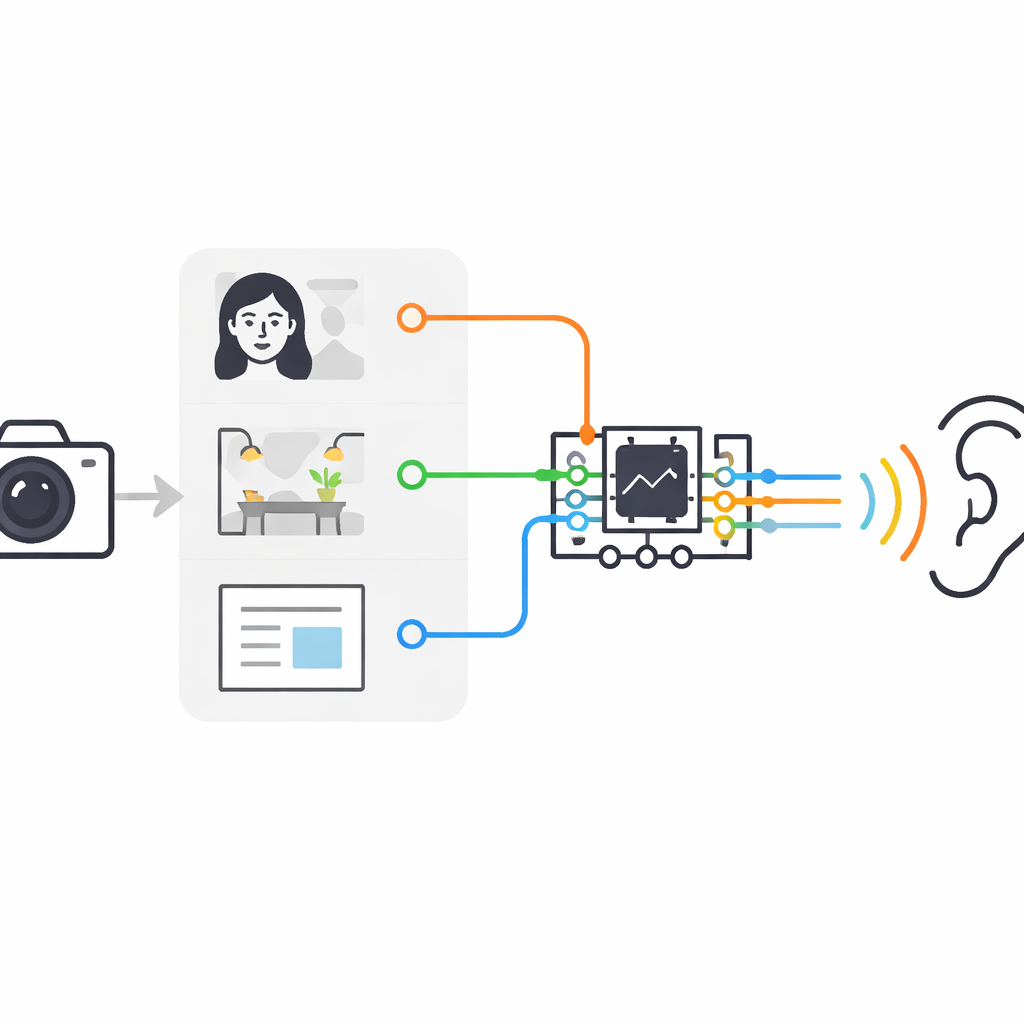

Una piccola scatola, tre capacità utili

BlindSpot‑VisionGuide raggruppa tre capacità principali in un unico dispositivo. Primo, può riconoscere volti familiari, così l’utente può sapere chi è entrato nella stanza senza dover aspettare una presentazione. Secondo, può descrivere ciò che la telecamera vede in linguaggio semplice, per esempio una persona seduta a un tavolo o un uccello appoggiato a una ringhiera. Terzo, può recuperare i titoli e brevi riassunti da giornali online e leggerli ad alta voce. Il tutto gira su un Raspberry Pi 5, un computer delle dimensioni di una carta di credito spesso usato in progetti hobbistici, abbinato a una piccola fotocamera, un microfono e un altoparlante o cuffie.

Parlare invece di toccare

Invece di schermi, pulsanti o gesti tattili, il sistema si basa quasi interamente sulla voce. Il Raspberry Pi ascolta continuamente comandi vocali semplici come “avvia il modulo volti” o “avvia il modulo notizie”. Quando l’utente attiva il riconoscimento facciale, la telecamera cattura video in diretta, il software isola eventuali volti, li confronta con una piccola galleria locale di persone conosciute e poi pronuncia la corrispondenza più vicina. Per la descrizione della scena, l’utente ha una breve pausa per mirare la telecamera; il sistema scatta quindi una foto e la passa a un avanzato modello immagine‑a‑testo che genera una frase dal suono naturale, trasformata poi in parlato. Per le notizie, il sistema contatta un servizio online, filtra articoli recenti — per paese, data e altre opzioni — e poi legge ogni titolo e riassunto con voce ferma e chiara.

Come funzionano insieme i pezzi intelligenti

Dietro le quinte, BlindSpot‑VisionGuide si appoggia a strumenti moderni di intelligenza artificiale ma li usa in modo molto pratico e orientato all’ingegneria. Per il riconoscimento facciale, converte ogni volto in un compatto “impronta” numerica usando una rete profonda e poi confronta questa impronta con esempi memorizzati. Nei test con 20 volontari e 300 immagini, ha riconosciuto correttamente le persone circa il 94% delle volte e di solito ha risposto in meno di un quarto di secondo per volto. Per le didascalie delle immagini utilizza un modello potente chiamato BLIP, che combina un modulo visivo e un modulo linguistico. Questo produce descrizioni ricche, ma sul piccolo Raspberry Pi richiede circa 4,5 secondi per pronunciare una didascalia — abbastanza veloce per comprendere una scena statica, ma non ancora per decisioni fulminee come attraversare una strada trafficata. Il modulo notizie fa affidamento su interfacce di programmazione web piuttosto che su scraping fragile, permettendo un accesso affidabile a notizie aggiornate limitando la quantità di dati personali inviati in rete.

Bilanciare velocità, consumo e privacy

Una sfida chiave è inserire tutte e tre le capacità in un computer piccolo e a basso consumo senza fare affidamento su server cloud remoti. Gli autori trattano questo come un problema di ingegneria di sistema piuttosto che una gara per reti neurali sempre più grandi. Funziona un solo modulo alla volta, condividendo telecamera, microfono ed engine di sintesi vocale per contenere l’uso di memoria e il consumo della batteria. Il riconoscimento facciale e la descrizione delle scene funzionano completamente offline una volta che i modelli sono memorizzati sul dispositivo, il che aiuta a proteggere la privacy dell’utente. L’unico uso regolare di internet è per recuperare notizie aggiornate e, anche in questo caso, il sistema può memorizzare gli articoli in cache in modo che possano essere riprodotti più tardi senza connessione. I test con 15 partecipanti ipovedenti hanno valutato l’usabilità complessiva come “eccellente” su un questionario standard, con alti tassi di successo nei compiti e carico mentale relativamente basso.

Cosa significa per la vita quotidiana

In termini semplici, BlindSpot‑VisionGuide dimostra che un computer economico e tascabile può offrire una serie di utili “occhi e orecchie” per chi non può fare affidamento sulla vista. Non inventa nuovi algoritmi di apprendimento; invece dimostra che strumenti esistenti per volti, linguaggio e parlato possono essere combinati con cura per funzionare localmente, rispondere abbastanza rapidamente per molte situazioni quotidiane e rispettare la privacy dell’utente. Il sistema non è ancora adatto alla navigazione rapida e critica per la sicurezza, e dipende ancora da internet per le notizie in tempo reale e da voce solo in inglese. Ma con la diffusione di acceleratori hardware, modelli più veloci e voci multilingue, questo tipo di scatola integrata e pilotata dalla voce potrebbe diventare un compagno pratico per utenti ipovedenti, aiutandoli a riconoscere le persone, capire l’ambiente circostante e restare informati con molta meno dipendenza dagli altri.

Citazione: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Parole chiave: tecnologia assistiva, disabilità visiva, Raspberry Pi, computer vision, text-to-speech