Clear Sky Science · ru

Система BlindSpot VisionGuide на Raspberry Pi с поддержкой ИИ для повышения самостоятельности людей с нарушениями зрения

Помогая людям меньше полагаться на зрение

Для миллионов людей с частичной или полной потерей зрения повседневные задачи, которые зрячие считают само собой разумеющимся — узнать лицо друга, понять, что находится в комнате, или просто узнать последние новости — могут быть утомительными или невозможными без посторонней помощи. В этой статье представлена BlindSpot‑VisionGuide, компактная система на недорогом компьютере Raspberry Pi, которая слушает голосовые команды, «смотрит» через камеру и отвечает устной подсказкой. Преобразуя визуальную информацию в звук в реальном времени, она призвана дать людям с нарушениями зрения большую самостоятельность дома, на работе и в поездках.

Один маленький блок — три полезные функции

BlindSpot‑VisionGuide объединяет три основные функции в одном устройстве. Во‑первых, оно умеет распознавать знакомые лица, чтобы пользователь мог понять, кто вошёл в комнату, не дожидаясь представления. Во‑вторых, оно может описывать то, что видит камера, простыми словами — например, «человек сидит за столом» или «птица сидит на перилах». В‑третьих, оно может получать заголовки и краткие сводки из онлайн‑газет и зачитывать их вслух. Всё это работает на Raspberry Pi 5 — компьютере размером с кредитную карту, часто используемом в любительских проектах — в паре с небольшой камерой, микрофоном и динамиком или наушниками.

Говорить вместо нажатий

Вместо экранов, кнопок или сенсорных жестов система практически полностью полагается на голос. Raspberry Pi постоянно слушает простые голосовые команды, такие как «запусти модуль распознавания лиц» или «запусти модуль новостей». Когда пользователь активирует распознавание лиц, камера захватывает видеопоток, программное обеспечение выделяет лица, сопоставляет их с небольшой локальной галереей известных людей и затем озвучивает наиболее подходящее совпадение. Для описания сцены пользователь получает короткую паузу, чтобы навести камеру; система делает снимок и пропускает его через продвинутую модель «изображение‑в‑текст», которая формирует естественно звучащее предложение, а затем превращает его в речь. Для новостей система обращается к онлайн‑сервису, фильтрует свежие статьи — по стране, дате и другим параметрам — и зачитывает каждый заголовок и сводку ровным, понятным голосом.

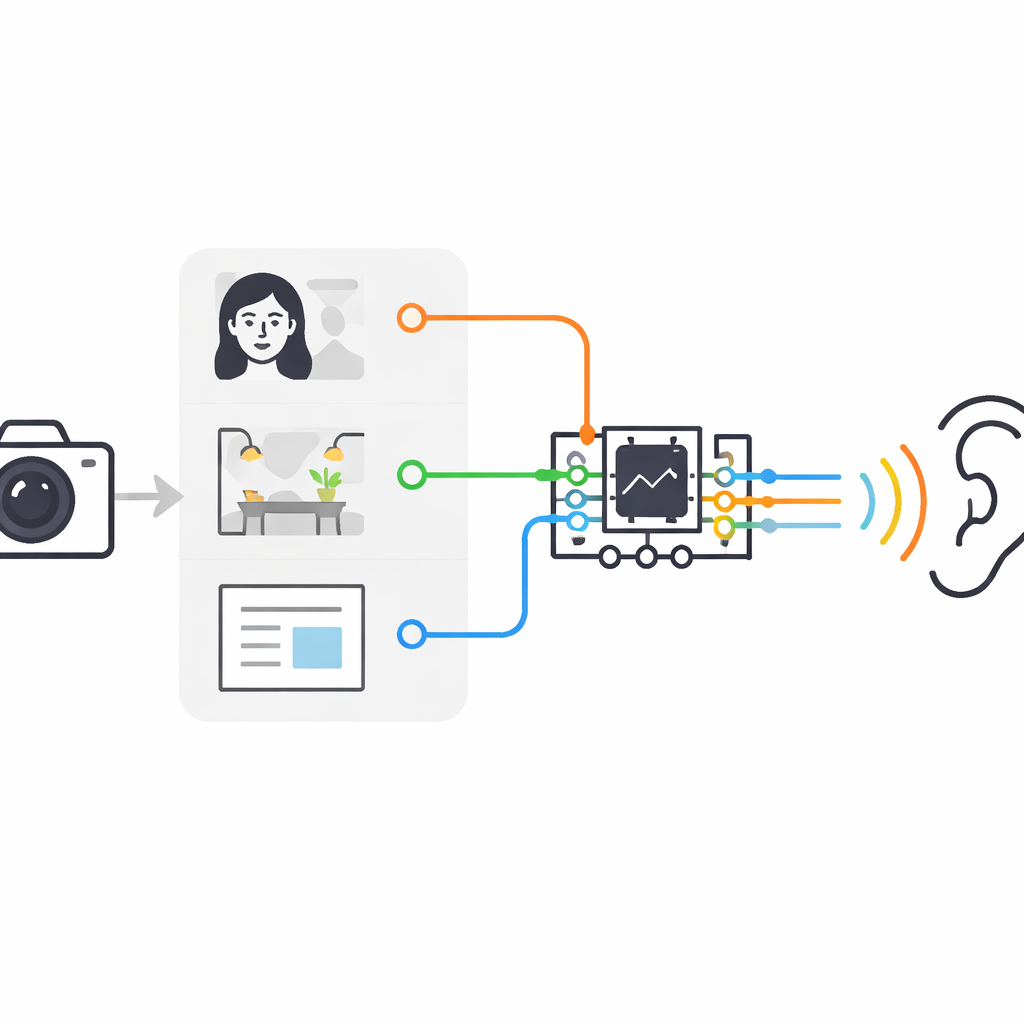

Как умные части работают вместе

За кулисами BlindSpot‑VisionGuide опирается на современные инструменты искусственного интеллекта, но использует их очень практично, с инженерной точки зрения. Для распознавания лиц каждое лицо преобразуется в компактный числовой «отпечаток» с помощью глубокой нейронной сети, который затем сравнивается с сохранёнными примерами. В испытаниях с 20 добровольцами и 300 изображениями система правильно распознавала людей примерно в 94% случаев и обычно отвечала менее чем за четверть секунды на одно лицо. Для описания изображений используется мощная модель под названием BLIP, которая объединяет модуль зрения и языковой модуль. Это даёт богатые описания, но на небольшом Raspberry Pi генерация и озвучивание подписи занимает около 4,5 секунд — достаточно быстро для понимания статичной сцены, но ещё недостаточно для молниеносных решений, например при переходе оживлённой улицы. Модуль новостей полагается на веб‑интерфейсы программирования, а не на хрупкий веб‑скрейпинг, что обеспечивает надёжный доступ к актуальным новостям при ограничении объёма персональных данных, отправляемых по сети.

Баланс между скоростью, энергопотреблением и конфиденциальностью

Ключевая задача — уместить все три функции в крошечном энергоэффективном компьютере без опоры на удалённые облачные серверы. Авторы рассматривают это как проблему системной инженерии, а не гонку за всё более крупными нейронными сетями. Одновременно работает только один модуль, при этом они совместно используют камеру, микрофон и речевой движок, чтобы держать использование памяти и расход батареи под контролем. Распознавание лиц и описание сцен работают полностью офлайн после загрузки моделей на устройство, что помогает защищать приватность пользователей. Единое регулярное обращение в интернет требуется для получения свежих новостей, причём система может кэшировать статьи, чтобы их можно было воспроизвести позже без подключения. Пользовательские испытания с 15 участниками с нарушениями зрения оценили общую удобство использования как «отличное» по стандартной анкете, с высоким уровнем выполнения задач и относительно небольшой умственной нагрузкой.

Что это значит для повседневной жизни

Проще говоря, BlindSpot‑VisionGuide демонстрирует, что недорогой карманный компьютер может предложить набор полезных «глаз и ушей» для человека, который не может полагаться на зрение. Он не изобретает новые алгоритмы обучения; вместо этого он доказывает, что существующие инструменты для распознавания лиц, работы с языком и синтеза речи можно тщательно объединить для локальной работы, обеспечения достаточно быстрой реакции в многих повседневных ситуациях и уважения приватности пользователя. Система пока не годится для быстрого навигационного использования, критичного с точки зрения безопасности, и по‑прежнему зависит от интернета для живых новостей и от речи только на английском языке. Но по мере появления аппаратных ускорителей, более быстрых моделей и многоязычных голосов такого рода интегрированное голосовое устройство может стать практичным компаньоном для людей с нарушениями зрения, помогая им узнавать людей, понимать окружение и оставаться в курсе новостей с гораздо меньшей зависимостью от других.

Цитирование: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Ключевые слова: технологии помощи, нарушение зрения, Raspberry Pi, компьютерное зрение, текст-в-речь