Clear Sky Science · es

Sistema BlindSpot VisionGuide con IA en Raspberry Pi para aumentar la independencia de personas con discapacidad visual

Ayudar a que las personas dependan menos de la vista

Para millones de personas con visión reducida o nula, las tareas cotidianas que la gente con visión da por sentadas —reconocer la cara de un amigo, entender qué hay en una habitación o simplemente ponerse al día con las noticias— pueden resultar agotadoras o imposibles sin ayuda. Este artículo presenta BlindSpot‑VisionGuide, un sistema compacto construido sobre un ordenador de bajo coste Raspberry Pi que escucha comandos de voz, observa a través de una cámara y responde con orientación hablada. Al convertir la información visual en sonido en tiempo real, pretende otorgar a las personas con discapacidad visual más independencia en el hogar, en el trabajo y en movimiento.

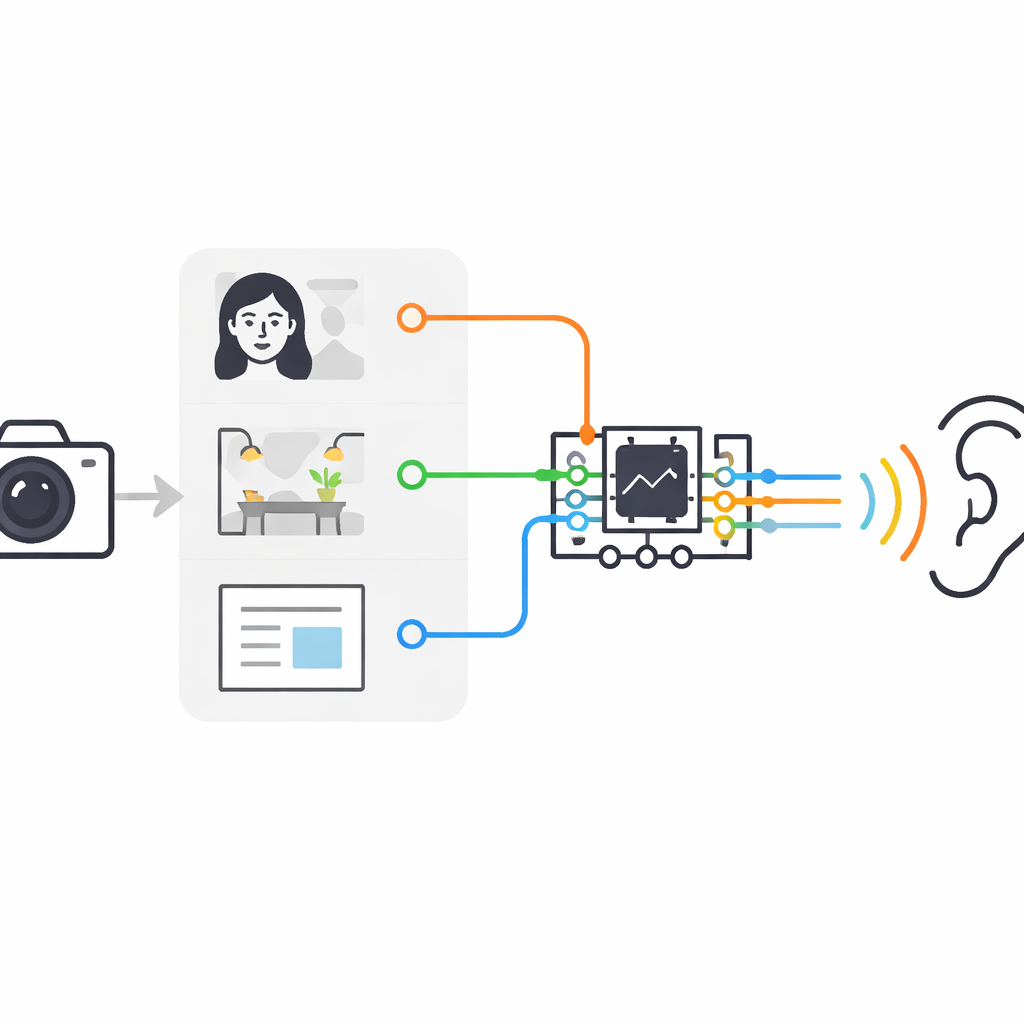

Una caja pequeña, tres capacidades útiles

BlindSpot‑VisionGuide agrupa tres capacidades principales en un solo dispositivo. Primero, puede reconocer rostros familiares, de modo que el usuario pueda saber quién ha entrado en la habitación sin esperar una presentación. Segundo, puede describir en lenguaje llano lo que la cámara ve, por ejemplo una persona sentada en una mesa o un pájaro posado en una barandilla. Tercero, puede obtener titulares y resúmenes breves de periódicos en línea y leerlos en voz alta. Todo esto se ejecuta en una Raspberry Pi 5, un ordenador del tamaño de una tarjeta de crédito usado a menudo en proyectos de afición, emparejado con una pequeña cámara, micrófono y altavoz o auriculares.

Hablar en lugar de tocar

En lugar de pantallas, botones o gestos táctiles, el sistema se basa casi por completo en la voz. La Raspberry Pi escucha continuamente comandos hablados sencillos como “ejecutar el módulo de rostros” o “ejecutar el módulo de periódico”. Cuando el usuario activa el reconocimiento facial, la cámara captura vídeo en vivo, el software aísla las caras, las compara con una pequeña galería local de personas conocidas y luego anuncia en voz alta la coincidencia más cercana. Para la descripción de la escena, el usuario dispone de una breve pausa para apuntar la cámara; el sistema toma entonces una foto y la procesa con un avanzado modelo de imagen a texto que genera una frase de sonido natural, que se convierte en habla. Para las noticias, el sistema contacta con un servicio en línea, filtra artículos recientes —por país, fecha y otras opciones— y luego lee cada título y resumen con una voz clara y constante.

Cómo funcionan juntas las piezas inteligentes

Tras bambalinas, BlindSpot‑VisionGuide se apoya en herramientas modernas de inteligencia artificial pero las utiliza de una manera muy práctica y centrada en la ingeniería. Para el reconocimiento facial, convierte cada rostro en una compacta “huella” numérica mediante una red profunda y luego compara esa huella con ejemplos almacenados. En pruebas con 20 voluntarios y 300 imágenes, reconoció correctamente a las personas en aproximadamente el 94% de los casos y normalmente respondió en menos de un cuarto de segundo por rostro. Para los subtítulos de imagen, usa un modelo potente llamado BLIP, que combina un módulo de visión y un módulo de lenguaje. Esto produce descripciones ricas, pero en la pequeña Raspberry Pi necesita alrededor de 4,5 segundos para pronunciar un subtítulo —lo bastante rápido para entender una escena estática, pero aún no para decisiones de fracción de segundo como cruzar una calle muy concurrida. El módulo de periódicos se basa en interfaces de programación web en lugar de en frágiles técnicas de scraping, lo que permite acceder de forma fiable a noticias actualizadas mientras limita la cantidad de datos personales enviados por la red.

Equilibrar velocidad, consumo y privacidad

Un reto clave es encajar las tres capacidades en un ordenador diminuto y de bajo consumo sin depender de servidores remotos en la nube. Los autores tratan esto como un problema de ingeniería de sistemas en lugar de una carrera por redes neuronales cada vez mayores. Solo un módulo se ejecuta a la vez, compartiendo la cámara, el micrófono y el motor de voz para mantener bajo el uso de memoria y el consumo de batería. El reconocimiento facial y la descripción de escena funcionan totalmente sin conexión una vez que los modelos están almacenados en el dispositivo, lo que ayuda a proteger la privacidad del usuario. El único uso regular de Internet es para obtener noticias frescas, y aún en ese caso el sistema puede almacenar en caché los artículos para que puedan reproducirse más tarde sin conexión. Las pruebas con 15 participantes con discapacidad visual calificaron la usabilidad general como “excelente” en un cuestionario estándar, con altas tasas de éxito en las tareas y una carga mental relativamente baja.

Qué significa esto para la vida cotidiana

En términos sencillos, BlindSpot‑VisionGuide demuestra que un ordenador de bajo coste y tamaño de bolsillo puede ofrecer un conjunto de “ojos y oídos” útiles para quien no puede confiar en la visión. No inventa nuevos algoritmos de aprendizaje; en su lugar, demuestra que las herramientas existentes de reconocimiento facial, lenguaje y voz pueden combinarse cuidadosamente para ejecutarse localmente, responder con la suficiente rapidez para muchas situaciones cotidianas y respetar la privacidad del usuario. El sistema aún no es adecuado para una navegación rápida y crítica para la seguridad, y sigue dependiendo de Internet para noticias en directo y de una voz en inglés únicamente. Pero a medida que los aceleradores de hardware, los modelos más rápidos y las voces multilingües se hagan más comunes, este tipo de caja integrada y controlada por voz podría convertirse en un compañero práctico para usuarios con discapacidad visual, ayudándoles a reconocer personas, comprender su entorno y mantenerse informados con mucha menos dependencia de terceros.

Cita: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Palabras clave: tecnología asistencial, discapacidad visual, Raspberry Pi, visión por computador, texto a voz