Clear Sky Science · pt

Sistema BlindSpot VisionGuide com IA em Raspberry Pi para aumentar a independência de usuários com deficiência visual

Ajudando Pessoas a Depender Menos da Visão

Para milhões de pessoas com visão limitada ou ausente, tarefas cotidianas que pessoas videntes consideram simples — reconhecer o rosto de um amigo, entender o que há em uma sala ou simplesmente se atualizar nas notícias — podem ser exaustivas ou impossíveis sem ajuda. Este artigo apresenta o BlindSpot‑VisionGuide, um sistema compacto construído sobre um computador de baixo custo Raspberry Pi que escuta comandos de voz, observa com uma câmera e responde com orientação falada. Ao transformar informação visual em som em tempo real, ele busca conferir mais independência a usuários com deficiência visual em casa, no trabalho e em deslocamentos.

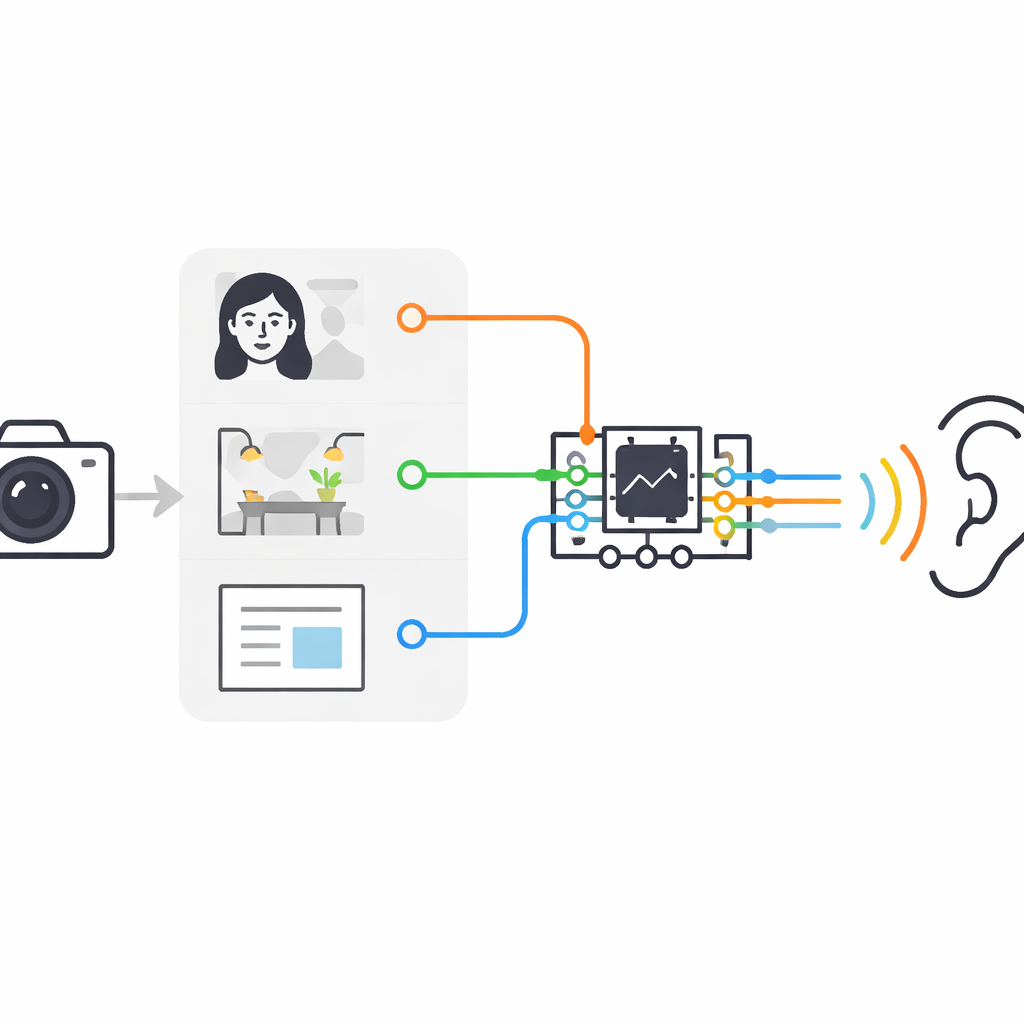

Uma Caixa Pequena, Três Capacidades Úteis

O BlindSpot‑VisionGuide reúne três capacidades principais em um único dispositivo. Primeiro, ele pode reconhecer rostos familiares, permitindo que o usuário saiba quem entrou na sala sem esperar por uma apresentação. Segundo, ele consegue descrever o que a câmera enxerga em linguagem comum, como uma pessoa sentada à mesa ou um pássaro pousado em uma grade. Terceiro, ele pode buscar manchetes e resumos curtos de jornais online e lê‑los em voz alta. Tudo isso roda em um Raspberry Pi 5, um computador do tamanho de um cartão de crédito comumente usado em projetos amadores, emparelhado com uma pequena câmera, microfone e alto‑falante ou fone de ouvido.

Falando em Vez de Tocar

Em vez de telas, botões ou gestos de toque, o sistema depende quase inteiramente da voz. O Raspberry Pi escuta continuamente por comandos de voz simples como “executar módulo de rosto” ou “executar módulo de jornais”. Quando o usuário aciona o reconhecimento facial, a câmera captura vídeo ao vivo, o software isola quaisquer rostos, compara‑os com uma pequena galeria local de pessoas conhecidas e então anuncia a correspondência mais próxima. Para descrição de cena, o usuário tem uma breve pausa para apontar a câmera; o sistema então tira uma foto e a processa por um avançado modelo de imagem‑para‑texto que gera uma frase de sonoridade natural, convertida em fala. Para notícias, o sistema contata um serviço online, filtra artigos recentes — por país, data e outras opções — e depois lê cada título e resumo em voz firme e clara.

Como as Peças Inteligentes Trabalham Juntas

Nos bastidores, o BlindSpot‑VisionGuide apoia‑se em ferramentas modernas de inteligência artificial, mas as usa de forma prática e com foco em engenharia. Para reconhecimento facial, ele converte cada rosto em uma “impressão” numérica compacta usando uma rede profunda e então compara essa impressão com exemplos armazenados. Em testes com 20 voluntários e 300 imagens, reconheceu corretamente as pessoas cerca de 94% das vezes e tipicamente respondeu em menos de um quarto de segundo por rosto. Para legendas de imagem, utiliza um modelo potente chamado BLIP, que combina um módulo de visão e um módulo de linguagem. Isso produz descrições ricas, mas no pequeno Raspberry Pi leva cerca de 4,5 segundos para falar uma legenda — rápido o bastante para entender uma cena estática, porém ainda insuficiente para decisões de fração de segundo como atravessar uma rua movimentada. O módulo de jornais baseia‑se em interfaces de programação web em vez de raspagem frágil de sites, permitindo acesso confiável a notícias atualizadas enquanto limita a quantidade de dados pessoais enviados pela rede.

Equilibrando Velocidade, Energia e Privacidade

Um desafio central é acomodar as três capacidades em um computador pequeno e de baixo consumo sem depender de servidores em nuvem distantes. Os autores tratam isso como um problema de engenharia de sistemas em vez de uma corrida por redes neurais cada vez maiores. Apenas um módulo é executado por vez, compartilhando a câmera, o microfone e o motor de fala para manter o uso de memória e o consumo de bateria sob controle. Reconhecimento facial e descrição de cena funcionam totalmente offline uma vez que os modelos estão armazenados no dispositivo, o que ajuda a proteger a privacidade do usuário. O único uso regular da internet é para buscar notícias recentes, e mesmo aí o sistema pode armazenar em cache os artigos para que sejam reproduzidos depois sem conexão. Testes com 15 participantes com deficiência visual avaliaram a usabilidade geral como “excelente” em um questionário padrão, com altas taxas de sucesso nas tarefas e carga mental relativamente baixa.

O Que Isso Significa para o Dia a Dia

Em termos simples, o BlindSpot‑VisionGuide demonstra que um computador de baixo custo e tamanho de bolso pode oferecer um conjunto útil de “olhos e ouvidos” para alguém que não pode confiar na visão. Ele não inventa novos algoritmos de aprendizagem; em vez disso, prova que ferramentas existentes de rosto, linguagem e fala podem ser cuidadosamente combinadas para rodar localmente, responder rápido o suficiente para muitas situações cotidianas e respeitar a privacidade do usuário. O sistema ainda não é adequado para navegação rápida e crítica para segurança, e continua dependendo da internet para notícias ao vivo e de fala apenas em inglês. Mas à medida que aceleradores de hardware, modelos mais rápidos e vozes multilíngues se tornarem mais comuns, esse tipo de caixa integrada e controlada por voz poderá se tornar um companheiro prático para usuários com deficiência visual, ajudando‑os a reconhecer pessoas, entender o ambiente e manter‑se informados com muito menos dependência de terceiros.

Citação: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Palavras-chave: tecnologia assistiva, deficiência visual, Raspberry Pi, visão computacional, texto para fala