Clear Sky Science · pl

System BlindSpot VisionGuide zasilany sztuczną inteligencją na Raspberry Pi zwiększający niezależność osób niewidomych

Pomagając ludziom mniej polegać na wzroku

Dla milionów osób z ograniczonym lub całkowitym brakiem wzroku codzienne czynności, które widzący biorą za pewnik — rozpoznanie twarzy znajomego, zorientowanie się, co znajduje się w pomieszczeniu, czy po prostu zapoznanie się z wiadomościami — mogą być wyczerpujące lub niemożliwe bez pomocy. Artykuł przedstawia BlindSpot‑VisionGuide, kompaktowy system zbudowany na niedrogim komputerze Raspberry Pi, który nasłuchuje poleceń głosowych, obserwuje przez kamerę i odpowiada mówionymi wskazówkami. Przekształcając informacje wizualne w dźwięk w czasie rzeczywistym, ma na celu zapewnienie osobom z zaburzeniami wzroku większej niezależności w domu, w pracy i w podróży.

Jedno małe pudełko, trzy przydatne możliwości

BlindSpot‑VisionGuide łączy trzy główne funkcje w jednym urządzeniu. Po pierwsze, potrafi rozpoznawać znane twarze, dzięki czemu użytkownik może dowiedzieć się, kto wszedł do pokoju, bez czekania na przedstawienie. Po drugie, potrafi opisać to, co widzi kamera, prostym językiem — na przykład: osoba siedząca przy stole albo ptak odpoczywający na poręczy. Po trzecie, potrafi pobierać nagłówki i krótkie streszczenia z internetowych gazet i odczytywać je na głos. Wszystko to działa na Raspberry Pi 5, komputerze wielkości karty kredytowej często używanym w projektach hobbystycznych, w połączeniu z małą kamerą, mikrofonem i głośnikiem lub słuchawkami.

Mówienie zamiast dotyku

Zamiast ekranów, przycisków czy gestów dotykowych system polega niemal wyłącznie na głosie. Raspberry Pi nieprzerwanie nasłuchuje prostych poleceń mówionych, takich jak „uruchom moduł twarzy” czy „uruchom moduł gazet”. Gdy użytkownik wywoła rozpoznawanie twarzy, kamera rejestruje obraz wideo na żywo, oprogramowanie izoluje wszelkie twarze, porównuje je z małą, zapisową galerią znanych osób na urządzeniu, a następnie wypowiada najbliższe dopasowanie. W przypadku opisu sceny użytkownik ma krótką pauzę na ustawienie kamery; system robi zdjęcie i przetwarza je za pomocą zaawansowanego modelu obraz‑do‑tekstu, który tworzy naturalnie brzmiące zdanie, przekształcane potem na mowę. W module wiadomości system łączy się z usługą online, filtruje ostatnie artykuły — według kraju, daty i innych opcji — a następnie czyta każdy tytuł i streszczenie równym, wyraźnym głosem.

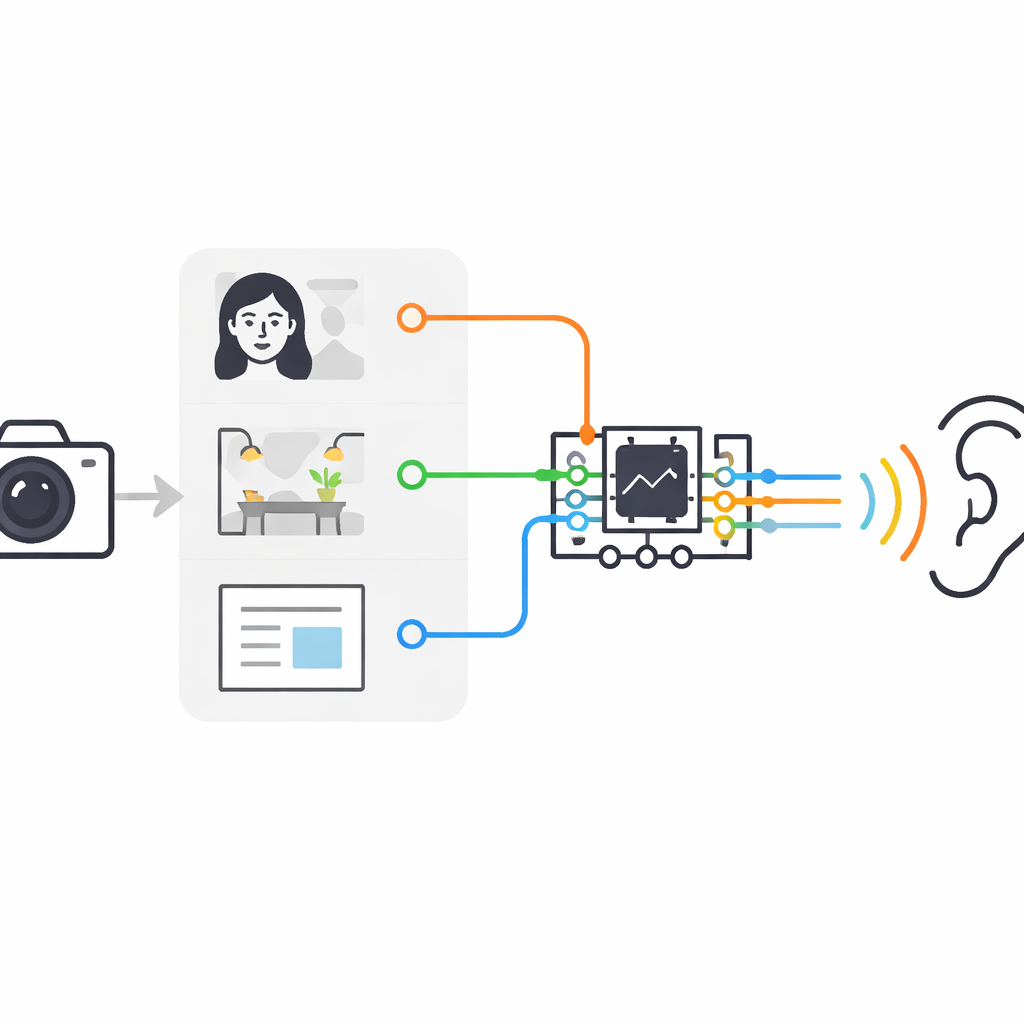

Jak inteligentne części współpracują

W tle BlindSpot‑VisionGuide opiera się na nowoczesnych narzędziach sztucznej inteligencji, ale wykorzystuje je w bardzo praktyczny, inżyniersko ukierunkowany sposób. W rozpoznawaniu twarzy każdą twarz przekształca w zwarte numeryczne „odciski palców” przy użyciu sieci głębokiej, a następnie porównuje ten odcisk z zapisanymi przykładami. W testach z 20 ochotnikami i 300 obrazami poprawnie rozpoznawał osoby około 94% czasu i zwykle udzielał odpowiedzi w mniej niż ćwierć sekundy na twarz. Dla opisów obrazów używa potężnego modelu o nazwie BLIP, który łączy moduł wizji z modułem językowym. To daje bogate opisy, ale na małym Raspberry Pi wygenerowanie i odczytanie podpisu zajmuje około 4,5 sekundy — wystarczająco szybko, by zrozumieć statyczną scenę, lecz jeszcze nie na tyle, by podejmować błyskawiczne decyzje, na przykład przy przechodzeniu ruchliwej ulicy. Moduł gazet korzysta z interfejsów programistycznych sieci (API), a nie kruchego web scrapingu, co umożliwia wiarygodny dostęp do aktualnych wiadomości przy ograniczeniu ilości danych osobowych wysyłanych przez sieć.

Równoważenie szybkości, mocy i prywatności

Kluczowym wyzwaniem jest zmieszczenie wszystkich trzech funkcji w malutkim, energooszczędnym komputerze bez polegania na odległych serwerach w chmurze. Autorzy traktują to jako problem inżynierii systemowej, a nie wyścig o coraz większe sieci neuronowe. Na raz działa tylko jeden moduł, współdzieląc kamerę, mikrofon i silnik mowy, aby kontrolować użycie pamięci i zużycie baterii. Rozpoznawanie twarzy i opisy scen działają w pełni lokalnie po zapisaniu modeli na urządzeniu, co pomaga chronić prywatność użytkownika. Jedynym regularnym użyciem internetu jest pobieranie świeżych wiadomości; nawet tam system może buforować artykuły, aby można je było odtworzyć później bez połączenia. Testy z 15 uczestnikami z uszkodzeniem wzroku oceniły ogólną użyteczność jako „doskonałą” w standardowej ankiecie, z wysokimi wskaźnikami powodzenia zadań i stosunkowo niskim obciążeniem poznawczym.

Co to oznacza w codziennym życiu

Mówiąc wprost, BlindSpot‑VisionGuide pokazuje, że tani, kieszonkowy komputer może zaoferować zestaw przydatnych „oczu i uszu” dla osoby, która nie może polegać na wzroku. Nie wynajduje nowych algorytmów uczenia; zamiast tego dowodzi, że istniejące narzędzia do rozpoznawania twarzy, przetwarzania języka i syntezy mowy można starannie połączyć tak, by działały lokalnie, reagowały wystarczająco szybko w wielu codziennych sytuacjach i szanowały prywatność użytkownika. System nie nadaje się jeszcze do szybkiej, krytycznej pod względem bezpieczeństwa nawigacji i wciąż zależy od internetu w kwestii wiadomości na żywo oraz obsługuje mowę tylko w języku angielskim. Jednak wraz z upowszechnianiem się akceleratorów sprzętowych, szybszych modeli i wielojęzycznych głosów, tego rodzaju zintegrowane, sterowane głosem urządzenie może stać się praktycznym towarzyszem dla osób z zaburzeniami wzroku, pomagając im rozpoznawać ludzi, rozumieć otoczenie i być na bieżąco z informacjami przy znacznie mniejszym uzależnieniu od innych.

Cytowanie: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Słowa kluczowe: technologie wspomagające, niedowidzenie, Raspberry Pi, widzenie komputerowe, tekst na mowę