Clear Sky Science · de

KI‑gestütztes BlindSpot VisionGuide‑System auf Raspberry Pi zur Steigerung der Selbstständigkeit sehbehinderter Nutzer

Menschen helfen, weniger auf das Sehen angewiesen zu sein

Für Millionen von Menschen mit eingeschränktem oder gar keinem Sehvermögen können alltägliche Aufgaben, die sehende Menschen für selbstverständlich halten — das Erkennen eines Freundes, das Erfassen dessen, was sich in einem Raum befindet, oder einfach das Informieren über die Nachrichten — ohne Hilfe anstrengend oder unmöglich sein. Dieses Papier stellt BlindSpot‑VisionGuide vor, ein kompaktes System auf Basis eines kostengünstigen Raspberry Pi‑Computers, das Sprachbefehle entgegennimmt, durch eine Kamera schaut und mit gesprochenen Anweisungen antwortet. Indem es visuelle Informationen in Echtzeit in Ton übersetzt, zielt es darauf ab, sehbehinderten Nutzern zu Hause, bei der Arbeit und unterwegs mehr Unabhängigkeit zu geben.

Eine kleine Box, drei nützliche Funktionen

BlindSpot‑VisionGuide bündelt drei Hauptfunktionen in einem einzigen Gerät. Erstens kann es vertraute Gesichter erkennen, sodass ein Nutzer erfährt, wer den Raum betreten hat, ohne nach einer Vorstellung warten zu müssen. Zweitens kann es in einfacher Sprache beschreiben, was die Kamera sieht, etwa eine Person, die an einem Tisch sitzt, oder einen Vogel, der auf einem Geländer ruht. Drittens kann es Schlagzeilen und kurze Zusammenfassungen aus Online‑Zeitungen abrufen und vorlesen. All das läuft auf einem Raspberry Pi 5, einem kreditkartengroßen Computer, der häufig in Hobbyprojekten verwendet wird, in Kombination mit einer kleinen Kamera, einem Mikrofon und einem Lautsprecher oder Kopfhörern.

Sprechen statt Tippen

Anstelle von Bildschirmen, Tasten oder Touchgesten verlässt sich das System fast vollständig auf Sprache. Der Raspberry Pi lauscht kontinuierlich auf einfache gesprochene Befehle wie „Starte das Gesichtsmodul“ oder „Starte das Zeitungsmodul“. Wenn der Nutzer die Gesichtserkennung auslöst, nimmt die Kamera Live‑Video auf, die Software isoliert Gesichter, vergleicht sie mit einer kleinen lokalen Galerie bekannter Personen und nennt dann die beste Übereinstimmung. Bei der Szenenbeschreibung hat der Nutzer kurz Zeit, die Kamera zu richten; das System macht dann ein Foto und verarbeitet es mit einem fortschrittlichen Bild‑zu‑Text‑Modell, das einen natürlich klingenden Satz erzeugt, der in Sprache umgewandelt wird. Für Nachrichten kontaktiert das System einen Onlinedienst, filtert aktuelle Artikel — nach Land, Datum und weiteren Optionen — und liest dann jeden Titel und jede Zusammenfassung in einer ruhigen, klaren Stimme vor.

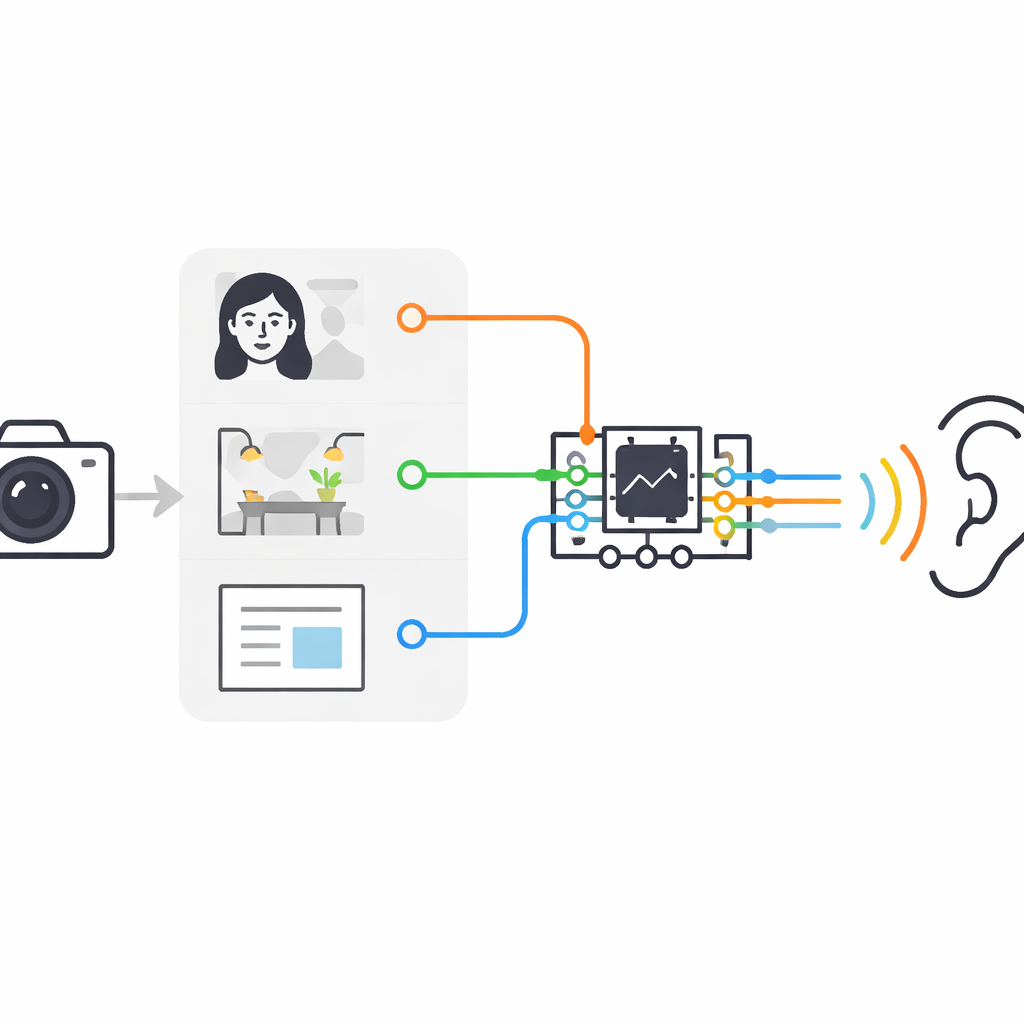

Wie die klugen Komponenten zusammenarbeiten

Im Hintergrund stützt sich BlindSpot‑VisionGuide auf moderne KI‑Werkzeuge, nutzt sie aber auf eine sehr praktische, ingenieurorientierte Weise. Für die Gesichtserkennung wandelt es jedes Gesicht in einen kompakten numerischen „Fingerabdruck“ mittels eines tiefen Netzwerks um und vergleicht diesen Fingerabdruck mit gespeicherten Beispielen. In Tests mit 20 Freiwilligen und 300 Bildern erkannte es Personen in etwa 94 % der Fälle korrekt und lieferte typischerweise innerhalb von unter einer Viertelsekunde pro Gesicht eine Antwort. Für Bildunterschriften verwendet es ein leistungsfähiges Modell namens BLIP, das ein Vision‑Modul und ein Sprachmodul kombiniert. Das erzeugt reichhaltige Beschreibungen, benötigt auf dem kleinen Raspberry Pi jedoch rund 4,5 Sekunden, um eine Bildunterschrift zu sprechen — schnell genug zum Verstehen einer statischen Szene, aber noch nicht für blitzschnelle Entscheidungen wie das Überqueren einer stark befahrenen Straße. Das Zeitungsmodul nutzt Web‑Programmierschnittstellen statt fragiler Web‑Scraping‑Methoden, was einen zuverlässigen Zugriff auf aktuelle Nachrichten ermöglicht und zugleich die Menge persönlicher Daten, die über das Netzwerk gesendet werden, begrenzt.

Balance zwischen Geschwindigkeit, Energieverbrauch und Datenschutz

Eine zentrale Herausforderung besteht darin, alle drei Funktionen in einem winzigen, energiearmen Computer unterzubringen, ohne auf entfernte Cloud‑Server angewiesen zu sein. Die Autorinnen und Autoren betrachten dies als ein System‑Engineering‑Problem statt als Wettlauf um immer größere neuronale Netze. Es läuft stets nur ein Modul zur Zeit, wobei Kamera, Mikrofon und Sprachengine geteilt werden, um Speicherverbrauch und Batterieentladung im Zaum zu halten. Gesichtserkennung und Szenenbeschreibung funktionieren vollständig offline, sobald die Modelle auf dem Gerät gespeichert sind, was zum Schutz der Privatsphäre beiträgt. Die einzige regelmäßige Internetnutzung dient dem Abruf aktueller Nachrichten; selbst hier kann das System Artikel zwischenspeichern, sodass sie später ohne Verbindung erneut abgespielt werden können. Nutzertests mit 15 sehbehinderten Teilnehmern bewerteten die Gesamt‑Usability in einem standardisierten Fragebogen als „ausgezeichnet“, mit hohen Erfolgsraten bei Aufgaben und vergleichsweise geringer mentaler Belastung.

Was das im Alltag bedeutet

Einfach ausgedrückt zeigt BlindSpot‑VisionGuide, dass ein kostengünstiger, taschengroßer Computer eine Reihe nützlicher „Augen und Ohren“ für Menschen bieten kann, die nicht auf das Sehen angewiesen sind. Es erfindet keine neuen Lernalgorithmen; vielmehr demonstriert es, dass bestehende Gesichts-, Sprach‑ und Textwerkzeuge sorgfältig kombiniert lokal betrieben, in vielen Alltagssituationen schnell genug reagieren und die Privatsphäre der Nutzer respektieren können. Das System ist noch nicht für schnelle, sicherheitskritische Navigation geeignet und hängt weiterhin für Live‑Nachrichten vom Internet sowie von englischsprachiger Sprachausgabe ab. Doch mit der Verbreitung von Hardwarebeschleunigern, schnelleren Modellen und mehrsprachigen Stimmen könnte eine solche integrierte, sprachgesteuerte Box zu einem praktischen Begleiter für sehbehinderte Nutzer werden und ihnen helfen, Menschen zu erkennen, ihre Umgebung zu verstehen und informiert zu bleiben — mit deutlich weniger Abhängigkeit von anderen.

Zitation: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

Schlüsselwörter: Hilfstechnologie, Sehbehinderung, Raspberry Pi, Computer Vision, Text‑zu‑Sprache