Clear Sky Science · ar

نظام BlindSpot‑VisionGuide المدعوم بالذكاء الاصطناعي على Raspberry Pi لتعزيز استقلالية المستخدمين ضعاف البصر

مساعدة الأشخاص على الاعتماد أقل على البصر

بالنسبة لملايين الأشخاص ذوي الرؤية المحدودة أو العمى، يمكن أن تكون المهام اليومية التي يعتبرها المبصرون أمراً مفروغاً منه — مثل التعرف على وجه صديق، أو فهم ما في غرفة، أو ببساطة الاطلاع على الأخبار — مستنزفة أو مستحيلة دون مساعدة. تعرض هذه الورقة نظام BlindSpot‑VisionGuide، وهو جهاز صغير مبني على حاسوب Raspberry Pi منخفض التكلفة يستمع للأوامر الصوتية، يطل عبر كاميرا، ويستجيب بتوجيهات منطوقة. من خلال تحويل المعلومات البصرية إلى صوت في الوقت الفعلي، يهدف النظام لمنح المستخدمين ضعاف البصر مزيداً من الاستقلالية في المنزل والعمل والتنقل.

صندوق صغير، ثلاث وظائف مفيدة

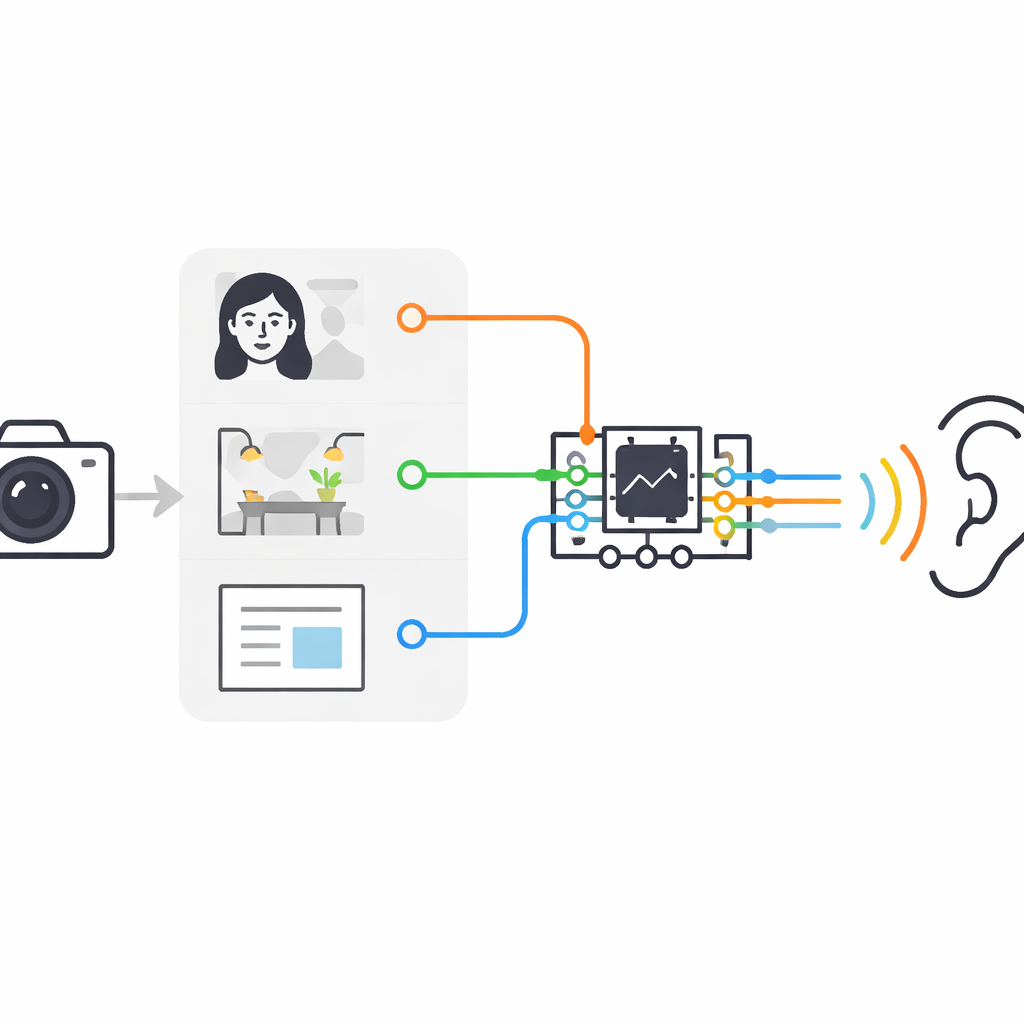

يجمع BlindSpot‑VisionGuide ثلاث قدرات رئيسية في جهاز واحد. أولاً، يمكنه التعرف على الوجوه المألوفة، بحيث يعرِف المستخدم من دخل الغرفة دون انتظار تقديم. ثانياً، يمكنه وصف ما تراه الكاميرا بلغة بسيطة، مثل «شخص جالس على طاولة» أو «طائر يستريح على درابزين». ثالثاً، يمكنه جلب عناوين الأخبار وملخصات قصيرة من الصحف الإلكترونية وقراءتها بصوت مسموع. يعمل كل ذلك على Raspberry Pi 5، وهو حاسوب بحجم بطاقة ائتمان يُستخدم كثيراً في المشاريع الهواية، مقترناً بكاميرا صغيرة وميكروفون ومكبر صوت أو سماعات رأس.

التحدث بدلاً من النقر

بدلاً من الشاشات أو الأزرار أو إيماءات اللمس، يعتمد النظام تقريباً بالكامل على الصوت. يستمع Raspberry Pi باستمرار لأوامر منطوقة بسيطة مثل «شغّل وحدة التعرف على الوجوه» أو «شغّل وحدة الصحف». عند تفعيل التعرف على الوجوه، تلتقط الكاميرا فيديو مباشرًا، يعزل البرنامج أي وجوه، يقارنها بمعرض صغير مخزن على الجهاز للأشخاص المعروفين، ثم ينطق أقرب تطابق. بالنسبة لوصف المشاهد، يحصل المستخدم على لحظة قصيرة لتوجيه الكاميرا؛ يلتقط النظام صورة ويمررها إلى نموذج متقدّم يحول الصورة إلى نص يُنتج جملة ذات نبرة طبيعية، تُحوَّل بعد ذلك إلى كلام. أما بالنسبة للأخبار، فيتصل النظام بخدمة على الإنترنت، يرشّح المقالات الحديثة — حسب البلد والتاريخ وخيارات أخرى — ثم يقرأ كل عنوان وملخص بصوت ثابت وواضح.

كيف تعمل الأجزاء الذكية معاً

في الخفاء، يستند BlindSpot‑VisionGuide إلى أدوات ذكاء اصطناعي حديثة لكنه يستخدمها بطريقة عملية ومركزة هندسياً. في التعرف على الوجوه، يحول كل وجه إلى «بصمة» رقمية مدمجة باستخدام شبكة عميقة، ثم يقارن هذه البصمة بأمثلة مخزنة. في اختبارات مع 20 متطوعاً و300 صورة، تعرف النظام على الأشخاص بدقة تقارب 94% وعادة ما كان يجيب في أقل من ربع ثانية لكل وجه. بالنسبة إلى توصيف الصور، يستخدم نموذجاً قوياً يُدعى BLIP، الذي يجمع بين وحدة رؤية ووحدة لغة. هذا يولّد أوصافاً غنية، لكن على Raspberry Pi الصغير يحتاج حوالي 4.5 ثانية لنطق التسميات — وهو وقت كافٍ لفهم مشهد ثابت، لكنه ليس سريعاً بما يكفي لقرارات فورية مثل عبور شارع مزدحم. تعتمد وحدة الصحف على واجهات برمجة تطبيقات ويب بدل الاعتماد على تجريف صفحات هش، مما يتيح وصولاً موثوقاً للأخبار الحديثة مع تقييد كمية البيانات الشخصية المرسلة عبر الشبكة.

موازنة السرعة والطاقة والخصوصية

التحدي الرئيسي هو تضمين كل القدرات الثلاث في حاسوب صغير منخفض الطاقة دون الاعتماد على خوادم سحابية بعيدة. يرى المؤلفون هذا كمشكلة هندسة نظم بدلاً من سباق نحو شبكات عصبية أكبر. يعمل مجرد موديل واحد في كل مرة، مع مشاركة الكاميرا والميكروفون ومحرك النطق للحد من استخدام الذاكرة واستهلاك البطارية. يعمل التعرف على الوجوه ووصف المشاهد بالكامل دون اتصال بالإنترنت بمجرد تخزين النماذج على الجهاز، ما يساعد في حماية خصوصية المستخدم. الاستخدام المنتظم الوحيد للإنترنت هو جلب الأخبار الطازجة، وحتى في هذا المجال يمكن للنظام تخزين المقالات مؤقتاً بحيث يمكن إعادة تشغيلها لاحقاً دون اتصال. قيّمت اختبارات المستخدمين مع 15 مشاركاً من ضعاف البصر سهولة الاستخدام العامة بأنها «ممتازة» في استبيان معياري، مع معدلات نجاح مهام عالية وعبء ذهني نسبيًا منخفض.

ماذا يعني هذا في الحياة اليومية

بكلمات بسيطة، يبيّن BlindSpot‑VisionGuide أن حاسوباً منخفض التكلفة بحجم الجيب يمكن أن يوفر مجموعة من «العيون والآذان» المفيدة لشخص لا يمكنه الاعتماد على البصر. لا يخترع النظام خوارزميات تعلم جديدة؛ بل يثبت أن أدوات التعرف على الوجوه واللغة والكلام الموجودة يمكن دمجها بعناية لتعمل محلياً، وتستجيب بسرعة كافية للعديد من المواقف اليومية، وتحترم خصوصية المستخدم. النظام غير مناسب بعد للتنقل السريع الحرج للسلامة، ولا يزال يعتمد على الإنترنت للأخبار الحية وعلى اللغة الإنجليزية فقط في النطق. لكن مع انتشار مسرّعات الأجهزة ونماذج أسرع وأصوات متعددة اللغات، قد يصبح هذا النوع من الصناديق المتكاملة والمحركة صوتياً رفيقاً عملياً لمستخدمي ضعاف البصر، يساعدهم على التعرف على الأشخاص، وفهم محيطهم، والبقاء على اطلاع مع اعتماد أقل على الآخرين.

الاستشهاد: Sudha, M., Swaminathan, S., Suba, M. et al. AI-powered BlindSpot VisionGuide system on raspberry Pi for enhancing independence of visually impaired users. Sci Rep 16, 11316 (2026). https://doi.org/10.1038/s41598-026-39724-9

الكلمات المفتاحية: تكنولوجيا مساعدة, ضعف البصر, Raspberry Pi, رؤية حاسوبية, تحويل النص إلى كلام