Clear Sky Science · pl

PatchCLIP umożliwia regionowe kontrastowe wspólne uczenie rekordów medycznych i obrazów z utratą osadzeń łat

Bardziej inteligentna pomoc przy zdjęciach klatki piersiowej

Radiolodzy codziennie analizują zdjęcia rentgenowskie klatki piersiowej, aby wykryć stany takie jak zapalenie płuc, płyn wokół płuc czy odma opłucnowa. Sztuczna inteligencja potrafi już wskazać, że na obrazie „coś jest nie tak”, ale często ma trudności z dokładnym wskazaniem miejsca problemu. W tym badaniu wprowadzono Patch‑CLIP, nową metodę AI zaprojektowaną nie tylko do stwierdzania obecności nieprawidłowości, lecz także do wskazywania jej prawdopodobnej lokalizacji na zdjęciu rentgenowskim, przy znacznie mniejszej liczbie adnotacji eksperckich niż w tradycyjnych systemach.

Dlaczego ważne jest znalezienie dokładnego miejsca

W obrazowaniu medycznym czas i precyzja mają kluczowe znaczenie. Obecne systemy wizja‑język uczą się na parach obrazów i towarzyszących im raportów, co pozwala rozpoznawać wzorce bez żmudnych, pikselowych etykiet od ekspertów. Jednak większość tych systemów traktuje obraz jako całość, wyłapując „ogólny sens”, ale pomijając szczegóły. To problem w przypadku zdjęć klatki piersiowej, gdzie subtelna linia czy mały cień mogą sygnalizować poważne schorzenie. Konwencjonalne detektory o wysokiej wydajności rozwiązują to, trenując się na wielu starannie narysowanych prostokątach wokół nieprawidłowości, ale takie oznaczanie jest kosztowne, czasochłonne i trudne do ustandaryzowania między radiologami i szpitalami.

Analiza zdjęć kawałek po kawałku

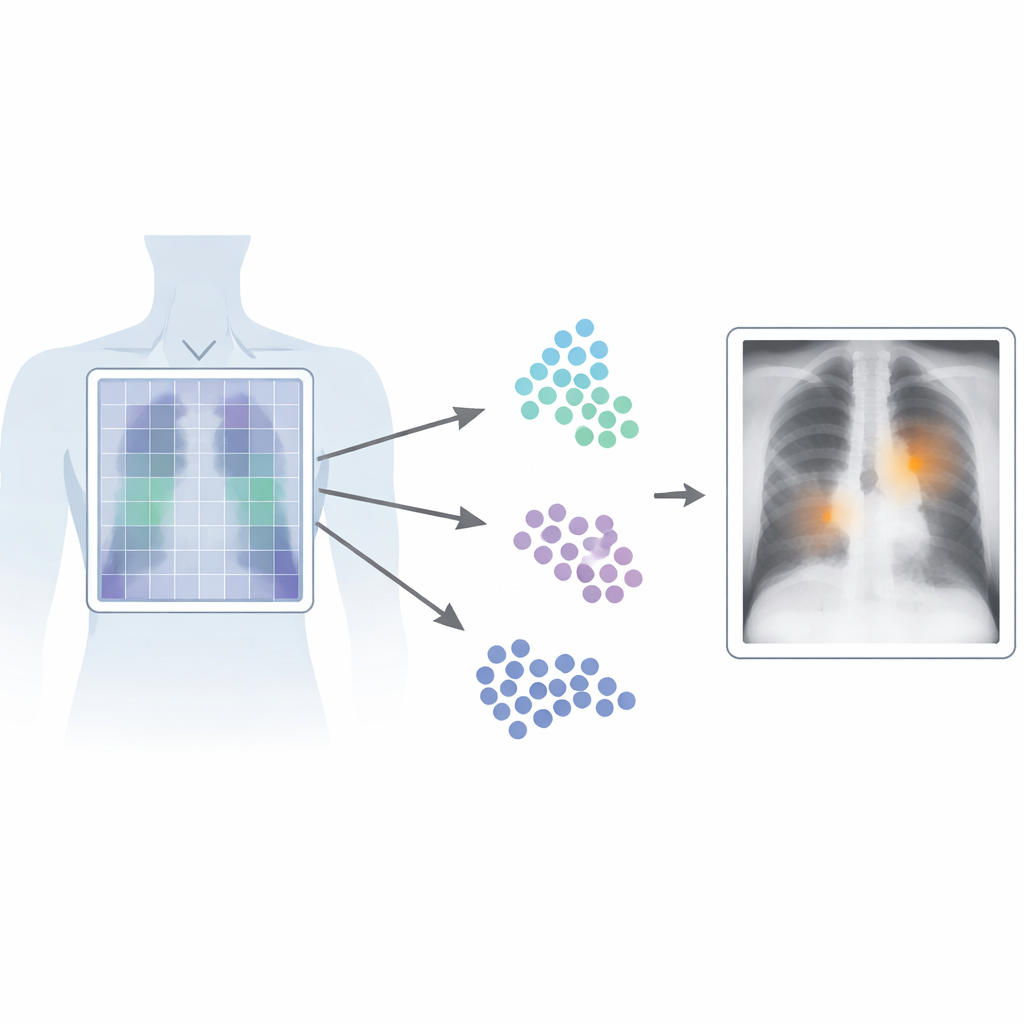

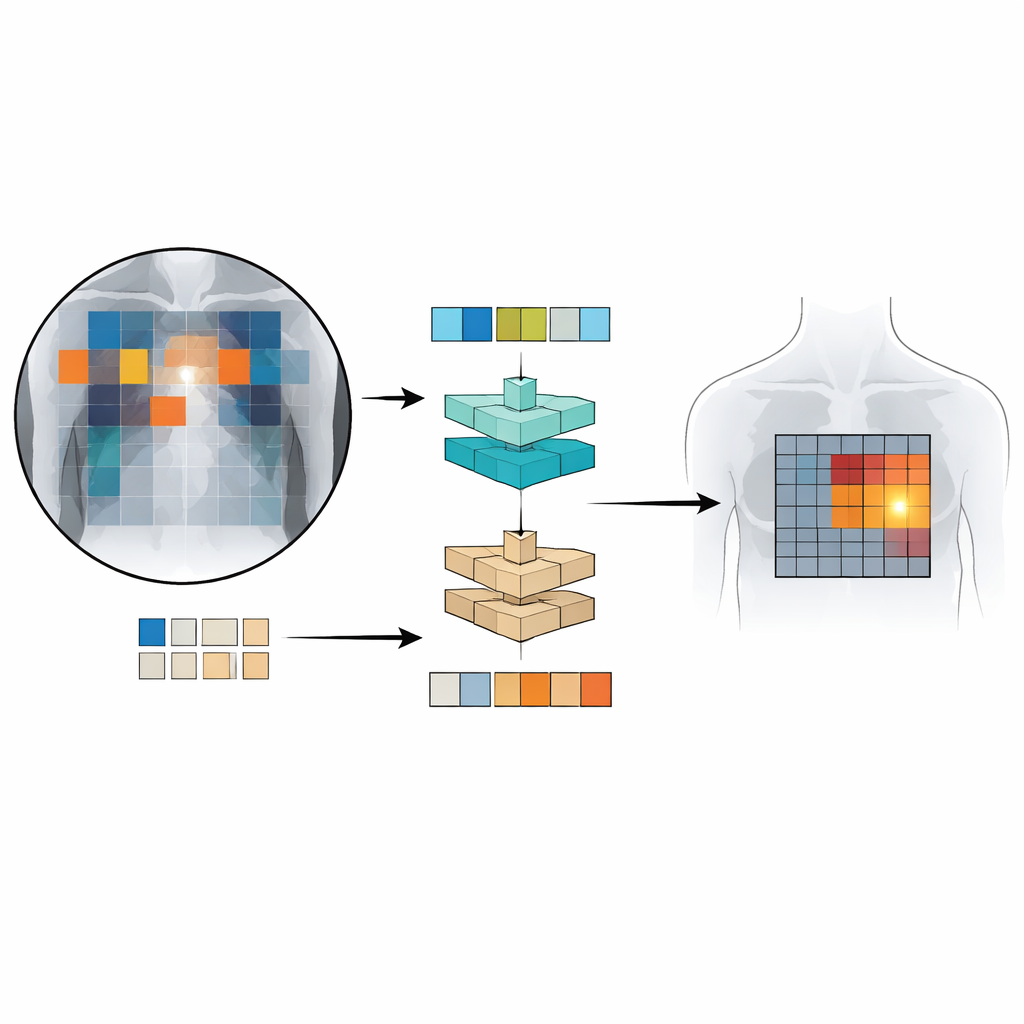

Patch‑CLIP bazuje na popularnym frameworku CLIP, który uczy się wspólnie z obrazów i tekstu, i rozbudowuje go w sposób lepiej dopasowany do potrzeb medycznych. Zamiast tylko generować jedną podsumowującą reprezentację całego zdjęcia rentgenowskiego, nowa metoda reprezentuje obraz jako siatkę małych fragmentów (patchy). Każdy patch jest mapowany do tej samej abstrakcyjnej przestrzeni co tekst opisujący medyczne stwierdzenie, na przykład „płyn w płucu” lub „brak płynu”. Autorzy wprowadzają dodatkowe cele treningowe, które zachęcają grupy istotnych patchy do zachowywania się jak lokalne detektory: patche pokrywające obszar z nieprawidłowością są przesuwane bliżej w tej przestrzeni do tekstu opisującego tę nieprawidłowość, podczas gdy patche z obszarów zdrowych przyciągane są w kierunku opisu „brak zmian”.

Nauczanie systemu przy mniejszej liczbie etykiet

Do treningu i testów Patch‑CLIP badacze wykorzystali kilka dużych zbiorów zdjęć rentgenowskich klatki piersiowej sparowanych z raportami radiologicznymi, w tym ponad pół miliona obrazów. Większość z nich użyto bez szczegółowych ręcznych oznaczeń; tylko podzbiór liczący około 16 000 zdjęć miał eksperckie pudełka wokół konkretnych zmian. Najpierw sieć „downscaler” uczy się, jak najlepiej zmniejszyć duże obrazy medyczne do rozdzielczości odpowiadającej standardowemu modelowi wizja‑język, przy zachowaniu istotnych szczegółów. Następnie, podczas strojenia na mniejszym, fachowo oznakowanym zbiorze, nowe straty związane z patchami uczą model łączyć konkretne części siatki obrazu z konkretnymi frazami z raportów. Ta konfiguracja pozwala systemowi jednocześnie uczyć się decyzji globalnych („czy występuje odma opłucnej?”) oraz przybliżonej lokalizacji („gdzie się prawdopodobnie znajduje?”).

Jak dobrze działa Patch‑CLIP?

Zespół porównał Patch‑CLIP z zaawansowanymi komercyjnymi detektorami zdjęć rentgenowskich klatki piersiowej oraz z rozwiniętym systemem wykrywania wizja‑język opracowanym pierwotnie do zwykłych fotografii. Używając klinicznej miary oceny, która równoważy czułość względem liczby fałszywych alarmów na obraz, Patch‑CLIP osiągnął wyniki na poziomie state‑of‑the‑art lub bliskie state‑of‑the‑art dla wielu zmian w płucach i sercu. Co ważne, mapy oparte na patchach wygenerowane przez Patch‑CLIP dawały mniej fałszywie podświetlonych obszarów niż standardowa uwaga (attention), która często aktywuje duże, nieistotne rejony. Dla stanów zajmujących zwykle większe obszary klatki, jak nagromadzenie płynu czy powiększenie serca, metoda szczególnie dobrze lokalizowała zmiany. Była mniej skuteczna dla niezwykle małych znalezisk, które mogą mieścić się w pojedynczym patchu, co sugeruje, że jeszcze drobniejsza siatka obrazów lub ulepszone architektury mogą dodatkowo poprawić wydajność.

Co to oznacza dla przyszłej opieki

Dla osób spoza specjalności kluczowa wiadomość jest taka, że Patch‑CLIP lepiej wykorzystuje pisemne raporty tworzone w codziennej praktyce klinicznej do nauczania systemów AI, gdzie patrzeć na zdjęcie rentgenowskie. Dopasowując opisy tekstowe do małych regionów obrazu, pomaga komputerom zarówno rozpoznawać, jak i w przybliżeniu lokalizować istotne zmiany przy mniejszej liczbie szczegółowych etykiet od ekspertów. Choć nie zastąpi radiologów, podejście to może pełnić rolę bardziej niezawodnej „drugiej pary oczu”, wskazując podejrzane obszary przy jednoczesnym utrzymaniu niskiej liczby fałszywych alarmów. W miarę rozszerzania metody na więcej chorób, obrazy o wyższej rozdzielczości i inne typy badań obrazowych, może stać się istotnym elementem skalowalnej, wyjaśnialnej AI medycznej.

Cytowanie: Bhat, S., Mansoor, A., Georgescu, B. et al. PatchCLIP enables region specific contrastive health record and image joint training with patch embedding loss. Sci Rep 16, 14688 (2026). https://doi.org/10.1038/s41598-026-52235-x

Słowa kluczowe: Sztuczna inteligencja do zdjęć rentgenowskich klatki piersiowej, lokalizacja w obrazowaniu medycznym, modele wizja‑język, nauka słabo nadzorowana, wsparcie komputerowe w radiologii