Clear Sky Science · pl

Zastosowanie uczenia reprezentacji w wykrywaniu ataków botnetowych

Dlaczego ukryte armie cybernetyczne dotyczą nas wszystkich

Za codziennym korzystaniem z internetu — od oglądania filmów po sprawdzanie stanu konta — kryją się ciche armie przejętych maszyn zwanych botnetami, które można skierować do zalewania stron, szerzenia oszustw lub kradzieży danych. Wykrycie tych botnetów na wczesnym etapie jest trudne, zwłaszcza gdy napastnicy ciągle zmieniają taktykę. Artykuł przedstawia nowy sposób „zobaczenia” podejrzanej aktywności w ruchu sieciowym poprzez przekształcenie surowych danych o połączeniach w zwarte obrazy, które model głębokiego uczenia potrafi zrozumieć, znacząco zwiększając szanse na wykrycie nowych, wcześniej nieznanych ataków botnetowych.

Rosnący problem cichych przejęć online

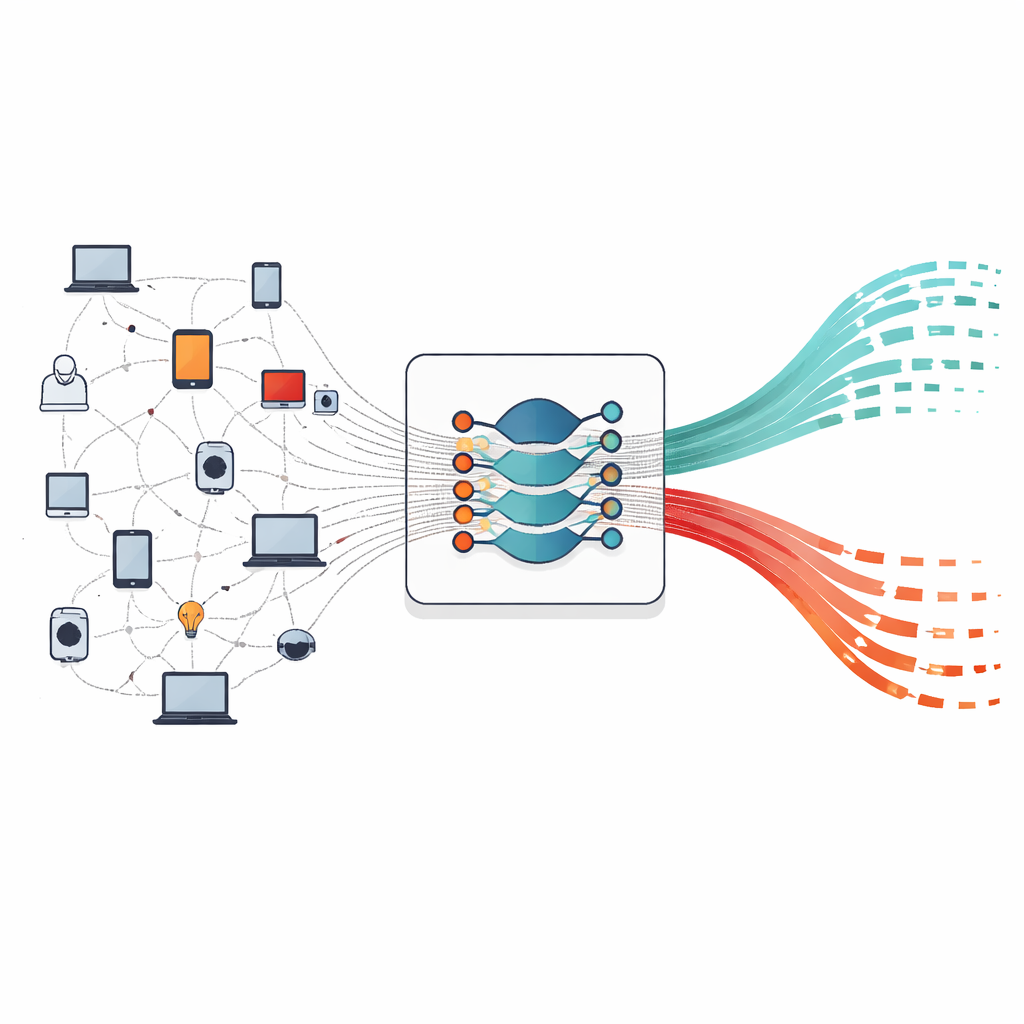

Botnety to sieci zwykłych urządzeń — laptopów, serwerów, a nawet urządzeń inteligentnego domu — które zostały potajemnie przejęte i mogą być zdalnie sterowane jako jedno narzędzie. Mogą one przytłoczyć usługi online ruchem śmieciowym, wysyłać fale spamu i wiadomości phishingowych albo po cichu wysysać dane osobowe i finansowe. Wraz z eksplozją liczby urządzeń podłączonych do internetu rośnie potencjalny rozmiar i siła tych ukrytych sieci. Tradycyjne zabezpieczenia opierają się na znanych „sygnaturach” ataków lub prostych regułach statystycznych, które działają tylko dopóty, dopóki napastnicy nie zmienią zbyt mocno swojego zachowania. Gdy pojawia się nowa rodzina botnetów lub sprytne maskowanie, starsze systemy często nie rozpoznają zagrożenia.

Ograniczenia dzisiejszych inteligentnych narzędzi bezpieczeństwa

W ostatnich latach badacze zwrócili się ku uczeniu maszynowemu i głębokiemu uczeniu, aby automatycznie wykrywać podejrzane wzorce w ruchu sieciowym. Wiele systemów używa ręcznie tworzonych podsumowań połączeń — takich jak średnie rozmiary pakietów czy czas trwania połączeń — jako wejścia do klasycznych modeli, jak drzewa decyzyjne czy lasy losowe. Choć metody te mogą dobrze działać na danych, do których były dostrojone, w dużej mierze zależą od wyboru cech zaprojektowanych przez człowieka. Gdy nowy botnet zachowuje się inaczej, stary zestaw cech może przestać uchwycić to, co jest niebezpieczne. Głębokie uczenie poprawiło sytuację przez naukę wzorców bezpośrednio z danych, ale większość podejść nadal traktuje ruch sieciowy jako proste tabele liczb, potencjalnie pomijając subtelne zależności, które mogłyby odróżnić nowy atak od normalnej aktywności.

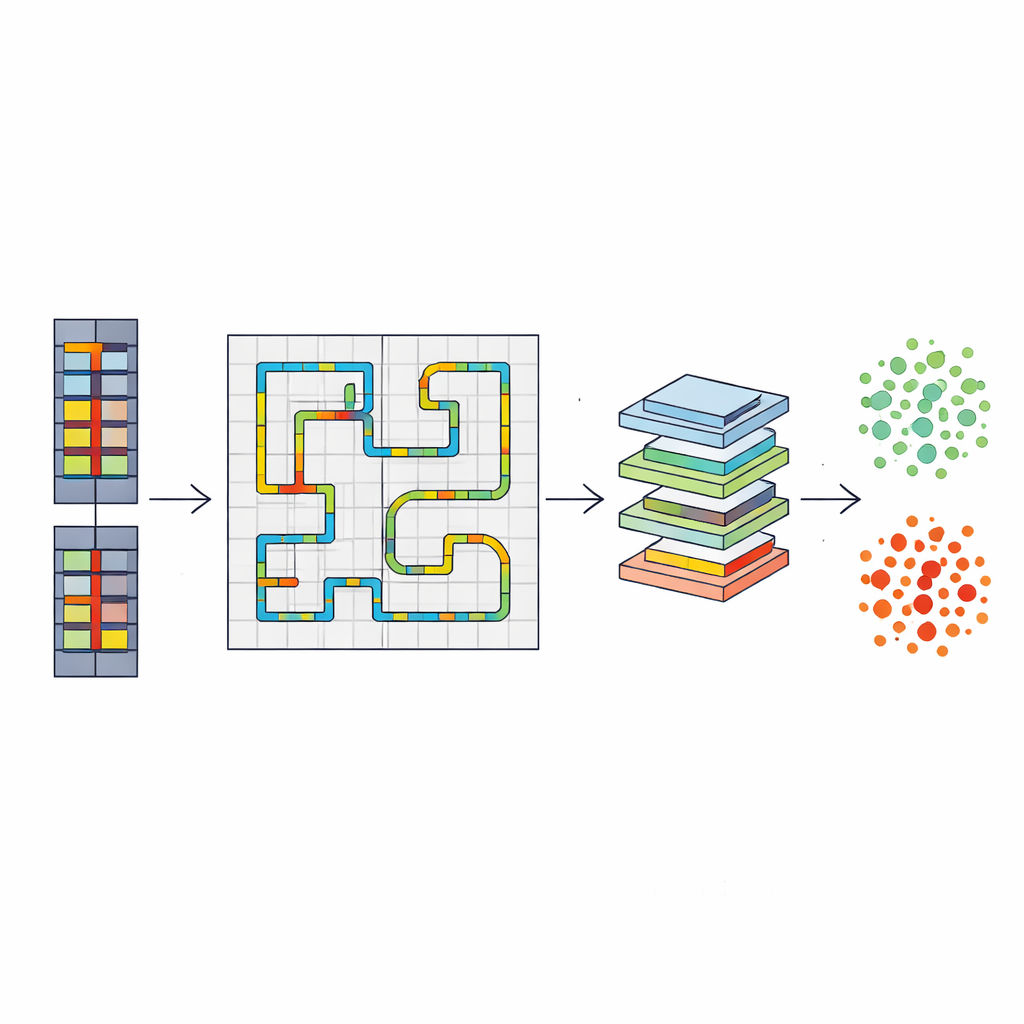

Przekształcanie surowego ruchu w obrazy czytelne dla sieci neuronowej

Badanie wprowadza kompleksowe rozwiązanie, które przeformułowuje wykrywanie botnetów jako problem rozpoznawania obrazów. Każdy przepływ sieciowy — rekord podsumowujący, kto z kim się komunikował, jak długo i ile danych przesłano — jest najpierw starannie zakodowany. Adresy IP są rozbijane na cztery składowe numeryczne, porty i protokoły są reprezentowane przez częstotliwość występowania, a wartości numeryczne, takie jak czas trwania i łączna liczba bajtów, skalowane do wspólnego zakresu. Z tych 19 liczb metoda buduje mały obraz w skali szarości przy użyciu krzywej wypełniającej przestrzeń Hilberta — wijącej ścieżki, która mapuje jednowymiarową listę wartości na dwuwymiarową siatkę, jednocześnie utrzymując bliskość sąsiadujących wartości. Mimo że większość pikseli jest pusta, niezerowe tworzą małe, spójne kształty, które splotowa sieć neuronowa potrafi nauczyć się rozpoznawać jako sygnatury zachowań normalnych lub złośliwych.

Test wytrzymałości systemu wobec zupełnie nowych zagrożeń

Aby sprawdzić, czy podejście oparte na obrazach rzeczywiście uogólnia, autor korzysta z realistycznego zestawu referencyjnego ruchu sieciowego CTU-13, który zawiera wiele zarejestrowanych infekcji botnetowych wymieszanych z normalną aktywnością. Model głębokiego uczenia jest trenowany tylko na jednej rodzinie botnetów, zwanej Murlo, a następnie testowany na zupełnie innej rodzinie, Rbot, której nigdy wcześniej nie widział. To ustawienie naśladuje rzeczywistą sytuację „zero‑day”, w której obrońca musi na bieżąco wykryć nowy wzorzec ataku. Proponowany system, oparty na klasyfikatorze obrazów ResNet-18 pracującym na zwartym obrazie 32×32, prawidłowo identyfikuje przepływy botnetowe z około 98% dokładnością ogólną i podobnie wysokim wynikiem F1, przy jednoczesnym utrzymaniu niskiego odsetka zarówno przeoczonych ataków, jak i fałszywych alarmów. W wyraźnym kontraście, silna tradycyjna metoda bazowa — Random Forest trenowany w tym samym scenariuszu — osiąga przyzwoitą dokładność ogólną, lecz niemal całkowicie nie rozpoznaje nowego botnetu, klasyfikując praktycznie cały złośliwy ruch jako nieszkodliwy.

Co to oznacza dla bezpieczniejszych sieci

Wyniki pokazują, że sposób reprezentacji danych sieciowych ma równie duże znaczenie jak wybór modelu. Organizując cechy połączeń w małe obrazy zachowujące lokalność, system uchwyca leżący u podstaw „kształt” złośliwego zachowania zamiast zapamiętywać konkretne liczby związane z jednym znanym botnetem. Pozwala to wykrywać powiązane, ale różne ataki z dużo większą niezawodnością. Ponieważ metoda wykorzystuje metadane i statystyki przepływów zamiast analizować zawartość pakietów, dobrze nadaje się do dzisiejszego świata szyfrowanej komunikacji i rozległych urządzeń Internetu Rzeczy. W praktyce praca ta wskazuje kierunek rozwoju systemów wykrywania włamań, które mogą adaptować się do nowych rodzin botnetów przy mniejszym nakładzie ręcznego dostrajania, oferując bardziej odporną linię obrony dla użytkowników prywatnych i organizacji.

Cytowanie: Le Ngoc, H. Application of representation learning in detecting botnet attacks. Sci Rep 16, 11977 (2026). https://doi.org/10.1038/s41598-026-40172-8

Słowa kluczowe: wykrywanie botnetów, bezpieczeństwo sieci, głębokie uczenie, uczenie reprezentacji, wykrywanie włamań